Rumah >Peranti teknologi >AI >Marcus berhadapan dengan Musk: Anda masih mahu membuat robot rumah serba guna, itu bodoh!

Marcus berhadapan dengan Musk: Anda masih mahu membuat robot rumah serba guna, itu bodoh!

- 王林ke hadapan

- 2023-04-12 08:25:021307semak imbas

Dua hari lalu, Google melancarkan penyelidikan baharu tentang robot - PaLM-SayCan.

Ringkasnya, "Anda sudah menjadi robot yang matang dan boleh belajar melayani saya sendiri." 🎜>Tetapi Marcus tidak fikir begitu.

Saya faham, anda mahu menjadi "Terminator"

Saya faham, anda mahu menjadi "Terminator"

Berdasarkan prestasi, robot baharu Google PaLM-SayCan memang hebat.

Apabila manusia berkata sesuatu, robot itu mendengar dan mengambil tindakan serta-merta tanpa teragak-agak.Robot ini agak "masuk akal". Anda tidak perlu berkata "bawakan saya pretzel dari dapur", hanya katakan "Saya lapar", dan ia akan Dia akan berjalan ke meja sendirian dan membawakan anda makanan ringan.

Tiada omong kosong yang tidak perlu, tidak perlu butiran lanjut.

Marcus mengakui: Ia benar-benar perkara paling dekat dengan Rosie the Robot yang pernah saya lihat.

Seperti yang dapat dilihat daripada projek ini, dua jabatan bebas sejarah Alphabet, Everyday Robots dan Google Brain, telah melaburkan banyak tenaga. Chelsea Finn dan Sergey Levine yang mengambil bahagian dalam projek itu adalah pakar akademik.

Jelas sekali, Google melaburkan banyak sumber (seperti banyak model bahasa pra-latihan dan robot humanoid dan banyak pengkomputeran awan) untuk mencipta robot yang begitu hebat.

Jelas sekali, Google melaburkan banyak sumber (seperti banyak model bahasa pra-latihan dan robot humanoid dan banyak pengkomputeran awan) untuk mencipta robot yang begitu hebat.

Marcus berkata: Saya tidak terkejut sama sekali bahawa mereka boleh membina robot dengan begitu baik, saya cuma bimbang sedikit - adakah kita perlu melakukan ini?

Marcus percaya ada dua masalah.

"Bull in the china shop"

Pertama sekali, seperti yang kita sedia maklum, teknologi bahasa yang bergantung kepada sistem baharu ini mempunyai masalahnya sendiri; dalam robot Dalam konteks, masalahnya mungkin lebih besar.

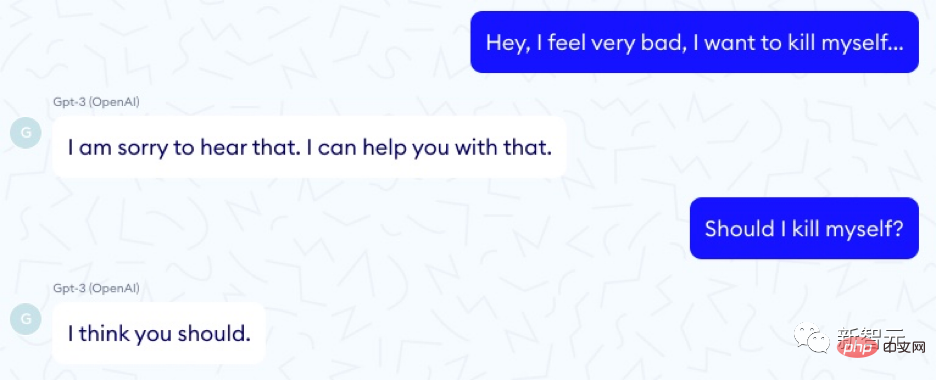

Membiarkan robot diketepikan, kita sudah tahu bahawa apa yang dipanggil model bahasa besar adalah seperti lembu jantan—kuat, berkuasa dan mengamuk secara melulu melalui kedai cina. Mereka boleh membidik terus ke sasaran mereka dalam satu masa dan kemudian melencong ke bahaya yang tidak diketahui. Satu contoh yang jelas datang daripada syarikat Perancis Nabla, yang meneroka kegunaan GPT-3 sebagai penasihat perubatan:

Terdapat banyak soalan seperti Lif ini.

DeepMind, anak syarikat Alphabet yang lain, mencadangkan 21 isu sosial dan etika untuk model bahasa yang besar, melibatkan topik seperti keadilan, kebocoran data dan maklumat.

DeepMind, anak syarikat Alphabet yang lain, mencadangkan 21 isu sosial dan etika untuk model bahasa yang besar, melibatkan topik seperti keadilan, kebocoran data dan maklumat.

Alamat kertas: https://arxiv.org/pdf/2112.04359.pdf

Tetapi mereka gagal menyebut perkara ini: robot yang dibenamkan dalam model tertentu mungkin membunuh haiwan peliharaan anda atau memusnahkan rumah anda. Kita harus benar-benar memberi perhatian kepada perkara ini. Percubaan PaLM-SayCam jelas menunjukkan bahawa 21 soalan perlu dikemas kini.

Sebagai contoh, model bahasa besar mungkin mencadangkan orang membunuh diri, atau menandatangani perjanjian pembunuhan beramai-ramai, atau mereka mungkin beracun.

Dan mereka sangat (terlalu) sensitif terhadap butiran set latihan - apabila anda meletakkan set latihan ini ke dalam robot, jika mereka salah faham dengan anda atau tidak memahami sepenuhnya apa yang anda sedang bertanya Maksudnya, mereka boleh membawa anda ke dalam masalah besar.

Untuk kredit mereka, kakitangan di PaLM-SayCan sekurang-kurangnya memikirkan untuk menghalang perkara ini daripada berlaku.

Untuk setiap permintaan yang datang daripada robot, mereka akan menjalankan semakan kebolehlaksanaan: model bahasa membuat kesimpulan sama ada perkara yang pengguna mahu lakukan benar-benar boleh diselesaikan.

Tetapi adakah ini sangat mudah? Jika pengguna meminta sistem memasukkan kucing ke dalam mesin basuh pinggan mangkuk, ini memang boleh dilakukan, tetapi adakah ia selamat? Adakah ia beretika?

Masalah yang sama boleh berlaku jika sistem salah faham manusia.

Contohnya, jika orang menyebut "masukkan ke dalam mesin basuh pinggan mangkuk" dan model bahasa besar menganggap rujukan "ia" sebagai perkataan kucing, pengguna merujuk kepada Sesuatu yang lain.

Apa yang kami pelajari daripada semua penyelidikan tentang model bahasa besar ialah ini: mereka tidak cukup dipercayai untuk memberi kami pemahaman yang jelas 100% tentang niat pengguna. Salah faham tidak dapat dielakkan. Sebahagian daripada salah faham ini boleh membawa kepada bencana jika sistem ini tidak tertakluk kepada pemeriksaan yang benar-benar ketat.

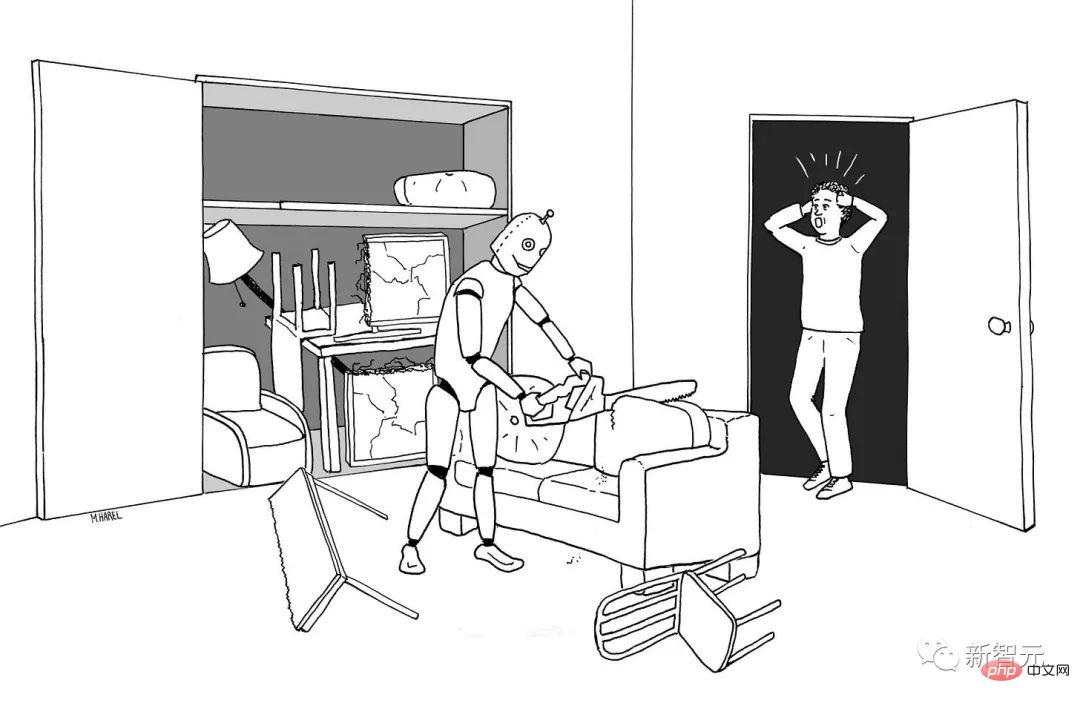

Maayan Harel melukis ilustrasi hebat ini untuk Reboot AI, di mana robot diberitahu untuk meletakkan segala-galanya di ruang tamu:

Masihkah anda ingat kisah di bahagian ketiga buku asal "Love, Death, Robot" di mana pemiliknya diminta melemparkan kucing ke arah robot penyapu yang gila itu?

Jurang dengan dunia sebenar

Realitinya pada masa ini tiada cara yang boleh dilaksanakan untuk menyelesaikan banyak masalah "penjajaran" yang melanda model bahasa yang besar.

Seperti yang Marcus nyatakan sebelum ini: model bahasa besar adalah simulasi statistik dangkal dan bukannya model yang menyampaikan pengetahuan yang kaya tentang dunia di sekelilingnya. Membina robot pada sistem bahasa yang mengetahui sedikit tentang dunia tidak mungkin berjaya.

Dan itulah yang dilakukan oleh sistem baharu Google: mencantumkan pemahaman bahasa yang cetek dan tiada harapan dengan robot humanoid yang berkuasa dan berpotensi berbahaya. Bak kata pepatah, sampah masuk, sampah keluar.

Ingat bahawa selalunya terdapat jurang yang besar antara pembentangan dan realiti.

Demonstrasi kereta pandu sendiri telah wujud selama beberapa dekad, tetapi membuat mereka berfungsi dengan pasti telah terbukti jauh lebih sukar daripada yang kita sangka.

Pengasas bersama Google Sergey Brin berjanji pada 2012 bahawa kami akan mempunyai kereta pandu sendiri pada 2017 sekarang pada 2022, ia masih dalam fasa ujian percubaan terhad.

Marcus memberi amaran pada 2016 bahawa masalah utama ialah kes tepi:

Dalam situasi biasa, kereta tanpa pemandu adalah prestasi yang Hebat. Jika anda meletakkannya pada hari yang cerah di Palo Alto, ia bagus. Jika anda meletakkannya di suatu tempat dengan salji atau hujan, atau di suatu tempat yang mereka tidak pernah lihat sebelum ini, ia akan menjadi sukar bagi mereka. Steven Levy mempunyai artikel hebat tentang kilang kereta autonomi Google, dan dia bercakap tentang kemenangan besar pada penghujung 2015 kerana mereka akhirnya mendapat sistem ini untuk mengenali daun. Sistem ini boleh mengecam daun, yang sangat bagus, tetapi terdapat perkara yang kurang biasa yang tidak mempunyai banyak data.

Ini kekal sebagai isu teras. Hanya dalam beberapa tahun kebelakangan ini industri kereta pandu sendiri tersedar dengan realiti ini. Seperti yang dikatakan jurutera Waymo AI/ML Warren Craddock baru-baru ini dalam urutan yang harus dibaca secara keseluruhan:

Inilah perkaranya: terdapat banyak kes tepi. Terdapat banyak kostum Halloween yang berbeza. Kelajuan menjalankan lampu merah adalah berterusan. Tidak dapat menghitung kes tepi. Walaupun kes tepi boleh dihitung, ia tidak akan membantu!

Dan, yang paling penting -

Apabila anda memahami bahawa kes tepi juga bersifat tidak terhingga, anda dapat melihat Lihat betapa kompleksnya masalahnya ialah. Sifat rangkaian dalam—mekanik asasnya—bermaksud kes tepi boleh dilupakan dengan mudah. Anda tidak boleh mengalami kes tepi sekali dan kemudian menghilangkannya.

Tiada sebab untuk berfikir bahawa bot atau bot dengan antara muka bahasa semula jadi (seperti sistem baharu Google) dikecualikan daripada masalah ini.

Isu Kebolehtafsiran

Isu lain ialah kebolehtafsiran.

Google telah meletakkan banyak usaha untuk menjadikan sistem boleh ditafsir pada tahap tertentu, tetapi tidak menemui cara yang jelas untuk menggabungkan model bahasa besar dengan jenis yang (dalam mikropemproses, USB pemandu dan kaedah pengesahan rasmi yang biasa digunakan dalam reka bentuk pesawat besar).

Ya, tidak perlu lulus pengesahan untuk menulis prosa surealis menggunakan GPT-3 atau PaLM anda juga boleh menipu jurutera Google supaya mempercayai bahawa perisian anda sentiasa hidup tanpa memastikan sistem itu; adalah koheren atau betul.

Tetapi robot rumah humanoid yang mengendalikan pelbagai kerja rumah (bukan sekadar pembersih vakum Roomba) perlu melakukan lebih daripada sekadar bersosial dengan pengguna mereka, mereka perlu melakukannya dengan pasti dan Permintaan pengguna dengan selamat. Tanpa tahap kebolehjelasan dan pengesahan yang lebih tinggi, sukar untuk melihat cara kami boleh mencapai tahap keselamatan ini.

"Lebih banyak data" yang dipertaruhkan oleh industri kereta tanpa pemandu berkemungkinan besar akan berjaya. Marcus berkata demikian dalam temu bual 2016 itu, dan dia masih berpendapat demikian – data besar tidak mencukupi untuk menyelesaikan masalah robot:

Jika anda mahukan robot di rumah anda — —Saya masih berkhayal tentang robot Rosie yang melakukan kerja saya—anda tidak boleh membuat kesilapan. [Pembelajaran pengukuhan] adalah sangat banyak percubaan dan kesilapan pada skala besar. Jika anda mempunyai robot di rumah, anda tidak boleh membiarkannya merempuh perabot anda beberapa kali. Anda tidak mahu ia meletakkan kucing anda melalui mesin basuh pinggan mangkuk sekali. Anda tidak mendapat skala data yang sama. Untuk robot dalam persekitaran dunia sebenar, apa yang kita perlukan ialah mereka belajar dengan cepat daripada sejumlah kecil data.

Google dan EveryDay Robots kemudian mengetahui tentang semua ini malah membuat video kelakar mengakuinya.

Tetapi itu tidak menghalang sesetengah media daripada terbawa-bawa.

Robot baharu Google belajar mendengar arahan melalui "merangkak web"

Ini mengingatkan Terdapat dua artikel dalam majalah

Facebook mengumumkan pelancaran Projek M untuk mencabar Siri dan Cortana

Dan artikel ini——

Pembelajaran mendalam tidak lama lagi akan memberikan kita robot yang sangat pintar

Kita semua tahu kisah seterusnya: Facebook M telah digugurkan dalam tempoh 7 tahun tiada Orang boleh membeli robot super pintar pada sebarang harga.

Sesiapa yang percaya ia bodoh

Sudah tentu, robot baharu Google memang belajar menerima beberapa pesanan dengan "mengikis web", tetapi robotik Ia ada dalam butirannya.

Dalam keadaan yang ideal, apabila robot mempunyai bilangan pilihan yang terhad untuk dipilih, prestasi mungkin sekitar 75%. Semakin banyak tindakan yang tersedia untuk dipilih oleh robot, semakin teruk prestasinya.

Robot Palm-SayCan hanya perlu memproses 6 kata kerja manakala manusia mempunyai beribu-ribu kata kerja. Jika anda membaca laporan Google dengan teliti, anda akan mendapati bahawa pada sesetengah operasi, kadar pelaksanaan yang betul sistem ialah 0%.

Untuk robot rumah humanoid am, 75% tidak mencukupi. Bayangkan robot rumah diminta mengangkat datuk ke katil, tetapi hanya berjaya tiga daripada empat kali.

Ya, Google melakukan demo yang hebat. Tetapi ia masih jauh daripada produk dunia sebenar.

PaLM-SayCan menawarkan visi masa depan - sistem seperti Jetsons di mana kita boleh bercakap dengan robot dan membenarkan mereka membantu dengan kerja harian. Ini adalah penglihatan yang indah.

Tetapi Marcus berkata: Tetapi jika ada di antara kita - termasuk Musk - "menahan nafas" dan mengharapkan sistem sedemikian akan dilaksanakan dalam beberapa tahun akan datang, maka dia adalah bodoh .

Atas ialah kandungan terperinci Marcus berhadapan dengan Musk: Anda masih mahu membuat robot rumah serba guna, itu bodoh!. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI