Rumah >Peranti teknologi >AI >Transformer meniru otak, melepasi 42 model dalam meramalkan pengimejan otak, dan juga boleh mensimulasikan penghantaran antara deria dan otak

Transformer meniru otak, melepasi 42 model dalam meramalkan pengimejan otak, dan juga boleh mensimulasikan penghantaran antara deria dan otak

- 王林ke hadapan

- 2023-04-11 21:16:211244semak imbas

Banyak model aplikasi AI kini perlu menyebut struktur model:

Transformer.

Ia meninggalkan CNN dan RNN tradisional dan sepenuhnya terdiri daripada mekanisme Perhatian.

Transformer bukan sahaja memberikan pelbagai model aplikasi AI keupayaan untuk menulis artikel dan puisi, tetapi juga bersinar dalam aspek pelbagai modal.

Terutama selepas keluaran ViT (Vision Transformer), halangan model antara CV dan NLP telah dipecahkan, dan hanya satu model Transformer boleh mengendalikan tugas berbilang modal.

(Tiada siapa boleh mengatakan betapa hebatnya ia selepas membacanya)

Walaupun Transformer pada asalnya direka untuk tugas bahasa, ia juga mempunyai potensi besar dalam meniru otak.

Tidak, seorang penulis saintifik menulis blog tentang cara Transformer memodelkan otak.

Apa kata dia datang ke Kangkang?

Transformer: Lakukan apa yang otak lakukan

Pertama sekali, kita perlu menyelesaikan evolusinya.

Mekanisme Transformer mula-mula muncul 5 tahun lalu Keupayaannya untuk melakukan dengan begitu hebat sebahagian besarnya disebabkan oleh mekanisme Perhatian Sendiri.

Bagaimana Transformer meniru otak, teruskan membaca di bawah.

Pada tahun 2020, pasukan penyelidik saintis komputer Austria Sepp Hochreiter menggunakan Transformer untuk menyusun semula rangkaian neural Hopfield (model pengambilan memori, HNN).

Malah, rangkaian neural Hopfield telah dicadangkan 40 tahun yang lalu, dan sebab mengapa pasukan penyelidik memilih untuk menyusun semula model ini selepas beberapa dekad adalah seperti berikut:

Pertama, rangkaian ini mengikuti A peraturan am: Neuron yang aktif pada masa yang sama mewujudkan hubungan yang kuat antara satu sama lain.

Kedua, proses mendapatkan semula ingatan oleh rangkaian neural Hopfield mempunyai persamaan tertentu dengan pelaksanaan Transformer bagi mekanisme Perhatian Kendiri.

Jadi pasukan penyelidik menyusun semula HNN untuk mewujudkan hubungan yang lebih baik antara neuron untuk menyimpan dan mendapatkan lebih banyak kenangan.

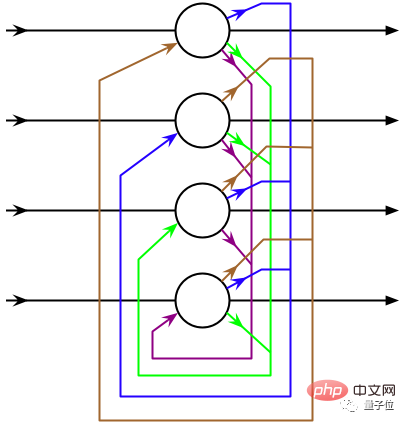

Proses penyusunan semula, secara ringkasnya, adalah untuk mengintegrasikan mekanisme perhatian Transformer ke dalam HNN, supaya HNN tak selanjar asal menjadi keadaan berterusan.

△Sumber: Wikipedia

Rangkaian Hopfield yang disusun semula boleh disepadukan ke dalam seni bina pembelajaran mendalam sebagai lapisan untuk membenarkan penyimpanan dan akses data input mentah , keputusan pertengahan, dsb.

Oleh itu, Hopfield sendiri dan Dmitry Krotov dari Makmal Kepintaran Buatan MIT Watson kedua-duanya berkata:

Rangkaian saraf Hopfield berasaskan Transformer adalah munasabah secara biologi.

Walaupun ini serupa dengan cara otak berfungsi pada tahap tertentu, ia tidak cukup tepat dalam beberapa aspek.

Oleh itu, ahli sains saraf pengiraan Whittington dan Behrens menyesuaikan kaedah Hochreiter dan membuat beberapa pembetulan pada rangkaian Hopfield yang disusun semula, meningkatkan lagi prestasi model dalam tugasan neurosains (mereplikasi corak tembakan saraf dalam otak) ) prestasi.

△Tim Behrens (kiri) James Whittington (kanan) Sumber: quantamagazine

Ringkasnya, semasa pengekodan-penyahkodan, model tidak lagi Sebaliknya pengekodan kenangan sebagai jujukan linear, mengekodnya sebagai koordinat dalam ruang dimensi tinggi.

Secara khusus, TEM (Tolman-Eichenbaum Machine) diperkenalkan ke dalam model.

TEM ialah sistem ingatan bersekutu yang dibina untuk meniru fungsi navigasi spatial hippocampus.

Ia dapat membuat generalisasi pengetahuan struktur ruang dan bukan ruang, meramalkan prestasi neuron yang diperhatikan dalam tugas memori spatial dan bersekutu, dan menerangkan fenomena pemetaan semula dalam hippocampus dan korteks entorhinal.

Gabungkan TEM dan Transformer, yang mempunyai banyak fungsi, untuk membentuk TEM-transformer (TEM-t).

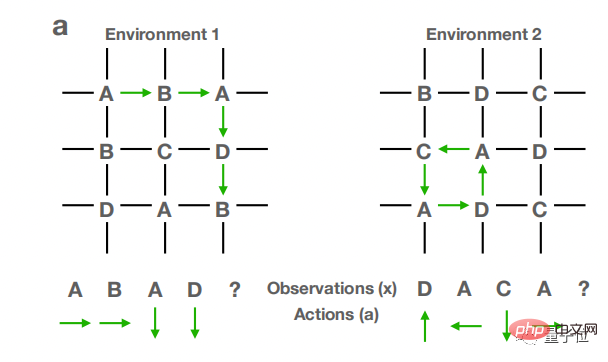

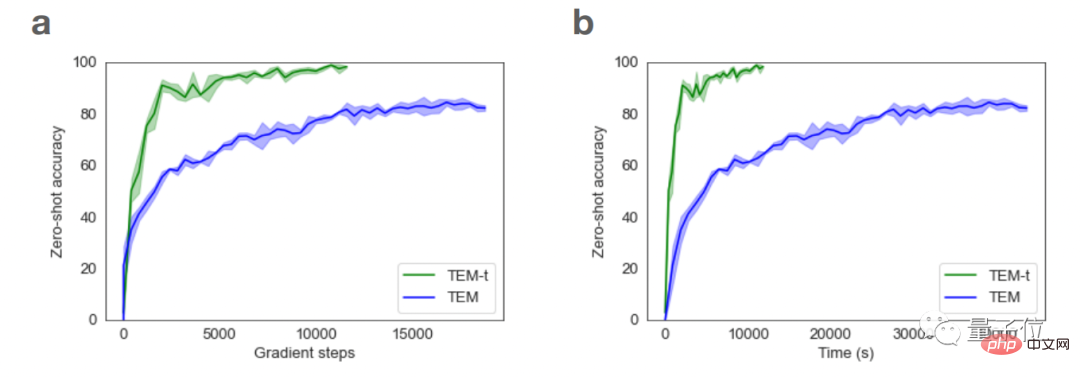

Kemudian, biarkan model TEM-t dilatih dalam berbilang persekitaran spatial yang berbeza Struktur persekitaran adalah seperti yang ditunjukkan dalam rajah di bawah.

Dalam TEM-t, ia masih mempunyai mekanisme Perhatian Kendiri Transformer. Dengan cara ini, hasil pembelajaran model boleh dipindahkan ke persekitaran baharu dan digunakan untuk meramalkan struktur spatial baharu.

Penyelidikan juga menunjukkan bahawa berbanding TEM, TEM-t lebih cekap dalam melaksanakan tugasan neurosains, dan ia juga boleh menangani lebih banyak masalah dengan sampel pembelajaran yang lebih sedikit.

Transformer semakin mendalam untuk meniru corak otak Dalam erti kata lain, perkembangan corak Transformer juga sentiasa menggalakkan pemahaman kita tentang prinsip kerja fungsi otak.

Bukan itu sahaja, dalam beberapa aspek, Transformer juga boleh meningkatkan pemahaman kita tentang fungsi otak yang lain.

Transformer membantu kita memahami otak

Sebagai contoh, tahun lepas, ahli sains saraf pengiraan Martin Schrimpf menganalisis 43 model rangkaian saraf yang berbeza untuk memerhati kesannya terhadap pengukuran aktiviti saraf manusia: Magnetisme Fungsian Kuasa ramalan resonans pengimejan (fMRI) dan laporan elektroensefalografi kortikal (EEG).

Antaranya, model Transformer boleh meramalkan hampir semua perubahan yang terdapat dalam pengimejan.

Mengimbas kembali, mungkin kita juga boleh meramalkan operasi fungsi otak yang sepadan daripada model Transformer.

Selain itu, baru-baru ini saintis komputer Yujin Tang dan David Ha mereka bentuk model yang secara sedar boleh menghantar sejumlah besar data secara rawak dan tidak teratur melalui model Transformer, meniru cara tubuh manusia menghantar pemerhatian deria ke otak .

Transformer ini seperti otak manusia dan boleh berjaya memproses aliran maklumat yang tidak teratur.

Walaupun model Transformer sentiasa bertambah baik, ia hanyalah satu langkah kecil ke arah model otak yang tepat, dan penyelidikan yang lebih mendalam diperlukan untuk mencapai titik akhir.

Jika anda ingin mengetahui lebih lanjut tentang cara Transformer meniru otak manusia, anda boleh klik pada pautan di bawah~

Pautan rujukan:

[1]https:// www.quantamagazine.org /how-ai-transformers-mimic-parts-of-the-brain-20220912/

[2]https://www.pnas.org/doi/10.1073/pnas.2105646118

[3]https://openreview.net/forum?id=B8DVo9B1YE0

Atas ialah kandungan terperinci Transformer meniru otak, melepasi 42 model dalam meramalkan pengimejan otak, dan juga boleh mensimulasikan penghantaran antara deria dan otak. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI