Rumah >Peranti teknologi >AI >Cara menggunakan pembelajaran mesin untuk menganalisis sentimen

Cara menggunakan pembelajaran mesin untuk menganalisis sentimen

- 王林ke hadapan

- 2023-04-11 16:49:032315semak imbas

Kami menggunakan algoritma pembelajaran mesin yang berbeza untuk analisis sentimen, dan kemudian membandingkan keputusan ketepatan setiap algoritma untuk menentukan algoritma yang paling sesuai untuk masalah ini.

Analisis sentimen ialah kandungan penting dalam pemprosesan bahasa semula jadi (NLP). Emosi ialah perasaan yang kita ada tentang sesuatu peristiwa, objek, situasi, atau perkara. Analisis sentimen ialah bidang penyelidikan yang secara automatik mengekstrak emosi manusia daripada teks. Ia perlahan-lahan mula berkembang pada awal 90-an.

Artikel ini akan membolehkan anda memahami cara menggunakan pembelajaran mesin (ML) untuk analisis sentimen dan membandingkan hasil algoritma pembelajaran mesin yang berbeza. Matlamat artikel ini bukan untuk mengkaji cara meningkatkan prestasi algoritma.

Kini, kita hidup dalam masyarakat yang serba pantas, semua barangan boleh dibeli dalam talian, dan semua orang boleh menyiarkan ulasan mereka sendiri dalam talian. Dan ulasan negatif dalam talian terhadap sesetengah produk boleh merosakkan reputasi syarikat, sekali gus menjejaskan jualan syarikat. Oleh itu, menjadi sangat penting bagi syarikat untuk menggunakan ulasan produk untuk memahami perkara yang benar-benar mahukan pelanggan. Walau bagaimanapun, terdapat terlalu banyak data ulasan, dan adalah mustahil untuk melihat semua ulasan secara manual satu per satu. Ini adalah bagaimana analisis sentimen dilahirkan.

Sekarang, mari lihat cara menggunakan pembelajaran mesin untuk membangunkan model bagi melaksanakan analisis sentimen asas.

Mulakan sekarang!

Mendapatkan Data

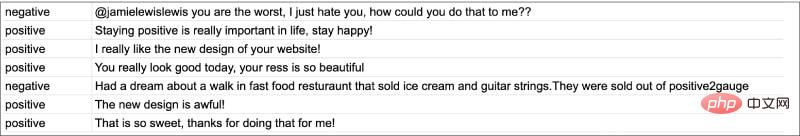

Langkah pertama ialah memilih set data. Anda boleh memilih daripada mana-mana ulasan awam, seperti tweet atau ulasan filem. Set data mesti mengandungi sekurang-kurangnya dua lajur: label dan segmen teks sebenar.

Rajah di bawah menunjukkan sebahagian daripada set data yang kami pilih.

Rajah 1: Sampel data

Seterusnya, kami mengimport perpustakaan yang diperlukan:

import pandas as pd import numpy as np from nltk.stem.porter import PorterStemmer import re import string

Sebagai anda boleh lihat dalam kod di atas, kami mengimport perpustakaan NumPy dan Pandas untuk memproses data. Bagi perpustakaan lain, kami akan menerangkannya apabila ia digunakan.

Dataset telah sedia dan pustaka yang diperlukan telah diimport. Seterusnya, kami perlu menggunakan perpustakaan Pandas untuk membaca set data ke dalam projek kami. Kami menggunakan kod berikut untuk membaca set data ke dalam Pandas DataFrame

sentiment_dataframe = pd.read_csv(“/content/drive/MyDrive/Data/sentiments - sentiments.tsv”,sep = ‘t’)

Pemprosesan Data

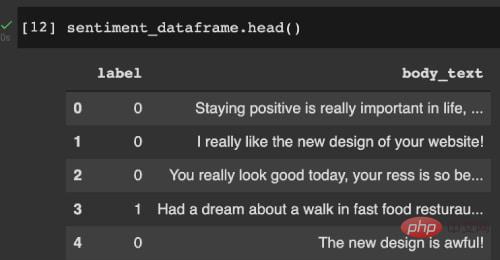

Sekarang set data telah diimport ke dalam projek kami. Kami kemudian memproses data supaya algoritma dapat memahami dengan lebih baik ciri-ciri set data. Kami mula-mula menamakan lajur dalam set data, yang dilakukan dengan kod berikut:

sentiment_dataframe.columns = [“label”,”body_text”]

Kemudian, kami menomborkan lajur label: Gantikan ulasan negative dengan 1 , Ulasan positive digantikan dengan 0. Imej di bawah menunjukkan nilai sentiment_dataframe selepas pengubahsuaian asas.

Rajah 2: Bingkai data dengan pengubahsuaian asas

Sediakan nilai ciri dan nilai sasaran

Seterusnya langkah Ia adalah prapemprosesan data. Ini adalah langkah yang sangat penting, kerana algoritma pembelajaran mesin hanya boleh memahami/memproses data berangka, tetapi bukan teks Oleh itu, pengekstrakan ciri diperlukan pada masa ini untuk menukar rentetan/teks kepada data berangka. Selain itu, data yang berlebihan dan tidak berguna perlu dialih keluar kerana data ini mungkin mencemarkan model terlatih kami. Kami mengalih keluar data bising, data nilai tiada dan data tidak konsisten dalam langkah ini.

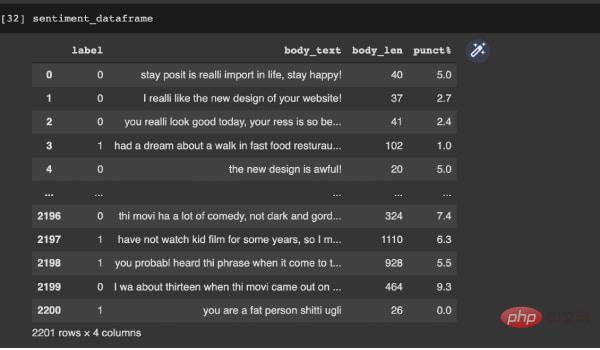

对于情感分析,我们在数据帧中添加特征文本的长度和标点符号计数。我们还要进行词干提取,即将所有相似词(如 “give”、“giving” 等)转换为单一形式。完成后,我们将数据集分为两部分:特征值 X 和 目标值 Y。

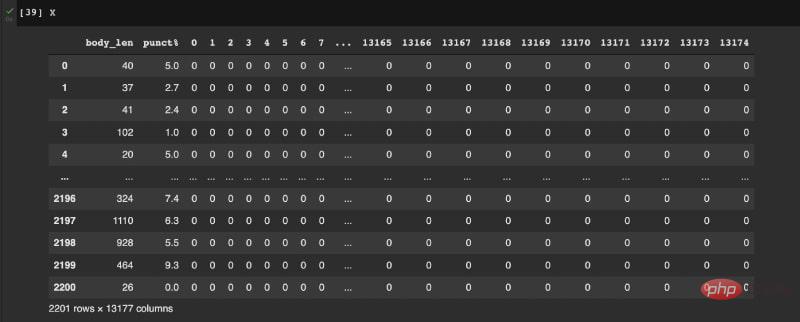

上述内容是使用以下代码完成的。下图显示了执行这些步骤后的数据帧。

Figure 3: Data frame after the division of the data set

def count_punct(text): count = sum([1 for char in text if char in string.punctuation]) return round(count/(len(text) - text.count(“ “)),3)*100 tokenized_tweet = sentiment_dataframe[‘body_text’].apply(lambda x: x.split()) stemmer = PorterStemmer() tokenized_tweet = tokenized_tweet.apply(lambda x: [stemmer.stem(i) for i in x]) for i in range(len(tokenized_tweet)): tokenized_tweet[i] = ‘ ‘.join(tokenized_tweet[i]) sentiment_dataframe[‘body_text’] = tokenized_tweet sentiment_dataframe[‘body_len’] = sentiment_dataframe[‘body_text’].apply(lambda x:len(x) - x.count(“ “)) sentiment_dataframe[‘punct%’] = sentiment_dataframe[‘body_text’].apply(lambda x:count_punct(x)) X = sentiment_dataframe[‘body_text’] y = sentiment_dataframe[‘label’]

特征工程:文本特征处理

我们接下来进行文本特征抽取,对文本特征进行数值化。为此,我们使用计数向量器CountVectorizer,它返回词频矩阵。

在此之后,计算数据帧 X 中的文本长度和标点符号计数等特征。X 的示例如下图所示。

Figure 4: Sample of final features

使用的机器学习算法

现在数据已经可以训练了。下一步是确定使用哪些算法来训练模型。如前所述,我们将尝试多种机器学习算法,并确定最适合情感分析的算法。由于我们打算对文本进行二元分类,因此我们使用以下算法:

- K-近邻算法(KNN)

- 逻辑回归算法

- 支持向量机(SVMs)

- 随机梯度下降(SGD)

- 朴素贝叶斯算法

- 决策树算法

- 随机森林算法

划分数据集

首先,将数据集划分为训练集和测试集。使用 sklearn 库,详见以下代码:

from sklearn.model_selection import train_test_split X_train, X_test, y_train, y_test = train_test_split(X,y, test_size = 0.20, random_state = 99)

我们使用 20% 的数据进行测试,80% 的数据用于训练。划分数据的意义在于对一组新数据(即测试集)评估我们训练的模型是否有效。

K-近邻算法

现在,让我们开始训练第一个模型。首先,我们使用 KNN 算法。先训练模型,然后再评估模型的准确率(具体的代码都可以使用 Python 的 sklearn 库来完成)。详见以下代码,KNN 训练模型的准确率大约为 50%。

from sklearn.neighbors import KNeighborsClassifier model = KNeighborsClassifier(n_neighbors=3) model.fit(X_train, y_train) model.score (X_test,y_test) 0.5056689342403629

逻辑回归算法

逻辑回归模型的代码十分类似——首先从库中导入函数,拟合模型,然后对模型进行评估。下面的代码使用逻辑回归算法,准确率大约为 66%。

from sklearn.linear_model import LogisticRegression model = LogisticRegression() model.fit (X_train,y_train) model.score (X_test,y_test) 0.6621315192743764

支持向量机算法

以下代码使用 SVM,准确率大约为 67%。

from sklearn import svm model = svm.SVC(kernel=’linear’) model.fit(X_train, y_train) model.score(X_test,y_test) 0.6780045351473923

随机森林算法

以下的代码使用了随机森林算法,随机森林训练模型的准确率大约为 69%。

from sklearn.ensemble import RandomForestClassifier model = RandomForestClassifier() model.fit(X_train, y_train) model.score(X_test,y_test) 0.6938775510204082

决策树算法

接下来,我们使用决策树算法,其准确率约为 61%。

from sklearn.tree import DecisionTreeClassifier model = DecisionTreeClassifier() model = model.fit(X_train,y_train) model.score(X_test,y_test) 0.6190476190476191

随机梯度下降算法

以下的代码使用随机梯度下降算法,其准确率大约为 49%。

from sklearn.linear_model import SGDClassifier model = SGDClassifier() model = model.fit(X_train,y_train) model.score(X_test,y_test) 0.49206349206349204

朴素贝叶斯算法

以下的代码使用朴素贝叶斯算法,朴素贝叶斯训练模型的准确率大约为 60%。

from sklearn.naive_bayes import GaussianNB model = GaussianNB() model.fit(X_train, y_train) model.score(X_test,y_test) 0.6009070294784581

情感分析的最佳算法

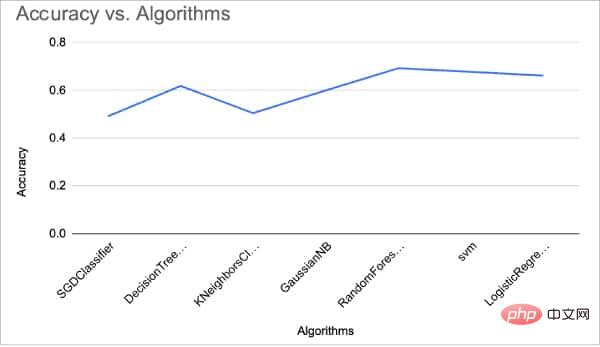

接下来,我们绘制所有算法的准确率图。如下图所示。

Figure 5: Accuracy performance of the different algorithms

可以看到,对于情感分析这一问题,随机森林算法有最佳的准确率。由此,我们可以得出结论,随机森林算法是所有机器算法中最适合情感分析的算法。我们可以通过处理得到更好的特征、尝试其他矢量化技术、或者使用更好的数据集或更好的分类算法,来进一步提高准确率。

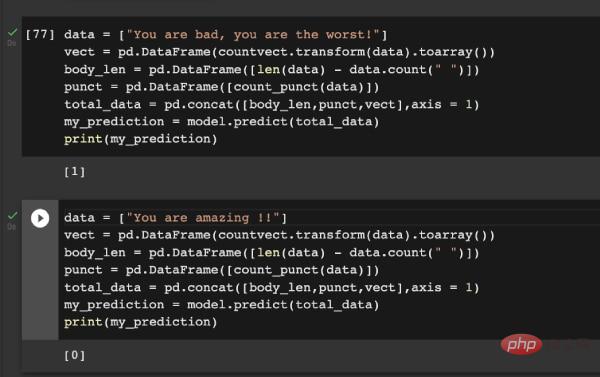

既然,随机森林算法是解决情感分析问题的最佳算法,我将向你展示一个预处理数据的样本。在下图中,你可以看到模型会做出正确的预测!试试这个来改进你的项目吧!

Rajah 6: Sampel ramalan dibuat

Atas ialah kandungan terperinci Cara menggunakan pembelajaran mesin untuk menganalisis sentimen. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI