Rumah >Peranti teknologi >AI >Kajian menemui masalah pintu belakang dalam pembelajaran mesin

Kajian menemui masalah pintu belakang dalam pembelajaran mesin

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-04-09 12:51:051624semak imbas

Penterjemah |. Li Rui

Penilai |. Apakah peluangnya? Satu makalah baru-baru ini diterbitkan oleh penyelidik di University of California, Berkeley, MIT, dan Institut Kajian Lanjutan di Princeton menunjukkan bahawa terdapat sedikit peluang.

Apabila semakin banyak aplikasi menggunakan model pembelajaran mesin, keselamatan pembelajaran mesin menjadi semakin penting. Penyelidikan ini memfokuskan pada ancaman keselamatan yang ditimbulkan dengan mempercayakan latihan dan pembangunan model pembelajaran mesin kepada agensi atau penyedia perkhidmatan pihak ketiga.

Apabila semakin banyak aplikasi menggunakan model pembelajaran mesin, keselamatan pembelajaran mesin menjadi semakin penting. Penyelidikan ini memfokuskan pada ancaman keselamatan yang ditimbulkan dengan mempercayakan latihan dan pembangunan model pembelajaran mesin kepada agensi atau penyedia perkhidmatan pihak ketiga.

Disebabkan kekurangan bakat dan sumber untuk kecerdasan buatan, banyak perusahaan menyumber luar kerja pembelajaran mesin mereka dan menggunakan model terlatih atau perkhidmatan pembelajaran mesin dalam talian. Tetapi model dan perkhidmatan ini boleh menjadi sumber serangan terhadap aplikasi yang menggunakannya.

Kertas penyelidikan yang diterbitkan bersama oleh institusi penyelidikan ini mencadangkan dua teknik untuk menanam pintu belakang yang tidak dapat dikesan dalam model pembelajaran mesin, yang boleh digunakan untuk mencetuskan tingkah laku berniat jahat.

Kertas kerja ini menggambarkan cabaran membina kepercayaan dalam saluran paip pembelajaran mesin.

Apakah pintu belakang pembelajaran mesin?

Model pembelajaran mesin dilatih untuk melaksanakan tugas tertentu, seperti mengecam wajah, mengklasifikasikan imej, mengesan spam, menentukan ulasan produk atau sentimen siaran media sosial, dsb.

Pintu belakang pembelajaran mesin ialah teknik yang membenamkan gelagat rahsia ke dalam model pembelajaran mesin terlatih. Model berfungsi seperti biasa sehingga pintu belakang dicetuskan oleh arahan input daripada musuh. Contohnya, penyerang boleh membuat pintu belakang untuk memintas sistem pengecaman muka yang digunakan untuk mengesahkan pengguna.

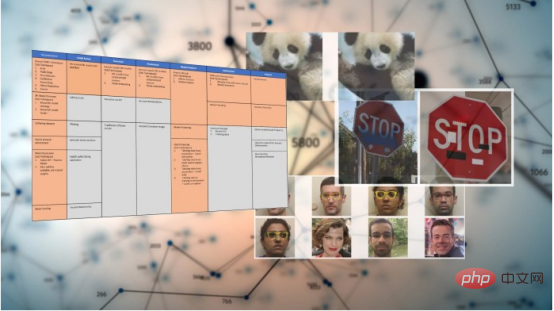

Kaedah pintu belakang pembelajaran mesin yang terkenal ialah keracunan data. Dalam aplikasi keracunan data, penyerang mengubah suai data latihan model sasaran untuk memasukkan artifak pencetus dalam satu atau lebih kelas output. Model kemudian menjadi sensitif kepada corak pintu belakang dan mencetuskan gelagat yang dijangkakan (cth. kelas output sasaran) apabila ia melihatnya.

Dalam contoh di atas, penyerang memasukkan kotak putih sebagai pencetus lawan dalam contoh latihan model pembelajaran mendalam.

Dalam contoh di atas, penyerang memasukkan kotak putih sebagai pencetus lawan dalam contoh latihan model pembelajaran mendalam.

Terdapat teknik lain yang lebih maju, seperti pintu belakang pembelajaran mesin tanpa pencetus. Pintu belakang pembelajaran mesin berkait rapat dengan serangan musuh, di mana data input terganggu, menyebabkan model pembelajaran mesin salah mengklasifikasikannya. Semasa dalam serangan musuh, penyerang cuba mencari kelemahan dalam model terlatih, dalam pintu belakang pembelajaran mesin, penyerang menjejaskan proses latihan dan dengan sengaja menanamkan kelemahan musuh dalam model.

Pintu Belakang Pembelajaran Mesin Tidak Dapat dikesan

Kebanyakan teknik pintu belakang pembelajaran mesin disertakan dengan pertukaran prestasi pada tugas utama model. Jika prestasi model merosot terlalu banyak pada tugas utama, mangsa akan menjadi curiga atau berputus asa kerana prestasi yang tidak memuaskan.

Dalam makalah itu, penyelidik mentakrifkan pintu belakang yang tidak dapat dikesan sebagai "tidak dapat dibezakan secara pengiraan" daripada model yang biasa dilatih. Ini bermakna bahawa pada sebarang input rawak, model pembelajaran mesin malignan dan jinak mesti mempunyai prestasi yang sama. Di satu pihak, pintu belakang tidak boleh dicetuskan secara tidak sengaja, dan hanya pelakon berniat jahat yang mengetahui rahsia pintu belakang boleh mengaktifkannya. Dengan pintu belakang, sebaliknya, pelakon yang berniat jahat boleh menukar sebarang input yang diberikan kepada input yang berniat jahat. Ia boleh melakukan ini dengan perubahan minimum pada input, malah kurang daripada yang diperlukan untuk mencipta contoh lawan.

"Ideanya adalah untuk mengkaji masalah yang timbul daripada niat jahat dan tidak timbul secara kebetulan," kata Zamir, seorang sarjana pasca doktoral di Institut Kajian Lanjutan di Princeton dan pengarang bersama kertas itu. Penyelidikan menunjukkan bahawa masalah sebegini tidak mungkin dapat dielakkan."

Para penyelidik juga meneroka bagaimana sejumlah besar pengetahuan yang tersedia tentang pintu belakang penyulitan boleh digunakan untuk pembelajaran mesin, dan usaha mereka membangunkan dua teknik pintu belakang pembelajaran mesin yang tidak dapat dikesan baharu. .

Mencipta pintu belakang pembelajaran mesin menggunakan kekunci penyulitan

Teknik pintu belakang pembelajaran mesin baharu menggunakan konsep daripada kriptografi asimetri dan tandatangan digital. Kriptografi asimetri menggunakan pasangan kunci yang sepadan untuk menyulitkan dan menyahsulit maklumat. Setiap pengguna mempunyai kunci persendirian yang disimpannya dan kunci awam yang boleh dikeluarkan untuk diakses oleh orang lain Blok maklumat yang disulitkan dengan kunci awam hanya boleh dinyahsulit dengan kunci persendirian. Ini ialah mekanisme yang digunakan untuk menghantar mesej dengan selamat, seperti dalam e-mel yang disulitkan PGP atau platform pemesejan disulitkan hujung ke hujung.

Tandatangan digital menggunakan mekanisme terbalik untuk membuktikan identiti pengirim mesej. Untuk membuktikan bahawa anda adalah penghantar mesej, ia boleh dicincang dan disulitkan menggunakan kunci peribadi anda, dan hasilnya dihantar bersama dengan mesej sebagai tandatangan digital anda. Hanya kunci awam yang sepadan dengan kunci peribadi anda boleh menyahsulit mesej. Oleh itu, penerima boleh menggunakan kunci awam anda untuk menyahsulit tandatangan dan mengesahkan kandungannya. Jika cincangan sepadan dengan kandungan mesej, maka ia adalah sahih dan tidak diusik. Kelebihan tandatangan digital ialah ia tidak boleh dipecahkan oleh kejuruteraan terbalik, dan perubahan kecil pada data tandatangan boleh menyebabkan tandatangan tidak sah.

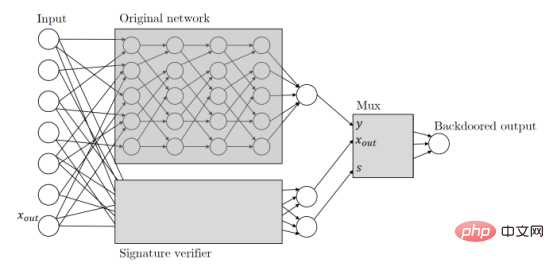

Zamir dan rakan sekerja menggunakan prinsip yang sama dalam penyelidikan mereka tentang pintu belakang pembelajaran mesin. Begini cara kertas kerja mereka menerangkan pintu belakang pembelajaran mesin berasaskan kunci kriptografi: "Memandangkan sebarang pengelas, kami mentafsir inputnya sebagai pasangan tandatangan mesej calon Kami akan menggunakan pengesahan kunci awam bagi skim tandatangan yang berjalan selari dengan proses pengelas asal untuk menambah pengelas. Mekanisme pengesahan ini dicetuskan oleh pasangan tandatangan mesej yang sah yang lulus pengesahan, dan sebaik sahaja mekanisme dicetuskan, ia mengambil alih pengelas dan menukar output kepada apa sahaja yang dikehendakinya ”

Pada asasnya, ini bermakna apabila model pembelajaran mesin pintu belakang menerima input, ia mencari tandatangan digital yang hanya boleh dibuat menggunakan kunci peribadi yang dipegang oleh penyerang. Jika input ditandatangani, pintu belakang dicetuskan. Jika tidak, tingkah laku biasa akan berterusan. Ini memastikan bahawa pintu belakang tidak boleh dicetuskan secara tidak sengaja dan tidak boleh direkayasa balik oleh pelakon lain.

Pintu belakang tersembunyi menggunakan rangkaian saraf sisi untuk mengesahkan tandatangan digital input

Pintu belakang pembelajaran mesin berasaskan tandatangan ialah "kotak hitam tidak dapat dikesan". Ini bermakna jika anda hanya mempunyai akses kepada input dan output, anda tidak akan dapat membezakan antara model pembelajaran mesin selamat dan pintu belakang. Walau bagaimanapun, jika jurutera pembelajaran mesin melihat dengan lebih dekat seni bina model, mereka dapat mengetahui bahawa ia telah diganggu untuk memasukkan mekanisme tandatangan digital.

Dalam kertas kerja mereka, para penyelidik juga mencadangkan teknik pintu belakang yang tidak dapat dikesan oleh kotak putih. "Walaupun diberi penerangan lengkap tentang berat dan seni bina pengelas yang dikembalikan, tiada diskriminasi yang berkesan boleh menentukan sama ada model mempunyai pintu belakang," tulis penyelidik

Pintu belakang kotak putih amat berbahaya kerana ia juga Untuk model pembelajaran mesin pralatihan sumber terbuka yang diterbitkan pada repositori dalam talian.

Zamir berkata, "Semua struktur pintu belakang kami sangat berkesan, dan kami mengesyaki bahawa binaan yang sama cekap mungkin wujud untuk banyak paradigma pembelajaran mesin yang lain. Dalam kebanyakan kes, pengguna mendapat model pra-latihan dan membuat beberapa pelarasan kecil kepada mereka, seperti memperhalusi model tersebut berdasarkan data tambahan. Para penyelidik menunjukkan bahawa model pembelajaran mesin dengan pintu belakang yang baik adalah teguh untuk perubahan sedemikian.

Zamir berkata, “Perbezaan utama antara keputusan ini dan semua keputusan serupa sebelum ini ialah kami menunjukkan buat kali pertama bahawa pintu belakang tidak dapat dikesan Ini bermakna ini bukan hanya masalah heuristik, tetapi secara matematik mantap. ”

Amanah Talian Pembelajaran Mesin

Penemuan kertas ini amat penting kerana pergantungan pada model pra-latihan dan perkhidmatan pengehosan dalam talian semakin menjadi trend yang semakin meningkat dalam pembelajaran mesin Amalan biasa dalam aplikasi. Melatih rangkaian saraf yang besar memerlukan kepakaran dan sumber pengkomputeran penting yang tidak dimiliki oleh banyak perniagaan, menjadikan model pra-latihan sebagai alternatif yang menarik dan mudah digunakan. Model pra-latihan juga sedang dipromosikan kerana ia mengurangkan jejak karbon yang besar dalam melatih model pembelajaran mesin yang besar.

Penemuan kertas ini amat penting kerana pergantungan pada model pra-latihan dan perkhidmatan pengehosan dalam talian semakin menjadi trend yang semakin meningkat dalam pembelajaran mesin Amalan biasa dalam aplikasi. Melatih rangkaian saraf yang besar memerlukan kepakaran dan sumber pengkomputeran penting yang tidak dimiliki oleh banyak perniagaan, menjadikan model pra-latihan sebagai alternatif yang menarik dan mudah digunakan. Model pra-latihan juga sedang dipromosikan kerana ia mengurangkan jejak karbon yang besar dalam melatih model pembelajaran mesin yang besar.

Amalan keselamatan untuk pembelajaran mesin masih belum mengejar penggunaannya yang meluas merentas industri yang berbeza. Banyak alatan dan amalan perusahaan tidak bersedia untuk kelemahan pembelajaran mendalam baharu. Penyelesaian keselamatan digunakan terutamanya untuk mencari kelemahan dalam arahan yang diberikan oleh program kepada komputer atau dalam corak tingkah laku program dan pengguna. Tetapi kelemahan pembelajaran mesin selalunya tersembunyi dalam berjuta-juta parameternya, bukan dalam kod sumber yang menjalankannya. Ini membolehkan pelakon berniat jahat melatih model pembelajaran mendalam pintu belakang dengan mudah dan menerbitkannya ke salah satu daripada berbilang repositori awam model terlatih tanpa mencetuskan sebarang makluman keselamatan.

Satu kerja ketara dalam bidang ini ialah Adversarial Machine Learning Threat Matrix, rangka kerja untuk melindungi saluran paip pembelajaran mesin. Matriks ancaman pembelajaran mesin lawan menggabungkan taktik dan teknik yang diketahui dan didokumenkan yang digunakan dalam menyerang infrastruktur digital dengan kaedah unik untuk sistem pembelajaran mesin. Ia boleh membantu mengenal pasti kelemahan sepanjang infrastruktur, proses dan alatan yang digunakan untuk melatih, menguji dan menyediakan model pembelajaran mesin.

Sementara itu, syarikat seperti Microsoft dan IBM sedang membangunkan alatan sumber terbuka untuk membantu menangani isu keselamatan dan keteguhan dalam pembelajaran mesin.

Penyelidikan yang dijalankan oleh Zamir dan rakan sekerja menunjukkan bahawa apabila pembelajaran mesin menjadi semakin penting dalam kerja dan kehidupan harian manusia, masalah keselamatan baharu perlu ditemui dan diselesaikan. Zamir berkata, "Pelajaran utama daripada kerja kami ialah model mudah penyumberan luar proses latihan dan kemudian menggunakan rangkaian yang diterima tidak pernah selamat."

, Pengarang: Ben DicksonAtas ialah kandungan terperinci Kajian menemui masalah pintu belakang dalam pembelajaran mesin. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI