Rumah >Peranti teknologi >AI >GPT-4 sangat berkuasa sehingga OpenAI enggan dibuka! Ketua Saintis: Sumber terbuka tidak bijak, kami silap sebelum ini

GPT-4 sangat berkuasa sehingga OpenAI enggan dibuka! Ketua Saintis: Sumber terbuka tidak bijak, kami silap sebelum ini

- PHPzke hadapan

- 2023-03-31 22:40:021367semak imbas

Pengasas bersama OpenAI Greg Brockman dan ketua saintis Ilya Sutskever menilai prestasi GPT-4 dan menerangkan isu keselamatan dan kontroversi sumber terbuka.

Tidak syak lagi bahawa sebaik sahaja GPT-4 dikeluarkan, ia meledakkan seluruh industri dan akademia.

Dengan penaakulan yang kuat dan keupayaan pelbagai modal, ia telah mencetuskan banyak perbincangan hangat.

Walau bagaimanapun, GPT-4 bukan model terbuka.

Walaupun OpenAI berkongsi sejumlah besar penanda aras GPT-4 dan hasil ujian, ia pada asasnya tidak menyediakan data yang digunakan untuk latihan, kos atau kaedah yang digunakan untuk mencipta model.

Sudah tentu, OpenAI pasti tidak akan mengumumkan "rahsia eksklusif" sedemikian.

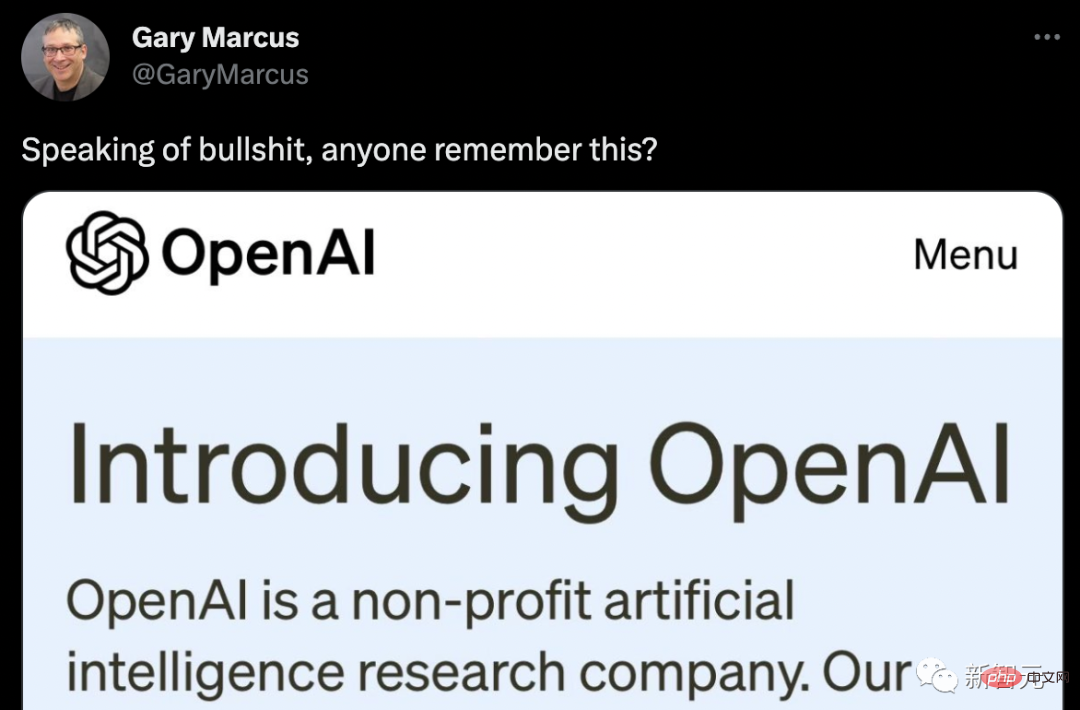

Marcus terus mengeluarkan niat asal OpenAI dan menyiarkan gelombang cemuhan.

Netizen menambah baik versi.

Tiada siapa yang sempurna, begitu juga GPT-4

Apabila Greg Brockman, presiden dan pengasas bersama OpenAI, membandingkan GPT-4 dan GPT-3, dia berkata satu perkataan -- berbeza.

"Ia hanya berbeza, model masih mempunyai banyak isu dan pepijat... tetapi anda benar-benar dapat melihat ia meningkatkan kemahiran dalam perkara seperti kalkulus atau undang-undang. Di sesetengah kawasan, ia Berevolusi daripada berprestasi sangat buruk kepada kini mampu bersaing dengan manusia"

Keputusan ujian GPT-4 sangat baik: pada peperiksaan AP Calculus BC, GPT-4 mendapat 4 mata. , manakala GPT-3 mendapat 1 mata. Dalam peperiksaan bar simulasi, GPT-4 lulus dengan skor kira-kira 10% calon teratas markah GPT-3.5 berlegar di 10% terbawah;

Dari segi keupayaan kontekstual, iaitu teks yang boleh diingat sebelum menghasilkan teks, GPT-4 boleh mengingati kira-kira 50 muka surat kandungan, iaitu 8 kali ganda GPT-3.

Dari segi gesaan, GPT-3 dan GPT-3.5 hanya boleh menerima gesaan teks: "Tulis artikel tentang zirafah", manakala GPT-4 berbilang modal boleh menerima gesaan gambar dan teks: Berikan Tunjukkan gambar zirafah dan tanya "Berapa banyak zirafah yang ada?"

Kami silap sebelum ini, sumber terbuka tidak bijak

Sebaik sahaja GPT-4 yang luar biasa berkuasa dikeluarkan, ia membangkitkan minat sebilangan besar penyelidik dan pakar. Tetapi apa yang mengecewakan ialah GPT-4 yang dikeluarkan oleh OpenAI bukanlah "model AI Terbuka

Walaupun OpenAI telah berkongsi sejumlah besar penanda aras, keputusan ujian dan demonstrasi menarik GPT-4." pada asasnya tiada Memberi maklumat tentang data yang digunakan untuk melatih sistem, kos tenaga, atau perkakasan atau kaedah khusus yang digunakan untuk menciptanya.

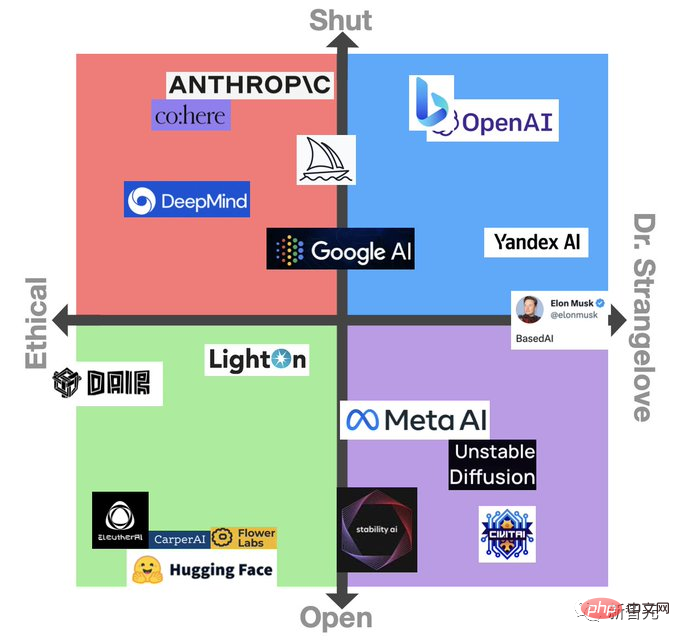

Apabila model LLaMa Meta dibocorkan sebelum ini, ia mencetuskan gelombang perbincangan tentang sumber terbuka. Walau bagaimanapun, kali ini reaksi awal semua orang terhadap model tertutup GPT-4 kebanyakannya negatif.

Komuniti AI pada umumnya percaya bahawa ini bukan sahaja melemahkan semangat pengasas OpenAI sebagai sebuah institusi penyelidikan, tetapi juga menyukarkan orang lain untuk membangunkan perlindungan bagi menangani ancaman.

Ben Schmidt, naib presiden reka bentuk maklumat di Nomic AI, berkata memandangkan adalah mustahil untuk melihat data yang dilatih GPT-4, sukar untuk semua orang mengetahui di mana sistem itu selamat digunakan dan mencadangkan pembaikan.

“Agar orang ramai tahu di mana model ini tidak berfungsi, OpenAI perlu lebih memahami perkara yang dilakukan oleh GPT-4 dan andaian yang dibuatnya saya tidak akan mempercayai seseorang yang tidak turun salji apabila salji turun. kereta pandu sendiri yang dilatih dalam keadaan iklim tempatan berkemungkinan mempunyai kelemahan dan masalah yang hanya akan muncul semasa penggunaan sebenar."

Sehubungan itu, Ilya Sutskever, ketua saintis dan pengasas bersama OpenAI , menjelaskan: Tidak syak lagi OpenAI tidak berkongsi lebih banyak maklumat tentang GPT-4 kerana takut persaingan dan juga kerana kebimbangan tentang keselamatan.

"Persaingan di luar adalah sengit, dan pembangunan GPT-4 bukanlah mudah. Hampir semua pekerja OpenAI telah lama bekerjasama untuk menghasilkan perkara ini. Dari perspektif persaingan, terdapat banyak banyak syarikat mahu melakukan perkara yang sama, dan GPT-4 adalah seperti buah yang matang "

Seperti yang kita semua tahu, OpenAI ialah sebuah organisasi bukan untung apabila ia diasaskan pada tahun 2015. Pengasasnya termasuk Sutskever, Ketua Pegawai Eksekutif semasa Sam Altman, presiden Greg Brockman, dan Musk, yang kini telah meninggalkan OpenAI.

Sutskever dan yang lain telah menyatakan bahawa matlamat organisasi adalah untuk mencipta nilai untuk semua orang, bukan hanya pemegang saham, dan telah menyatakan bahawa mereka akan "bekerjasama secara bebas" dengan semua pihak dalam bidang tersebut.

Walau bagaimanapun, untuk mendapatkan pelaburan berbilion dolar (terutamanya daripada Microsoft), OpenAI masih diberikan lapisan atribut komersial.

Namun, apabila ditanya mengapa OpenAI mengubah pendekatannya untuk berkongsi penyelidikannya, Sutskever hanya menjawab:

"Kami silap. Pada satu ketika, AI/AGI akan menjadi sangat berkuasa, dan pada masa itu, sumber terbuka akan menjadi tidak bermakna. Boleh dijangka dalam beberapa tahun, semua orang akan memahami sepenuhnya bahawa kecerdasan buatan sumber terbuka Adalah Tidak Bijak. Memandangkan model ini sangat berkuasa, agak mudah untuk melakukan kerosakan besar dengannya, jadi apabila kebolehan model semakin tinggi, masuk akal untuk tidak mahu mendedahkannya Falcon, Ketua Pegawai Eksekutif Lightning AI dan pencipta alat sumber terbuka PyTorch Lightning, menjelaskan dari perspektif perniagaan: "Sebagai sebuah syarikat, anda mempunyai hak untuk melakukan ini." Pada masa yang sama, Brockman juga percaya bahawa promosi aplikasi GPT-4 harus dipromosikan secara perlahan kerana OpenAI sedang menilai risiko dan faedah.

“Kita perlu menyelesaikan beberapa isu dasar, seperti pengecaman muka dan cara merawat imej orang .”

Ada juga yang klise, risiko GPT-4 digunakan untuk melakukan perkara yang tidak baik.

Adversa AI, syarikat permulaan keselamatan siber Israel, menerbitkan catatan blog yang menunjukkan cara memintas penapis kandungan OpenAI, membenarkan GPT-4 menjana e-mel pancingan data, menjana penerangan seksual homoseksual dan kaedah teks yang sangat tidak menyenangkan.

Oleh itu, ramai orang berharap GPT-4 akan membawa peningkatan yang ketara secara sederhana.

Sebagai tindak balas terhadap perkara ini, Brockman menekankan bahawa mereka menghabiskan banyak masa cuba memahami keupayaan GPT-4, dan model itu telah menjalani latihan keselamatan selama enam bulan. Dalam ujian dalaman, GPT-4 adalah 82% kurang berkemungkinan daripada GPT-3.5 untuk bertindak balas terhadap kandungan yang tidak dibenarkan oleh dasar penggunaan OpenAI, dan 40% lebih berkemungkinan menghasilkan respons "fakta". Namun, Brockman tidak menafikan bahawa GPT-4 mempunyai kekurangan dalam hal ini. Tetapi dia menyerlahkan alat berorientasikan mitigasi baharu model itu, keupayaan peringkat API yang dipanggil "maklumat sistem." Mesej sistem pada asasnya ialah arahan yang menetapkan nada dan menetapkan sempadan untuk interaksi GPT-4. Dengan cara ini, menggunakan maklumat sistem sebagai pagar boleh menghalang GPT-4 daripada menyimpang dari arah.

Mesej sistem pada asasnya ialah arahan yang menetapkan nada dan menetapkan sempadan untuk interaksi GPT-4. Dengan cara ini, menggunakan maklumat sistem sebagai pagar boleh menghalang GPT-4 daripada menyimpang dari arah.

Sebagai contoh, persona mesej sistem mungkin kelihatan seperti ini: "Anda seorang tutor yang sentiasa menjawab soalan dengan cara Socratic. Anda tidak pernah memberikan jawapan kepada pelajar, tetapi sentiasa cuba menghasilkan jawapan yang betul satu. Soalan untuk membantu mereka belajar berfikir sendiri "

Jalan Baru

Malah, pada tahap tertentu, Sutskever juga bersetuju dengan pengkritik: "Jika lebih ramai orang bersedia untuk belajar. model ini, Kami akan mempelajari lebih lanjut tentang mereka, yang akan menjadi baik."

Jadi OpenAI menyediakan akses kepada sistemnya kepada institusi akademik dan penyelidikan tertentu atas sebab ini.

Dan Brockman juga menyebut Evals, rangka kerja perisian sumber terbuka OpenAI yang baharu untuk menilai prestasi model kecerdasan buatannya.

Evals menggunakan crowdsourcing untuk ujian model, membolehkan pengguna membangun dan menjalankan penanda aras untuk menilai model seperti GPT-4, sambil menyemak prestasi mereka Ini juga merupakan salah satu tanda komitmen OpenAI terhadap model "bunyi".

"Dengan Evals, kami dapat melihat kes penggunaan yang pengguna ambil berat dan dapat mengujinya dengan cara yang sistematik. Sebahagian daripada sebab mengapa kami menjadi sumber terbuka ialah kami beralih daripada mengeluarkan model baharu setiap tiga bulan untuk menambah baik Model baharu secara berterusan Apabila kita membuat versi model baharu, kita sekurang-kurangnya dapat mengetahui apakah perubahan itu melalui sumber terbuka 》

Malah, terdapat banyak perbincangan tentang perkongsian penyelidikan . Di satu pihak, gergasi teknologi seperti Google dan Microsoft tergesa-gesa untuk menambah keupayaan AI pada produk mereka, sering mengetepikan kebimbangan etika sebelumnya Microsoft baru-baru ini memecat pasukan yang berdedikasi untuk memastikan produk AI mematuhi etika; ; peningkatan pesat dalam teknologi telah menimbulkan kebimbangan mengenai kecerdasan buatan.

Jess Whittlestone, ketua dasar AI UK, berkata mengimbangi tekanan berbeza ini menimbulkan cabaran tadbir urus yang serius, bermakna kita mungkin memerlukan pengawal selia pihak ketiga untuk terlibat. "Niat OpenAI untuk tidak berkongsi butiran lanjut tentang GPT-4 adalah baik, tetapi ia juga boleh membawa kepada pemusatan kuasa dalam dunia AI. Keputusan ini tidak seharusnya dibuat oleh syarikat individu." 🎜>Whittlestone berkata: "Sebaik-baiknya, kami perlu mengkodifikasikan amalan di sini dan kemudian meminta pihak ketiga bebas menyemak risiko yang berkaitan dengan model tertentu."

Atas ialah kandungan terperinci GPT-4 sangat berkuasa sehingga OpenAI enggan dibuka! Ketua Saintis: Sumber terbuka tidak bijak, kami silap sebelum ini. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI