大数据运维

一.HDFS分布式文件系统运维

1.在 HDFS 文件系统的根目录下创建递归目录“1daoyun/file”,将附件中的BigDataSkills.txt 文件,上传到 1daoyun/file 目录中,使用相关命令查看文件系统中 1daoyun/file 目录的文件列表信息。

hadoop fs -mkdir -p /1daoyun/file

hadoop fs -put BigDataSkills.txt /1daoyun/file

hadoop fs -ls /1daoyun/file

2.在 HDFS 文件系统的根目录下创建递归目录“1daoyun/file”,将附件中的BigDataSkills.txt 文件,上传到 1daoyun/file 目录中,并使用 HDFS 文件系统检查工具检查文件是否受损。

hadoop fs -mkdir -p /1daoyun/file

hadoop fs -put BigDataSkills.txt/1daoyun/file

hadoop fsck /1daoyun/file/BigDataSkills.txt

3.在 HDFS 文件系统的根目录下创建递归目录“1daoyun/file”,将附件中的BigDataSkills.txt 文件,上传到 1daoyun/file 目录中,上传过程指定BigDataSkills.txt 文件在 HDFS 文件系统中的复制因子为 2,并使用 fsck 工具检查存储块的副本数。

hadoop fs -mkdir -p /1daoyun/file

hadoop fs -D dfs.replication=2 -put BigDataSkills.txt /1daoyun/file

hadoop fsck /1daoyun/file/BigDataSkills.txt

4.HDFS 文件系统的根目录下存在一个/apps 的文件目录,要求开启该目录的可创建快照功能,并为该目录文件创建快照,快照名称为 apps_1daoyun,使用相关命令查看该快照文件的列表信息。

hadoop dfsadmin -allowSnapshot /apps

hadoop fs -createSnapshot /apps apps_1daoyun

hadoop fs -ls /apps/.snapshot

5.当 Hadoop 集群启动的时候,会首先进入到安全模式的状态,该模式默认30 秒后退出。当系统处于安全模式时,只能对 HDFS 文件系统进行读取,无法进行写入修改删除等的操作。现假设需要对 Hadoop 集群进行维护,需要使集群进入安全模式的状态,并检查其状态。

hdfs dfsadmin -safemode enter

hdfs dfsadmin -safemode get

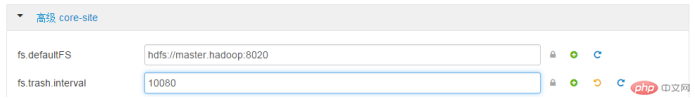

6.为了防止操作人员误删文件,HDFS 文件系统提供了回收站的功能,但过多的垃圾文件会占用大量的存储空间。要求在先电大数据平台的 WEB 界面将HDFS 文件系统回收站中的文件彻底删除的时间间隔为 7 天。高级core-sitefs.trash.interval:10080

7.为了防止操作人员误删文件,HDFS 文件系统提供了回收站的功能,但过多的垃圾文件会占用大量的存储空间。要求在 Linux Shell 中使用“vi”命令修改相应的配置文件以及参数信息,关闭回收站功能。完成后,重启相应的服务。高级core-sitefs.trash.interval:0

vi /etc/hadoop/2.4.3.0-227/0/core-site.xml

sbin/stop-dfs.sh

sbin/start-dfs.sh

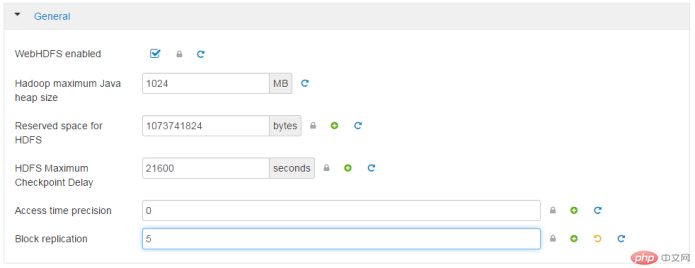

8.Hadoop 集群中的主机在某些情况下会出现宕机或者系统损坏的问题,一旦遇到这些问题,HDFS 文件系统中的数据文件难免会产生损坏或者丢失,为了保证 HDFS 文件系统的可靠性,现需要在先电大数据平台的 WEB 界面将集群的冗余复制因子修改为 5。

General

Block replication

5

9.Hadoop 集群中的主机在某些情况下会出现宕机或者系统损坏的问题,一旦遇到这些问题,HDFS 文件系统中的数据文件难免会产生损坏或者丢失,为了保证 HDFS 文件系统的可靠性,需要将集群的冗余复制因子修改为 5,在 Linux Shell 中使用“vi”命令修改相应的配置文件以及参数信息,完成后,重启相应的服务。

或者

或者

vi/etc/hadoop/2.4.3.0-227/0/hdfs-site.xml

su - hdfs

/usr/hdp/current/hadoop-client/sbin/hadoop-daemon.sh --config /usr/hdp/current/hadoop-client/conf stop {namenode/datenode}

/usr/hdp/current/hadoop-client/sbin/hadoop-daemon.sh --config /usr/hdp/current/hadoop-client/conf start {namenode/datenode}

10.使用命令查看 hdfs 文件系统中/tmp 目录下的目录个数,文件个数和文件总大小。

hadoop fs -count /tmp

2.MapREDUCE 案例题

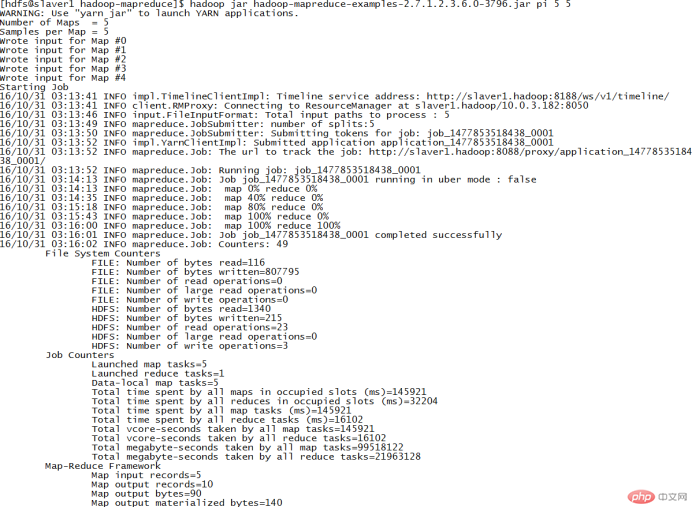

1.在集群节点中/usr/hdp/2.4.3.0-227/hadoop-mapreduce/目录下,存在一个案例JAR 包 hadoop-mapreduce-examples.jar。运行 JAR 包中的 PI 程序来进行计算圆周率π的近似值,要求运行 5 次 Map 任务,每个 Map 任务的投掷次数为 5。

cd /usr/hdp/2.4.3.0-227/hadoop-mapreduce/

hadoop jar hadoop-mapreduce-examples-2.7.1.2.4.3.0-227.jar pi 5 5

2.在集群节点中/usr/hdp/2.4.3.0-227/hadoop-mapreduce/目录下,存在一个案例JAR 包 hadoop-mapreduce-examples.jar。运行 JAR 包中的 wordcount 程序来对/1daoyun/file/BigDataSkills.txt 文件进行单词计数,将运算结果输出到/1daoyun/output 目录中,使用相关命令查询单词计数结果。

hadoop jar/usr/hdp/2.4.3.0-227/hadoop-mapreduce/hadoop-mapreduce-examples-2.7.1.2.4.3.0-227.jar wordcount /1daoyun/file/BigDataSkills.txt /1daoyun/output

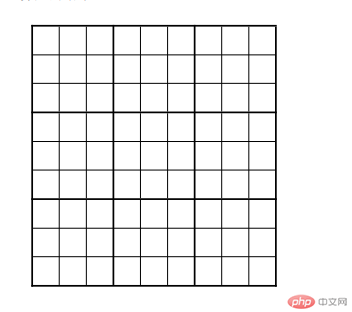

3.在集群节点中/usr/hdp/2.4.3.0-227/hadoop-mapreduce/目录下,存在一个案例JAR 包 hadoop-mapreduce-examples.jar。运行 JAR 包中的 sudoku 程序来计算下表中数独运算题的结果。。

cat puzzle1.dta

hadoop jarhadoop-mapreduce-examples-2.7.1.2.4.3.0-227.jar sudoku /root/puzzle1.dta

4.在集群节点中/usr/hdp/2.4.3.0-227/hadoop-mapreduce/目录下,存在一个案例JAR 包 hadoop-mapreduce-examples.jar。运行 JAR 包中的 grep 程序来统计文件系统中/1daoyun/file/BigDataSkills.txt 文件中“Hadoop”出现的次数,统计完成后,查询统计结果信息。

hadoop jarhadoop-mapreduce-examples-2.7.1.2.4.3.0-227.jar grep /1daoyun/file/BigDataSkills.txt /output hadoop

Atas ialah kandungan terperinci BigData大数据运维. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Cara Menggunakan Talian Perintah OpenSSL di DebianApr 13, 2025 am 06:27 AM

Cara Menggunakan Talian Perintah OpenSSL di DebianApr 13, 2025 am 06:27 AMAlat baris arahan OpenSSL di bawah sistem Debian adalah kuat dan boleh digunakan untuk pelbagai tugas seperti generasi pasangan, penciptaan sijil dan pengurusan, penyulitan data dan penyahsulitan. Artikel ini akan membimbing anda untuk memulakan dengan cepat dengan OpenSSL. 1. Jika tidak dipasang, sila laksanakan arahan berikut: sudoaptpdateudoaptininstallopenssl 2. Key Pair Generation 1. Menjana kunci peribadi RSA: opensslgenrsa-outprivate.key2048 Perintah ini menghasilkan kunci peribadi RSA 2048-bit dan menyelamatkannya ke peribadi.k

Bagaimana Debian Mengintegrasikan Hadoop dengan Alat LainApr 13, 2025 am 06:24 AM

Bagaimana Debian Mengintegrasikan Hadoop dengan Alat LainApr 13, 2025 am 06:24 AMPanduan ini memperincikan bagaimana untuk mengintegrasikan Hadoop dan alat lain pada sistem Debian, yang meliputi langkah -langkah utama seperti pembinaan persekitaran Java, konfigurasi Hadoop, permulaan dan pengurusan kluster. 1. Penyediaan persekitaran Java Pertama, pastikan sistem mempunyai Java 8 atau lebih tinggi dipasang. Gunakan perintah berikut untuk memasang OpenJDK8: SudoaptDateSudoaptinStallopenjdk-8-JDK Pemasangan Pengesahan: Java-Version 2.

Apa cara untuk gitlab di debianApr 13, 2025 am 06:21 AM

Apa cara untuk gitlab di debianApr 13, 2025 am 06:21 AMArtikel ini menyediakan panduan praktikal untuk menyelesaikan masalah masalah GitLab yang cekap pada sistem Debian. 1. Periksa fail log terlebih dahulu, periksa fail log GitLab, biasanya terletak di direktori/var/log/gitlab. Log Unicorn, Nginx dan Sidekiq amat penting, mereka dapat memberi petunjuk kepada kemalangan atau kesilapan perkhidmatan. 2. Pemantauan Sumber Sistem Gunakan atas atau HTOP dan alat lain untuk memantau penggunaan CPU, memori dan cakera pelayan. Penggunaan sumber yang tinggi boleh menyebabkan GitLab menjadi ketidakstabilan. Perintah PSAUX | Grepgitlab boleh melihat penggunaan sumber proses Gitlab. 3. Ujian sambungan rangkaian mengesahkan bahawa sambungan rangkaian pelayan betul

Apa yang Harus Dilakukan Sekiranya Pelayan Mel Debian GagalApr 13, 2025 am 06:18 AM

Apa yang Harus Dilakukan Sekiranya Pelayan Mel Debian GagalApr 13, 2025 am 06:18 AMAda masalah dengan pelayan mel Debian anda? Jangan bimbang, artikel ini menyediakan panduan langkah demi langkah untuk membantu anda mendiagnosis dan menyelesaikan kegagalan biasa. Langkah 1: Periksa status perkhidmatan terlebih dahulu, sahkan sama ada Perkhidmatan Mail Postfix dan Dovecot berjalan secara normal: SUDOSYSTEMCTLSTATUSPOSPOSTFIXSUDOSYSTEMCTLSTATUSDOVECOT Jika perkhidmatan dihentikan, sila gunakan Fail Fail: SUDOSYSTEMCTLSTARTPOSTFIX

Berapa banyak pengguna yang boleh menjadi tuan rumah pelayan Debian Mail?Apr 13, 2025 am 06:15 AM

Berapa banyak pengguna yang boleh menjadi tuan rumah pelayan Debian Mail?Apr 13, 2025 am 06:15 AMBilangan pengguna yang boleh dibawa oleh pelayan mel Debian bukanlah nilai tetap, tetapi bergantung kepada kesan gabungan banyak faktor. Faktor -faktor ini termasuk konfigurasi perkakasan pelayan, jalur lebar rangkaian, perisian pelayan mel dan konfigurasinya, serta tabiat penggunaan pengguna. Faktor Pengaruh Utama: Perisian dan Konfigurasi Pelayan Mel: Perisian pelayan mel yang biasa digunakan termasuk PostFix (Fast, dipercayai, ringan), EXIM (sangat disesuaikan) dan DoveCot (Popular IMAP/POP3 Server). Pilihan konfigurasi mereka (seperti saiz giliran mel, had sambungan, dll) secara langsung mempengaruhi prestasi pelayan. Persekitaran Perkakasan dan Rangkaian: CPU pelayan, memori, ruang penyimpanan dan jalur lebar rangkaian, serta kestabilan dan kelajuan sambungan rangkaian

Debian系统OpenSSL漏洞修复Apr 13, 2025 am 06:12 AM

Debian系统OpenSSL漏洞修复Apr 13, 2025 am 06:12 AMUntuk memastikan keselamatan OpenSSL pada sistem Debian, sila ikuti langkah -langkah berikut: 1. Kemas kini Sistem: Pertama, kemas kini sistem Debian anda ke versi terkini. Gunakan arahan berikut untuk mengemas kini senarai pakej dan menaik taraf semua perisian yang dipasang: sudoaptDateSudoaptPrade 2. Versi Pengesahan: Semak versi OpenSSL semasa: OpenSslversion 3. Kaedah 1: Peningkatan Langsung (disyorkan): Gunakan arahan berikut untuk menaik taraf terus ke versi terbaru OpenSSL: Sudoaptinstall-hanya meningkatkan

Cara Menyelesaikan Masalah OpenSSL mengenai DebianApr 13, 2025 am 06:09 AM

Cara Menyelesaikan Masalah OpenSSL mengenai DebianApr 13, 2025 am 06:09 AMArtikel ini membimbing anda bagaimana untuk menyelesaikan masalah dan menyelesaikan masalah OpenSSL dengan berkesan pada sistem Debian. 1. Kemas kini pakej sistem dan perisian terlebih dahulu, pastikan sistem debian anda telah dikemas kini ke versi terkini: sudoaptpupdateudoaptgrade 2. Pasang OpenSSL dan Pembangunan Perpustakaan Pemasangan OpenSSL dan Perpustakaan Pembangunan yang diperlukan: SudoaptinStallopensslibssl-Dev, Sahkan sama ada Pemasangan menyusun dan memasang OpenSSL secara manual: dari OP

Lokasi Fail Konfigurasi OpenSSL di DebianApr 13, 2025 am 06:06 AM

Lokasi Fail Konfigurasi OpenSSL di DebianApr 13, 2025 am 06:06 AMDalam sistem Debian, fail konfigurasi OpenSSL biasanya terletak di direktori /etc /ssl. Walau bagaimanapun, lokasi fail yang tepat mungkin berbeza -beza bergantung kepada kaedah pemasangan dan versi OpenSSL. Berikut adalah beberapa fail biasa: sijil dan kunci SSL: biasanya disimpan dalam/etc/ssl/certs dan/etc/ssl/direktori swasta. Fail Konfigurasi Utama: Fail OpenSSL.CNF adalah fail konfigurasi utama OpenSSL, biasanya terletak di /etc/ssl/openssl.cnf. Jika anda memasang OpenSSL menggunakan pengurus pakej seperti apt, fail -fail ini hendaklah dibuat secara automatik dan diletakkan dalam direktori yang sepadan. Sila ambil perhatian

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Dreamweaver CS6

Alat pembangunan web visual

Pelayar Peperiksaan Selamat

Pelayar Peperiksaan Selamat ialah persekitaran pelayar selamat untuk mengambil peperiksaan dalam talian dengan selamat. Perisian ini menukar mana-mana komputer menjadi stesen kerja yang selamat. Ia mengawal akses kepada mana-mana utiliti dan menghalang pelajar daripada menggunakan sumber yang tidak dibenarkan.

EditPlus versi Cina retak

Saiz kecil, penyerlahan sintaks, tidak menyokong fungsi gesaan kod

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Versi Mac WebStorm

Alat pembangunan JavaScript yang berguna