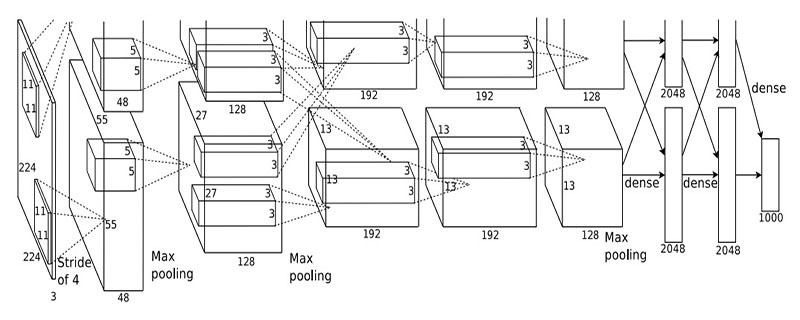

Alex在2012年提出的alexnet网络结构模型引爆了神经网络的应用热潮,并赢得了2012届图像识别大赛的冠军,使得CNN成为在图像分类上的核心算法模型。

AlexNet该模型一共分为八层,5个卷积层,以及3个全连接层,在每一个卷积层中包含了激励函数RELU以及局部响应归一化(LRN)处理,然后在经过降采样(pool处理)。 (推荐学习:web前端视频教程)

第一层:卷积层1,输入为 224×224×3224 \times 224 \times 3224×224×3的图像,卷积核的数量为96,论文中两片GPU分别计算48个核; 卷积核的大小为 11×11×311 \times 11 \times 311×11×3; stride = 4, stride表示的是步长, pad = 0, 表示不扩充边缘;

卷积后的图形大小是怎样的呢?

wide = (224 + 2 * padding - kernel_size) / stride + 1 = 54<br/>height = (224 + 2 * padding - kernel_size) / stride + 1 = 54<br/>dimention = 96<br/>

然后进行 (Local Response Normalized), 后面跟着池化pool_size = (3, 3), stride = 2, pad = 0 最终获得第一层卷积的feature map

第二层:卷积层2, 输入为上一层卷积的feature map, 卷积的个数为256个,论文中的两个GPU分别有128个卷积核。卷积核的大小为:5×5×485 \times 5 \times 485×5×48; pad = 2, stride = 1; 然后做 LRN, 最后 max_pooling, pool_size = (3, 3), stride = 2;

第三层:卷积3, 输入为第二层的输出,卷积核个数为384, kernel_size = (3×3×2563 \times 3 \times 2563×3×256), padding = 1, 第三层没有做LRN和Pool

第四层:卷积4, 输入为第三层的输出,卷积核个数为384, kernel_size = (3×33 \times 33×3), padding = 1, 和第三层一样,没有LRN和Pool

第五层:卷积5, 输入为第四层的输出,卷积核个数为256, kernel_size = (3×33 \times 33×3), padding = 1。然后直接进行max_pooling, pool_size = (3, 3), stride = 2;

第6,7,8层是全连接层,每一层的神经元的个数为4096,最终输出softmax为1000,因为上面介绍过,ImageNet这个比赛的分类个数为1000。全连接层中使用了RELU和Dropout。

Atas ialah kandungan terperinci alexnet网络结构详解. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

AO3 quark masuk laman web rasmi AO3 laman web rasmi quark masukMay 15, 2025 pm 06:45 PM

AO3 quark masuk laman web rasmi AO3 laman web rasmi quark masukMay 15, 2025 pm 06:45 PM1. AO3 laman web rasmi quark masuk ☜☜☜☜☜☜Click untuk menyimpan. 2. AO3 quark masuk laman web rasmi ☜☜☜☜☜☜☜Click untuk menyimpan. 【AO3】 1. AO3 (Arkib kita sendiri) adalah laman web arkib dalam talian yang besar yang dicipta oleh peminat. 2. 3. AO3 mempunyai kandungan yang kaya dan pelbagai jenis, yang dapat memenuhi keperluan pembaca yang berbeza.

AO3 Mirror URL Quark AO3 Mirror Alamat quark masukMay 15, 2025 pm 06:42 PM

AO3 Mirror URL Quark AO3 Mirror Alamat quark masukMay 15, 2025 pm 06:42 PM1. AO3 cermin url quark☜☜☜☜☜☜☜☜ klik untuk masuk. 2. AO3 Mirror Alamat quark masuk ☜☜☜☜☜☜☜ Klik untuk masuk. 3. AO3 (Arkib kita sendiri) adalah laman web kipas bukan keuntungan dan laman web arkib fiksyen yang dilancarkan pada 29 Oktober 2008. 4. AO3 adalah laman web yang diasaskan oleh peminat dan dikendalikan oleh peminat, yang didedikasikan untuk melindungi karya-karya yang dicipta oleh peminat dan menyediakan persekitaran bebas penapisan untuk penulis novel penggemar.

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Muat turun versi mac editor Atom

Editor sumber terbuka yang paling popular

SublimeText3 versi Inggeris

Disyorkan: Versi Win, menyokong gesaan kod!

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

mPDF

mPDF ialah perpustakaan PHP yang boleh menjana fail PDF daripada HTML yang dikodkan UTF-8. Pengarang asal, Ian Back, menulis mPDF untuk mengeluarkan fail PDF "dengan cepat" dari tapak webnya dan mengendalikan bahasa yang berbeza. Ia lebih perlahan dan menghasilkan fail yang lebih besar apabila menggunakan fon Unicode daripada skrip asal seperti HTML2FPDF, tetapi menyokong gaya CSS dsb. dan mempunyai banyak peningkatan. Menyokong hampir semua bahasa, termasuk RTL (Arab dan Ibrani) dan CJK (Cina, Jepun dan Korea). Menyokong elemen peringkat blok bersarang (seperti P, DIV),

Dreamweaver Mac版

Alat pembangunan web visual