pembangunan bahagian belakang

pembangunan bahagian belakang Tutorial Python

Tutorial Python Cache Python: Cara Mempercepatkan Kod Anda dengan Caching Berkesan

Cache Python: Cara Mempercepatkan Kod Anda dengan Caching BerkesanBlog ini pada mulanya disiarkan ke Crawlbase Blog

Kod yang cekap dan pantas adalah penting untuk mencipta pengalaman pengguna yang hebat dalam aplikasi perisian. Pengguna tidak suka menunggu respons yang perlahan, sama ada memuatkan halaman web, melatih model pembelajaran mesin atau menjalankan skrip. Satu cara untuk mempercepatkan kod anda ialah menyimpan cache.

Tujuan caching adalah untuk membuat cache sementara data yang kerap digunakan supaya program anda boleh mengaksesnya dengan lebih pantas tanpa perlu mengira semula atau mendapatkannya beberapa kali. Caching boleh mempercepatkan masa tindak balas, mengurangkan beban dan meningkatkan pengalaman pengguna.

Blog ini akan merangkumi prinsip caching, peranannya, kes penggunaan, strategi dan contoh dunia nyata caching dalam Python. Mari mulakan!

Melaksanakan Caching dalam Python

Caching boleh dilakukan dalam Python dalam pelbagai cara. Mari lihat dua kaedah biasa: menggunakan penghias manual untuk caching dan functools.lru_cache terbina dalam Python.

1. Penghias Manual untuk Caching

Penghias ialah fungsi yang membungkus fungsi lain. Kita boleh mencipta penghias caching yang menyimpan hasil panggilan fungsi dalam memori dan mengembalikan hasil cache jika input yang sama dipanggil semula. Berikut ialah contoh:

import requests

# Manual caching decorator

def memoize(func):

cache = {}

def wrapper(*args):

if args in cache:

return cache[args]

result = func(*args)

cache[args] = result

return result

return wrapper

# Function to get data from a URL

@memoize

def get_html(url):

response = requests.get(url)

return response.text

# Example usage

print(get_html('https://crawlbase.com'))

Dalam contoh ini, kali pertama get_html dipanggil, ia mengambil data daripada URL dan menyimpannya dalam cache. Pada panggilan berikutnya dengan URL yang sama, hasil cache dikembalikan.

- Menggunakan functools.lru_cache Python

Python menyediakan mekanisme caching terbina dalam yang dipanggil lru_cache daripada modul functools. Penghias ini menyimpan panggilan fungsi dan mengalih keluar item yang paling kurang digunakan baru-baru ini apabila cache penuh. Begini cara menggunakannya:

from functools import lru_cache

@lru_cache(maxsize=128)

def expensive_computation(x, y):

return x * y

# Example usage

print(expensive_computation(5, 6))

Dalam contoh ini, lru_cache menyimpan cache hasil pengiraan_mahal. Jika fungsi dipanggil semula dengan hujah yang sama, ia mengembalikan hasil cache dan bukannya mengira semula.

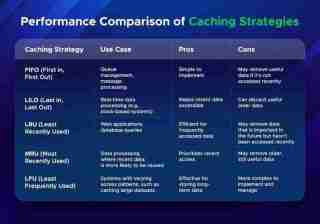

Perbandingan Prestasi Strategi Caching

Apabila memilih strategi caching, anda perlu mempertimbangkan prestasinya dalam keadaan yang berbeza. Prestasi strategi caching bergantung pada bilangan capan cache (apabila data ditemui dalam cache) dan saiz cache.

Berikut ialah perbandingan strategi caching biasa:

Memilih strategi caching yang betul bergantung pada corak akses data dan keperluan prestasi aplikasi anda.

Fikiran Akhir

Caching boleh menjadi sangat berguna untuk apl anda. Ia boleh mengurangkan masa pengambilan data dan beban sistem. Sama ada anda sedang membina apl web, projek pembelajaran mesin atau ingin mempercepatkan sistem anda, caching pintar boleh menjadikan kod anda berjalan lebih pantas.

Kaedah caching seperti FIFO, LRU dan LFU mempunyai kes penggunaan yang berbeza. Contohnya, LRU bagus untuk apl web yang perlu menyimpan data yang kerap diakses, manakala LFU bagus untuk program yang perlu menyimpan data dari semasa ke semasa.

Melaksanakan caching dengan betul akan membolehkan anda mereka bentuk apl yang lebih pantas dan cekap serta memperoleh prestasi dan pengalaman pengguna yang lebih baik.

Atas ialah kandungan terperinci Cache Python: Cara Mempercepatkan Kod Anda dengan Caching Berkesan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Terangkan perbezaan prestasi dalam operasi elemen-bijak antara senarai dan tatasusunan.May 06, 2025 am 12:15 AM

Terangkan perbezaan prestasi dalam operasi elemen-bijak antara senarai dan tatasusunan.May 06, 2025 am 12:15 AMArraysareBetterforelement-wiseoperationsduetofasteraccessandoptimizedImplementations.1) arrayshavecontiguousmemoryfordirectaccess, enhancingperformance.2) listsareflexibleButslowerduetopotentiahyiLys.3)

Bagaimanakah anda boleh melakukan operasi matematik pada keseluruhan array Numpy dengan cekap?May 06, 2025 am 12:15 AM

Bagaimanakah anda boleh melakukan operasi matematik pada keseluruhan array Numpy dengan cekap?May 06, 2025 am 12:15 AMOperasi matematik keseluruhan array di Numpy dapat dilaksanakan dengan cekap melalui operasi vektor. 1) Gunakan pengendali mudah seperti tambahan (ARR 2) untuk melaksanakan operasi pada tatasusunan. 2) Numpy menggunakan perpustakaan bahasa C yang mendasari, yang meningkatkan kelajuan pengkomputeran. 3) Anda boleh melakukan operasi kompleks seperti pendaraban, pembahagian, dan eksponen. 4) Perhatikan operasi penyiaran untuk memastikan bahawa bentuk array bersesuaian. 5) Menggunakan fungsi numpy seperti np.sum () dapat meningkatkan prestasi dengan ketara.

Bagaimana anda memasukkan elemen ke dalam array python?May 06, 2025 am 12:14 AM

Bagaimana anda memasukkan elemen ke dalam array python?May 06, 2025 am 12:14 AMDi Python, terdapat dua kaedah utama untuk memasukkan elemen ke dalam senarai: 1) Menggunakan kaedah memasukkan (indeks, nilai), anda boleh memasukkan elemen pada indeks yang ditentukan, tetapi memasukkan pada permulaan senarai besar tidak cekap; 2) Menggunakan kaedah append (nilai), tambahkan elemen pada akhir senarai, yang sangat berkesan. Untuk senarai besar, disarankan untuk menggunakan append () atau pertimbangkan menggunakan array deque atau numpy untuk mengoptimumkan prestasi.

Bagaimana anda boleh membuat skrip python boleh dilaksanakan pada kedua -dua Unix dan Windows?May 06, 2025 am 12:13 AM

Bagaimana anda boleh membuat skrip python boleh dilaksanakan pada kedua -dua Unix dan Windows?May 06, 2025 am 12:13 AMTomakeapythonscriptexecutableonbothunixandWindows: 1) addashebangline (#!/Usr/bin/envpython3) andusechmod xtomakeitexecutableonunix.2) onwindows, memastikanpythonisinstalledandAssociateWith.pyhiles, runeAtAsdiStAnToSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSoSo.

Apa yang perlu anda periksa jika anda mendapat ralat 'perintah tidak dijumpai' apabila cuba menjalankan skrip?May 06, 2025 am 12:03 AM

Apa yang perlu anda periksa jika anda mendapat ralat 'perintah tidak dijumpai' apabila cuba menjalankan skrip?May 06, 2025 am 12:03 AMApabila menghadapi kesilapan "commandnotfound", perkara -perkara berikut harus diperiksa: 1. Sahkan bahawa skrip ada dan jalannya betul; 2. Semak kebenaran fail, dan gunakan ChMod untuk menambah kebenaran pelaksanaan jika perlu; 3. Pastikan penterjemah skrip dipasang dan di jalan; 4. Sahkan bahawa garis shebang pada permulaan skrip adalah betul. Melakukannya dengan berkesan dapat menyelesaikan masalah operasi skrip dan memastikan proses pengekodan lancar.

Kenapa array secara amnya lebih cekap memori daripada senarai untuk menyimpan data berangka?May 05, 2025 am 12:15 AM

Kenapa array secara amnya lebih cekap memori daripada senarai untuk menyimpan data berangka?May 05, 2025 am 12:15 AMArraysareGenerallymorememememory-efficientthanlistsforstoringnumericaldataduetotheirfixed-sizenatureanddirectmemoryaccess.1) arraysstoreelementsinacontiguousblock, reducingoverheadfrointersormetadata.2)

Bagaimana anda boleh menukar senarai python ke array python?May 05, 2025 am 12:10 AM

Bagaimana anda boleh menukar senarai python ke array python?May 05, 2025 am 12:10 AMToConvertapythonlisttoanarray, usetheArraymodule: 1) importThearraymodule, 2) createalist, 3) UseArray (typecode, list) toConvertit, spesifyingthetypecodelike'i'forintegers.ThisconversionOptimizesMogenhomogeneousdata, enHomerMogeneShomogeneousdata, enHomerMogeneousdata, enhomoMogenerDataShomaSdata, enhomoMogenhomogeneousdata,

Bolehkah anda menyimpan jenis data yang berbeza dalam senarai python yang sama? Beri contoh.May 05, 2025 am 12:10 AM

Bolehkah anda menyimpan jenis data yang berbeza dalam senarai python yang sama? Beri contoh.May 05, 2025 am 12:10 AMSenarai Python boleh menyimpan pelbagai jenis data. Senarai contoh mengandungi integer, rentetan, nombor titik terapung, boolean, senarai bersarang, dan kamus. Senarai fleksibiliti adalah berharga dalam pemprosesan data dan prototaip, tetapi ia perlu digunakan dengan berhati -hati untuk memastikan kebolehbacaan dan pemeliharaan kod.

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Versi Mac WebStorm

Alat pembangunan JavaScript yang berguna

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 Linux versi baharu

SublimeText3 Linux versi terkini

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

EditPlus versi Cina retak

Saiz kecil, penyerlahan sintaks, tidak menyokong fungsi gesaan kod