QwQ-32B

Gunakan sekarang

pengenalan:Ditambah pada:Pelawat Bulanan:

Model penalaran sumber terbuka untuk tugas kompleks dengan parameter 32B.Mar-26,2025 0

0

0

0

Maklumat Produk

Apa itu qwq-32b?

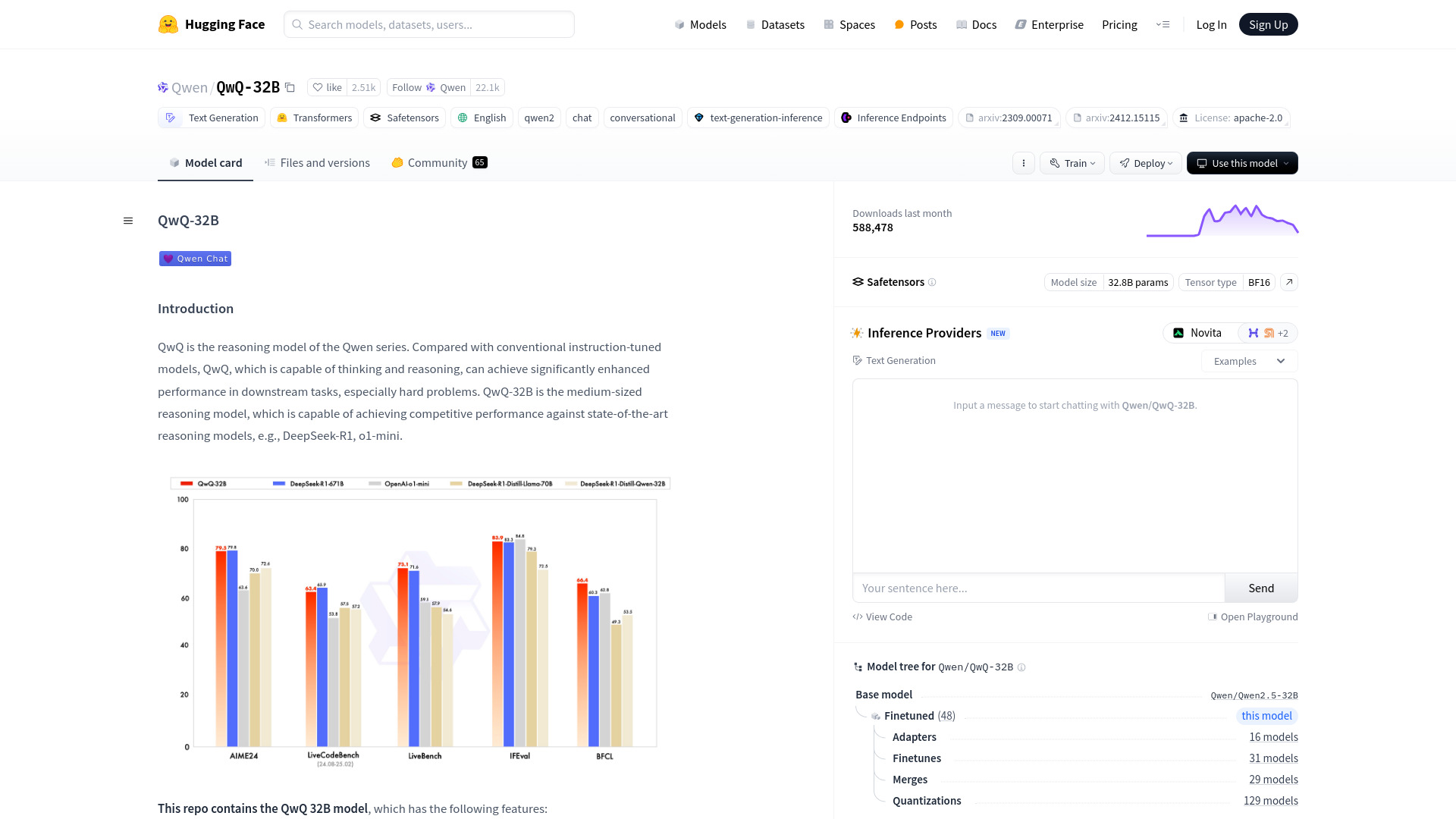

QWQ-32B, yang dibangunkan oleh pasukan Alibaba Qwen, adalah model bahasa parameter 32 bilion sumber terbuka yang direka untuk penalaran yang mendalam. Ia menggunakan pembelajaran tetulang, menjadikannya mampu menafikan dan meningkatkan prestasi dalam tugas -tugas yang kompleks berbanding dengan model konvensional.

Bagaimana cara menggunakan qwq-32b?

Untuk menggunakan QWQ-32B, muatkan model melalui Perpustakaan Transformers Face Hugging, masukkan arahan anda, dan menghasilkan respons menggunakan keupayaan model.

Ciri-ciri teras QWQ-32B

Sumber terbuka

32 bilion parameter

Keupayaan penalaran yang mendalam

Menyokong output yang bijak

Kes penggunaan QWQ-32B

Penjanaan teks untuk tugas penalaran yang kompleks

Menjana jawapan kepada masalah matematik dengan penalaran langkah demi langkah

Sumber berkaitan

Artikel Panas

Ejen replit: panduan dengan contoh praktikal

2 bulan yang laluBy尊渡假赌尊渡假赌尊渡假赌

Apakah Protokol Konteks Model (MCP)?

2 bulan yang laluBy尊渡假赌尊渡假赌尊渡假赌

Cara Menggunakan Dall-E 3: Contoh, Contoh, dan Ciri

1 bulan yang laluBy尊渡假赌尊渡假赌尊渡假赌

Penjana Seni AI Terbaik (Percuma & amp; Dibayar) untuk projek kreatif

1 bulan yang laluBy百草

Saya cuba pengekodan getaran dengan kursor AI dan ia menakjubkan!

1 bulan yang laluBy尊渡假赌尊渡假赌尊渡假赌