Vincentian 다이어그램의 초석인 CLIP 모델 개발에 대한 검토

- 王林앞으로

- 2024-03-22 20:50:221336검색

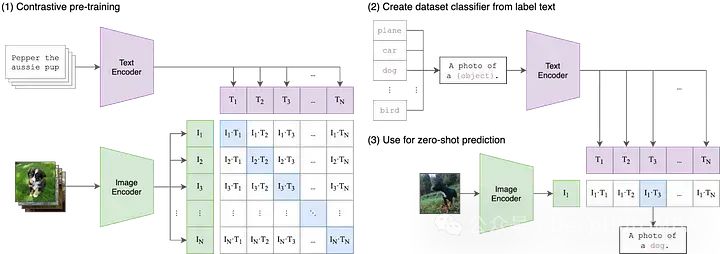

CLIP은 Contrastive Language-Image Pre-training의 약자로, 대조 텍스트-이미지 쌍을 기반으로 한 사전 학습 방법 또는 모델입니다. CLIP의 학습 데이터는 텍스트-이미지로 구성됩니다. 이미지가 해당 텍스트 설명과 쌍을 이루는 모델은 대조 학습을 통해 텍스트와 이미지 쌍 간의 관계를 이해하는 것을 목표로 합니다.

Open AI 출시 DALL-E 및 CLIP, 두 모델 모두 다중입니다. -이미지와 텍스트를 결합할 수 있는 모달 모델. DALL-E는 텍스트를 기반으로 이미지를 생성하는 모델이고, CLIP은 텍스트를 감독 신호로 사용하여 전송 가능한 시각적 모델을 훈련합니다.

Stable Diffusion 모델에서는 CLIP 텍스트 인코더에서 추출한 텍스트 특징이 Cross Attention을 통해 확산 모델의 UNet에 삽입됩니다. 구체적으로 텍스트 기능은 관심의 키와 가치로 사용되는 반면 UNet 기능은 쿼리로 사용됩니다. 즉, CLIP은 사실상 텍스트 정보와 이미지 정보를 유기적으로 결합하여 텍스트와 그림 사이의 핵심적인 가교 역할을 하는 것입니다. 이러한 조합을 통해 모델은 다양한 양식 간의 정보를 더 잘 이해하고 처리할 수 있으므로 복잡한 작업을 처리할 때 더 나은 결과를 얻을 수 있습니다. 이러한 방식으로 Stable Diffusion 모델은 CLIP의 텍스트 인코딩 기능을 보다 효과적으로 활용하여 전반적인 성능을 향상시키고 적용 영역을 확장할 수 있습니다.

CLIP

이 문서는 2021년 OpenAI에서 발행한 최초의 논문입니다. CLIP을 이해하려면 약어를 세 가지 구성 요소로 분해해야 합니다. (1) 대비, (2) 언어 - 이미지, ( 3) 사전 훈련.

언어-이미지부터 시작해 보겠습니다.

기존 기계 학습 모델에서는 일반적으로 텍스트, 이미지, 표 형식 데이터 또는 오디오와 같은 입력 데이터의 단일 형식만 허용될 수 있습니다. 예측을 위해 다양한 데이터 양식을 사용해야 하는 경우 여러 가지 다양한 모델을 훈련해야 합니다. CLIP에서 "Language-Image"는 모델이 텍스트(언어)와 이미지 입력 데이터를 모두 수용할 수 있다는 의미입니다. 이 설계를 통해 CLIP은 다양한 양식의 정보를 보다 유연하게 처리할 수 있으므로 예측 기능과 적용 범위가 향상됩니다.

CLIP은 텍스트 인코더와 이미지 인코더라는 두 가지 인코더를 사용하여 텍스트 및 이미지 입력을 처리합니다. 이 두 인코더는 입력 데이터를 저차원 잠재 공간에 매핑하여 각 입력에 대해 해당 임베딩 벡터를 생성합니다. 중요한 세부 사항은 텍스트 및 이미지 인코더가 데이터를 동일한 공간에 삽입한다는 것입니다. 즉, 원래 CLIP 공간은 512차원 벡터 공간입니다. 이러한 디자인을 통해 별도의 변환이나 처리 없이 텍스트와 이미지를 직접 비교하고 매칭할 수 있습니다. 이러한 방식으로 CLIP은 동일한 벡터 공간에서 텍스트 설명과 이미지 내용을 표현할 수 있으므로 교차 모달 의미 체계 정렬 및 검색 기능이 가능합니다. 이 공유 임베딩 공간의 설계는 CLIP에 더 나은 일반화 기능과 적응성을 제공하여 다양한 작업과 데이터 세트에서 잘 작동할 수 있게 해줍니다.

Contrastive

텍스트와 이미지 데이터를 동일한 벡터 공간에 삽입하는 것이 유용한 출발점이 될 수 있지만, 단순히 이렇게 하는 것만으로는 모델이 텍스트와 이미지의 표현을 효과적으로 비교할 수 있다고 보장할 수 없습니다. 예를 들어, 텍스트에 '개' 또는 '개 사진'을 삽입하는 것과 개 이미지를 삽입하는 것 사이에 합리적이고 해석 가능한 관계를 구축하는 것이 중요합니다. 그러나 이 두 모델 사이의 격차를 해소할 방법이 필요합니다.

다중 모드 기계 학습에는 두 가지 양식을 정렬하는 다양한 기술이 있지만 현재 가장 널리 사용되는 방법은 대비입니다. 대조 기술은 이미지와 캡션이라는 두 가지 양식에서 입력 쌍을 취하고 모델의 두 인코더를 훈련하여 이러한 입력 데이터 쌍을 최대한 가깝게 표현합니다. 동시에, 모델은 짝이 없는 입력(예: 개 이미지 및 "자동차 사진" 텍스트)을 가져와 가능한 한 멀리 표시하도록 유도됩니다. CLIP은 이미지와 텍스트에 대한 최초의 대조 학습 기술은 아니지만 단순성과 효율성으로 인해 다중 모드 애플리케이션의 주류가 되었습니다.

사전 훈련

CLIP 자체는 제로샷 분류, 의미 검색, 비지도 데이터 탐색과 같은 애플리케이션에 유용하지만 CLIP은 다수의 다중 학습을 위한 빌딩 블록으로도 사용됩니다. Stable Diffusion 및 DALL-E부터 StyleCLIP 및 OWL-ViT까지 모달 애플리케이션. 대부분의 다운스트림 애플리케이션에서 초기 CLIP 모델은 "사전 학습"의 시작점으로 간주되며 전체 모델은 새로운 사용 사례에 맞게 미세 조정됩니다.

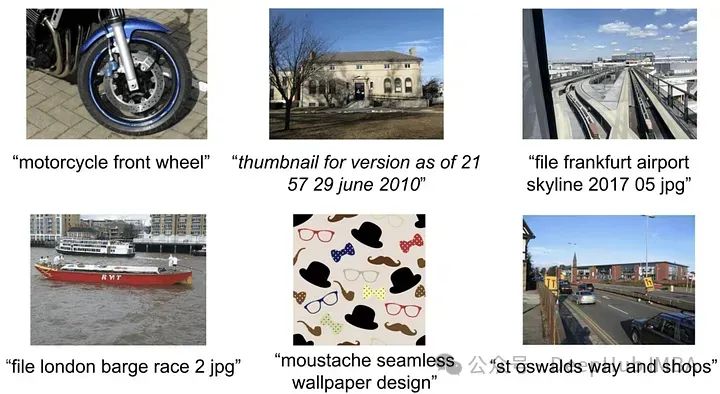

OpenAI는 원래 CLIP 모델을 훈련하는 데 사용된 데이터를 명시적으로 지정하거나 공유하지 않았지만, CLIP 논문에서는 해당 모델이 인터넷에서 수집한 4억 개의 이미지-텍스트 쌍을 대상으로 훈련했다고 언급했습니다.

https://www.php.cn/link/7c1bbdaebec5e20e91db1fe61221228f

ALIGN: 시끄러운 텍스트 감독으로 시각 및 시각 언어 표현 학습 확장

CLIP을 사용하면 OpenAI는 40억 달러를 사용합니다. 이미지-텍스트 쌍의 세부 정보가 제공되지 않으므로 데이터 세트가 어떻게 구성되었는지 정확히 아는 것은 불가능합니다. 그러나 새로운 데이터 세트를 설명하면서 그들은 Google의 개념적 캡션을 영감으로 여겼습니다. 이는 값비싼 필터링 및 후처리 기술을 사용하는 상대적으로 작은 데이터 세트(330만 개의 이미지-캡션 쌍)입니다. 기술은 강력하지만 특별히 확장 가능하지는 않습니다. .

그래서 고품질의 데이터 세트가 연구의 방향이 되었습니다. CLIP에 이어 ALIGN은 스케일 필터링을 통해 이 문제를 해결했습니다. ALIGN은 신중하게 주석을 달고 엄선된 이미지 캡션 데이터 세트에 의존하지 않고 대신 18억 쌍의 이미지와 대체 텍스트를 활용합니다.

이러한 대체 텍스트 설명은 제목보다 평균적으로 훨씬 더 시끄럽지만 데이터세트의 엄청난 크기가 이를 보완하고도 남습니다. 작성자는 기본 필터링을 사용하여 중복된 항목, 관련 대체 텍스트가 1,000개 이상 포함된 이미지, 정보가 없는 대체 텍스트(너무 일반적이거나 드문 태그 포함)를 제거했습니다. 이러한 간단한 단계를 통해 ALIGN은 다양한 제로샷 및 미세 조정 작업에서 최첨단 기술에 도달하거나 이를 능가합니다.

https://arxiv.org/abs/2102.05918

K-LITE: 외부 지식을 활용한 전이 가능한 시각적 모델 학습

ALIGN과 마찬가지로 K-LITE도 다음의 비교 사전 학습 문제를 해결합니다. 제한된 수의 문제에 대한 고품질 이미지-텍스트 쌍.

K-LITE는 개념을 설명하는 데 중점을 둡니다. 즉, 맥락과 알려지지 않은 개념에 대한 정의나 설명은 폭넓은 이해를 발전시키는 데 도움이 될 수 있습니다. 대중적인 설명은 사람들이 처음으로 기술 용어와 흔하지 않은 어휘를 소개할 때 일반적으로 이를 단순히 정의하거나 모든 사람이 알고 있는 것에 대한 비유를 사용한다는 것입니다.

이 접근 방식을 구현하기 위해 Microsoft와 UC Berkeley의 연구원들은 WordNet과 Wiktionary를 사용하여 이미지-텍스트 쌍의 텍스트를 향상시켰습니다. ImageNet의 클래스 레이블과 같은 일부 격리된 개념의 경우 개념 자체가 향상되는 반면 제목(예: GCC의)의 경우 가장 덜 일반적인 명사구가 향상됩니다. 이러한 추가 구조화된 지식을 통해 사전 훈련된 모델은 전이 학습 작업에서 상당한 개선을 보여줍니다.

https://arxiv.org/abs/2204.09222

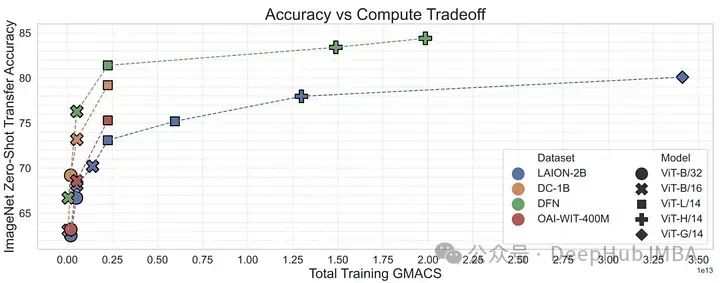

OpenCLIP: 대조 언어-이미지 학습을 위한 재현 가능한 스케일링 법칙

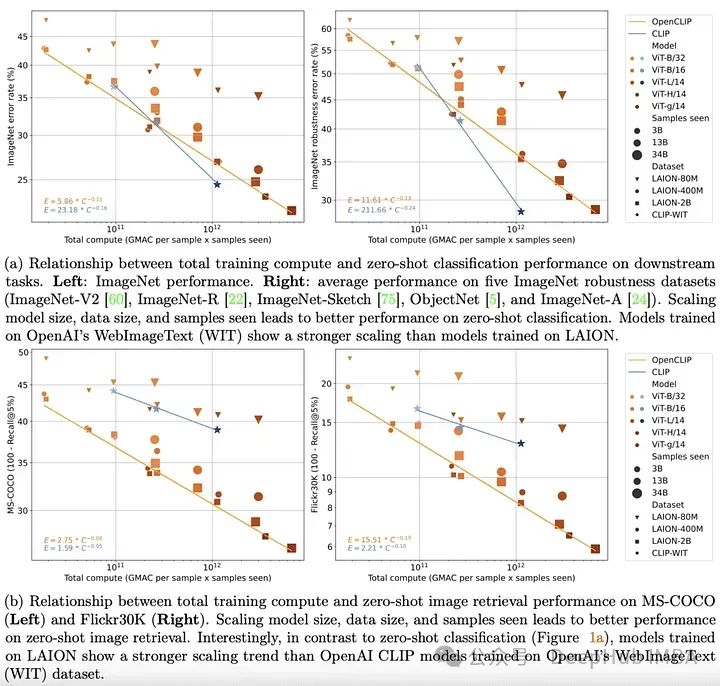

2022년 말까지 변환기 모델이 텍스트와 시각적 도메인. 두 분야 모두에서 선구적인 경험적 연구를 통해 단봉 작업에 대한 변환기 모델의 성능이 간단한 스케일링 법칙으로 잘 설명될 수 있음이 명확하게 나타났습니다. 이는 훈련 데이터의 양, 훈련 시간 또는 모델 크기가 증가함에 따라 모델의 성능을 상당히 정확하게 예측할 수 있음을 의미합니다.

OpenCLIP은 현재까지 공개된 최대 오픈 소스 이미지-텍스트 쌍 데이터 세트를 사용하여 위의 이론을 다중 모달 시나리오로 확장하여 제로 샷 및 미세 조정 작업에서 훈련 데이터 쌍 모델의 성능을 체계적으로 연구합니다(5B) Impact . 단일 모드의 경우와 마찬가지로 이 연구에서는 다중 모드 작업의 모델 성능이 계산, 표시된 샘플 수 및 모델 매개변수 수 측면에서 거듭제곱 법칙에 따라 확장된다는 것을 보여줍니다.

멱함수 법칙의 존재보다 훨씬 더 흥미로운 점은 멱함수 법칙 스케일링과 사전 훈련 데이터 간의 관계입니다. OpenAI의 CLIP 모델 아키텍처와 훈련 방법을 유지하는 OpenCLIP 모델은 샘플 이미지 검색 작업에서 더 강력한 확장 기능을 보여줍니다. ImageNet의 제로샷 이미지 분류를 위해 OpenAI의 모델(독점 데이터 세트로 교육됨)은 더 강력한 스케일링 기능을 보여주었습니다. 이러한 결과는 다운스트림 성능에 대한 데이터 수집 및 필터링 절차의 중요성을 강조합니다.

https://arxiv.org/abs/2212.07143그러나 OpenCLIP이 출시된 직후 LAION 데이터세트에는 불법 이미지가 포함되어 있다는 이유로 인터넷에서 삭제되었습니다.

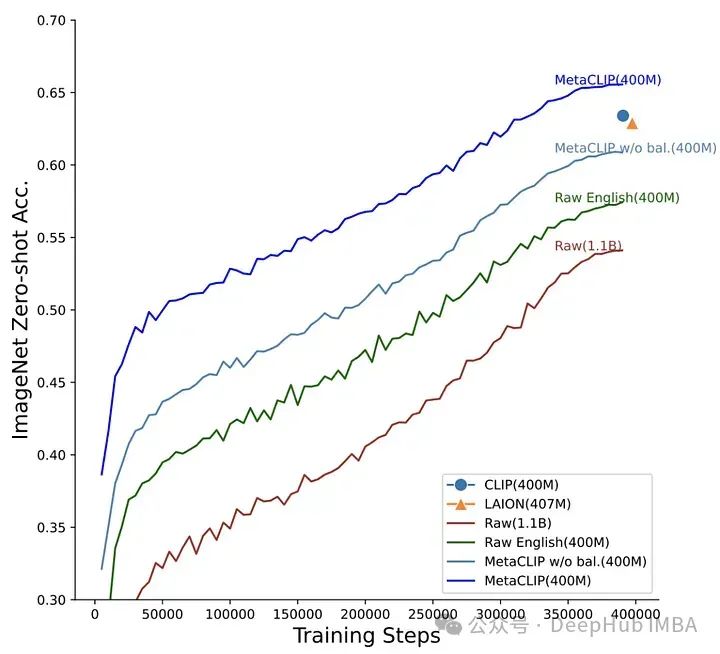

MetaCLIP: CLIP 데이터 이해하기

OpenCLIP은 데이터 양, 계산 노력, 모델 매개변수 수에 따라 다운스트림 작업의 성능이 어떻게 변하는지 이해하려고 시도하는 반면, MetaCLIP은 데이터 선택 방법에 중점을 둡니다. 저자가 말했듯이 "우리는 CLIP의 성공의 주요 요인은 모델 아키텍처나 사전 훈련 목표가 아니라 데이터라고 믿습니다."

이 가설을 검증하기 위해 저자는 모델 아키텍처와 훈련 단계를 수정하고 실험을 수행했습니다. MetaCLIP 팀은 하위 문자열 일치, 필터링 및 데이터 분포 균형 조정과 관련된 다양한 전략을 테스트한 결과, 훈련 데이터 세트에서 각 텍스트가 최대 20,000번 나타날 때 최고의 성능이 달성된다는 사실을 확인했습니다. 심지어 초기 데이터 풀에서 5,400만 번 등장한 '사진'이라는 단어도 훈련 데이터에서는 이미지-텍스트 쌍 20,000개로 제한됐다. 이 전략을 사용하여 MetaCLIP은 Common Crawl 데이터세트의 4억 개의 이미지-텍스트 쌍에 대해 교육을 받았고, 다양한 벤치마크에서 OpenAI의 CLIP 모델보다 성능이 뛰어났습니다.

https://arxiv.org/abs/2309.16671

DFN: 데이터 필터링 네트워크

MetaCLIP에 대한 연구를 통해 데이터 관리가 고등 교육을 위한 중요한 도구가 될 수 있음을 알 수 있습니다. -성능 다중 모드 모델(예: CLIP) MetaCLIP의 필터링 전략은 매우 성공적이지만 주로 경험적 방법을 기반으로 합니다. 그런 다음 연구원들은 이 필터링을 보다 효율적으로 수행하도록 모델을 훈련할 수 있는지 여부를 조사했습니다.

이를 검증하기 위해 저자는 개념적 12M의 고품질 데이터를 사용하여 저품질 데이터에서 고품질 데이터를 필터링하도록 CLIP 모델을 학습합니다. 이 DFN(데이터 필터링 네트워크)은 선별되지 않은 데이터세트(이 경우 공통 크롤링)에서 고품질 데이터만 선택하여 더 큰 고품질 데이터세트를 구축하는 데 사용됩니다. 필터링된 데이터로 훈련된 CLIP 모델은 초기 고품질 데이터로만 훈련된 모델과 필터링되지 않은 대량의 데이터로 훈련된 모델보다 성능이 뛰어났습니다.

https://arxiv.org/abs/2309.17425

Summary

OpenAI의 CLIP 모델은 다중 모드 데이터를 처리하는 방식을 크게 변화시킵니다. 하지만 CLIP은 시작에 불과합니다. 사전 훈련 데이터부터 훈련 방법 및 대조 손실 함수의 세부 사항에 이르기까지 CLIP 제품군은 지난 몇 년 동안 놀라운 발전을 이루었습니다. ALIGN은 시끄러운 텍스트의 크기를 조정하고, K-LITE는 외부 지식을 향상시키며, OpenCLIP은 확장 법칙을 연구하고, MetaCLIP은 데이터 관리를 최적화하며, DFN은 데이터 품질을 향상시킵니다. 이러한 모델은 다중 모드 인공 지능 개발에서 CLIP의 역할에 대한 이해를 심화시켜 이미지와 텍스트 연결의 진전을 보여줍니다.

위 내용은 Vincentian 다이어그램의 초석인 CLIP 모델 개발에 대한 검토의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!