시계열 예측은 소매, 금융, 제조, 의료, 자연과학 등 다양한 분야에서 중요한 역할을 합니다. 유통업계에서는 수요예측의 정확성을 높여 재고비용을 효과적으로 절감하고 매출을 증대시킬 수 있습니다. 이는 기업이 고객 수요를 더 잘 충족하고, 재고 과잉 및 손실을 줄이면서 매출과 이익을 높일 수 있음을 의미합니다. 따라서 시계열 예측은 소매 분야에서 큰 가치를 가지며 기업에 실체를 가져올 수 있습니다.

딥 러닝(DL) 모델은 "다변수 시계열 예측" 작업을 지배하며 다양한 대회에서 사용되며 실제 응용 프로그램.

동시에 자연어 처리(NLP) 작업의 대규모 기본 언어 모델에서 상당한 진전이 이루어져 번역, 검색 향상 생성, 코드 완성 등의 작업 성능이 효과적으로 향상되었습니다.

NLP 모델의 교육은 크롤러, 오픈 소스 코드 등 다양한 소스에서 제공되는 대규모 텍스트 데이터에 의존합니다. 교육된 모델은 언어의 패턴을 인식할 수 있으며 제로 샘플에서 학습할 수 있는 능력이 있습니다. : 예를 들어 대형 모델은 모델이 현재 이벤트에 대한 질문에 답하고 요약할 수 있는 검색 작업에 사용됩니다.

딥 러닝 기반 예측기는 훈련 및 추론 비용 절감을 포함하여 여러 측면에서 기존 방법보다 성능이 뛰어나지만 여전히 극복해야 할 몇 가지 과제가 있습니다.

많은 딥 러닝 모델이 오랜 시간 동안 훈련 및 검증을 거쳐야 가능합니다. 새로운 시계열에서 테스트되었습니다. 이와 대조적으로 시계열 예측을 위한 기본 모델에는 "즉시 사용 가능한 예측" 기능이 있으며 추가 교육 없이 알 수 없는 시계열 데이터에 적용할 수 있습니다. 이 기능을 통해 사용자는 소매 수요 계획과 같은 실제 다운스트림 작업에 대한 예측 개선에 집중할 수 있습니다.

Google Research의 연구원들은 최근 1,000억 개의 실제 시점에 대해 사전 훈련된 TimesFM이라는 시계열 예측을 위한 기본 모델을 제안했습니다. 현재 최첨단 LLM(대형 언어 모델)과 비교할 때 TimesFM은 2억 개의 매개변수만 포함하여 크기가 훨씬 작습니다.

논문 링크: https://arxiv.org/pdf/2310.10688.pdf

실험 결과에 따르면 소규모에도 불구하고 TimesFM은 훈련받지 않은 경우와 다양한 도메인 및 시간 척도에서 다르게 작동하는 것으로 나타났습니다. 이러한 데이터 세트에 대해 명시적으로 훈련된 최첨단 지도 방법의 성능에 가까운 놀라운 "제로 샷 성능"입니다.

연구원들은 올해 말 Google Cloud Vertex AI를 통해 외부 고객에게 TimesFM 모델을 제공할 계획입니다.

기본 모델 TimesFM

LLM은 일반적으로 세 단계를 포함하는 디코더 전용 방식으로 훈련됩니다.

1 텍스트는 토큰이라는 하위 단어로 분해됩니다.

2. 인과 변환기 레이어를 쌓아 각 입력 토큰에 해당하는 출력을 생성합니다. 이 레이어는 입력 없이는 토큰, 즉 미래 토큰을 처리할 수 없다는 점에 유의해야 합니다. 대응 i번째 토큰의 출력은 모든 것을 요약합니다. 이전 토큰의 정보를 수집하고 (i+1)번째 토큰

을 예측합니다. 추론 중에 LLM은 한 번에 하나의 토큰 출력을 생성합니다.

예를 들어 "프랑스의 수도는 무엇입니까?"(프랑스의 수도는 무엇입니까?)라는 프롬프트를 입력하면 모델은 "The" 토큰을 생성한 후 다음 토큰인 "Capital"을 기반으로 생성할 수 있습니다. 이 프롬프트에서 ”(대문자) 등을 모델이 완전한 답변을 생성할 때까지 계속합니다. “프랑스의 수도는 파리입니다.”(프랑스의 수도는 파리입니다).

시계열 예측을 위한 기본 모델은 사전 훈련된 대규모 데이터 세트(패턴)의 모든 패턴을 인코딩할 수 있을 만큼 강력하면서도 가변 컨텍스트(모델이 관찰하는 것) 및 범위(쿼리 모델이 예측하는 것) 길이에 적응해야 합니다.

LLM과 유사하게 연구자들은 시계열 예측의 맥락에서 누적된 Transformer 레이어(Self-Attention 및 Feed-forward 레이어)를 TimesFM 모델의 주요 빌딩 블록으로 사용합니다. 연속 시점) 토큰으로서 아이디어는 최근의 장거리 예측 작업에서 나왔습니다. 특정 작업은 누적된 Transformer 레이어 패치의 끝에서 주어진 i번째 출력에 대한 (i+1)번째 시점을 예측하는 것입니다.

TimesFM은 언어 모델과 몇 가지 주요 차이점이 있습니다.

1 모델에는 시계열 패치를 토큰으로 변환하기 위해 잔여 연결이 있는 다층 퍼셉트론 블록이 필요하며 이는 인코딩( PE)를 Transformer 계층에 대한 입력과 함께 제공합니다. 이를 위해 우리는 장기 예측에서 이전 작업과 유사한 잔차 블록을 사용합니다.

2. 스택된 Transformer의 출력 토큰을 사용하여 입력 패치 길이보다 긴 후속 시점의 길이를 예측할 수 있습니다. 즉, 출력 패치 길이가 입력 패치 길이보다 클 수 있습니다.

512개 시점 길이의 시계열을 사용하여 "입력 패치 길이 32" 및 "출력 패치 길이 128"을 사용하는 TimesFM 모델을 훈련한다고 가정합니다.

훈련 중에 모델은 다음과 같이 훈련됩니다. 동시에 처음 32개 시점을 사용하여 다음 128개 시점을 예측하려면 처음 64개 시점을 사용하여 시점 65~192를 예측하고, 처음 96개 시점을 사용하여 시점 97~224를 예측하는 식입니다.

입력 데이터가 길이 256의 시계열이고 그 작업이 미래의 다음 256개 시점을 예측하는 것이라고 가정하면 모델은 먼저 시점 257~384에 대한 미래 예측을 생성한 다음 초기 데이터를 가져옵니다. 256 길이 입력 플러스 생성된 출력은 시점 385~512를 생성하는 조건입니다.

반면에 모델에서 출력 패치 길이가 입력 패치 길이 32와 같다면 동일한 작업에 대해 모델이 2세대가 아닌 8세대 단계를 거치므로 오류 누적 위험이 높아집니다. 따라서 실험 결과에서 볼 수 있듯이 출력 패치 길이가 길수록 장기 예측 성능이 향상됩니다.

사전 훈련 데이터

LLM이 더 많은 토큰으로 더 좋아질 수 있는 것처럼 TimesFM은 학습하고 개선하기 위해 많은 양의 합법적인 시계열 데이터가 필요합니다. 연구원은 훈련 데이터 세트를 생성하고 평가하는 데 많은 시간을 소비하며 두 가지 더 나은 방법을 찾았습니다. :

합성 데이터는 기본에 도움이 됩니다

통계 모델이나 물리적 시뮬레이션을 사용하여 의미 있는 합성 시계열 데이터를 생성할 수 있습니다. 기본적으로 시간 패턴은 모델이 시계열 예측의 문법을 학습하도록 안내할 수 있습니다.

실제 데이터가 실제 세계의 풍미를 더합니다.

연구원들은 사용 가능한 공개 시계열 데이터 세트를 샅샅이 뒤져 선택적으로 결합하여 1,000억 개의 대규모 시점 코퍼스를 통합했습니다.

데이터세트에는 Google Trends 및 Wikipedia의 페이지 뷰가 있는데, 이는 사용자가 무엇에 관심을 갖고 있는지 추적하고 다른 많은 실제 시계열의 추세와 패턴을 잘 반영하여 TimesFM이 더 큰 그림을 이해할 수 있도록 도와줍니다. "훈련 중에 표시되지 않는 도메인별 컨텍스트"에 대한 일반화 성능을 향상시킵니다.

제로 샘플 평가 결과

연구원들은 일반적으로 사용되는 시계열 벤치마크를 사용하여 훈련 중에 보이지 않는 데이터에 대해 TimesFM의 제로 샘플 평가를 수행한 결과 TimesFM이 ARIMA, ETS, 대상 시계열에 대해 명시적으로 훈련된 DeepAR, PatchTST와 같은 강력한 DL 모델과 일치하거나 그보다 뛰어난 성능을 발휘할 수 있습니다.

연구원들은 Monash Forecasting Archive를 사용하여 교통, 날씨 및 수요 예측과 같은 다양한 영역의 수만 개의 시계열을 포함하고 분 단위의 주파수를 포함하는 데이터 세트인 TimesFM의 기본 성능을 평가했습니다. 연간 데이터로.

기존 문헌을 기반으로 연구원들은 데이터 세트에 대해 평균으로 적절하게 조정된 평균 절대 오차(MAE)를 조사했습니다.

보시다시피 ZS(Zero-Shot) TimesFM은 최신 딥 러닝 모델을 포함하여 대부분의 지도 방법보다 성능이 뛰어납니다. 또한 llmtime(ZS)이 제안한 특정 힌트 기술을 사용한 예측을 위해 TimesFM과 GPT-3.5를 비교한 결과, TimesFM이 llmtime(ZS)보다 더 나은 성능을 보인 것으로 나타났습니다.

) 다른 지도 및 제로 샷 방법에 대한 MAE 비율(낮을수록 좋음)

대부분의 Monash 데이터세트는 단기 또는 중기 데이터이므로 예측 길이가 너무 길지 않다는 의미입니다. 장기 예측을 위한 벤치마크는 최첨단 기준인 PatchTST(및 기타 장기 예측 기준)입니다.

연구원들은 미래의 96개 및 192개 시점을 예측하는 작업을 위해 ETT 데이터세트에 MAE를 플롯하고 각 데이터세트의 마지막 테스트 창에서 측정항목을 계산했습니다.

TimesFM(ZS) 대 llmtime(ZS)의 마지막 창 MAE(낮을수록 좋음) 및 ETT 데이터 세트의 장기 예측 기준

볼 수 있듯이 TimesFM은 llmtime(ZS)을 초과할 뿐만 아니라 ) 해당 데이터세트에 대해 명시적으로 훈련된 지도 PatchTST 모델과 일치합니다.

결론

연구원들은 1,000억 개의 실제 시점으로 구성된 대규모 사전 훈련 코퍼스를 사용하여 기본 디코더 전용 모델을 훈련했습니다. 그 중 대부분은 Google 트렌드의 검색 관심도 시계열 데이터와 Wikipedia Views의 페이지였습니다.

결과에 따르면 TimesFM 아키텍처를 사용하는 비교적 작은 200M 매개변수 사전 학습 모델도 다양한 공개 벤치마크(다양한 도메인 및 세부 수준)에서 상당히 우수한 제로샷 성능을 나타냅니다.

위 내용은 2억 개의 매개변수만으로 제로 샘플 성능이 지도를 능가합니다! Google, 기본 시계열 예측 모델 TimesFM 출시의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

AI 우주 회사가 탄생했습니다May 12, 2025 am 11:07 AM

AI 우주 회사가 탄생했습니다May 12, 2025 am 11:07 AM이 기사는 AI가 Tomorrow.io를 사용하여 우주 산업에 혁명을 일으키는 방법을 보여줍니다. Core에서 AI로 제작되지 않은 SpaceX와 같은 기존의 우주 회사와 달리 Tomorrow.io는 AI- 기업입니다. 탐험합시다

인도의 기계 학습 인턴쉽 10 (2025)May 12, 2025 am 10:47 AM

인도의 기계 학습 인턴쉽 10 (2025)May 12, 2025 am 10:47 AM인도에 꿈의 기계 학습 인턴쉽을 착륙 시키십시오 (2025)! 학생과 초기 전문가에게는 기계 학습 인턴쉽이 보람있는 경력을위한 완벽한 런치 패드입니다. 최첨단 제나에서 다양한 부문의 인도 기업

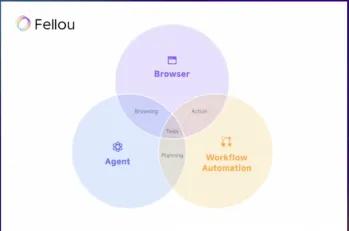

Fellou ai를 시도하고 Google 및 Chatgpt에 작별 인사May 12, 2025 am 10:26 AM

Fellou ai를 시도하고 Google 및 Chatgpt에 작별 인사May 12, 2025 am 10:26 AM온라인 브라우징의 환경은 작년에 상당한 변화를 겪었습니다. 이러한 변화는 Perplexity 및 Copilot과 같은 플랫폼의 향상된 개인 검색 결과로 시작되었으며 Chatgpt의 Web S 통합으로 가속화되었습니다.

개인 해킹은 꽤 치열한 곰이 될 것입니다May 11, 2025 am 11:09 AM

개인 해킹은 꽤 치열한 곰이 될 것입니다May 11, 2025 am 11:09 AM사이버 공격이 발전하고 있습니다. 일반 피싱 이메일의 시대는 지났습니다. 사이버 범죄의 미래는 과인간화되어 온라인 데이터와 AI를 활용하여 고도로 표적화 된 공격을 만들어냅니다. 당신의 직업을 아는 사기꾼을 상상해보십시오. f

교황 레오 XIVMay 11, 2025 am 11:07 AM

교황 레오 XIVMay 11, 2025 am 11:07 AM시카고 출신의 로버트 프랜시스 프레 보스 (Robert Francis Prevost)는 카디널스 대학 (Cardinals) 대학의 첫 연설에서 새로 선출 된 교황 레오 14 세는 교황 (1878-1903)이 자동차의 새벽과 일치하는 교황 레오 XIII의 영향에 대해 논의했다.

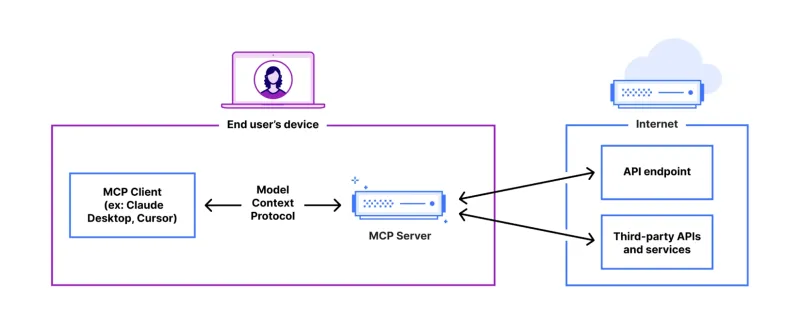

초보자 및 전문가를위한 Fastapi -MCP 튜토리얼 - 분석 VidhyaMay 11, 2025 am 10:56 AM

초보자 및 전문가를위한 Fastapi -MCP 튜토리얼 - 분석 VidhyaMay 11, 2025 am 10:56 AM이 튜토리얼은 MCP (Model Context Protocol) 및 Fastapi를 사용하여 LLM (Large Language Model)을 외부 도구와 통합하는 방법을 보여줍니다. Fastapi를 사용하여 간단한 웹 응용 프로그램을 구축하고이를 MCP 서버로 변환하여 L을 활성화합니다.

DIA-1.6B TTS : 최고의 텍스트-다이얼그 생성 모델-분석 VidhyaMay 11, 2025 am 10:27 AM

DIA-1.6B TTS : 최고의 텍스트-다이얼그 생성 모델-분석 VidhyaMay 11, 2025 am 10:27 AMDIA-1.6B : 자금이없는 두 명의 학부생이 개발 한 획기적인 텍스트 음성 연설 모델을 탐색하십시오! 이 16 억 개의 매개 변수 모델은 웃음과 재채기와 같은 비언어적 신호를 포함하여 현저하게 현실적인 연설을 생성합니다. 이 기사 안내서

AI가 멘토링을 그 어느 때보 다 의미있게 만들 수있는 3 가지 방법May 10, 2025 am 11:17 AM

AI가 멘토링을 그 어느 때보 다 의미있게 만들 수있는 3 가지 방법May 10, 2025 am 11:17 AM나는 진심으로 동의합니다. 나의 성공은 멘토의지도와 불가분의 관계입니다. 특히 비즈니스 관리에 관한 그들의 통찰력은 나의 믿음과 관행의 기반을 형성했습니다. 이 경험은 멘토에 대한 나의 약속을 강조합니다

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

VSCode Windows 64비트 다운로드

Microsoft에서 출시한 강력한 무료 IDE 편집기

mPDF

mPDF는 UTF-8로 인코딩된 HTML에서 PDF 파일을 생성할 수 있는 PHP 라이브러리입니다. 원저자인 Ian Back은 자신의 웹 사이트에서 "즉시" PDF 파일을 출력하고 다양한 언어를 처리하기 위해 mPDF를 작성했습니다. HTML2FPDF와 같은 원본 스크립트보다 유니코드 글꼴을 사용할 때 속도가 느리고 더 큰 파일을 생성하지만 CSS 스타일 등을 지원하고 많은 개선 사항이 있습니다. RTL(아랍어, 히브리어), CJK(중국어, 일본어, 한국어)를 포함한 거의 모든 언어를 지원합니다. 중첩된 블록 수준 요소(예: P, DIV)를 지원합니다.

맨티스BT

Mantis는 제품 결함 추적을 돕기 위해 설계된 배포하기 쉬운 웹 기반 결함 추적 도구입니다. PHP, MySQL 및 웹 서버가 필요합니다. 데모 및 호스팅 서비스를 확인해 보세요.

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

Eclipse용 SAP NetWeaver 서버 어댑터

Eclipse를 SAP NetWeaver 애플리케이션 서버와 통합합니다.