'그래프 기반 모델'의 3대 문제점을 최초로 극복했습니다! HKU 오픈 소스 OpenGraph: 제로 샘플 학습은 다양한 다운스트림 작업에 적응합니다.

그래프 학습 기술은 추천 시스템, 소셜 네트워크 분석, 인용 네트워크, 교통 네트워크 등 다양한 분야에서 널리 사용되고 있습니다. 이 기술은 복잡한 관계형 데이터를 효율적으로 마이닝하고 학습할 수 있어 데이터 과학자와 엔지니어에게 강력한 도구를 제공합니다. 그래프 학습 알고리즘을 통해 데이터 간의 연관성과 연결을 더 잘 이해할 수 있으며, 이를 통해 데이터 뒤에 숨겨진 법칙과 패턴을 발견하는 데 도움이 됩니다. 실제 응용 분야에서 그래프 학습 기술은 반복적인 메시지 전달 메커니즘을 사용하여 보다 정확하고

그래프 신경망(GNN)을 구축하여 그래프 구조 데이터의 복잡한 고차 관계를 캡처하는 데 도움이 될 수 있습니다. 그래프 학습 애플리케이션.

일반적으로 이런 종류의 엔드투엔드 그래프 신경망은 더 나은 훈련 결과를 얻기 위해 주석이 달린 고품질 데이터가 많이 필요합니다.

최근 몇 년 동안 일부 연구에서는 다양한 자기 지도 학습 작업을 사용하여 레이블이 지정되지 않은 그래프에서 먼저 사전 훈련하는 그래프 모델의 사전 훈련 및 미세 조정(Pre-training and Fine-tuning) 모드를 제안했습니다. 그런 다음 레이블이 지정된 데이터에 대해 소량의 미세 조정을 수행하여 감독 신호가 부족한 문제를 해결합니다. 여기서 자기 지도 학습 작업에는 대조 학습, 마스크 재구성, 로컬 및 글로벌 상호 정보 극대화와 같은 방법이 포함됩니다.

이러한 사전 훈련 방법은 어느 정도 성공하더라도 일반화 기능에 특정 제한이 있습니다. 특히 사전 훈련과 다운스트림 작업 간에 분포 이동이 발생할 때 더욱 그렇습니다.

추천 시스템에서 사전 학습된 모델은 초기 데이터를 기반으로 학습되지만 사용자 선호도와 제품 인기도는 자주 변하므로 새로운 정보에 적응하기 위해 모델을 지속적으로 업데이트해야 합니다.

이 문제를 해결하기 위해 최근 연구에서는 사전 훈련된 모델이 다양한 다운스트림 작업 및 데이터에 더 효과적으로 적응할 수 있도록 그래프 모델에 대한 힌트 미세 조정 방법을 제안했습니다.

위의 연구는 그래프 신경망 모델의 일반화 성능을 촉진했지만 이러한 모델은 가정을 기반으로 합니다. 학습 데이터와 테스트 데이터는 동일한 노드 세트와 특징 공간을 갖습니다.

이로 인해 사전 훈련된 그래프 모델의 적용 범위가 크게 제한됩니다. 따라서 이 기사에서는 그래픽 모델의 일반화 능력을 더욱 향상시키는 방법을 탐구합니다.

우리는 OpenGraph가 일반적인 토폴로지 구조 패턴을 포착하고 테스트 데이터에 대한 제로샷 예측을 달성할 것으로 기대합니다. 이는 순방향 전파 과정을 통해 특징을 효율적으로 추출하고 테스트 그래프 데이터를 정확하게 예측할 수 있음을 의미합니다.

모델의 훈련 과정은 완전히 다른 그래프 데이터에서 수행되며, 훈련 단계에서는 노드, 가장자리, 특징 벡터를 포함한 테스트 그래프의 어떤 요소도 건드리지 않습니다.

이 목표를 달성하려면 이 문서에서는 다음 세 가지 문제를 해결해야 합니다.

C1. 데이터 세트 전반에 걸친 토큰 세트 변경

제로 샘플 그래프 예측의 상당한 어려움 작업은 서로 다른 그래프 데이터가 일반적으로 완전히 다른 그래프 토큰 세트를 갖는다는 것입니다. 특히, 서로 다른 그래프의 노드 세트는 겹치지 않는 경우가 많으며, 서로 다른 그래프 데이터세트는 완전히 다른 노드 기능을 사용하는 경우가 많습니다. 이렇게 하면 모델이 특정 데이터세트의 그래프 토큰에 바인딩된 매개변수를 학습하여 데이터세트 간 예측 작업을 수행하는 것을 방지할 수 있습니다.

C2. 효율적인 노드 간 관계 모델링

그래프 학습 분야에서는 노드 간에 복잡한 종속성이 있는 경우가 많으며, 모델은 노드의 로컬 및 전역 이웃 관계를 종합적으로 고려해야 합니다. 일반 그래프 모델을 구축할 때 중요한 작업은 노드 간의 관계를 효율적으로 모델링할 수 있는 것인데, 이는 대량의 그래프 데이터를 처리할 때 모델 효과와 확장성을 높일 수 있습니다.

C3. 훈련 데이터의 부족

개인 정보 보호, 데이터 수집 비용 및 기타 이유로 인해 데이터 부족 문제는 그래프 학습의 많은 다운스트림 분야에 널리 퍼져 있으며 이로 인해 일반 그래프 모델의 훈련이 부족하기 쉽습니다. 다운스트림 도메인에 대한 이해 부족으로 인해 특정 차선책 훈련 결과에 대한 지원이 부족합니다.

위 문제를 해결하기 위해 홍콩 대학의 연구자들은 제로샷 학습에 능숙하고 다양한 다운스트림 도메인 간에 전환 가능한 토폴로지 구조 패턴을 식별할 수 있는 모델인 OpenGraph를 제안했습니다.

문서 링크: https://arxiv.org/pdf/2403.01121.pdf

소스 코드 링크: https://github.com/HKUDS/OpenGraph

토폴로지 인식 생성 프로젝션 제안된 그래프 토크나이저는 챌린지 C1을 해결하여 통합 그래프 토큰을 생성합니다.

챌린지 C2를 해결하기 위해 확장 가능한 그래프 Transformer가 설계되었습니다. 이 Transformer는 앵커 샘플링을 기반으로 하는 효율적인 self-attention 메커니즘을 갖추고 토큰 시퀀스 샘플링을 포함하여 보다 효율적인 교육을 달성합니다.

C3 과제를 해결하기 위해 우리는 힌트 트리 알고리즘과 Gibbs 샘플링을 사용하여 실제 그래프 구조의 관계형 데이터를 시뮬레이션함으로써 데이터 증강을 위한 대규모 언어 모델을 활용하여 사전 학습을 강화합니다. 여러 그래프 데이터 세트에 대한 광범위한 테스트는 다양한 설정에서 OpenGraph의 뛰어난 일반화 기능을 보여줍니다.

모델 소개

전체 모델 아키텍처는 아래 그림에 표시되어 있으며, 이는 1) 통합 그래프 토크나이저, 2) 확장 가능한 그래프 변환기, 3) 대규모 언어 모델 지식 증류의 세 부분으로 나눌 수 있습니다. .

통합 그래프 토크나이저

다양한 데이터 세트의 노드, 에지 및 기능의 큰 차이에 대처하기 위해 우리의 첫 번째 작업은 통합 그래프를 구축하는 것입니다. 다양한 그래프 데이터를 통합된 토큰 시퀀스로 효과적으로 매핑할 수 있는 토크나이저. 토크나이저에서 각 토큰에는 해당 노드의 정보를 설명하는 의미 벡터가 있습니다.

통일된 노드 표현 공간과 유연한 시퀀스 데이터 구조를 채택하여 다양한 그래프 데이터에 대해 표준화되고 효율적인 토큰화를 수행하고자 합니다.

이 목표를 달성하기 위해 우리의 토크나이저는 매끄러운 토폴로지 정보와 노드 공간에서 잠재 표현 공간으로의 매핑 기능을 사용합니다.

고차 평활 인접 행렬

그래프 토큰화 과정에서는 인접 행렬의 고차 거듭제곱이 입력 중 하나로 사용됩니다. 이 방법은 높은 차수를 얻을 수 있을 뿐만 아니라 그래프 구조의 연결 관계를 정렬할 뿐만 아니라 원래 인접 행렬의 연결 희소성 문제도 해결합니다.

계산 과정에서 라플라시안 정규화가 수행되며, 다양한 차수의 모든 인접 행렬 거듭제곱이 고려됩니다. 구체적인 계산 방법은 다음과 같습니다.

임의 그래프의 토폴로지 인식 매핑

다양한 데이터 세트의 인접 행렬은 차원에서 큰 차이가 있기 때문에 인접 행렬을 입력으로 직접 취한 다음 고정 입력을 사용할 수 없습니다. 차원 신경망 처리.

저희 솔루션은 먼저 인접 행렬을 노드 표현 시퀀스의 형태로 투영한 다음 가변 길이 시퀀스 모델을 사용하여 처리하는 것입니다. 매핑 과정에서 정보 손실을 줄이기 위해 위상 인식 매핑 방법을 제안합니다.

우선, 토폴로지 인식 매핑의 값 범위는 고차원 잠재 표현 공간입니다. 일부 이전 연구에서는 더 큰 잠재 공간 차원을 채택할 때 무작위 매핑조차도 종종 만족스러운 표현을 생성할 수 있다고 지적했습니다.

그래프 구조 정보를 더욱 보존하고 무작위성의 영향을 줄이기 위해 빠른 고유값 분해(SVD)를 사용하여 매핑 기능을 구성합니다. 실제 실험에서는 두 번의 빠른 고유값 분해를 통해 위상 정보를 효과적으로 유지할 수 있으며 결과적인 계산 오버헤드는 다른 모듈에 비해 무시할 수 있습니다.

Scalable Graph Transformer

매개변수가 없는 그래프 토큰화 프로세스 후 OpenGraph는 다양한 특성을 가진 그래프 데이터에 통합 토폴로지 인식 그래프 토큰 표현을 할당합니다. 다음 작업은 훈련 가능한 신경망을 사용하여 노드 간의 복잡한 종속성을 모델링하는 것입니다.

OpenGraph는 복잡한 관계를 모델링하는 강력한 기능을 활용하기 위해 변환기 아키텍처를 채택합니다. 모델 효율성과 성능을 보장하기 위해 다음 두 가지 샘플링 기술을 소개합니다.

토큰 시퀀스 샘플링

그래프 토큰 시퀀스 데이터에는 일반적으로 많은 수의 토큰과 숨겨진 표현 차원이 있으므로 OpenGraph에서 사용하는 그래프 변환기는 입력 토큰 시퀀스를 샘플링하고 현재 교육 배치만 학습합니다. 시간 내 토큰 간의 쌍 관계는 노드 수의 제곱에서 훈련 배치 크기의 제곱으로 모델링해야 하는 관계 쌍의 수를 줄여 훈련에서 그래프 변환기의 시간 및 공간 오버헤드를 크게 줄입니다. 단계. 또한 이 샘플링 방법을 사용하면 모델이 훈련할 때 현재 훈련 배치에 더 많은 주의를 기울일 수 있습니다.

입력 데이터가 샘플링되었지만 초기 그래프 토큰 표현에는 노드 간의 위상 관계가 포함되어 있으므로 샘플링된 토큰 시퀀스는 여전히 전체 그래프의 모든 노드 정보를 어느 정도 반영할 수 있습니다.

self-attention의 앵커 샘플링 방법

토큰 시퀀스 샘플링은 노드 수의 제곱에서 배치 크기의 제곱으로 복잡성을 줄이지만, 제곱 수준의 복잡성은 배치 크기의 제곱에 더 큰 영향을 미칩니다. 배치 크기 제한으로 인해 모델 훈련에 더 큰 배치를 사용할 수 없으므로 전체 훈련 시간과 훈련 안정성에 영향을 미칩니다.

이 문제를 완화하기 위해 OpenGraph의 변환기 부분은 모든 토큰 간의 쌍 관계 모델링을 포기하고 대신 일부 앵커 포인트를 샘플링하고 모든 노드 간의 관계 학습을 두 번 나눕니다.

대언어 모델 지식 증류

데이터 개인 정보 보호 및 기타 이유로 인해 일반 그래프 모델을 학습하기 위해 다양한 분야에서 데이터를 얻는 것은 매우 어렵습니다. LLM(Large Language Model)이 보여주는 놀라운 지식과 이해력을 느끼며, 그 힘을 활용하여 일반 그래프 모델 학습을 위한 다양한 그래프 구조의 데이터를 생성합니다.

저희가 설계한 데이터 확대 메커니즘을 통해 LLM 강화 그래프 데이터가 실제 그래프의 특성에 더욱 근접하게 되므로 증강 데이터의 관련성과 유용성이 향상됩니다.

LLM 기반 노드 생성

그래프를 생성할 때 초기 단계는 특정 애플리케이션 시나리오에 적합한 노드 세트를 생성하는 것입니다. 각 노드에는 후속 에지 생성 프로세스를 용이하게 하는 텍스트 기반 기능 설명이 있습니다.

그러나 실제 시나리오를 다룰 때는 노드 세트의 크기가 크기 때문에 이 작업이 특히 어려울 수 있습니다. 예를 들어, 전자상거래 플랫폼에서 그래프 데이터에는 수십억 개의 제품이 포함될 수 있습니다. 따라서 LLM을 효율적으로 활성화하여 많은 수의 노드를 생성하는 것이 중요한 과제가 됩니다.

위 문제를 해결하기 위해 우리는 일반 노드를 보다 세분화된 하위 범주로 지속적으로 나누는 전략을 채택합니다.

예를 들어 전자상거래 시나리오에서 제품 노드를 생성할 때 먼저 "Taobao와 같은 전자상거래 플랫폼에 있는 모든 제품의 하위 카테고리를 나열합니다."와 유사한 쿼리 프롬프트 LLM을 사용합니다. LLM은 "의류", "가정용 주방용품", "전자 제품"과 같은 하위 카테고리 목록으로 답변했습니다.

그런 다음 LLM에 각 하위 범주를 더욱 구체화하여 반복적인 분할 프로세스를 계속하도록 요청합니다. 이 프로세스는 "의류", "여성 의류", "스웨터", "주머니가 있는 스웨터" 및 "흰색 주머니가 있는 스웨터"라는 레이블이 있는 노드와 같이 실제 인스턴스와 유사한 노드가 있을 때까지 반복됩니다.

프롬프트 트리 알고리즘

노드를 하위 범주로 나누고 세분화된 엔터티를 생성하는 프로세스는 트리와 같은 구조를 따릅니다. 초기 일반 노드(예: "제품", "딥 러닝 논문")는 루트 역할을 하고 세분화된 엔터티는 리프 노드 역할을 합니다. 우리는 이러한 노드를 탐색하고 생성하기 위해 트리 힌트 전략을 채택합니다.

LLM 및 Gibbs 샘플링을 기반으로 한 Edge 생성

Edge를 생성하기 위해 위에서 생성된 노드 세트와 함께 Gibbs 샘플링 알고리즘을 사용합니다. 알고리즘은 무작위 샘플에서 시작하여 매번 반복되며, 현재 샘플을 기반으로 데이터 차원 중 하나를 변경하여 얻은 샘플이 샘플링됩니다.

이 알고리즘의 핵심은 현재 샘플의 조건에서 특정 데이터 차원이 변경되는 조건부 확률을 추정하는 것입니다. 우리는 노드 생성 시 획득한 텍스트 특징을 기반으로 LLM을 통한 확률 추정을 제안합니다.

에지의 집합 공간이 크기 때문에 LLM이 탐색하도록 함으로써 발생하는 막대한 오버헤드를 피하기 위해 먼저 LLM을 사용하여 노드 집합을 특성화한 다음 간단한 유사성 연산자를 사용하여 노드 집합 기반을 특성화합니다. 표현 벡터에 대해 그들 사이의 관계를 계산합니다. 위의 에지 생성 프레임워크 내에서 조정을 위해 다음 세 가지 중요한 기술도 채택합니다.

동적 확률 정규화

LLM 표현의 유사도는 [0, 1] 범위와 크게 다를 수 있으므로 샘플링에 더 적합한 확률 값을 얻기 위해 동적 확률 정규화를 사용합니다. 행동 양식.

이 방법은 샘플링 프로세스 중에 가장 최근의 T' 유사성 추정값을 동적으로 유지하고 해당 평균과 표준편차를 계산한 다음 최종적으로 현재 유사성 추정치를 평균 위아래 두 표준편차의 분포 범위에 매핑합니다. 결과적으로 확률 추정치는 대략 [0, 1]이 됩니다.

노드 지역성 소개

LLM 기반 엣지 생성 방법은 노드의 의미적 유사성을 기반으로 잠재적인 연결 관계를 효과적으로 결정할 수 있습니다.

그러나 실제 그래프에서 중요한 지역성 개념을 무시하면서 의미상 관련된 모든 노드 간에 너무 많은 연결을 생성하는 경향이 있습니다.

실제 세계에서 노드는 일반적으로 노드 하위 집합과 제한된 상호 작용만 하기 때문에 관련 노드의 하위 집합에 연결될 가능성이 더 높습니다. 이 중요한 속성을 모델링하기 위해 에지 생성 중에 지역성을 고려하는 방법이 도입되었습니다.

각 노드에는 지역성 지수가 무작위로 할당됩니다. 두 노드 간의 상호 작용 확률은 지역성 지수의 절대 차이 감쇠에 영향을 받습니다. 노드의 지역성 지수 차이가 클수록 감쇠가 심각해집니다. 될거야.

그래프 토폴로지 패턴 주입

생성된 그래프 데이터가 토폴로지 구조의 패턴과 더욱 일치하도록 하기 위해 첫 번째 그래프 생성 프로세스에서 수정된 노드 표현을 다시 생성합니다.

이 노드 표현은 간단한 그래프 컨볼루션 네트워크를 사용하여 초기 생성된 그래프에서 얻어집니다. 이는 그래프 구조 데이터의 분포 특성을 더 잘 따르고 그래프와 텍스트 공간 간의 분포 이동을 피할 수 있습니다. 마지막으로 수정된 노드 표현을 기반으로 다시 그래프 샘플링을 수행하여 최종 그래프 구조 데이터를 얻습니다.

실험 검증

실험에서는 OpenGraph 모델 훈련을 위해 LLM 기반으로 생성된 데이터 세트만 사용했으며 테스트 데이터 세트는 다양한 응용 시나리오의 실제 데이터 세트이며 노드 분류 및 체인을 포함합니다. 도로 예측 작업에는 두 가지 유형이 있습니다. 실험의 구체적인 설정은 다음과 같습니다.

0-shot 설정

OpenGraph의 제로 샘플 예측 능력을 검증하기 위해 생성된 학습 데이터 세트에 대해 OpenGraph를 테스트한 후 전혀 다른 실제 테스트 데이터 세트를 사용하여 효과 테스트를 수행합니다. 노드, 모서리, 기능 및 레이블 측면에서 훈련 데이터 세트와 테스트 데이터 세트 사이에는 겹치는 부분이 없습니다.

Few-shot 설정

대부분의 기존 방법은 효과적인 제로샷 예측을 수행할 수 없기 때문에 우리는 Few-shot 예측을 사용하여 테스트합니다. 기본 방법은 사전 훈련 데이터로 사전 훈련된 다음 k-shot 샘플을 사용하여 미세 조정된 내용에 대해 훈련, 미세 조정 또는 힌트를 제공할 수 있습니다.

전체 효과 비교

2개의 Task와 총 8개의 테스트 데이터 세트에 대한 테스트 결과는 다음과 같습니다.

관찰할 수 있습니다:

1) 교차 데이터 세트의 경우 OpenGraph의 제로 샘플 예측 효과는 기존 방법보다 더 큰 이점을 갖습니다.

2) 교차 데이터 세트 마이그레이션의 경우 기존 사전 학습 방법은 몇 가지 샘플에 대해 처음부터 학습하는 기본 모델보다 더 나쁜 경우가 있습니다. 이는 교차 데이터를 얻는 그래프 모델의 능력을 반영합니다. 데이터 세트 일반화의 어려움.

그래프 토크나이저 연구

다음으로 이미지 토크나이저 디자인이 효과에 미치는 영향을 살펴보겠습니다. 먼저 인접 행렬 평활화 끝을 조정하고 그것이 효과에 미치는 영향을 테스트했습니다. 효과는 0차에서 심각하게 감쇠되는데, 이는 고차 평활화 사용의 중요성을 나타냅니다.

두 번째로, 토폴로지 인식 매핑 기능을 데이터 세트 전체의 학습 가능한 원-핫 ID 표현, 무작위 매핑, 노드 수준에 따른 학습 가능한 표현을 포함한 다른 간단한 방법으로 대체합니다.

결과는 세 가지 대안 모두 덜 효과적이라는 것을 보여줍니다. 그 중 데이터 세트 전체에 걸쳐 학습하는 id 표현 효과는 기존 작업에서 일반적으로 사용되는 정도 표현 효과도 크게 약화됩니다. 모든 대체 방법이 가장 잘 수행되지만 여전히 토폴로지 인식 매핑에 비해 훨씬 부족합니다.

사전 훈련 데이터 세트 연구

우리는 LLM 기반 지식 증류 방법의 효율성을 검증하기 위해 다양한 사전 훈련 데이터 세트를 사용하여 OpenGraph를 교육하고 다양한 테스트 세트에서 테스트합니다. 효과에.

이 실험에서 비교한 사전 학습 데이터 세트에는 생성 방법만으로 특정 트릭을 제거한 버전과 테스트 데이터 세트와 관련이 없는 두 개의 실제 데이터 세트인 Yelp2018 및 Gowalla, ML과 관련된 데이터 세트가 포함되어 있습니다. 10M 데이터 세트는 결과에서 확인할 수 있습니다.

1) 전반적으로 생성된 데이터 세트는 모든 테스트 데이터에서 더 나은 결과를 생성할 수 있습니다.

2) 테스트한 3세대 기술 모두 상당한 개선 효과가 있습니다.

3) 학습에 실제 데이터 세트(Yelp, Gowalla)를 사용하면 부정적인 영향을 미칠 수 있으며, 이는 서로 다른 실제 데이터 세트 간의 분포 차이로 인해 발생할 수 있습니다.

4) ML-10M은 ML-1M과 ML-10M 모두에서 가장 좋은 결과를 얻었으며, 이는 유사한 훈련 데이터 세트를 사용하면 더 나은 결과를 얻을 수 있음을 보여줍니다.

Transformer의 샘플링 기술에 대한 연구

이 실험은 그래프 변환기 모듈에서 토큰 시퀀스 샘플링(Seq) 및 앵커 샘플링(Anc)에 대한 절제 테스트를 수행했습니다.

결과는 두 가지 샘플링 방법이 훈련 및 테스트 프로세스 중에 모델의 공간 및 시간 오버헤드를 최적화할 수 있음을 보여줍니다. 효과 측면에서 토큰 시퀀스 샘플링은 모델 효과에 긍정적인 영향을 미치는 반면, ddi 데이터 세트의 결과는 앵커 접시 샘플링이 모델 효과에 부정적인 영향을 미치는 것으로 나타났습니다.

결론

이 연구의 주요 초점은 다양한 그래프 구조에서 복잡한 토폴로지 패턴을 정확하게 포착하고 이해할 수 있는 적응성이 뛰어난 프레임워크를 개발하는 것입니다.

제안된 모델의 잠재력을 활용하여 다양한 다운스트림 애플리케이션을 포함한 제로샷 그래프 학습 작업에서 잘 수행될 수 있도록 모델의 일반화 능력을 크게 향상시키는 것을 목표로 합니다.

OpenGraph의 효율성과 견고성을 더욱 향상시키기 위해 확장 가능한 그래프 변환기 아키텍처와 LLM 기반 데이터 증대 메커니즘을 기반으로 모델을 구축했습니다.

여러 벤치마크 데이터 세트에 대한 광범위한 실험을 통해 모델의 뛰어난 일반화 기능을 검증합니다. 본 연구에서는 그래프 기반 모델의 방향으로 사전 탐색을 시도한다.

향후 작업에서 우리는 다양한 그래프에 대한 일반적이고 전환 가능한 구조 패턴을 학습하면서 반사실적 학습 영향으로 시끄러운 연결과 구조를 자동으로 발견할 수 있도록 프레임워크를 강화할 계획입니다.

위 내용은 '그래프 기반 모델'의 3대 문제점을 최초로 극복했습니다! HKU 오픈 소스 OpenGraph: 제로 샘플 학습은 다양한 다운스트림 작업에 적응합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

하나의 프롬프트는 모든 주요 LLM의 보호 조치를 우회 할 수 있습니다Apr 25, 2025 am 11:16 AM

하나의 프롬프트는 모든 주요 LLM의 보호 조치를 우회 할 수 있습니다Apr 25, 2025 am 11:16 AMHiddenlayer의 획기적인 연구는 LLMS (Leading Lange Language Models)에서 중요한 취약점을 드러냅니다. 그들의 연구 결과는 "정책 인형극"이라는 보편적 인 바이 패스 기술을 보여줍니다.

5 가지 실수 대부분의 기업은 올해 지속 가능성으로 만듭니다.Apr 25, 2025 am 11:15 AM

5 가지 실수 대부분의 기업은 올해 지속 가능성으로 만듭니다.Apr 25, 2025 am 11:15 AM환경 책임과 폐기물 감소에 대한 추진은 기본적으로 비즈니스 운영 방식을 바꾸는 것입니다. 이 혁신은 제품 개발, 제조 프로세스, 고객 관계, 파트너 선택 및 새로운 채택에 영향을 미칩니다.

H20 Chip Ban Jolts China AI 회사이지만 오랫동안 충격을 받기 위해 자랑했습니다.Apr 25, 2025 am 11:12 AM

H20 Chip Ban Jolts China AI 회사이지만 오랫동안 충격을 받기 위해 자랑했습니다.Apr 25, 2025 am 11:12 AMAdvanced AI 하드웨어에 대한 최근 제한은 AI 지배에 대한 확대 된 지정 학적 경쟁을 강조하여 중국의 외국 반도체 기술에 대한 의존도를 드러냅니다. 2024 년에 중국은 3,800 억 달러 상당의 반도체를 수입했습니다.

OpenAi가 Chrome을 구매하면 AI는 브라우저 전쟁을 지배 할 수 있습니다.Apr 25, 2025 am 11:11 AM

OpenAi가 Chrome을 구매하면 AI는 브라우저 전쟁을 지배 할 수 있습니다.Apr 25, 2025 am 11:11 AMGoogle의 Chrome의 잠재적 인 강제 매각은 기술 산업 내에서 강력한 논쟁을 불러 일으켰습니다. OpenAi가 65%의 글로벌 시장 점유율을 자랑하는 주요 브라우저를 인수 할 가능성은 TH의 미래에 대한 중요한 의문을 제기합니다.

AI가 소매 미디어의 고통을 해결할 수있는 방법Apr 25, 2025 am 11:10 AM

AI가 소매 미디어의 고통을 해결할 수있는 방법Apr 25, 2025 am 11:10 AM전반적인 광고 성장을 능가 함에도 불구하고 소매 미디어의 성장은 느려지고 있습니다. 이 성숙 단계는 생태계 조각화, 비용 상승, 측정 문제 및 통합 복잡성을 포함한 과제를 제시합니다. 그러나 인공 지능

'AI는 우리이고 우리보다 더 많아요'Apr 25, 2025 am 11:09 AM

'AI는 우리이고 우리보다 더 많아요'Apr 25, 2025 am 11:09 AM깜박 거리는 스크린 모음 속에서 정적으로 오래된 라디오가 딱딱합니다. 이 불안정한 전자 제품 더미, 쉽게 불안정하게, 몰입 형 전시회에서 6 개의 설치 중 하나 인 "The-Waste Land"의 핵심을 형성합니다.

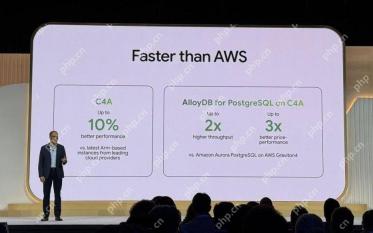

Google Cloud는 다음 2025 년 인프라에 대해 더 진지하게 생각합니다.Apr 25, 2025 am 11:08 AM

Google Cloud는 다음 2025 년 인프라에 대해 더 진지하게 생각합니다.Apr 25, 2025 am 11:08 AMGoogle Cloud의 다음 2025 : 인프라, 연결 및 AI에 대한 초점 Google Cloud의 다음 2025 회의는 수많은 발전을 선보였으며 여기에서 자세히 설명하기에는 너무 많았습니다. 특정 공지 사항에 대한 심도있는 분석은 My의 기사를 참조하십시오.

Talking Baby ai Meme, Arcana의 550 만 달러 AI 영화 파이프 라인, IR의 비밀 후원자 공개Apr 25, 2025 am 11:07 AM

Talking Baby ai Meme, Arcana의 550 만 달러 AI 영화 파이프 라인, IR의 비밀 후원자 공개Apr 25, 2025 am 11:07 AM이번 주 AI 및 XR : AI 구동 창의성의 물결은 음악 세대에서 영화 제작에 이르기까지 미디어와 엔터테인먼트를 통해 휩쓸고 있습니다. 헤드 라인으로 뛰어 들자. AI 생성 콘텐츠의 영향력 증가 : 기술 컨설턴트 인 Shelly Palme

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

SublimeText3 영어 버전

권장 사항: Win 버전, 코드 프롬프트 지원!

VSCode Windows 64비트 다운로드

Microsoft에서 출시한 강력한 무료 IDE 편집기

PhpStorm 맥 버전

최신(2018.2.1) 전문 PHP 통합 개발 도구

WebStorm Mac 버전

유용한 JavaScript 개발 도구

드림위버 CS6

시각적 웹 개발 도구