AI 짧은 비디오를 사용하여 긴 비디오 이해를 '피드백'하는 Tencent의 MovieLLM 프레임워크는 영화 수준의 연속 프레임 생성을 목표로 합니다.

- PHPz앞으로

- 2024-03-11 13:10:10474검색

영상 이해 분야에서는 멀티 모달 모델이 짧은 영상 분석에서 획기적인 성과를 거두고 강력한 이해 능력을 보여주었지만, 영화 수준의 긴 영상을 마주하면 무력해 보입니다. 따라서 긴 영상에 대한 분석과 이해, 특히 몇 시간 분량의 영화 콘텐츠에 대한 이해는 오늘날 큰 과제가 되었습니다.

모델이 긴 동영상을 이해하기 어려운 이유는 주로 품질과 다양성에 결함이 있는 긴 동영상 데이터 리소스가 부족하기 때문입니다. 또한 이 데이터를 수집하고 라벨을 지정하려면 많은 작업이 필요합니다.

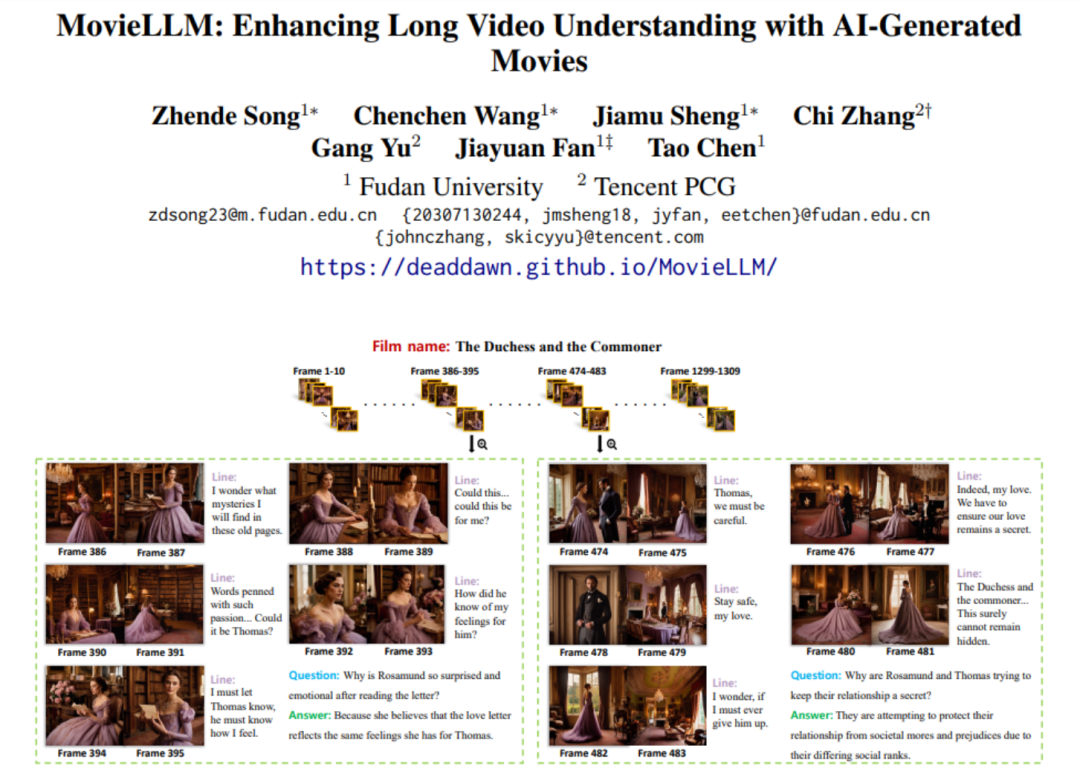

이러한 문제에 직면하여 Tencent와 Fudan University의 연구팀은 혁신적인 AI 생성 프레임워크인 MovieLLM을 제안했습니다. MovieLLM은 고품질의 다양한 비디오 데이터를 생성할 뿐만 아니라 수많은 관련 질문 및 답변 데이터 세트를 자동으로 생성하여 데이터의 차원과 깊이를 크게 풍부하게 하는 혁신적인 방법을 채택하고 있으며 전체 자동화 프로세스도 매우 뛰어납니다. Dadi는 인적 투자를 줄입니다.

- 논문 주소: https://arxiv.org/abs/2403.01422

- 홈 페이지 주소: https://deaddawn.github.io/MovieLLM/

이 중요한 발전은 복잡한 비디오 내러티브에 대한 모델의 이해를 향상시킬 뿐만 아니라 몇 시간 동안 지속되는 영화 콘텐츠를 처리할 때 모델의 분석 능력을 향상시킵니다. 동시에 기존 데이터 세트의 희소성과 편견의 한계를 극복하고 초장편 영상 콘텐츠를 이해하는 새롭고 효과적인 방법을 제공합니다.

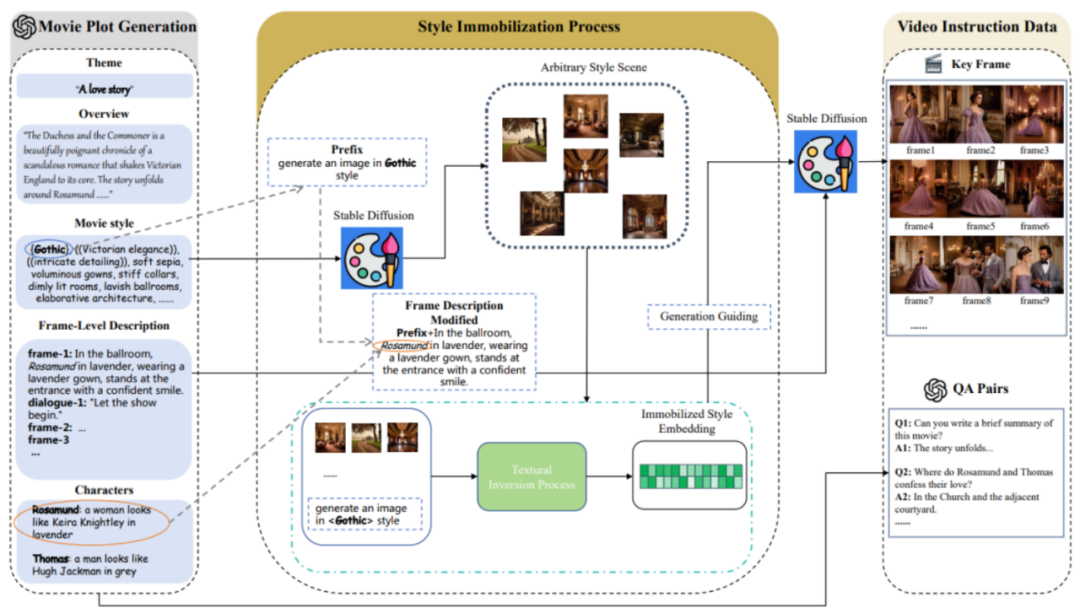

MovieLLM은 GPT-4 및 확산 모델의 강력한 생성 기능을 교묘하게 활용하고 "스토리 확장" 연속 프레임 설명 생성 전략을 채택합니다. "텍스트 반전" 방법은 확산 모델을 안내하여 텍스트 설명과 일치하는 장면 이미지를 생성함으로써 완전한 영화의 연속 프레임을 생성하는 데 사용됩니다.

방법 개요

MovieLLM은 GPT-4와 확산 모델을 결합하여 긴 비디오에 대한 대형 모델 이해도를 향상시킵니다. 이 영리한 조합은 고품질의 다양한 긴 비디오 데이터와 QA 질문 및 답변을 생성하여 모델의 생성 기능을 향상시키는 데 도움이 됩니다.

MovieLLM에는 주로 세 가지 단계가 포함됩니다.

1.

MovieLLM은 플롯을 생성하기 위해 웹이나 기존 데이터 세트에 의존하지 않고 대신 GPT-4의 기능을 완전히 활용하여 합성 데이터를 생성합니다. 테마, 개요, 스타일과 같은 특정 요소를 제공함으로써 GPT-4는 후속 세대 프로세스에 맞는 영화적 키프레임 설명을 생성하도록 안내됩니다.

2. 스타일 수정 과정.

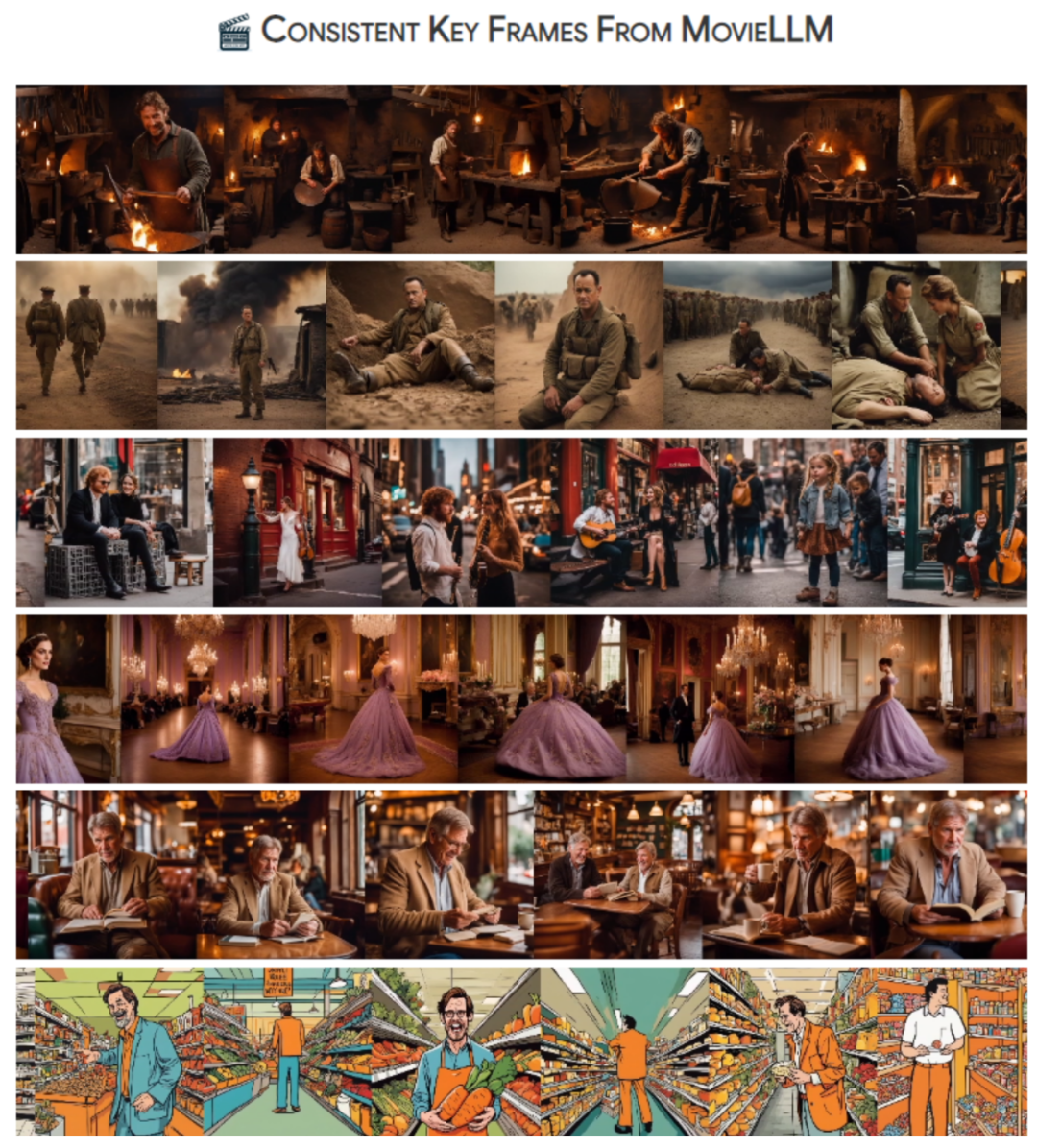

MovieLLM은 "텍스트 반전" 기술을 교묘하게 사용하여 스크립트에서 생성된 스타일 설명을 확산 모델의 잠재 공간에 고정합니다. 이 방법은 모델이 고정된 스타일로 장면을 생성하고 통일된 미학을 유지하면서 다양성을 유지하도록 안내합니다.

3. 비디오 명령 데이터 생성.

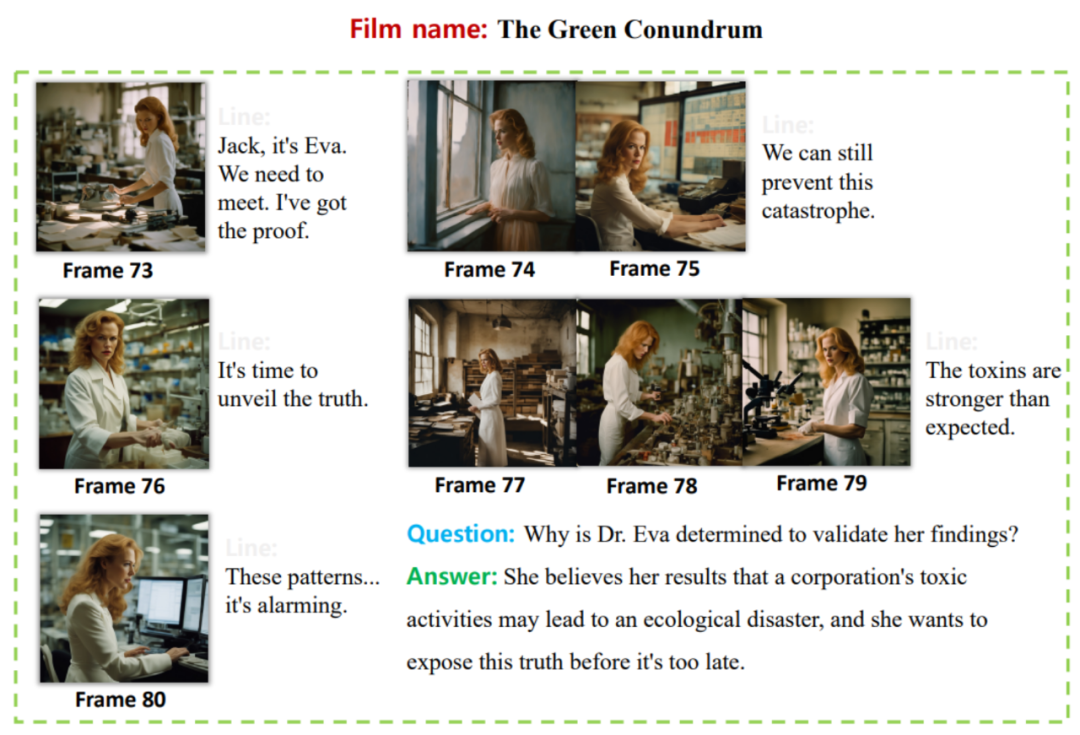

처음 두 단계를 기반으로 고정 스타일 임베딩 및 키프레임 설명을 얻었습니다. 이를 기반으로 MovieLLM은 스타일 임베딩을 사용하여 확산 모델을 안내하여 키 프레임 설명을 준수하는 키 프레임을 생성하고 영화 플롯에 따라 다양한 교육용 질문 및 답변 쌍을 점차적으로 생성합니다.

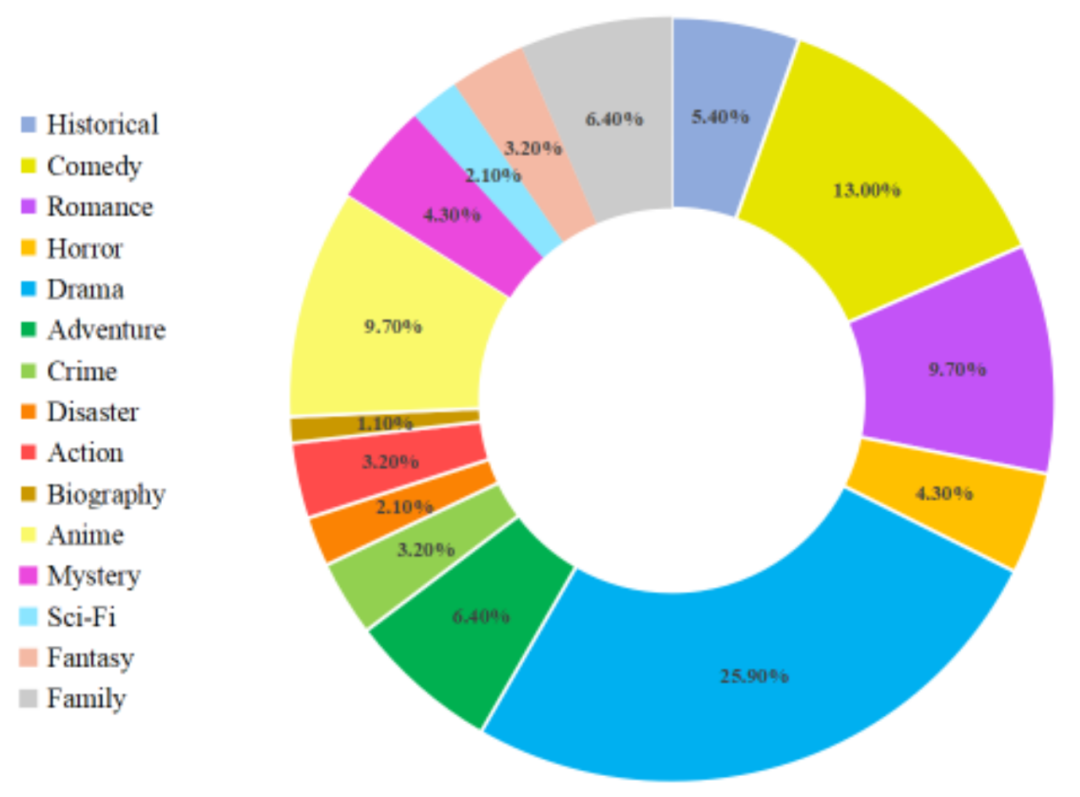

위 단계를 거친 후 MovieLLM은 고품질의 다양한 스타일, 일관된 영화 프레임 및 해당 질문 및 답변 쌍 데이터를 생성했습니다. 영화 데이터 유형의 세부 분포는 다음과 같습니다.

실험 결과

장편 영상 이해에 초점을 맞춘 대형 모델인 LLaMA-VID의 미세 조정을 위해 MovieLLM을 기반으로 구축된 데이터를 적용함으로써, 본 논문은 모델의 다양한 길이의 영상 콘텐츠 이해 능력을 크게 향상시켰습니다. 장편 영상 이해에 대해서는 현재 테스트 벤치마크를 제안하는 작업이 없으므로, 본 글에서는 장편 영상 이해 능력을 테스트하기 위한 벤치마크도 제안한다.

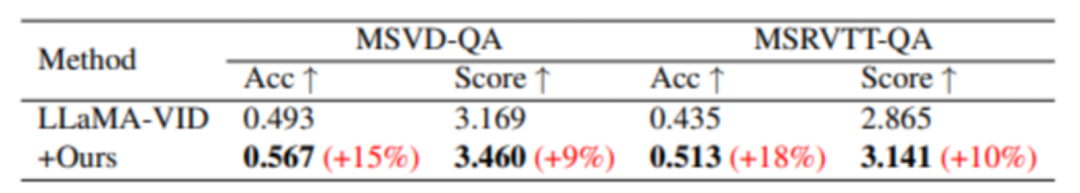

MovieLLM이 훈련을 위해 특별히 짧은 비디오 데이터를 구성하지는 않았지만 훈련을 통해 다양한 짧은 비디오 벤치마크에서 성능 향상이 관찰되었습니다.

MSVD-QA 및 MSRVTT와 비교. 기본 모델인 QA는 이 두 가지 테스트 데이터 세트에서 크게 향상되었습니다.

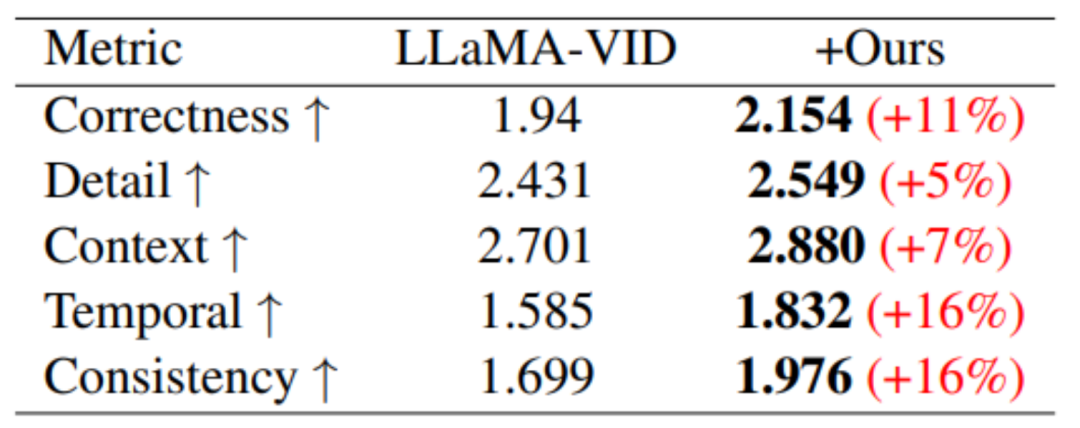

영상세대 기반 성능 벤치마크에서는 5개 평가 영역 모두에서 성능 향상이 이루어졌습니다.

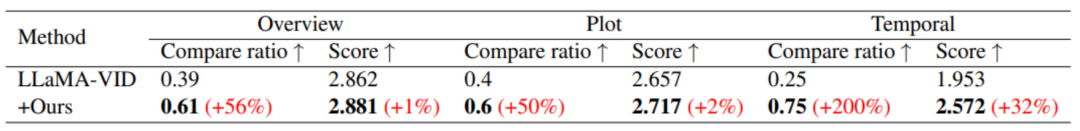

장편 영상 이해 측면에서 MovieLLM 학습을 통해 모델의 요약, 줄거리, 타이밍에 대한 이해도가 크게 향상되었습니다.

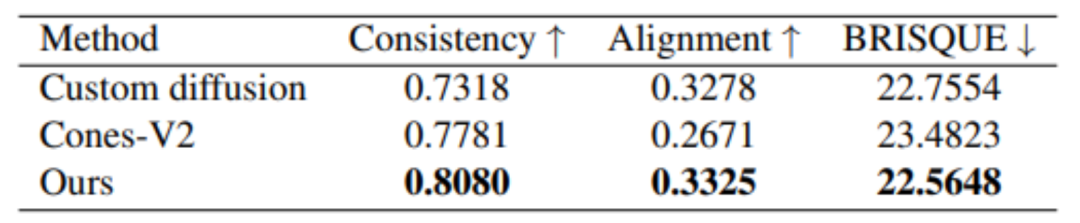

또한 MovieLLM은 다른 유사한 고정 스타일 이미지 생성 방법에 비해 생성 품질 측면에서도 더 나은 결과를 제공합니다.

요컨대 MovieLLM이 제안하는 데이터 생성 워크플로우는 모델을 위한 영화 수준의 비디오 데이터를 생성하는 과제를 크게 줄이고 생성된 콘텐츠의 제어 및 다양성을 향상시킵니다. 동시에 MovieLLM은 영화 수준의 긴 비디오를 이해하는 다중 모드 모델의 능력을 크게 향상시켜 다른 분야에서 유사한 데이터 생성 방법을 채택할 수 있는 귀중한 참고 자료를 제공합니다.

본 연구에 관심이 있는 독자들은 논문 원문을 읽고 연구 내용에 대해 더 자세히 알아볼 수 있습니다.

위 내용은 AI 짧은 비디오를 사용하여 긴 비디오 이해를 '피드백'하는 Tencent의 MovieLLM 프레임워크는 영화 수준의 연속 프레임 생성을 목표로 합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!