AMD Ryzen AI CPU 및 Radeon RX 7000 GPU는 이제 기본적으로 LLM 및 AI 챗봇 실행을 지원합니다.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2024-03-08 08:30:12794검색

3월 7일 이 사이트의 뉴스에 따르면 AMD는 오늘 사용자가 GPT 기반 LLM(대형 언어 모델)을 로컬에서 실행하여 전용 AI 챗봇을 구축할 수 있다고 발표했습니다.

AMD는 사용자가 AMD의 새로운 XDNA NPU로 구동되는 Ryzen 7000 및 Ryzen 8000 시리즈 APU와 AI 가속 코어가 내장된 Radeon RX 7000 시리즈 GPU 장치를 포함한 장치에서 기본적으로 LLM 및 AI 챗봇을 실행할 수 있다고 말합니다.

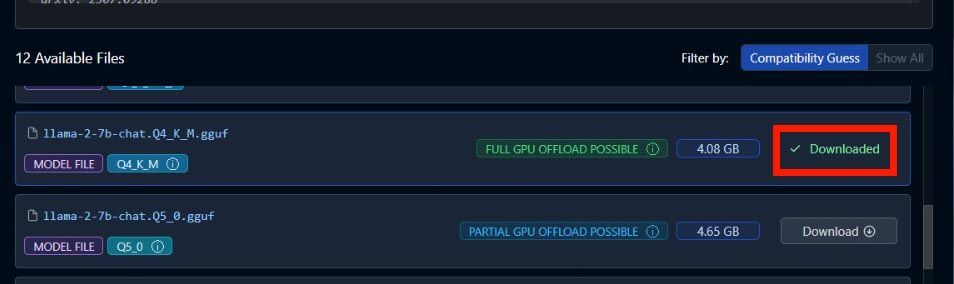

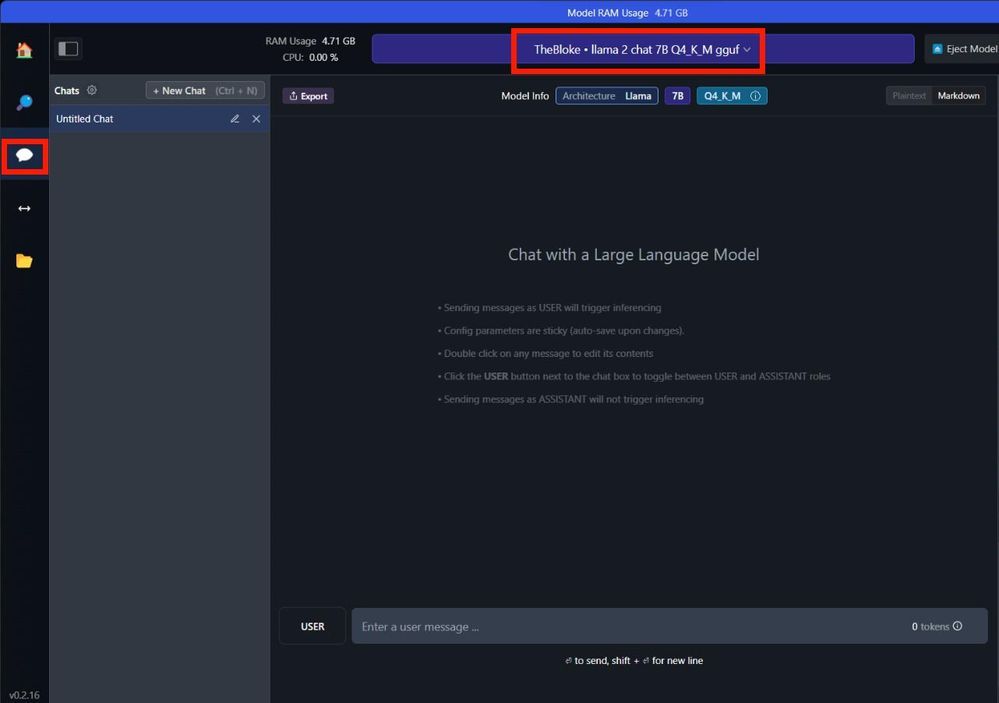

AMD는 발표에서 70억 개의 매개변수로 Mistral을 실행하고, 70억 개의 매개변수로 LLAMA v2를 실행하는 경우 "TheBloke / OpenHermes-2.5-Mistral-7B-GGUF"를 검색하고 다운로드하는 등의 실행 단계를 자세히 설명했습니다. , "TheBloke/Llama-2-7B-Chat-GGUF"를 검색하고 다운로드하세요.

AMD는 이 작업을 수행한 최초의 회사는 아니지만 NVIDIA는 최근 GeForce RTX 40 및 RTX 30 시리즈 GPU 인공 지능 챗봇이 지원되는 "Chat with RTX"를 출시했습니다. 현지화된 데이터 세트를 기반으로 신속하게 생성된 AI 결과를 제공하는 TensorRT-LLM 기능 세트로 가속화됩니다.

공고문의 원본 주소는 이 웹사이트에 첨부되어 있습니다. 관심 있는 사용자는 방문하여 읽어보실 수 있습니다.

위 내용은 AMD Ryzen AI CPU 및 Radeon RX 7000 GPU는 이제 기본적으로 LLM 및 AI 챗봇 실행을 지원합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!