Google의 새로운 방법인 ASPIRE: LLM 자체 채점 기능을 제공하고 '환상' 문제를 효과적으로 해결하며 볼륨 모델의 10배를 초과합니다.

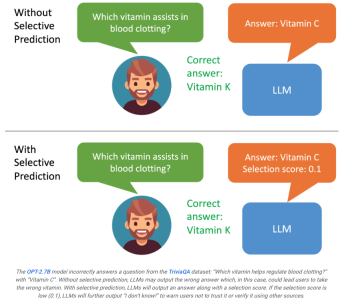

대형모델의 '환상' 문제 곧 해결될까?

University of Wisconsin-Madison의 연구원과 Google은 최근 대형 모델이 결과를 자체 평가할 수 있는 ASPIRE 시스템을 출시했습니다.

사용자가 모델이 생성한 결과의 점수가 낮다는 것을 알게 되면 해당 답변이 환상일 수 있음을 깨닫게 됩니다.

시스템이 평가 결과를 기반으로 출력 콘텐츠를 추가로 필터링할 수 있는 경우(예: 평가가 낮을 때) 대형 모델은 "이 질문에 답할 수 없습니다"와 같은 문을 생성할 수 있습니다. 환각 문제의 개선을 극대화합니다.

문서 주소: https://aclanthology.org/2023.findings-emnlp.345.pdf

ASPIRE를 사용하면 LLM이 답변과 답변의 신뢰도 점수를 출력할 수 있습니다.

연구원의 실험 결과에 따르면 ASPIRE는 다양한 QA 데이터 세트(예: CoQA 벤치마크)에서 기존의 선택적 예측 방법보다 훨씬 뛰어난 성능을 보였습니다.

LLM이 질문에 답변할 뿐만 아니라 답변을 평가하도록 하세요.

선택적 예측 벤치마크 테스트에서 연구진은 ASPIRE 시스템을 통해 모델 규모의 10배 이상의 결과를 달성했습니다.

학생들에게 교과서 뒷부분에 있는 답을 직접 확인하라고 하는 것과 같습니다. 비록 다소 신뢰할 수 없는 것처럼 들리지만, 곰곰이 생각해 보면 문제에 답한 후에는 모두가 정말로 만족할 것입니다. 등급이 있을 겁니다.

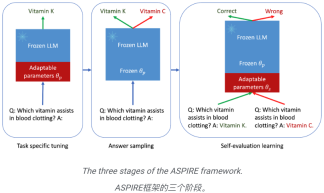

이것이 ASPIRE의 핵심이며 세 단계로 구성됩니다.

(1) 특정 작업에 대한 튜닝,

(2) 답변 샘플링,

( 3 ) 자기 평가 학습.

연구원의 눈에 ASPIRE는 단순한 또 다른 프레임워크가 아니라 LLM 신뢰성을 종합적으로 향상하고 환각을 줄이는 밝은 미래를 나타냅니다.

LLM이 의사결정 과정에서 신뢰할 수 있는 파트너가 될 수 있다면.

선택적 예측 능력을 계속해서 최적화하는 한, 인간은 대형 모델의 잠재력을 완전히 실현하는 데 한 걸음 더 다가갈 수 있습니다.

연구원들은 ASPIRE를 사용하여 차세대 LLM의 진화를 시작하여 더욱 안정적이고 자기 인식적인 인공 지능을 만들기를 희망합니다.

ASPIRE의 메커니즘

작업별 미세 조정

ASPIRE는 LLM을 동결하는 동안 적응형 매개변수 를 훈련하기 위해 작업별 미세 조정을 수행합니다.

를 훈련하기 위해 작업별 미세 조정을 수행합니다.

생성 작업을 위한 훈련 데이터세트가 주어지면 사전 훈련된 LLM을 미세 조정하여 예측 성능을 향상시킵니다.

이를 위해 매개변수 효율적인 미세 조정 기술(예: 소프트 큐 단어 미세 조정 및 LoRA)을 사용하여 작업에 대해 사전 훈련된 LLM을 미세 조정할 수 있습니다. 적은 수의 목표 데이터.

구체적으로 LLM 매개변수(θ)는 동결되고 미세 조정을 위해 적응형 매개변수 가 추가됩니다.

가 추가됩니다.

표준 LLM 훈련 손실(예: 교차 엔트로피)을 최소화하려면 θ(p)만 업데이트하세요.

이런 종류의 미세 조정은 예측 정확도를 향상시킬 뿐만 아니라 시퀀스를 올바르게 출력할 가능성도 높이기 때문에 선택적 예측 성능을 향상시킬 수 있습니다.

Answer Sampling

ASPIRE는 특정 작업에 맞춰 조정된 후 LLM을 사용하고  학습하여 각 교육 질문에 대해 서로 다른 답변을 생성하고 자체 평가 학습을 위한 데이터 세트를 만듭니다.

학습하여 각 교육 질문에 대해 서로 다른 답변을 생성하고 자체 평가 학습을 위한 데이터 세트를 만듭니다.

연구원의 목표는 가능성이 높은 출력 시퀀스를 생성하는 것입니다. 그들은 Beam Search를 디코딩 알고리즘으로 사용하여 가능성이 높은 출력 시퀀스를 생성하고 Rouge-L 메트릭을 사용하여 생성된 출력 시퀀스가 올바른지 확인했습니다.

자체 평가 학습

ASPIRE는 각 쿼리의 가능성이 높은 출력을 샘플링한 후 적응형 매개변수를 추가하고  미세 조정만

미세 조정만  하여 자체 평가를 학습합니다.

하여 자체 평가를 학습합니다.

출력 시퀀스 생성은 θ와  에만 의존하므로 θ와 학습된

에만 의존하므로 θ와 학습된  을 동결하면 자체 평가를 학습할 때 LLM의 예측 동작이 변경되는 것을 피할 수 있습니다.

을 동결하면 자체 평가를 학습할 때 LLM의 예측 동작이 변경되는 것을 피할 수 있습니다.

연구원들은 적응된 LLM이 정답과 오답을 스스로 구별할 수 있도록  최적화했습니다.

최적화했습니다.

이 프레임워크에서는 매개변수 효율적인 미세 조정 방법을 사용하여  및

및  을 훈련할 수 있습니다.

을 훈련할 수 있습니다.

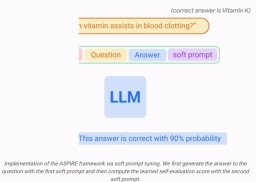

이 연구에서 연구원들은 특정 다운스트림 작업을 수행하기 위해 전통적인 개별 텍스트 단서보다 더 효과적으로 고정된 언어 모델을 조정하기 위해 "소프트 단서"를 학습하는 간단하면서도 효과적인 메커니즘인 소프트 단서 미세 조정을 사용합니다.

이 접근 방식의 핵심은 자기 평가를 효과적으로 자극하는 단서가 개발될 수 있다면 목표한 훈련 목표와 결합된 부드러운 단서의 미세 조정을 통해 이러한 단서를 발견할 수 있어야 한다는 인식입니다.

학습  및

및  후에 연구원들은 빔 검색 디코딩을 통해 쿼리에 대한 예측을 얻었습니다.

후에 연구원들은 빔 검색 디코딩을 통해 쿼리에 대한 예측을 얻었습니다.

그런 다음 연구자들은 답변을 생성할 가능성과 학습된 자체 평가 점수(즉, 쿼리에 대한 예측이 정확할 가능성)를 결합한 선택 점수를 정의하여 선택적인 예측을 합니다.

결과

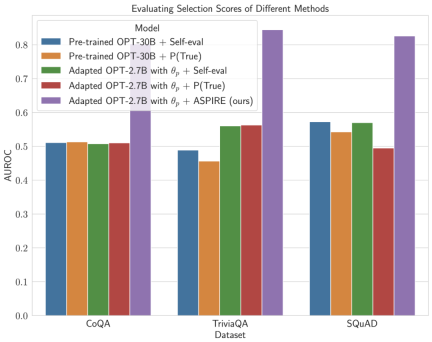

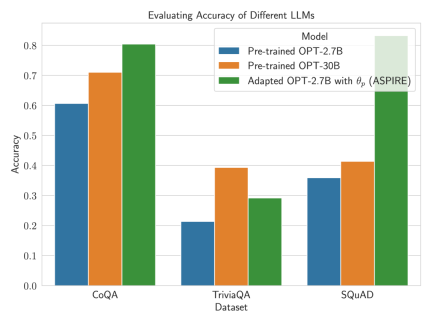

ASPIRE의 효과를 입증하기 위해 연구원들은 다양한 개방형 사전 훈련된 OPT(사전 훈련된 Transformer) 모델을 사용하여 세 가지 질문 답변 데이터 세트(CoQA, TriviaQA 및 SQuAD)에서 이를 평가했습니다.

소프트 큐를 사용하여 훈련을 조정함으로써 연구원들은 LLM 정확도가 크게 향상되는 것을 관찰했습니다.

연구원들은 LLM 정확도가 크게 향상되는 것을 관찰했습니다.

예를 들어 ASPIRE를 사용하는 OPT-2.7B 모델은 CoQA 및 SQuAD 데이터 세트를 사용하여 미리 훈련된 더 큰 OPT-30B 모델에 비해 더 나은 성능을 보여주었습니다.

이러한 결과는 적절한 조정을 통해 소규모 LLM이 경우에 따라 대규모 모델의 정확도와 일치하거나 이를 초과할 수 있음을 시사합니다.

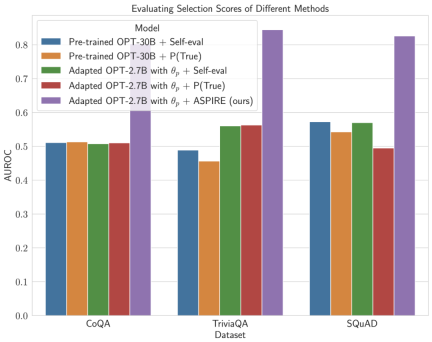

고정 모델 예측에 대한 선택 점수 계산을 자세히 살펴보면 ASPIRE는 모든 데이터 세트에 대해 기준 방법보다 더 높은 AUROC 점수를 달성했습니다(무작위로 선택한 올바른 출력 시퀀스는 무작위로 선택한 잘못된 출력 시퀀스보다 더 높은 값을 가짐). 선택 점수가 더 높을 확률).

예를 들어 CoQA 벤치마크에서 ASPIRE는 기준에 비해 AUROC를 51.3%에서 80.3%로 향상시킵니다.

TriviaQA 데이터 세트에 대한 평가에서 흥미로운 패턴이 나타났습니다.

사전 훈련된 OPT-30B 모델은 더 높은 기준 정확도를 나타내지만 전통적인 자체 평가 방법(자기 평가 및 P(True))을 적용하면 선택적 예측 성능이 크게 향상되지 않습니다.

반면 훨씬 작은 OPT-2.7B 모델은 ASPIRE로 강화된 이 점에서 다른 모델보다 성능이 뛰어납니다.

이 차이점은 중요한 문제를 구체화합니다. 전통적인 자체 평가 기술을 활용하는 대규모 LLM은 소규모 ASPIRE 강화 모델만큼 선택적 예측에 효과적이지 않을 수 있습니다.

연구원들의 ASPIRE 실험 여정은 LLM 환경의 주요 변화를 강조합니다. 언어 모델의 용량은 성능의 전부이자 끝이 아닙니다.

반면, 정책 조정을 통해 모델 효율성을 크게 향상할 수 있으므로 작은 모델에서도 더 정확하고 확실한 예측이 가능합니다.

따라서 ASPIRE는 자체 답변의 확실성을 현명하게 결정하고 선택적 예측 작업에서 크기가 10배인 다른 모델보다 훨씬 뛰어난 LLM의 잠재력을 보여줍니다.

위 내용은 Google의 새로운 방법인 ASPIRE: LLM 자체 채점 기능을 제공하고 '환상' 문제를 효과적으로 해결하며 볼륨 모델의 10배를 초과합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

10 GPT-4O 이미지 생성 프롬프트 오늘 시험해보십시오!Apr 24, 2025 am 10:26 AM

10 GPT-4O 이미지 생성 프롬프트 오늘 시험해보십시오!Apr 24, 2025 am 10:26 AMAI의 세계에서 절대적으로 거친 물건이 일어나고 있습니다. Openai의 기본 이미지 생성은 지금 미쳤다. 우리는 턱을 떨어 뜨리는 비주얼, 무서운 좋은 디테일 및 출력을 말하고 있습니다.

Windsurf와의 분위기 코딩 안내서Apr 24, 2025 am 10:25 AM

Windsurf와의 분위기 코딩 안내서Apr 24, 2025 am 10:25 AMCodeium 's Windsurf, AI 구동 코딩 동반자로 코딩 비전을 쉽게 가져 오십시오. Windsurf는 코딩 및 디버깅에서 최적화에 이르기까지 전체 소프트웨어 개발 수명주기를 간소화하여 프로세스를 Intu로 변환합니다.

RMGB v2.0을 사용하여 이미지 배경 제거 탐색Apr 24, 2025 am 10:20 AM

RMGB v2.0을 사용하여 이미지 배경 제거 탐색Apr 24, 2025 am 10:20 AMBraiai의 RMGB v2.0 : 강력한 오픈 소스 배경 제거 모델 이미지 세분화 모델은 다양한 필드에 혁명을 일으키고 있으며 배경 제거의 주요 영역입니다. Braiai의 RMGB v2.0

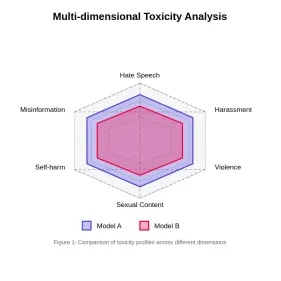

큰 언어 모델의 독성 평가Apr 24, 2025 am 10:14 AM

큰 언어 모델의 독성 평가Apr 24, 2025 am 10:14 AM이 기사는 대형 언어 모델 (LLM)에서 독성의 중요한 문제와이를 평가하고 완화하는 데 사용되는 방법을 탐구합니다. LLMS, 챗봇에서 콘텐츠 생성에 이르기까지 다양한 응용 프로그램을 구동하며 강력한 평가 지표, 재치가 필요합니다.

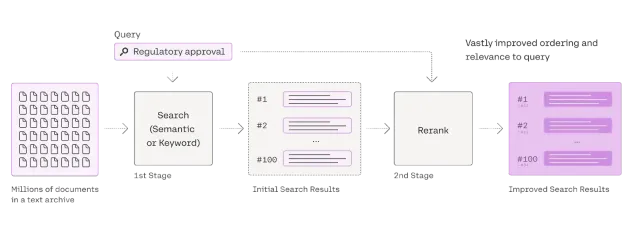

헝겊에 대한 재 랭커에 대한 포괄적 인 가이드Apr 24, 2025 am 10:10 AM

헝겊에 대한 재 랭커에 대한 포괄적 인 가이드Apr 24, 2025 am 10:10 AM검색 증강 생성 (RAG) 시스템은 정보 액세스를 변화시키고 있지만 그 효과는 검색된 데이터의 품질에 달려 있습니다. 이곳은 재창조자가 중요 해지는 곳입니다. 검색 결과를위한 품질 필터 역할을하여

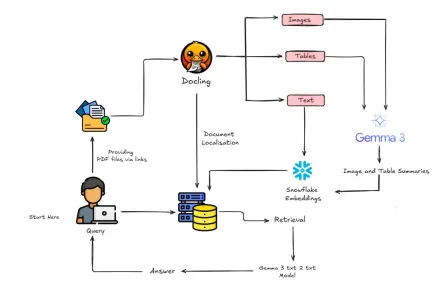

Gemma 3 & docling으로 멀티 모달 헝겊을 만드는 방법?Apr 24, 2025 am 10:04 AM

Gemma 3 & docling으로 멀티 모달 헝겊을 만드는 방법?Apr 24, 2025 am 10:04 AM이 튜토리얼은 Google Colab 내에서 정교한 멀티 모달 검색 세대 생성 (RAG) 파이프 라인을 구축함으로써 안내합니다. 우리는 Gemma 3 (언어 및 비전), docling (문서 변환), Langchain과 같은 최첨단 도구를 사용합니다.

확장 가능한 AI 및 기계 학습 응용 프로그램을위한 Ray 안내서Apr 24, 2025 am 10:01 AM

확장 가능한 AI 및 기계 학습 응용 프로그램을위한 Ray 안내서Apr 24, 2025 am 10:01 AMRay : AI 및 Python 응용 프로그램 스케일링을위한 강력한 프레임 워크 Ray는 AI 및 Python 응용 프로그램을 쉽게 확장하도록 설계된 혁신적인 오픈 소스 프레임 워크입니다. 직관적 인 API는 연구원과 개발자가 코드를 이용할 수 있도록합니다.

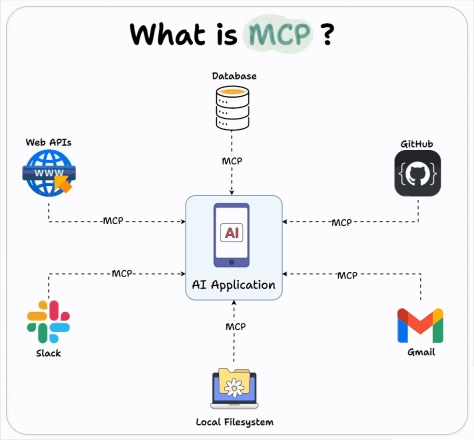

건물 에이전트에 OpenAI MCP 통합을 사용하는 방법은 무엇입니까?Apr 24, 2025 am 09:58 AM

건물 에이전트에 OpenAI MCP 통합을 사용하는 방법은 무엇입니까?Apr 24, 2025 am 09:58 AMOpenAi는 다양한 데이터 시스템과의 AI 보조 통합을 단순화하는 오픈 소스 표준 단순화 인 Anthropic의 MCP (Model Context Protocol)를 지원함으로써 상호 운용성을 수용합니다. 이 협업은 AI 애플리케이션에 대한 통합 프레임 워크를 EFF로 향상시킵니다.

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

SublimeText3 영어 버전

권장 사항: Win 버전, 코드 프롬프트 지원!

SublimeText3 Linux 새 버전

SublimeText3 Linux 최신 버전

WebStorm Mac 버전

유용한 JavaScript 개발 도구

mPDF

mPDF는 UTF-8로 인코딩된 HTML에서 PDF 파일을 생성할 수 있는 PHP 라이브러리입니다. 원저자인 Ian Back은 자신의 웹 사이트에서 "즉시" PDF 파일을 출력하고 다양한 언어를 처리하기 위해 mPDF를 작성했습니다. HTML2FPDF와 같은 원본 스크립트보다 유니코드 글꼴을 사용할 때 속도가 느리고 더 큰 파일을 생성하지만 CSS 스타일 등을 지원하고 많은 개선 사항이 있습니다. RTL(아랍어, 히브리어), CJK(중국어, 일본어, 한국어)를 포함한 거의 모든 언어를 지원합니다. 중첩된 블록 수준 요소(예: P, DIV)를 지원합니다.