OpenAI는 조용히 사용 정책을 업데이트하고 '기술을 군사 및 전쟁 목적으로 사용하는 것을 엄격히 금지합니다'라는 조항을 삭제합니다.

- 王林앞으로

- 2024-01-15 18:33:22802검색

외신 더 인터셉트(The Intercept)의 보도에 따르면 OpenAI는 최근 자사 기술을 군사적 목적으로 사용하는 것을 명시적으로 금지하는 문구를 삭제하는 등 사용 정책을 소폭 조정했습니다. 이 움직임은 약간의 우려와 논란을 불러일으켰습니다.

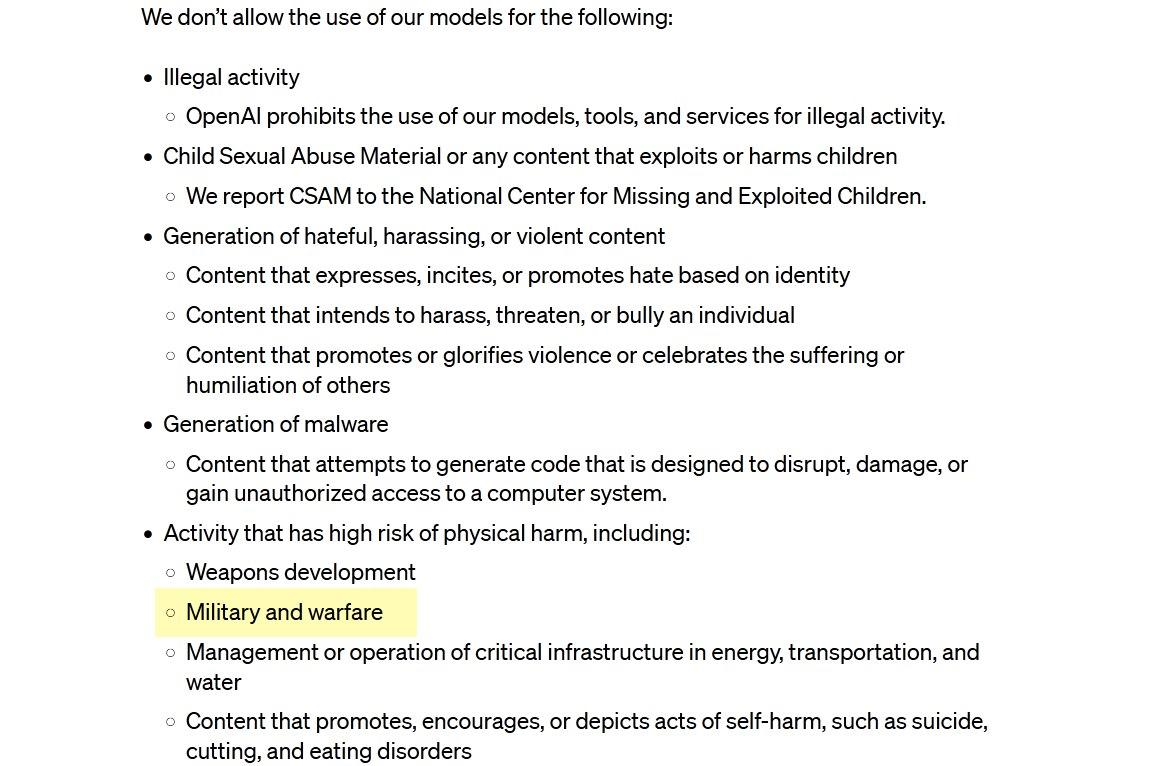

보고서에서는 현지 시간으로 1월 10일 공개된 OpenAI의 사용 정책에는 특히 무기 개발, 군사, 전쟁 분야에서 “심각한 신체적 피해를 초래할 수 있는” 활동에 대한 금지가 여전히 포함되어 있다고 지적했습니다.

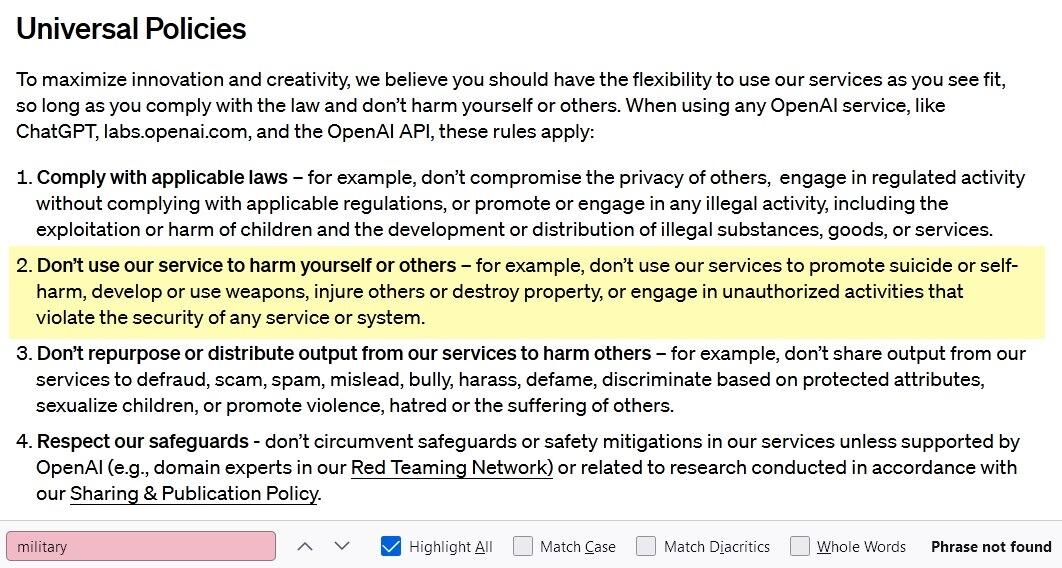

본 사이트에 첨부된 사진 : 위 사진은 수정 전, 아래 사진은 수정 후입니다.

그러나 새로운 정책에서는 '본 서비스를 사용하여 자신이나 타인에게 해를 끼치는 것'을 금지하고 '무기 개발 또는 사용'을 예로 들지만, '군사 및 전쟁'은 보다 포괄적인 의미를 갖습니다. 금지 더 이상 존재하지 않습니다.

OpenAI는 이러한 변경의 목적이 "더 명확하고 읽기 쉽게" 만드는 것이라고 주장했습니다. 회사 대변인 Nick Felix는 언론에 "우리의 목표는 '해를 끼치지 마세요'와 같은 공통 원칙을 만드는 것입니다. . "타인"의 원칙은 광범위하고 많은 상황과 관련이 있으며, 우리는 특히 무기와 타인에 대한 피해를 명확한 예로 언급했습니다. “금지는 모든 군사적 용도에 적용됩니까. OpenAI 대변인은 이에 대해 다음과 같이 답변했습니다. 군사적 사용을 포함하여 우리의 기술을 사용하여 무기를 "개발" 또는 "사용"하거나, 타인에게 해를 끼치거나 재산을 손상시키거나, 서비스나 시스템 보안을 침해하는 무단 활동에 가담하는 사람은 누구든지, 허락되지 않는다.

보고서에서는 사이버 보안 회사인 Trail of Bits의 엔지니어링 이사이자 기계 학습 및 자율 시스템 보안 전문가인 Heidi Clough의 말을 인용하여 OpenAI가 자신의 기술과 서비스를 사용함으로써 발생할 수 있는 위험과 위험을 매우 잘 알고 있다고 말했습니다. 군사용 애플리케이션 , 새로운 사용 정책은 '보안'보다는 '합법성'을 강조하는 것 같습니다.

위 내용은 OpenAI는 조용히 사용 정책을 업데이트하고 '기술을 군사 및 전쟁 목적으로 사용하는 것을 엄격히 금지합니다'라는 조항을 삭제합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!