실시간 렌더링: Street Gaussian을 기반으로 한 동적 도시 장면 모델링

- 王林앞으로

- 2024-01-08 13:49:461223검색

솔직히 기술 업데이트 속도가 매우 빠르기 때문에 학계의 일부 오래된 방법이 점차 새로운 방법으로 대체되고 있습니다. 최근 저장대학교 연구팀이 가우시안(Gaussians)이라는 새로운 방법을 제안해 큰 관심을 끌었다. 이 방법은 문제 해결에 고유한 이점이 있으며 업무에 성공적으로 사용되었습니다. 비록 네르프는 학계에서 점차 영향력을 잃어가고 있지만

아직 레벨을 통과하지 못한 플레이어들에게 도움을 주기 위해 게임 내에서 구체적인 퍼즐 해결 방법을 살펴보겠습니다.

아직 레벨을 통과하지 못한 플레이어를 돕기 위해 퍼즐을 푸는 구체적인 방법을 함께 배울 수 있습니다. 이를 위해 퍼즐 해결에 관한 논문을 찾았습니다. 링크는 https://arxiv.org/pdf/2401.01339.pdf입니다. 이 문서를 읽으면 퍼즐 해결 기술에 대해 자세히 알아볼 수 있습니다. 이것이 플레이어에게 도움이 되기를 바랍니다!

본 논문은 단안 영상을 통해 역동적인 도시 거리 장면을 모델링하는 문제를 해결하는 것을 목표로 합니다. 최근 방법은 NeRF를 확장하여 추적 차량 포즈를 애니메이션 차량에 통합함으로써 역동적인 도시 거리 장면의 사실적인 뷰 합성을 가능하게 했습니다. 그러나 이들의 중요한 한계는 느린 훈련 및 렌더링 속도와 차량 자세 추적 시 높은 정확도에 대한 긴급한 요구가 결합되어 있다는 것입니다. 이 문서에서는 이러한 모든 제한 사항을 해결하는 새로운 명시적 장면 표현인 Street Gaussians를 소개합니다. 특히, 역동적인 도시 거리는 의미론적 로짓과 3D 가우시안을 갖춘 포인트 클라우드 세트로 표현되며, 각각은 전경 차량 또는 배경과 연관되어 있습니다.

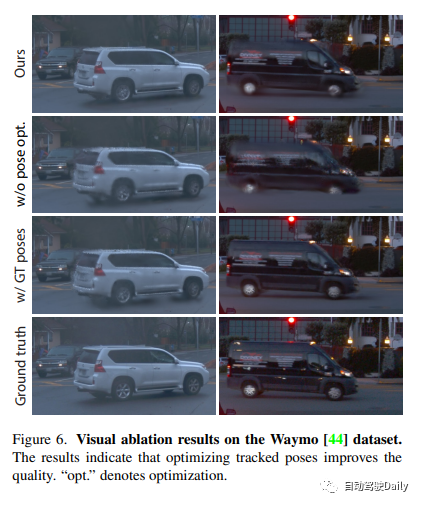

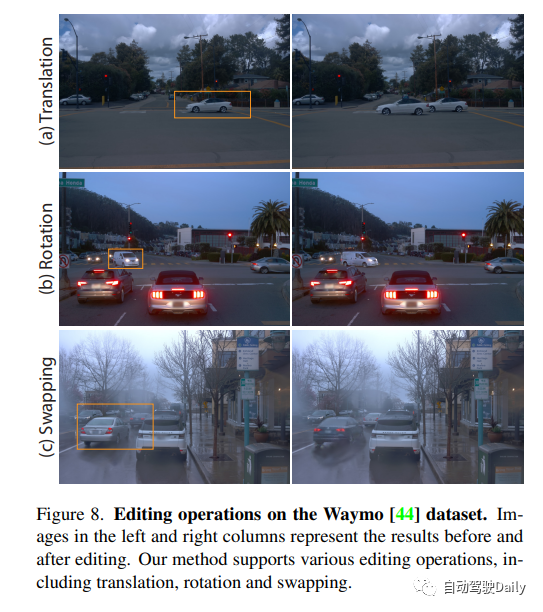

전경 객체 차량의 역학을 모델링하기 위해 각 객체 포인트 클라우드는 최적화 가능한 추적 포즈와 동적 외관의 동적 구면 조화 모델을 사용하여 최적화될 수 있습니다. 이러한 명시적 표현을 통해 대상 차량과 배경의 간단한 합성, 장면 편집 작업 및 훈련 30분 이내에 133FPS(1066×1600 해상도)의 렌더링이 가능합니다. 연구원들은 KITTI 및 Waymo Open 데이터 세트를 포함한 여러 가지 까다로운 벤치마크에서 이 접근 방식을 평가했습니다.

실험 결과에 따르면 우리가 제안한 방법은 모든 데이터 세트에서 기존 기술보다 지속적으로 성능이 뛰어납니다. 우리는 기성 추적기의 포즈 정보에만 의존하지만 우리의 표현은 실제 포즈 정보를 사용하여 얻은 것과 비슷한 성능을 제공합니다.

아직 레벨을 통과하지 못한 플레이어들을 돕기 위해 구체적인 퍼즐 해결 방법을 찾을 수 있는 https://zju3dv.github.io/streetgaussians/ 링크를 제공합니다. 링크를 클릭하시면 참고하실 수 있으니 도움이 되셨으면 좋겠습니다.

스트리트 가우스 방법 소개

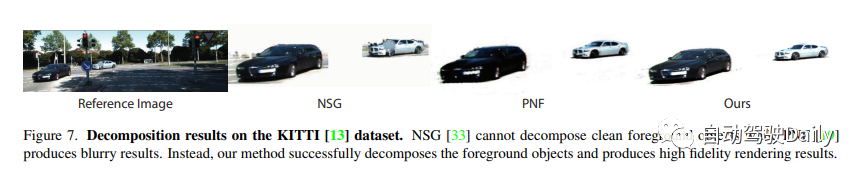

도시 거리 장면에서 움직이는 차량에서 캡처한 일련의 이미지를 바탕으로 이 논문의 목표는 주어진 입력 시간 단계에 대해 사실적인 이미지를 생성할 수 있는 방법을 개발하는 것입니다. 어떤 관점. 이 목표를 달성하기 위해 역동적인 거리 장면을 표현하도록 특별히 설계된 Street Gaussians라는 새로운 장면 표현이 제안되었습니다. 그림 2에서 볼 수 있듯이 역동적인 도시 거리 장면은 일련의 포인트 클라우드로 표현되며, 각 포인트 클라우드는 정적 배경 또는 움직이는 차량에 해당합니다. 명시적 포인트 기반 표현을 통해 개별 모델을 간단하게 구성할 수 있어 실시간 렌더링은 물론 편집 애플리케이션을 위한 전경 객체 분해도 가능합니다. 제안된 장면 표현은 추적된 차량 포즈 최적화 전략에 의해 강화된 기성 추적기의 추적된 차량 포즈와 함께 RGB 이미지만을 사용하여 효율적으로 훈련될 수 있습니다.

Street Gaussians 개요 아래 그림과 같이 역동적인 도시 거리 장면은 최적화된 추적 차량 포즈를 사용하여 포인트 기반 배경 및 전경 타겟 세트로 표현됩니다. 각 점에는 위치, 불투명도, 회전 및 축척으로 구성된 공분산을 포함하는 3D 가우스가 할당되어 형상을 나타냅니다. 모양을 표현하기 위해 각 배경 점에는 구면 조화 모델이 할당되고 전경 점은 동적 구면 조화 모델과 연결됩니다. 명시적 포인트 기반 표현을 통해 별도의 모델을 간단하게 조합할 수 있어 고품질 이미지와 의미 지도(훈련 중에 2D 의미 정보가 제공되는 경우 선택 사항)의 실시간 렌더링이 가능하고 편집을 위한 전경 객체 분해가 가능합니다. 애플리케이션

실험 결과 비교

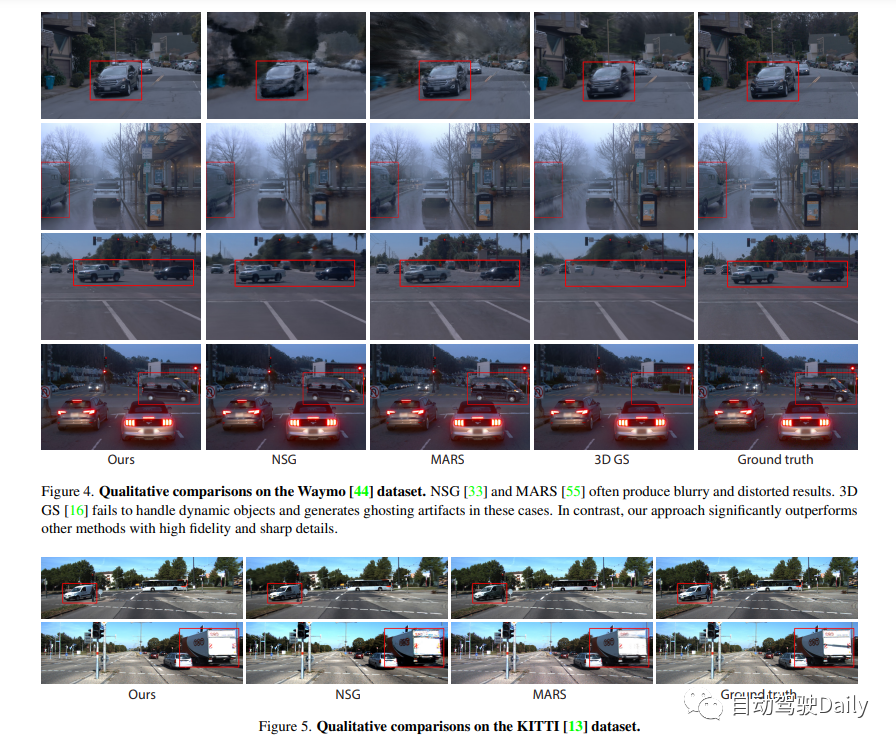

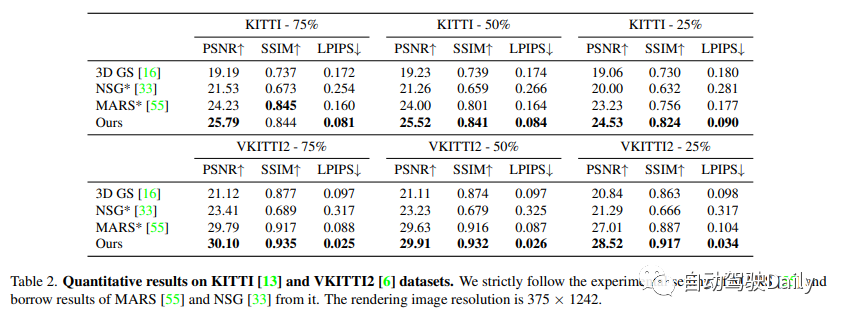

Waymo 오픈 데이터세트와 KITTI 벤치마크를 대상으로 실험을 진행했습니다. Waymo 공개 데이터 세트에서는 다수의 움직이는 물체, 중요한 자아 움직임 및 복잡한 조명 조건을 포함하는 6개의 녹음 시퀀스가 선택되었습니다. 모든 시퀀스의 길이는 약 100프레임이며, 시퀀스의 10개 이미지마다 테스트 프레임으로 선택되고 나머지 이미지는 학습에 사용됩니다. 고해상도 이미지로 학습할 때 기본 방법의 메모리 비용이 높다는 사실이 확인되면 입력 이미지를 1066×1600으로 축소했습니다. KITTI 및 Vitural KITTI 2에서는 다양한 열차/테스트 분할 설정을 사용하여 MARS 설정을 따르고 평가했습니다. Waymo 데이터세트에서 탐지기와 추적기에 의해 생성된 경계 상자를 사용하고 KITTI에서 공식적으로 제공하는 대상 궤적을 사용합니다.

저희 방법을 최근 세 가지 방법과 비교해 보세요.

(1) NSG는 배경을 다면 이미지로 표현하고 각 객체에 대해 학습된 잠재 코드와 공유 디코더를 사용하여 움직이는 객체를 모델링합니다.

(2) MARS는 Nerfstudio를 기반으로 장면 그래프를 구축합니다.

(3) 3D 가우스는 이방성 가우스 세트를 사용하여 장면을 모델링합니다.

NSG와 MARS는 모두 GT 박스를 사용하여 교육 및 평가되었으며, 여기에서 다양한 버전의 구현을 시도하고 각 시퀀스에 대한 최상의 결과가 보고됩니다. 또한 3D 가우스 맵의 SfM 포인트 클라우드를 공정한 비교를 위한 방법과 동일한 입력으로 대체합니다. 자세한 내용은 보충 정보를 참조하세요.

원본 링크: https://mp.weixin.qq.com/s/oikZWcR47otm7xfU90JH4g

위 내용은 실시간 렌더링: Street Gaussian을 기반으로 한 동적 도시 장면 모델링의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!