문서 이미지를 마크다운 형식으로 변환하고 싶으십니까?

과거에는 이 작업에 텍스트 인식, 레이아웃 감지 및 정렬, 수식표 처리, 텍스트 정리 등 여러 단계가 필요했습니다. -

이번에는 단 한 문장의 명령으로 다중 모드 대형 모델 Vary는 터미널 출력 결과에 직접 전달됩니다:

pictures

pictures

중국어와 영어로 된 큰 텍스트인지 여부:

pictures

pictures

또한 수식 문서 그림

pictures을 포함합니다

pictures을 포함합니다

또는 모바일 페이지 스크린샷:

picture

picture

사진 속 테이블을 latex로 변환할 수도 있습니다. 형식:

picture

picture

물론 멀티 모델 대형으로 모델에서는 범용 기능을 유지하는 것이 필수적입니다.

사진

사진

Vary는 큰 잠재력과 극도로 높은 상한을 보여줍니다. OCR은 더 이상 긴 파이프라인을 필요로 하지 않고 직접 end-to-end를 출력할 수 있으며 라텍스와 같은 다양한 형식을 출력할 수 있습니다. 사용자 프롬프트에 따라 단어, 마크다운.

강력한 언어 사전 설정을 통해 이 아키텍처는 "레버리지" 및 "듀폴" 등과 같이 OCR에서 오타가 발생하기 쉬운 단어를 피할 수 있습니다. 퍼지 문서의 경우 언어 사전의 도움으로 더욱 강력한 OCR 효과를 얻을 수 있을 것으로 예상됩니다

많은 네티즌들의 관심을 끌었던 프로젝트는 출시와 동시에 큰 화제를 불러일으켰습니다. 이를 본 네티즌 중 한 명은 "너무 멋지다!"라고 외쳤다.

사진

사진

이 효과는 어떻게 구현된 걸까요?

대형 모델에서 영감을 얻음

현재 거의 모든 다중 모드 대형 모델은 CLIP을 Vision Encoder 또는 시각적 어휘로 사용합니다. 실제로 4억 개의 이미지-텍스트 쌍으로 훈련된 CLIP은 강력한 시각적 텍스트 정렬 기능을 갖추고 있으며 대부분의 일상 작업에서 이미지 인코딩을 처리할 수 있습니다.

그러나 특히 영어가 아닌 시나리오에서 문서 수준 OCR 및 차트 이해와 같은 조밀하고 세밀한 인식 작업의 경우 CLIP은 명백한 코딩 비효율성과 어휘 부족 문제를 보여줍니다.

대형 순수 NLP 모델(예: LLaMA)이 영어에서 중국어(대형 모델의 경우 "외국어")로 전환하는 경우 중국어를 인코딩하는 원래 어휘가 비효율적이므로 더 나은 결과를 얻으려면 텍스트 어휘를 확장해야 합니다.

연구팀이 영감을 얻은 것은 바로 이 기능 때문입니다

이제 CLIP 시각적 어휘를 기반으로 한 다중 모드 대형 모델은 빽빽하게 들어찬 페이지와 같은 "외국어 이미지"와 마주치는 동일한 문제에 직면합니다. 종이에 텍스트가 있으면 이미지를 효율적으로 토큰화하기가 어렵습니다.

Vary는 이러한 문제를 해결하기 위해 제공되는 솔루션입니다. 원래의 어휘를 재정립하지 않고도 시각적인 어휘를 효율적으로 확장할 수 있습니다.

Pictures

Pictures

기존 방식과 달리 기성 CLIP 어휘인 Vary를 사용합니다.

첫 번째 단계에서는 작은 디코더 전용 네트워크를 사용하여 자동 회귀 방식으로 강력하고 새로운 시각적 어휘를 생성합니다.

다음으로 두 번째 단계에서는 새로운 어휘와 CLIP 어휘가 fused를 통해 효율적으로 LVLM을 훈련하고 새로운 기능을 제공합니다

다음은 Vary의 훈련 방법과 모델 구조를 보여줍니다.

Pictures

Pictures

공개 데이터 세트와 렌더링된 문서 차트에 대한 훈련을 통해 Vary는 세분화된 작업을 크게 향상시킵니다. 시각적 인식 능력.

바닐라 다중 모드 기능을 유지하면서 엔드투엔드 중국어 및 영어 그림, 수식 스크린샷 및 차트 이해 기능에 영감을 줍니다.

또한 연구팀은 원래 수천 개의 토큰이 필요할 수 있는 페이지 콘텐츠가 문서 이미지를 통해 입력되었으며, 해당 정보가 256개의 이미지 토큰으로 Vary 압축되어 추가 페이지 분석 및 요약 공간에 더 많은 상상력을 제공했다는 사실을 발견했습니다. .

현재 Vary의 코드와 모델은 오픈 소스이며 누구나 시도해 볼 수 있는 웹 데모도 제공됩니다.

관심있는 친구들은 한번 해보세요~

위 내용은 Megvii의 오픈 소스 다중 모드 대형 모델은 중국어와 영어를 포괄하는 문서 수준 OCR을 지원합니다. 이것이 OCR의 종말을 의미합니까?의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

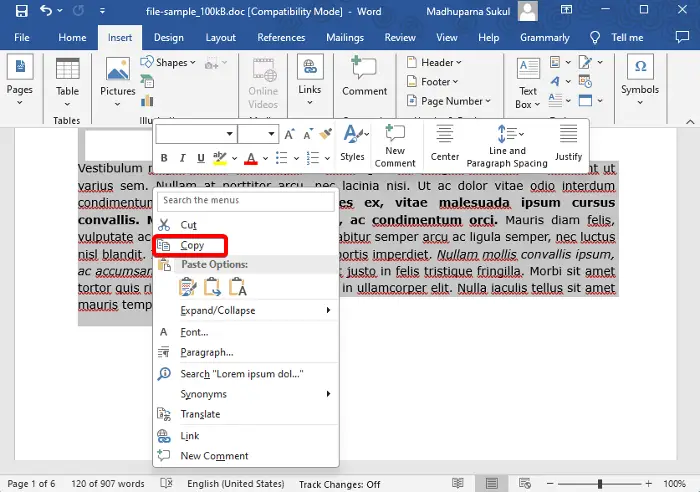

如何在Word中复制页面Feb 20, 2024 am 10:09 AM

如何在Word中复制页面Feb 20, 2024 am 10:09 AM是否要复制MicrosoftWord中的页面,并保持格式不变?这是一个聪明的想法,因为当您想要创建特定文档布局或格式的多个副本时,在Word中复制页面可能是一种有用的节省时间的技术。本指南将逐步引导您在Word中复制页面的过程,无论是创建模板还是复制文档中的特定页面。这些简单的说明旨在帮助您轻松地重新制作页面,省去从头开始的麻烦。为什么要在MicrosoftWord中复制页面?在Word中复制页面非常有益的原因有以下几点:当您有一个具有特定布局或格式的文档要复制时。与从头开始重新创建整个页面不同

如何快速刷新网页?Feb 18, 2024 pm 01:14 PM

如何快速刷新网页?Feb 18, 2024 pm 01:14 PM页面刷新在我们日常的网络使用中非常常见,当我们访问一个网页后,有时候会遇到一些问题,比如网页加载不出来或者显示不正常等。这时候我们通常会选择刷新页面来解决问题,那么如何快速地刷新页面呢?下面我们就来探讨一下页面刷新的快捷键。页面刷新快捷键是一种通过键盘操作来快速刷新当前网页的方法。在不同的操作系统和浏览器中,页面刷新的快捷键可能有所不同。下面我们以常见的W

3秒跳转页面实现方法:PHP编程指南Mar 25, 2024 am 10:42 AM

3秒跳转页面实现方法:PHP编程指南Mar 25, 2024 am 10:42 AM标题:3秒跳转页面实现方法:PHP编程指南在网页开发中,页面跳转是常见的操作,一般情况下我们使用HTML中的meta标签或者JavaScript的方法进行页面跳转。不过,在某些特定的情况下,我们需要在服务器端进行页面跳转。本文将介绍如何使用PHP编程实现一个在3秒内自动跳转到指定页面的功能,同时会给出具体的代码示例。PHP实现页面跳转的基本原理PHP是一种在

如何在iPhone上自定义和编辑待机模式:iOS 17的新功能Sep 21, 2023 pm 04:01 PM

如何在iPhone上自定义和编辑待机模式:iOS 17的新功能Sep 21, 2023 pm 04:01 PM待机是iOS17更新中的一项新功能,它提供了一种新的增强方式,可以在手机快速闲置时访问信息。通过StandBy,您可以方便地查看时间、查看即将发生的事件、浏览日历、获取您所在位置的天气更新等等。激活后,iPhone在充电时设置为横向时会直观地进入待机模式。此功能非常适合床头柜等无线充电点,或者在日常任务中离开iPhone充电时。它允许您轻扫待机中显示的各种小部件,以访问来自各种应用程序的不同信息集。但是,您可能希望根据您的偏好和您经常需要的信息修改这些小部件,甚至删除一些小部件。因此,让我们深入

处理Laravel页面无法正确显示CSS的方法Mar 10, 2024 am 11:33 AM

处理Laravel页面无法正确显示CSS的方法Mar 10, 2024 am 11:33 AM《处理Laravel页面无法正确显示CSS的方法,需要具体代码示例》在使用Laravel框架开发Web应用时,有时候会遇到页面无法正确显示CSS样式的问题,这可能会导致页面呈现不正常的样式,影响用户体验。本文将介绍一些处理Laravel页面无法正确显示CSS的方法,并提供具体的代码示例,帮助开发者解决这一常见问题。一、检查文件路径首先要检查CSS文件的路径是

重新排列、禁用和删除 iPhone 主屏幕页面的方法Nov 29, 2023 am 08:22 AM

重新排列、禁用和删除 iPhone 主屏幕页面的方法Nov 29, 2023 am 08:22 AM在iOS中,Apple允许您禁用iPhone上的单个主屏幕页面。还可以重新排列主屏幕页面的顺序,并直接删除页面,而不仅仅是禁用它们。这是它的工作原理。如何重新排列主屏幕页面触摸并按住主屏幕上的空格可进入抖动模式。轻点代表主屏幕页面的圆点行。在显示的主屏幕网格中,轻触并拖动页面以将其相对于其他页面重新排列。其他人会移动以响应您的拖拽动作。当您对新排列感到满意时,点击屏幕右上角的“完成”,然后再次点击“完成”以退出抖动模式。如何禁用或删除主屏幕页面触摸并按住主屏幕上的空格可进入抖动模式。轻点代表主屏

利用ThinkPHP6实现漂亮的404页面Jun 20, 2023 am 11:06 AM

利用ThinkPHP6实现漂亮的404页面Jun 20, 2023 am 11:06 AM随着互联网的日益发展,许多网站或应用也逐渐变得复杂。当用户在使用时,时常会遇到错误页面,其中最常见的就是404页面。404页面指访问的页面不存在,是常见的错误页面。而对于网站或应用来说,一个漂亮的404页面能极大提升用户体验。在本文中,我们将会介绍如何利用ThinkPHP6快速实现一个漂亮的404页面。创建路由首先,我们需要在route文件夹中创建一个err

Word删除一页内容的方法介绍Mar 26, 2024 am 10:06 AM

Word删除一页内容的方法介绍Mar 26, 2024 am 10:06 AM标题:Word删除一页内容的方法介绍在使用MicrosoftWord编辑文档时,有时会遇到需要删除某一页内容的情况,可能是想删除文档中的一页空白页或者某一页不需要的内容。针对这种情况,我们可以采取一些方法来快速、有效地删除一页内容。接下来,将介绍一些在MicrosoftWord中删除一页内容的方法。方法一:删除一页内容首先,打开需要编辑的Word文档。定

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

ZendStudio 13.5.1 맥

강력한 PHP 통합 개발 환경

에디트플러스 중국어 크랙 버전

작은 크기, 구문 강조, 코드 프롬프트 기능을 지원하지 않음

맨티스BT

Mantis는 제품 결함 추적을 돕기 위해 설계된 배포하기 쉬운 웹 기반 결함 추적 도구입니다. PHP, MySQL 및 웹 서버가 필요합니다. 데모 및 호스팅 서비스를 확인해 보세요.

SublimeText3 Linux 새 버전

SublimeText3 Linux 최신 버전

mPDF

mPDF는 UTF-8로 인코딩된 HTML에서 PDF 파일을 생성할 수 있는 PHP 라이브러리입니다. 원저자인 Ian Back은 자신의 웹 사이트에서 "즉시" PDF 파일을 출력하고 다양한 언어를 처리하기 위해 mPDF를 작성했습니다. HTML2FPDF와 같은 원본 스크립트보다 유니코드 글꼴을 사용할 때 속도가 느리고 더 큰 파일을 생성하지만 CSS 스타일 등을 지원하고 많은 개선 사항이 있습니다. RTL(아랍어, 히브리어), CJK(중국어, 일본어, 한국어)를 포함한 거의 모든 언어를 지원합니다. 중첩된 블록 수준 요소(예: P, DIV)를 지원합니다.

뜨거운 주제

1371

1371 52

52 38

38 19

19