고품질 이미지 생성을 향한 새로운 단계: Google의 UFOGen 초고속 샘플링 방법

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-11-20 14:30:471310검색

지난해 Stable Diffusion으로 대표되는 일련의 Vincentian 그래프 확산 모델은 시각적 창작 분야를 완전히 바꿔 놓았습니다. 수많은 사용자들이 확산 모델로 생성된 이미지로 생산성을 향상시켰습니다. 그러나 확산 모델의 생성 속도는 일반적인 문제입니다. 노이즈 제거 모델은 초기 가우스 노이즈를 점차적으로 이미지로 변환하기 위해 다단계 노이즈 제거에 의존하기 때문에 네트워크에 대한 여러 계산이 필요하므로 생성 속도가 매우 느려집니다. 이로 인해 대규모 Vincentian 그래프 확산 모델은 실시간 및 상호 작용에 중점을 두는 일부 응용 프로그램에 매우 적합하지 않게 됩니다. 일련의 기술이 도입되면서 확산 모델에서 샘플링하는 데 필요한 단계 수가 초기 수백 단계에서 수십 단계 또는 심지어 4~8단계로 늘어났습니다.

최근 Google 연구팀은 매우 빠르게 샘플링할 수 있는 확산 모델의 변형인 UFOGen 모델을 제안했습니다. 논문에서 제안한 방법으로 Stable Diffusion을 미세 조정함으로써 UFOGen은 단 한 단계만으로 고품질의 이미지를 생성할 수 있습니다. 동시에 그래프 생성 및 ControlNet과 같은 Stable Diffusion의 다운스트림 애플리케이션도 유지할 수 있습니다.

논문을 보려면 다음 링크를 클릭하세요: https://arxiv.org/abs/2311.09257

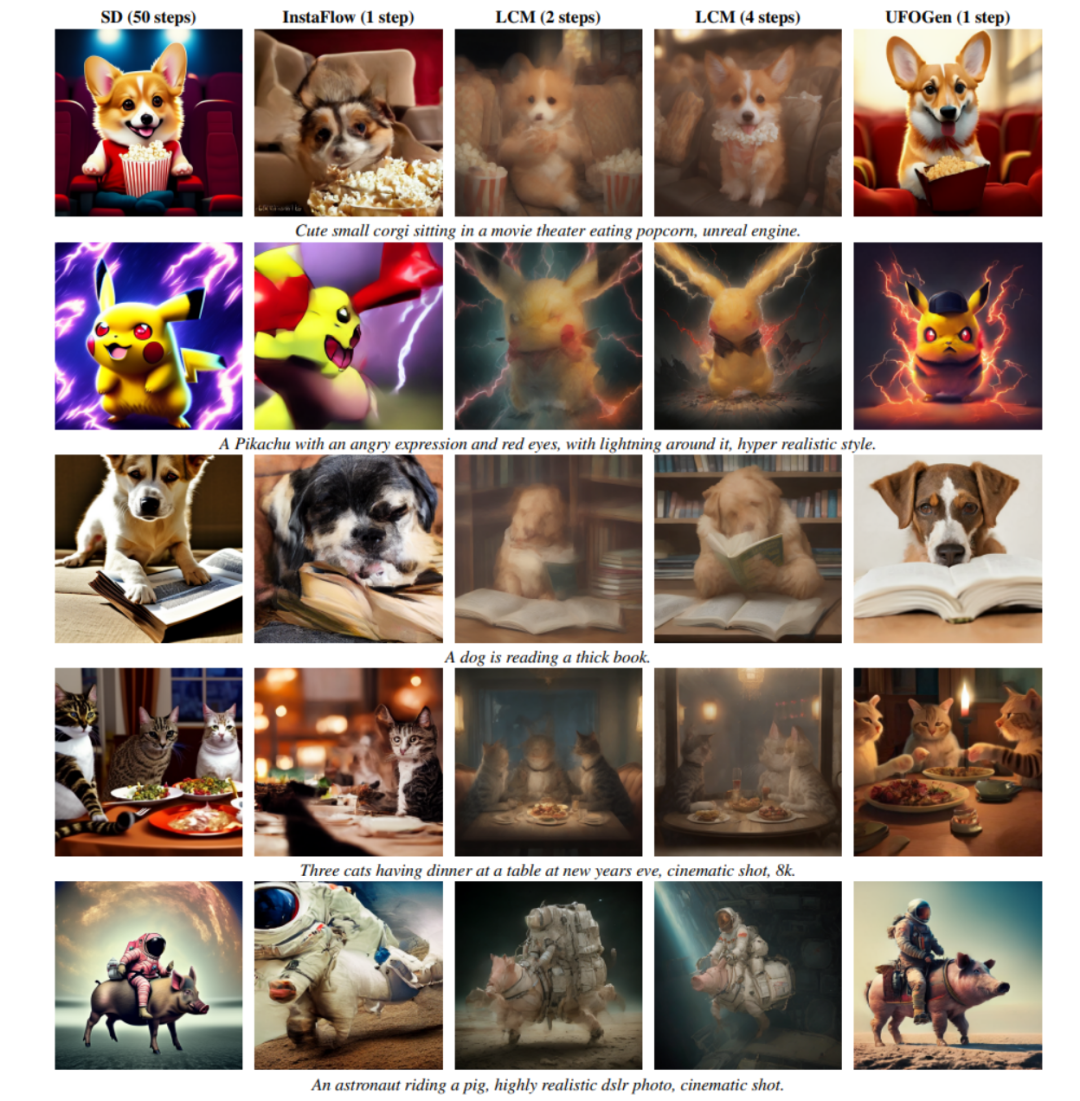

아래 그림에서 볼 수 있듯이 UFOGen은 고품질의 다양한 생성을 생성할 수 있습니다. 단 한 단계만으로 이미지를 얻을 수 있습니다.

확산 모델의 생성 속도를 높이는 것은 새로운 연구 방향이 아닙니다. 이 분야의 이전 연구는 주로 두 가지 방향에 중점을 두었습니다. 한 가지 방향은 보다 효율적인 수치 계산 방법을 설계하여 더 적은 이산 단계를 사용하여 확산 모델의 샘플링 ODE를 해결하려는 목적을 달성하는 것입니다. 예를 들어, Tsinghua University의 Zhu Jun 팀이 제안한 DPM 시리즈 수치 솔버는 Stable Diffusion에서 매우 효과적인 것으로 입증되었으며, DDIM의 기본 50단계에서 20단계 미만으로 솔루션 단계 수를 크게 줄일 수 있습니다. 또 다른 방향은 지식 증류 방법을 사용하여 모델의 ODE 기반 샘플링 경로를 더 적은 수의 단계로 압축하는 것입니다. 이 방향의 예로는 CVPR2023에서 최고의 논문 후보 중 하나인 유도 증류와 최근 인기 있는 LCM(Latent Consistency Model)이 있습니다. 특히 LCM은 일관성 목표를 추출하여 샘플링 단계 수를 4단계로 줄일 수 있으며, 이로 인해 많은 실시간 생성 애플리케이션이 생성되었습니다.

그러나 Google 연구팀은 UFOGen 모델에서 위의 일반적인 방향을 따르지 않고 대신 다른 접근 방식을 취하여 1년 이상 전에 제안된 확산 모델과 GAN의 하이브리드 모델 아이디어를 사용했습니다. 앞서 언급한 ODE 기반 샘플링 및 증류에는 근본적인 한계가 있으며 샘플링 단계 수를 한계까지 압축하기 어렵다고 생각합니다. 그러므로 원스텝세대라는 목표를 달성하려면 새로운 아이디어를 열어야 합니다.

하이브리드 모델은 확산 모델과 생성적 적대 신경망(GAN)을 결합한 방식을 말합니다. 이 방법은 ICLR 2022에서 NVIDIA 연구팀에 의해 처음 제안되었으며 DDGAN("Using Denoising Diffusion GAN to Solve Three Problems in Generative Learning")이라고 합니다. DDGAN은 노이즈 감소 분포에 대해 가우스 가정을 하는 일반 확산 모델의 단점에서 영감을 받았습니다. 간단히 말해서, 확산 모델은 노이즈 제거 분포(노이즈가 있는 샘플이 주어졌을 때 노이즈가 적은 샘플을 생성하는 조건부 분포)가 단순 가우스 분포라고 가정합니다. 그러나 확률론적 미분 방정식 이론은 이러한 가정이 잡음 감소 단계 크기가 0에 접근할 때만 유효하다는 것을 증명합니다. 따라서 확산 모델은 작은 노이즈 제거 단계 크기를 보장하기 위해 많은 수의 반복된 노이즈 제거 단계가 필요하므로 생성 속도가 느려집니다. DDGAN은 노이즈 제거 분포에 대한 가우스 가정을 포기하고 대신 조건부 GAN을 사용하여 시뮬레이션할 것을 제안합니다. 이 노이즈 감소 분포. GAN은 매우 강력한 표현 기능을 갖고 있고 복잡한 분포를 시뮬레이션할 수 있기 때문에 더 큰 노이즈 감소 단계 크기를 사용하여 단계 수를 줄일 수 있습니다. 그러나 DDGAN은 확산 모델의 안정적인 재구성 훈련 목표를 GAN의 훈련 목표로 변경하므로 훈련 불안정성이 쉽게 발생하고 더 복잡한 작업으로 확장하기가 어렵습니다. NeurIPS 2023에서 UGOGen을 만든 동일한 Google 연구팀은 DDGAN의 훈련 목표에 재구성 목적 함수를 다시 도입하여 훈련의 안정성과 생성 품질을 향상시키는 SIDDM(논문 제목 Semi-Implicit Denoising Diffusion Models)을 제안했습니다. DDGAN에 비해 크게 개선되었습니다.

SIDDM은 UFOGen의 전신으로서 단 4단계만으로 CIFAR-10, ImageNet 및 기타 연구 데이터 세트에서 고품질 이미지를 생성할 수 있습니다. 하지만 SIDDM에는 해결해야 할 두 가지 문제가 있습니다. 첫째, 이상적인 조건의 1단계 생성을 달성할 수 없다는 점, 둘째, 보다 관심 있는 Vincentian 그래프 분야로 확장하는 것이 간단하지 않다는 점입니다. 이를 위해 구글 연구팀은 이 두 가지 문제를 해결하기 위해 UFOGen을 제안했습니다.

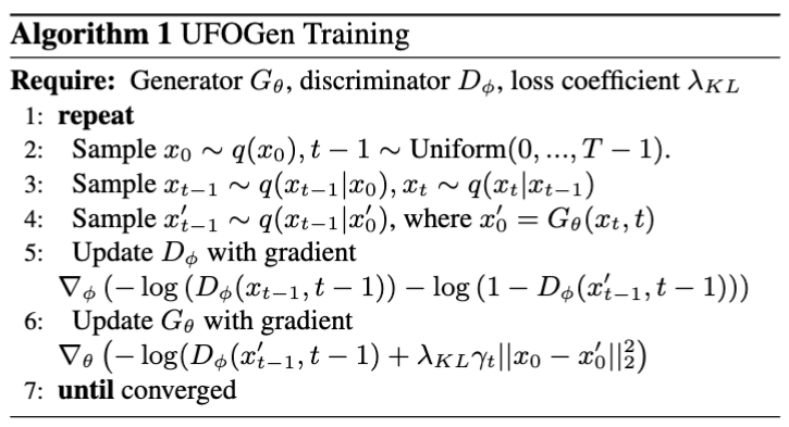

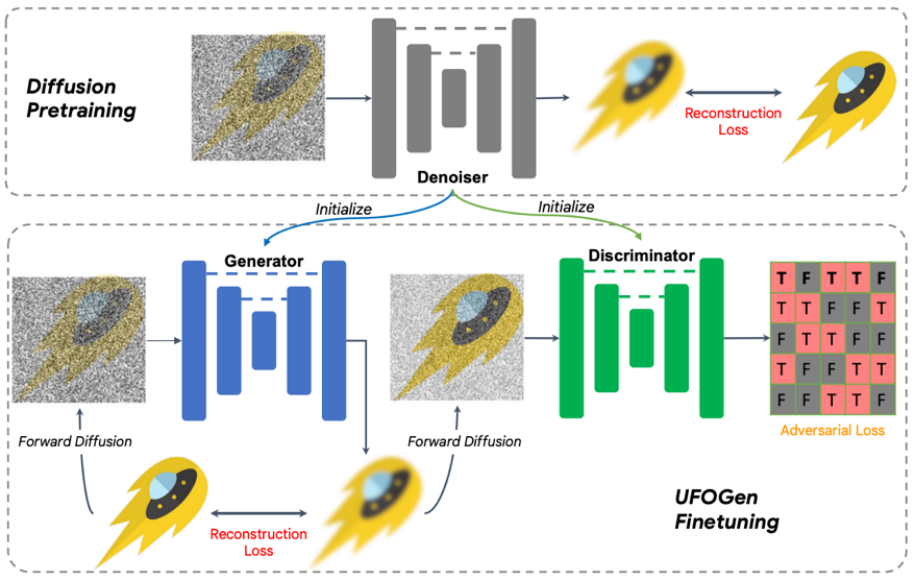

구체적으로, 1번 문제의 경우, 간단한 수학적 분석을 통해 생성기의 매개변수화 방식과 재구성 손실함수의 계산 방식을 변경하면 이론적인 모델을 한 단계로 생성할 수 있음을 발견했습니다. 두 번째 질문에 대해 팀은 UFOGen 모델을 Vincent 다이어그램 작업으로 더 빠르고 효과적으로 확장할 수 있도록 초기화에 기존 Stable Diffusion 모델을 사용할 것을 제안했습니다. SIDDM은 생성기와 판별기 모두 UNet 아키텍처를 채택할 것을 제안했다는 점에 주목할 필요가 있습니다. 따라서 이 설계를 기반으로 UFOGen의 생성기와 판별기는 Stable Diffusion 모델에 의해 초기화됩니다. 이렇게 하면 Stable Diffusion의 내부 정보, 특히 이미지와 텍스트 간의 관계에 대한 정보를 최대한 활용할 수 있습니다. 이러한 정보는 적대적 학습을 통해 얻기가 어렵습니다. 훈련 알고리즘과 다이어그램은 다음과 같습니다.

GAN을 사용하여 Vincentian 그래프를 만든 이전 작업이 있었음을 주목할 가치가 있습니다. 예를 들어 NVIDIA의 StyleGAN-T, Adobe의 GigaGAN 등 StyleGAN의 기본 아키텍처를 더 큰 크기로 확장했습니다. . 스케일을 사용하여 한 단계로 그림을 만들 수 있습니다. UFOGen의 저자는 GAN을 기반으로 한 이전 작업과 비교할 때 생성 품질 외에도 UFOGen에는 여러 가지 장점이 있다고 지적했습니다. 매우 불안정합니다. 판별자는 이미지의 질감을 판단해야 할 뿐만 아니라 이미지와 텍스트 간의 일치 정도를 이해해야 합니다. 이는 특히 학습 초기 단계에서 매우 어려운 작업입니다. 따라서 GigaGAN과 같은 이전 GAN 모델은 훈련을 돕기 위해 많은 수의 보조 손실을 도입하여 훈련 및 매개변수 조정을 극도로 어렵게 만들었습니다. 그러나 UFOGen은 재구성 손실을 도입하여 GAN을 보조 역할로 만들어 매우 안정적인 훈련을 달성합니다

2. GAN을 처음부터 직접 훈련하는 것은 불안정할 뿐만 아니라 특히 Vincent 그래프가 필요한 작업에서는 비용이 매우 많이 듭니다. 많은 양의 데이터와 훈련 단계. 두 개의 매개변수 세트를 동시에 업데이트해야 하기 때문에 GAN 학습은 확산 모델보다 더 많은 시간과 메모리를 소비합니다. UFOGen의 혁신적인 디자인은 Stable Diffusion의 매개변수를 초기화하여 훈련 시간을 크게 절약할 수 있습니다. 일반적으로 수렴에는 수만 개의 학습 단계만 필요합니다.

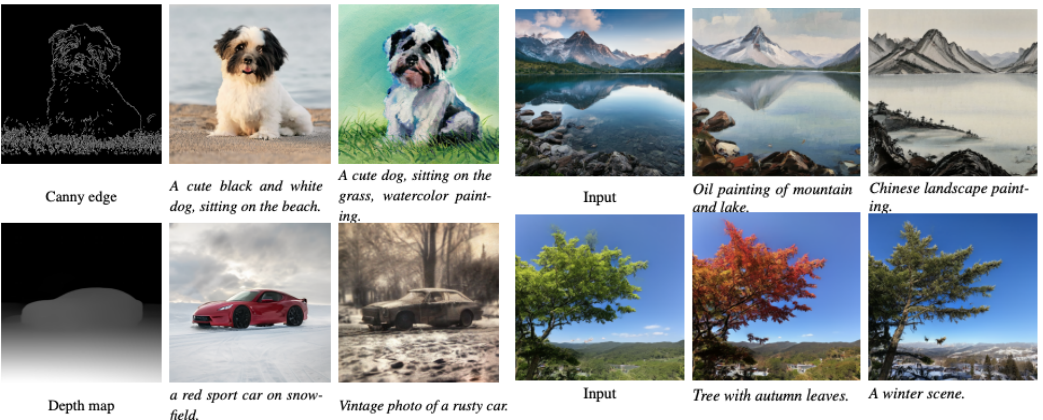

3 Vincent 그래프 확산 모델의 매력 중 하나는 그래프 그래프와 같이 미세 조정이 필요하지 않은 응용 프로그램과 이미 미세 조정이 필요한 응용 프로그램을 포함하여 다른 작업에 적용할 수 있다는 것입니다. 통제된 세대. 이전 GAN 모델은 GAN을 미세 조정하는 것이 어려웠기 때문에 이러한 다운스트림 작업으로 확장하기가 어려웠습니다. 대조적으로, UFOGen은 확산 모델의 프레임워크를 가지고 있으므로 이러한 작업에 더 쉽게 적용될 수 있습니다. 아래 그림은 UFOGen의 그래프 생성 그래프와 제어 가능한 생성의 예를 보여줍니다. 이러한 생성에는 한 단계의 샘플링만 필요합니다.

실험에 따르면 UFOGen은 단 한 번의 샘플링 단계로 텍스트 설명과 일치하는 고품질 이미지를 생성할 수 있습니다. 최근 제안된 확산 모델(예: Instaflow 및 LCM)에 대해 고속 샘플링 방법과 비교하여 UFOGen은 강력한 경쟁력을 보여줍니다. 50단계의 샘플링을 거쳐야 하는 Stable Diffusion과 비교해도 UFOGen에서 생성된 샘플은 외관상 뒤떨어지지 않습니다. 비교 결과는 다음과 같습니다.

요약

Google 팀은 기존 확산 모델과 GAN의 하이브리드 모델을 개선하여 구현한 UFOGen이라는 강력한 모델을 제안했습니다. 이 모델은 Stable Diffusion을 통해 미세 조정되었으며, 한 단계에서 그래프를 생성하는 기능을 보장하는 동시에 다양한 다운스트림 애플리케이션에도 적합합니다. 초고속 텍스트-이미지 합성을 달성하기 위한 초기 작업 중 하나로 UFOGen은 고효율 생성 모델 분야에서 새로운 길을 열었습니다

위 내용은 고품질 이미지 생성을 향한 새로운 단계: Google의 UFOGen 초고속 샘플링 방법의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!