거의 절반에 가까운 매개변수로 성능은 Google Minerva에 가깝고, 또 다른 대규모 수학적 모델은 오픈 소스입니다.

- PHPz앞으로

- 2023-10-21 14:13:011351검색

현재 다양한 텍스트 혼합 데이터를 학습한 언어 모델은 매우 일반적인 언어 이해 및 생성 능력을 보여주며, 다양한 애플리케이션에 적응하기 위한 기본 모델로 사용될 수 있습니다. 개방형 대화 또는 지침 추적과 같은 응용 프로그램은 전체 자연 텍스트 배포에 걸쳐 균형 잡힌 성능이 필요하므로 범용 모델을 선호합니다.

그러나 특정 도메인(예: 의학, 금융 또는 과학) 내에서 성능을 최대화하려는 경우 도메인별 언어 모델은 주어진 계산 비용 또는 더 높은 비용으로 우수한 기능을 제공할 수 있습니다. 계산 비용은 주어진 수준의 기능을 제공합니다.

프린스턴 대학교, EleutherAI 등의 연구원들은 수학 문제를 해결하기 위해 도메인별 언어 모델을 훈련했습니다. 그들은 첫째, 수학적 문제를 해결하려면 많은 양의 전문적인 사전 지식과 패턴 일치가 필요하므로 영역 적응성 훈련에 이상적인 환경입니다. 둘째, 수학적 추론 자체가 AI의 핵심 작업입니다. 강력한 수학적 추론 언어 모델은 보상 모델링, 추론 강화 학습, 알고리즘 추론과 같은 많은 연구 주제의 업스트림입니다.

따라서 Proof-Pile-2의 지속적인 사전 학습을 통해 언어 모델을 수학에 적용하는 방법을 제안합니다. Proof-Pile-2는 수학 관련 텍스트와 코드가 혼합된 것입니다. Code Llama에 이 접근 방식을 적용하면 수학적 기능이 크게 향상된 7B 및 34B용 기본 언어 모델인 LLEMMA가 생성됩니다.

논문 주소: https://arxiv.org/pdf/2310.10631.pdf

프로젝트 주소: https://github.com/EleutherAI/math-lm

LLEMMA 7B의 4샷 수학 성능은 Google Minerva 8B의 성능을 훨씬 능가하며, LLEMMA 34B의 성능은 거의 절반의 매개변수로 Minerva 62B의 성능에 가깝습니다.

구체적으로 이 기사의 기여는 다음과 같습니다.

- 1 수학을 위한 7B 및 34B 언어 모델을 훈련하고 출시했습니다. LLEMMA 모델은 MATH에서 공개적으로 발표된 기본 모델의 최첨단 모델입니다.

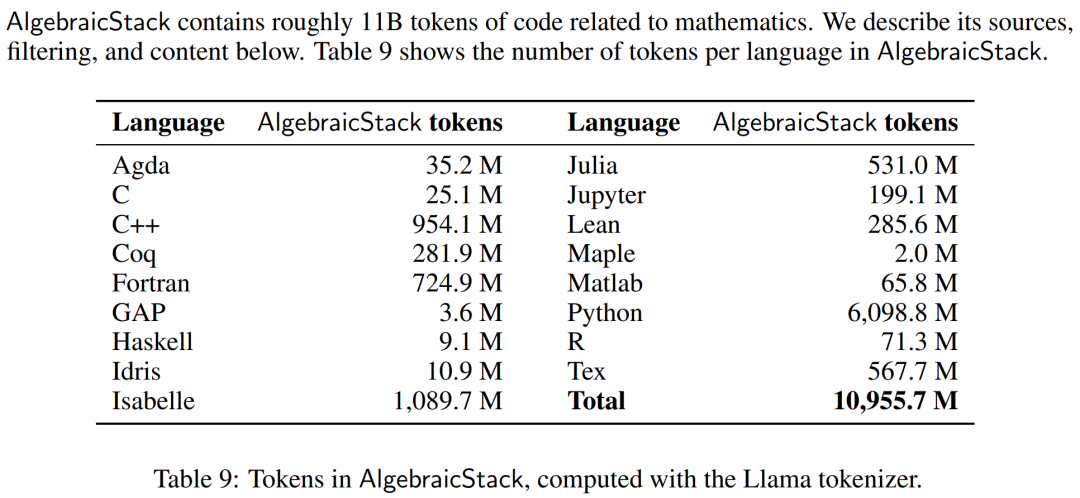

- 2. 특히 수학과 관련된 11B 코드 토큰이 포함된 데이터 세트인 AlgebraicStack을 출시했습니다.

- 3. LLEMMA가 계산 도구, 즉 Python 해석기 및 형식 정리 증명을 사용하여 수학적 문제를 해결할 수 있음을 입증했습니다.

- 4. 이전 수학적 언어 모델(예: Minerva)과 달리 LLEMMA 모델은 개방형입니다. 연구원들은 훈련 데이터와 코드를 대중에게 공개했습니다. 이는 LLEMMA를 수학적 추론에 대한 미래 연구를 위한 플랫폼으로 만듭니다.

방법 개요

LLEMMA는 수학에서 특별히 사용되는 70B 및 34B 언어 모델입니다. Proof-Pile-2에서 Llama 코드를 계속해서 사전 훈련하여 얻습니다.

DATA: Proof-Pile-2

연구원들은 55B 토큰 과학 논문인 Proof-Pile-2를 만들었습니다. 수학 코드. Proof-Pile-2의 지식 마감일은 Lean 교정 단계 하위 집합을 제외하고 2023년 4월입니다.

수치 시뮬레이션, 컴퓨터 대수 시스템, 형식 정리 증명과 같은 계산 도구는 수학자에게 점점 더 중요해지고 있습니다. 따라서 연구원들은 수치 수학, 기호 수학, 형식 수학을 다루는 17개 언어의 소스 코드가 포함된 11B 토큰 데이터 세트인 AlgebraicStack을 만들었습니다. 데이터 세트는 Stack, GitHub 공개 리포지토리 및 공식 증명 단계 데이터에서 필터링된 코드로 구성됩니다. 표 9는 AlgebraicStack의 각 언어에 대한 토큰 수를 보여줍니다.

AlgebraicStack의 각 언어에 대한 토큰 수입니다.

연구원들은 수학 콘텐츠에 대해 필터링된 고품질 웹 페이지로 구성된 15B 토큰 데이터세트인 OpenWebMath를 사용했습니다. OpenWebMath는 수학 관련 키워드 및 분류 기준 수학 점수를 기반으로 CommonCrawl 웹 페이지를 필터링하고 수학 형식(예: LATEX, AsciiMath)을 유지하며 추가 품질 필터(예: 유연성, 도메인, 길이) 및 거의 중복을 포함합니다.

또한 연구원들은 LLaMA 교육 데이터세트의 공개 변환인 RedPajama의 ArXiv 하위 집합도 사용했습니다. ArXiv 하위 집합에는 29B 청크가 포함되어 있습니다. 훈련 혼합물은 소량의 일반 도메인 데이터로 구성되며 정규화 역할을 합니다. LLaMA 2의 사전 훈련 데이터 세트는 아직 공개적으로 제공되지 않기 때문에 연구원들은 Pile을 대체 훈련 데이터 세트로 사용했습니다.

모델 및 훈련

각 모델은 Code Llama에서 초기화되고, 이는 차례로 Llama 2에서 초기화되며 디콘더 전용 변환기 구조를 사용하고 500B 코드 토큰을 사용하여 훈련으로 만들어집니다. 연구원들은 표준 자동 회귀 언어 모델링 목표를 사용하여 Proof-Pile-2에서 Code Llama 모델을 계속 훈련했습니다. 여기서 LLEMMA 7B 모델에는 2000억 개의 토큰이 있고 LLEMMA 34B 모델에는 500억 개의 토큰이 있습니다.

연구원들은 GPT-NeoX 라이브러리를 사용하여 256개의 A100 40GB GPU에서 bfloat16 혼합 정밀도로 위의 두 모델을 훈련했습니다. 그들은 LLEMMA-7B의 경우 월드 크기 2의 텐서 병렬성을 사용하고 34B의 경우 월드 크기 8의 텐서 병렬성을 사용했으며 데이터 병렬 복제본 전반에 걸쳐 ZeRO Stage 1 샤드 최적화 상태를 사용했습니다. Flash Attention 2는 처리량을 늘리고 메모리 요구 사항을 더욱 줄이는 데도 사용됩니다.

LLEMMA 7B는 글로벌 배치 크기가 400만 개 토큰이고 컨텍스트 길이가 4096개 토큰인 42,000단계에 대해 훈련되었습니다. 이는 23,000 A100시간에 해당합니다. 학습률은 500단계 후에 최대 1·10^−4까지 예열되고, 48,000단계 후에는 최대 학습률의 1/30으로 코사인 감쇄됩니다.

LLEMMA 34B는 12,000단계에 대해 학습되었으며 전역 배치 크기도 400만 개의 토큰이고 컨텍스트 길이는 4096입니다. 이는 47,000 A100시간에 해당합니다. 학습률은 500단계 후에 최대 5·10^−5까지 따뜻해진 다음 최고 학습률의 1/30으로 감소합니다.

평가 결과

실험 부분에서는 연구자들은 LLEMMA가 수학 텍스트의 기본 모델로 사용될 수 있는지 평가하는 것을 목표로 했습니다. 그들은 소수의 평가를 활용하여 LLEMMA 모델을 비교하고 감독된 수학 작업 샘플에 대해 미세 조정되지 않은 SOTA 모델에 주로 중점을 둡니다.

연구원들은 먼저 LLEMMA의 수학적 문제 해결 능력을 평가하기 위해 일련의 사고방식과 다수결 투표 방법을 사용했습니다. 평가 벤치마크에는 MATH와 GSM8k가 포함되었습니다. 그런 다음 퓨샷 도구의 사용과 정리 증명을 살펴보세요. 마지막으로 메모리와 데이터 혼합의 영향을 연구합니다.

CoT(Chains of Thoughts)를 사용하여 수학 문제 해결

이 작업에는 외부 도구 없이 LATEX 또는 자연어로 표현된 질문에 대한 독립적인 텍스트 답변을 생성하는 작업이 포함됩니다. 연구자들이 사용하는 평가 벤치마크에는 MATH, GSM8k, OCWCourses, SAT 및 MMLU-STEM이 포함됩니다.

아래 표 1에 결과가 나와 있습니다. Proof-Pile-2 코퍼스에 대한 LLEMMA의 지속적인 사전 학습은 5개의 수학적 벤치마크에서 소수 샘플 성능을 향상시켰습니다. 그 중 LLEMMA 34B는 GSM8k에서 20포인트 향상되었습니다. Code Llama보다 백분율 포인트가 높고, MATH에서는 Code Llama보다 13% 더 높습니다. 동시에 LLEMMA 7B는 독점 Minerva 모델보다 성능이 뛰어났습니다.

따라서 연구원들은 Proof-Pile-2에 대한 지속적인 사전 훈련이 사전 훈련된 모델의 수학적 문제 해결 능력을 향상시키는 데 도움이 될 수 있다고 결론지었습니다.

도구를 사용하여 수학 문제 해결

여기에는 계산 도구를 사용하여 문제를 해결하는 작업이 포함됩니다. 연구자들이 사용하는 평가 벤치마크로는 MATH+Python과 GSM8k+Python이 있습니다.

결과는 아래 표 3에 나와 있으며, LLEMMA는 두 작업 모두에서 Code Llama보다 성능이 뛰어납니다. 두 도구를 모두 사용하는 MATH 및 GSM8k의 성능도 도구를 사용하지 않을 때보다 더 좋습니다.

형식수학

Proof-Pile-2의 AlgebraicStack 데이터세트에는 Lean과 Isabelle에서 추출한 공식 증명을 포함하여 15억 개의 공식 수학 데이터 토큰이 있습니다. 형식 수학에 대한 전체 연구는 이 기사의 범위를 벗어나지만 다음 두 가지 작업에 대한 LLEMMA의 몇 번의 성능을 평가합니다.

공식 증명 작업, 즉 공식 제안, 비공식 LATEX 제안 및 비공식 LATEX 증명이 주어지면 공식 증명 작업을 생성합니다.

공식 증명 작업 , 일련의 증명 단계(또는 전략)를 생성하여 공식적인 제안을 증명합니다.

결과는 아래 표 4에 나와 있습니다. LLEMMA의 Proof-Pile-2에 대한 지속적인 사전 학습은 두 가지 형식 정리 증명 작업에서 소수 샘플 성능을 향상시켰습니다.

데이터 혼합의 영향

언어 모델을 훈련할 때 일반적인 방법은 혼합 가중치를 기반으로 훈련 데이터의 고품질 하위 집합을 업샘플링하는 것입니다. 연구자들은 신중하게 선택된 여러 혼합 가중치에 대해 짧은 훈련을 수행하여 혼합 가중치를 선택했습니다. 그런 다음 고품질의 유지 텍스트 세트에 대한 혼란을 최소화하는 혼합 가중치가 선택되었습니다(여기서는 MATH 훈련 세트가 사용되었습니다).

아래 표 5는 arXiv, 웹 및 코드와 같은 다양한 데이터 혼합으로 훈련한 후 모델의 MATH 훈련 세트 난해함을 보여줍니다.

자세한 기술적 내용과 평가 결과는 원문을 참고해주세요.

위 내용은 거의 절반에 가까운 매개변수로 성능은 Google Minerva에 가깝고, 또 다른 대규모 수학적 모델은 오픈 소스입니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!