생성 모델은 대화형 실제 시뮬레이터를 구축하는데, LeCun은 이것이 매우 멋지다고 생각합니다.

- 王林앞으로

- 2023-10-12 17:17:01786검색

인터넷 데이터를 기반으로 훈련된 생성 모델은 텍스트, 이미지 및 비디오 콘텐츠가 생성되는 방식에 혁신을 가져옵니다. 일부 연구자들은 생성 모델의 다음 이정표는 도로에서 자동차를 운전하는 방법이나 식사를 준비하는 방법과 같이 전 세계 인간 경험의 모든 측면을 시뮬레이션하는 능력이 될 것이라고 예측합니다.

요즘에는 매우 포괄적인 실제 시뮬레이터의 도움으로 인간은 다양한 장면 및 물체와 상호 작용할 수 있으며 로봇은 시뮬레이션된 경험을 통해 학습하여 물리적 손상 위험을 피할 수 있습니다.

그러나 이러한 실제 시뮬레이터를 구축하는 데 있어 주요 장애물 중 하나는 사용 가능한 데이터 세트에 있습니다. 인터넷에는 수십억 개의 텍스트, 이미지, 비디오 클립이 있지만 서로 다른 데이터 세트는 서로 다른 정보 축을 다루고 있으며 이러한 데이터 세트를 모아서 세계의 현실적인 경험을 시뮬레이션해야 합니다. 예를 들어, 쌍을 이루는 텍스트 이미지 데이터에는 풍부한 장면과 개체가 포함되어 있지만 동작은 거의 없습니다. 비디오 자막과 질문 및 답변 데이터에는 풍부한 고급 활동 설명이 포함되어 있지만 낮은 수준의 동작 세부 정보에는 풍부한 인간 동작이 포함되어 있습니다. 로봇 데이터에는 풍부한 로봇 움직임이 포함되어 있지만 그 양은 제한되어 있습니다.

위에 나열된 정보 차이는 자연스럽고 극복하기 어렵기 때문에 실제 경험을 포착하는 것을 목표로 하는 실제 시뮬레이션을 구축하기가 어렵습니다. 현실 세계의 장치는 어려움을 가져옵니다.

이 기사에서는 UC Berkeley, Google DeepMind, MIT 및 기타 기관의 연구원들이 생성 모델을 통해 실제 상호 작용을 학습하는 범용 시뮬레이터인 UniSim을 탐색하여 범용 시뮬레이터 구축의 첫 단계를 밟습니다. 예를 들어 UniSim은 "서랍 열기"와 같은 상위 수준 지침과 하위 수준 지침의 시각적 결과를 시뮬레이션하여 인간과 에이전트가 세계와 상호 작용하는 방식을 시뮬레이션할 수 있습니다.

- 논문 주소: https://arxiv.org/pdf/2310.06114.pdf

- 논문 홈페이지: https://universal-simulator.github.io/unisim/

이 문서는 대량의 데이터(인터넷 텍스트-이미지 쌍, 탐색, 인간 활동, 로봇 동작 등의 풍부한 데이터, 시뮬레이션 및 렌더링 데이터 포함)를 조건부 비디오 생성 프레임워크로 결합합니다. . 그런 다음 이 문서는 다양한 축을 따라 풍부한 데이터를 신중하게 조정함으로써 UniSim이 다양한 데이터 축의 경험을 성공적으로 병합하고 데이터를 넘어 일반화하여 정적 장면과 개체의 세밀한 모션 제어를 통해 풍부한 상호 작용을 가능하게 할 수 있음을 보여줍니다.

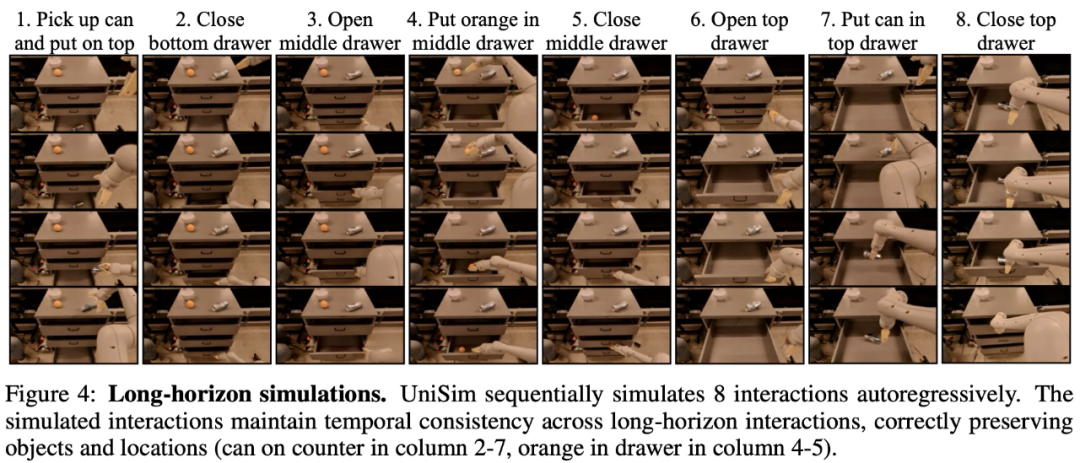

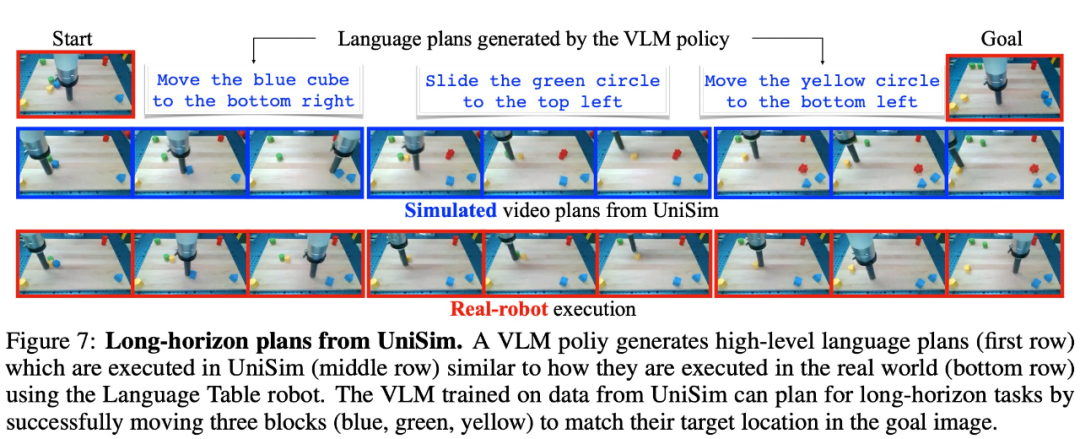

다음 비디오는 UniSim이 긴 상호 작용 범위를 사용하여 예제를 시뮬레이션하는 방법을 보여줍니다. 이 비디오는 UniSim이 로봇의 8가지 동작 명령을 한 번에 시뮬레이션하는 것을 보여줍니다.

UniSim의 인간 행동 시뮬레이션:

UniSim의 RL 전략 시뮬레이션된 배포는 다음과 같습니다.

Meta의 수석 AI 과학자 Yann LeCun, NVIDIA의 수석 연구 과학자 Jim Fan 등 업계 전문가가 이 연구를 전달했습니다. 르쿤은 이 작품에 '멋지다'라는 평가를 주었습니다

짐 팬님이 이번 작품이 매우 흥미롭다고 하셨습니다. 비디오 확산 모델은 에이전트가 로봇 하드웨어를 건드리거나 손상을 입히지 않고도 최적의 동작을 계획, 탐색 및 학습할 수 있는 데이터 기반 물리 시뮬레이션으로 사용됩니다. LLM은 운영 체제일 뿐만 아니라 완전한 현실 시뮬레이터라고 할 수 있습니다

논문의 제1저자이자 버클리 캘리포니아 대학교 박사 과정 학생인 Sherry Yang은 이렇게 말했습니다. 실제 모델을 배우는 것이 현실이 되고 있습니다.”

실제 상호 작용 시뮬레이션

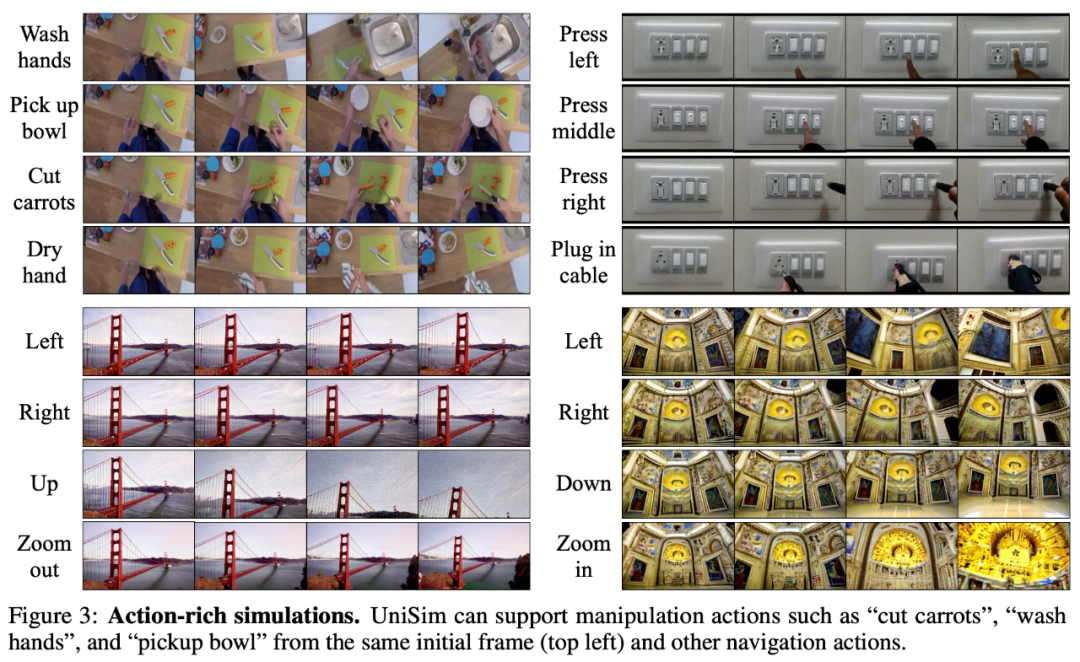

그림 3에 표시된 것처럼 UniSim은 손 씻기, 그릇 잡기, 당근 자르기, 손 말리기 등 주방 장면에서 일련의 다양한 동작을 시뮬레이션할 수 있습니다. 그림 3의 오른쪽 상단에는 서로 다른 스위치가 표시되고 그림 3의 하단에는 두 개의 탐색 장면이 표시됩니다.

아래 그림 4는 UniSim이 8개의 상호 작용을 순차적으로 자동 회귀적으로 시뮬레이션하는 장거리 시뮬레이션의 예를 보여줍니다

.

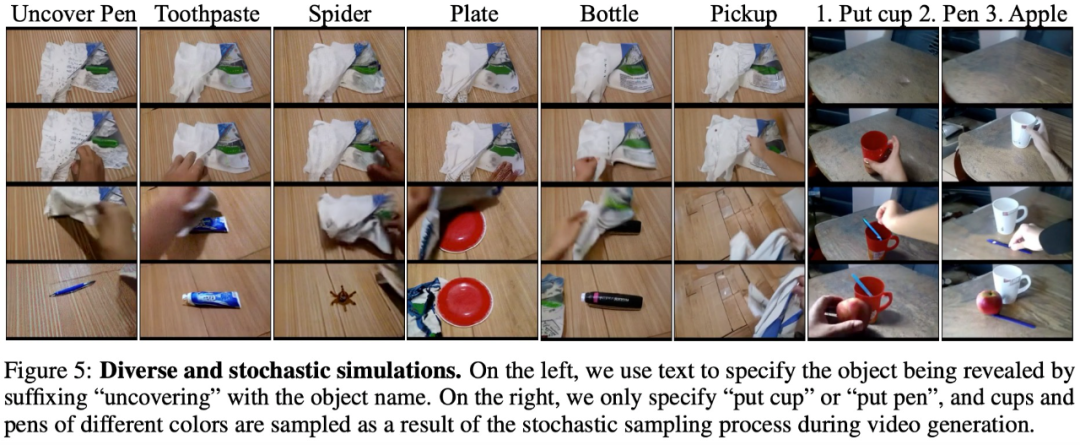

UniSim은 풍부한 액션을 지원할 뿐만 아니라 장거리 상호 작용도 매우 다양하고 무작위적인 환경 변화를 달성할 수 있습니다. 예를 들어 상단 수건을 제거한 후 표시된 개체는 다양성을 갖습니다(왼쪽 아래 그림 5 참조)

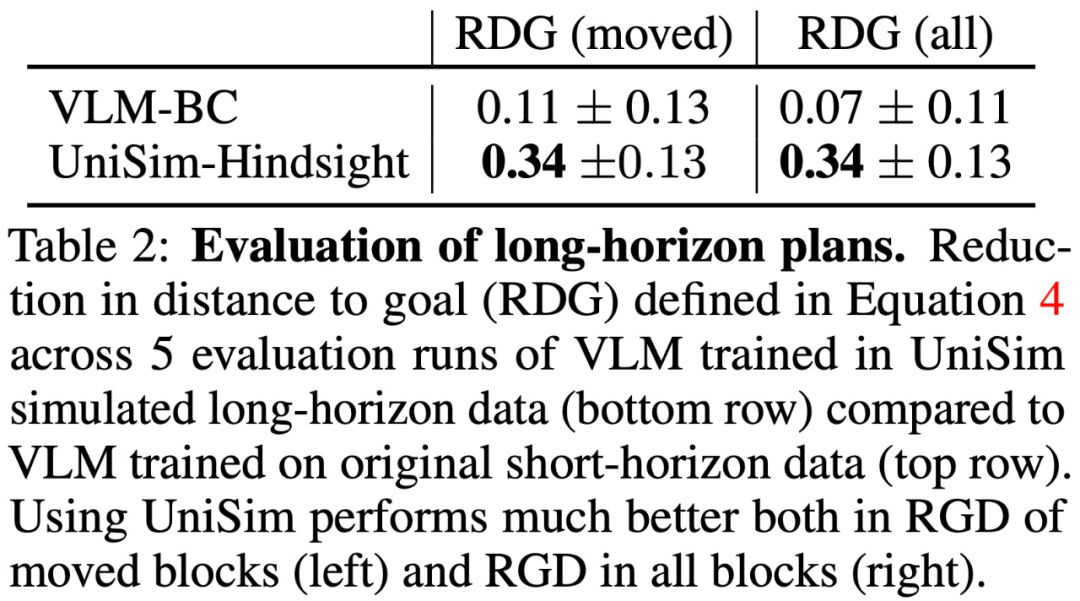

실험에서는 UniSim이 약 20~30단계로 낮은 수준의 제어 작업을 반복적으로 수행하여 끝점을 왼쪽, 오른쪽, 아래, 위로 움직이는 실제 로봇을 시뮬레이션할 때 다양한 작업을 얼마나 잘 수행하는지 평가합니다. 표 3은 RL 훈련이 다양한 작업, 특히 파란색 블록을 가리키는 것과 같은 작업에서 VLA 정책의 성능을 크게 향상시킨다는 것을 보여줍니다. 그런 다음 그림 8(하단 행)과 같이 UniSim에서 훈련된 제로샷 RL 정책을 실제 로봇에 직접 배포합니다.

위 내용은 생성 모델은 대화형 실제 시뮬레이터를 구축하는데, LeCun은 이것이 매우 멋지다고 생각합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!