다음은 RWKV 팟캐스트에 대한 내 생각의 요약입니다: https://www.php.cn/link/9bde76f262285bb1eaeb7b40c758b53e

대안의 중요성이 왜 그렇게 두드러지나요?

2023년 인공지능 혁명과 함께 Transformer 아키텍처는 현재 정점에 있습니다. 그러나 성공적인 Transformer 아키텍처를 채택하려고 서두르다 보면 배울 수 있는 대안을 간과하기 쉽습니다.

엔지니어로서 우리는 일률적인 접근 방식을 취하거나 모든 문제에 동일한 솔루션을 사용해서는 안 됩니다. 우리는 모든 상황에서 장단점을 따져봐야 합니다. 그렇지 않으면 대안이 있다는 사실을 모르고 "만족"을 느끼면서 특정 플랫폼의 한계에 갇혀 하루아침에 개발이 해방 이전 상태로 돌아갈 수 있습니다

이 문제는 인공지능 분야에만 국한된 것이 아니라, 고대부터 현재까지 반복되어 온 역사적 패턴이다.

데이터베이스 관리 시스템 간의 경쟁과 대결을 그린 SQL 전쟁의 역사를 담은 페이지입니다. 이 이야기에서는 Oracle, MySQL, SQL Server와 같은 다양한 데이터베이스 관리 시스템이 시장 점유율과 기술 우위를 놓고 치열하게 경쟁합니다. 이러한 경쟁은 성능과 기능뿐만 아니라 비즈니스 전략, 마케팅, 사용자 만족도 등 다양한 측면을 반영합니다. 이러한 데이터베이스 관리 시스템은 더 많은 사용자와 기업이 제품을 선택하도록 유도하기 위해 지속적으로 새로운 기능과 개선 사항을 도입하고 있습니다. 데이터베이스 관리 시스템 산업의 발전과 변화를 목격하고 우리에게 귀중한 경험과 교훈을 제공한 SQL 전쟁의 역사의 한 페이지

최근 소프트웨어 개발에서 주목할만한 사례는 SQL NoSQL 추세는 서버가 물리적으로 제한되기 시작하면서 나타났습니다. 전 세계의 스타트업은 "규모"라는 이유로 NoSQL로 전환하고 있지만 이러한 규모에는 미치지 못합니다.

그러나 시간이 지남에 따라 최종 일관성과 NoSQL 관리 오버헤드가 나타나고 하드웨어 기능 측면에서 엄청난 도약이 이루어집니다. SSD 속도와 용량, SQL 서버는 최근 사용 편의성으로 인해 다시 돌아왔고 현재 90% 이상의 스타트업이 충분한 확장성을 갖추고 있습니다.

SQL과 NoSQL은 서로 다른 두 가지 데이터베이스 기술입니다. SQL은 Structured Query Language의 약어로, 주로 구조화된 데이터를 처리하는 데 사용됩니다. NoSQL은 비관계형 데이터베이스를 말하며, 비정형 또는 반정형 데이터를 처리하는 데 적합합니다. 어떤 사람들은 SQL이 NoSQL보다 낫다고 생각하거나 그 반대라고 생각하지만 실제로는 각 기술마다 고유한 장단점 및 사용 사례가 있다는 의미일 뿐입니다. 어떤 경우에는 복잡한 관계형 데이터를 처리하는 데 SQL이 더 적합할 수 있는 반면, 대규모 비정형 데이터를 처리하는 데는 NoSQL이 더 적합할 수 있습니다. 그러나 이는 하나의 기술만 선택할 수 있다는 의미는 아닙니다. 실제로 많은 애플리케이션과 시스템에서는 실제로 SQL과 NoSQL의 하이브리드 솔루션을 사용합니다. 특정 요구 사항과 데이터 유형에 따라 가장 적합한 기술을 선택하여 문제를 해결할 수 있습니다. 따라서 각 기술의 특성과 적용 가능한 시나리오를 이해하고 특정 상황에 따라 현명한 선택을 하는 것이 중요합니다. SQL이든 NoSQL이든 둘 다 유사한 기술에서 학습하고 상호 교류할 수 있는 고유한 학습 포인트와 선호하는 사용 사례가 있습니다

현재의 가장 큰 문제점은 무엇입니까 Transformer 아키텍처?

일반적으로 여기에는 계산, 컨텍스트 크기, 데이터 세트 및 정렬이 포함됩니다. 이 토론에서는 계산 및 컨텍스트 길이에 중점을 둘 것입니다.

- 사용/생성된 토큰당 O(N^2) 증가로 인한 2차 계산 비용입니다. 이로 인해 100,000보다 큰 컨텍스트 크기가 매우 비싸지고 추론 및 훈련에 영향을 미칩니다.

- 현재 GPU 부족으로 인해 이 문제가 더욱 악화되고 있습니다.

- 컨텍스트 크기는 Attention 메커니즘을 제한하여 "스마트 에이전트" 사용 사례(예: smol-dev)를 심각하게 제한하고 문제에 대한 해결책을 강요합니다. 더 큰 컨텍스트에는 더 적은 해결 방법이 필요합니다.

그렇다면 이 문제를 어떻게 해결할까요?

RWKV 소개: 선형 Transformer/현대 대규모 RNN

RWKV 및 Microsoft RetNet은 "선형 변환기"라고 합니다. " 새 카테고리의 첫 번째

다음을 지원하여 위의 세 가지 제한 사항을 직접 해결합니다.

- 컨텍스트 크기와 무관한 선형 계산 비용.

- CPU(특히 ARM)에서는 요구 사항이 낮은 RNN 모드에서 합리적인 토큰/초 출력을 허용합니다.

- RNN에는 하드 컨텍스트 크기 제한이 없습니다. 문서의 모든 제한은 지침이므로 세부적으로 조정할 수 있습니다.

AI 모델을 100k 이상의 컨텍스트 크기로 계속 확장함에 따라 2차 계산 비용이 기하급수적으로 증가하기 시작합니다.

그러나 Linear Transformer는 순환 신경망 아키텍처를 포기하지 않고 병목 현상을 해결하여 강제로 교체하게 되었습니다.

그러나 새로 디자인된 RNN은 Transformer의 확장 가능한 교훈을 배웠으므로 RNN이 Transformer와 유사하게 작동하고 이러한 병목 현상을 제거할 수 있습니다.

훈련 속도 측면에서 Transformers를 다시 활용해 비슷한 성능 수준을 유지하면서 훈련에서 10억 개가 넘는 매개변수로 확장하면서 O(N) 비용으로 효율적으로 실행할 수 있습니다.

차트: 선형 변환기 계산 비용 선형 스케일링 대 토큰당 변환기의 기하급수적 증가

선형 스케일링에 정사각형 스케일링을 적용하면 2k에서 10배 이상의 성장을 얻습니다. 100,000개 토큰 길이에서 토큰 수 및 100배 이상의 성장

14B 매개변수에서 RWKV는 GPT NeoX 및 기타 데이터 세트(예: Pile)와 유사한 가장 큰 오픈 소스 선형 변환기입니다.

RWKV 모델 성능은 비슷한 크기의 기존 트랜스포머 모델과 비슷하며, 다양한 벤치마크에서 보여집니다.

하지만 간단히 말해서 이것은 무엇을 의미합니까?

장점

- 추론/훈련은 RNN에서 더 큰 컨텍스트 크기에서 Transformer보다 10배 이상 저렴합니다. 모드 아래로, 괜찮습니다. 매우 제한적으로 천천히 실행됩니다. 하드웨어

- 동일한 데이터 세트에서 Transformer와 유사한 성능

- RNN에는 기술적인 컨텍스트 크기 제한이 없습니다(무제한 컨텍스트!)

슬라이딩 윈도우 문제, 특정 지점을 넘어서는 메모리 손실

- 14B 매개변수 이상으로 확장하는 것이 입증되지 않음

- 트랜스포머 최적화 및 채택만큼 좋지 않음

- 그래서 RWKV 동안 아직 LLaMA2의 600억 개 이상의 매개변수 규모에 도달하지 않았지만 적절한 지원과 리소스를 통해 더 낮은 비용과 더 넓은 맥락에서 그렇게 할 수 있는 잠재력이 있습니다. 특히 모델이 더 작고 더 효율적인 경향이 있기 때문에

사용 사례는 효율성을 위해 중요합니다. 이를 고려하십시오. 그러나 이것이 최종 해결책은 아닙니다. 핵심은 건강한 대안에 있습니다.

우리는 다른 대안과 그 이점을 배우는 것을 고려해야 합니다.

확산 모델: 텍스트 훈련이 더 빠릅니다. 그러나 다중 에포크 훈련에는 매우 유연합니다. 이유를 알아내면 토큰 위기를 완화하는 데 도움이 될 수 있습니다.

생성적 적대 네트워크/에이전트: 데이터 세트가 없는 텍스트 기반 모델이더라도 특정 대상에 대해 필요한 훈련 세트를 훈련하는 데 기술을 사용할 수 있습니다.

원제:

RWKV 소개: 선형 변환기의 부상 및 대안 탐색

picocreator https://www.php.cn/ 링크/b433da1b32b5ca96c0ba7fcb9edba97d

위 내용은 RWKV 소개: 선형 변압기의 등장 및 대안 모색의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

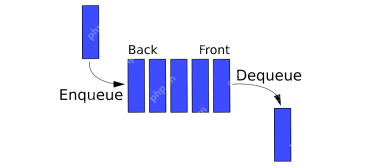

파이썬의 대기열 - 분석 VidhyaApr 16, 2025 am 10:32 AM

파이썬의 대기열 - 분석 VidhyaApr 16, 2025 am 10:32 AM소개 슈퍼마켓 대기열에서 자신을 구상하면서 좋아하는 아티스트를위한 콘서트 티켓을 구매하기 위해 회전을 기다리고 있습니다. 개인이 라인에 합류하여 첫 번째 (FIFO) 방식으로 진행하는이 순서 대비 프로세스는 PREC입니다.

AV 바이트 : AI 산업 교대 및 기술 혁신 - 분석 VidhyaApr 16, 2025 am 10:29 AM

AV 바이트 : AI 산업 교대 및 기술 혁신 - 분석 VidhyaApr 16, 2025 am 10:29 AM이번 주 AI : 주요 인수, 모델 발전 및 윤리적 고려 사항 이 AV Bytes 에디션은 지난주의 상당한 AI 혁신을 다룹니다. Google의 전략적 문자 획득에서 이는 Bitnet B1.58의 출시에 이르기까지

Movinets 탐색 : 효율적인 모바일 비디오 인식Apr 16, 2025 am 10:25 AM

Movinets 탐색 : 효율적인 모바일 비디오 인식Apr 16, 2025 am 10:25 AM소개 “Movinets Unleashed”로 매혹적인 모바일 비디오 인식의 세계로 뛰어 들자! 이 블로그는 Movinets가 모바일 장치에 대한 비디오 분석을 어떻게 변형시키는 지 탐색합니다.

팬더 대 폴라Apr 16, 2025 am 10:24 AM

팬더 대 폴라Apr 16, 2025 am 10:24 AM소개 데이터 프로젝트에서 무릎을 꿇고, 대규모 데이터 세트로 씨름하고 가능한 한 빨리 패턴을 사냥한다고 상상해보십시오. 이동 데이터 조작 도구에 도달하지만 더 나은 옵션이 존재하면 어떻게됩니까? 상대적으로 NE를 입력하십시오

IT 비즈니스 분석가의 역할Apr 16, 2025 am 10:19 AM

IT 비즈니스 분석가의 역할Apr 16, 2025 am 10:19 AM소개 혁신적인 소프트웨어를 시작하기 직전에 역동적 인 IT 회사를 구상하십시오. 흥분이 높지만 기술 개발자와 비즈니스 이해 관계자 간의 격차를 해소합니다. 이곳은 IT 비즈니스 분석가입니다

파이썬의 계승 프로그램Apr 16, 2025 am 10:13 AM

파이썬의 계승 프로그램Apr 16, 2025 am 10:13 AM소개 특정 원하는 맛 프로파일로 접시를 준비한다고 상상해보십시오. 올바른 단계의 단계가 중요합니다. 마찬가지로 수학 및 프로그래밍에서 숫자의 계승을 계산하려면 정확한 Multiplicatio의 정확한 시퀀스가 필요합니다.

데이터 오케스트레이션을위한 공기 흐름 대안 - 분석 VidhyaApr 16, 2025 am 09:55 AM

데이터 오케스트레이션을위한 공기 흐름 대안 - 분석 VidhyaApr 16, 2025 am 09:55 AM소개 Apache Airflow는 데이터 오케스트레이션의 중요한 구성 요소이며 복잡한 워크 플로우를 처리하고 데이터 파이프 라인을 자동화 할 수있는 기능으로 유명합니다. 많은 조직이 유연성과 S로 인해이를 선택했습니다.

Nvidia AI Summit 2024에 어떻게 등록 할 수 있습니까?Apr 16, 2025 am 09:49 AM

Nvidia AI Summit 2024에 어떻게 등록 할 수 있습니까?Apr 16, 2025 am 09:49 AMNvidia AI Summit 2024 : 인도의 AI 혁명에 대한 깊은 다이빙 Datahack Summit 2024에 이어 인도는 뭄바이의 Jio World Convention Center에서 10 월 23 일부터 25 일까지 예정된 Nvidia AI Summit 2024에 기어 올랐습니다. 이 중추적 인 이벤트 무도회

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

Dreamweaver Mac版

시각적 웹 개발 도구

PhpStorm 맥 버전

최신(2018.2.1) 전문 PHP 통합 개발 도구

SublimeText3 영어 버전

권장 사항: Win 버전, 코드 프롬프트 지원!

DVWA

DVWA(Damn Vulnerable Web App)는 매우 취약한 PHP/MySQL 웹 애플리케이션입니다. 주요 목표는 보안 전문가가 법적 환경에서 자신의 기술과 도구를 테스트하고, 웹 개발자가 웹 응용 프로그램 보안 프로세스를 더 잘 이해할 수 있도록 돕고, 교사/학생이 교실 환경 웹 응용 프로그램에서 가르치고 배울 수 있도록 돕는 것입니다. 보안. DVWA의 목표는 다양한 난이도의 간단하고 간단한 인터페이스를 통해 가장 일반적인 웹 취약점 중 일부를 연습하는 것입니다. 이 소프트웨어는

mPDF

mPDF는 UTF-8로 인코딩된 HTML에서 PDF 파일을 생성할 수 있는 PHP 라이브러리입니다. 원저자인 Ian Back은 자신의 웹 사이트에서 "즉시" PDF 파일을 출력하고 다양한 언어를 처리하기 위해 mPDF를 작성했습니다. HTML2FPDF와 같은 원본 스크립트보다 유니코드 글꼴을 사용할 때 속도가 느리고 더 큰 파일을 생성하지만 CSS 스타일 등을 지원하고 많은 개선 사항이 있습니다. RTL(아랍어, 히브리어), CJK(중국어, 일본어, 한국어)를 포함한 거의 모든 언어를 지원합니다. 중첩된 블록 수준 요소(예: P, DIV)를 지원합니다.