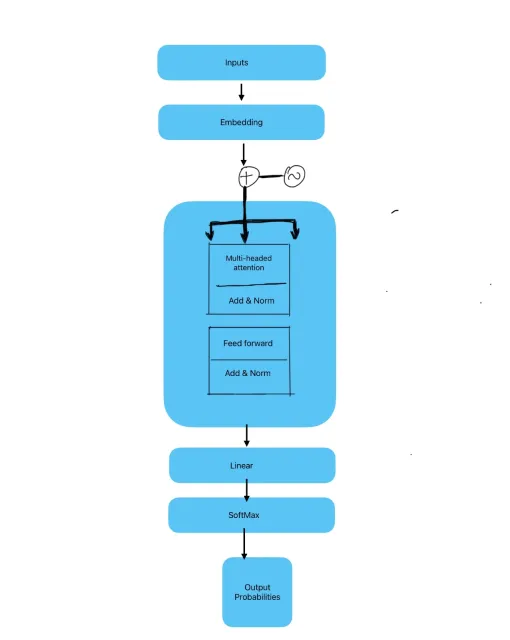

IT하우스 뉴스 6월 12일 메타는 최근 구글이 2017년 출시한 Transformer 모델을 기반으로 한 AI 언어 모델 MusicGen을 Github에 오픈소스화했습니다. 모델 이름에서 알 수 있듯이 MusicGen은 주로 음악 생성에 사용되며 텍스트와 기존 멜로디를 완전한 음악 작품으로 변환할 수 있습니다.

R&D 팀은 다음과 같이 말했습니다. “우리는 모델을 훈련하기 위해 20,000시간의 승인된 음악을 사용했고, 병렬 처리를 위해 오디오 데이터를 더 작은 단위로 분해하기 위해 Meta의 EnCodec 인코더를 사용하여 MusicGen의 컴퓨팅 효율성과 생성 속도가 모두 유사 제품보다 향상되었습니다. AI 모델.”

또한 MusicGen은 텍스트와 멜로디의 결합 입력도 지원합니다. 예를 들어 "가벼운 트랙"을 생성하도록 제안하는 동시에 "베토벤의 "환희의 송가"와 결합"을 요청할 수 있습니다.

R&D팀에서는 뮤직젠의 실제 성능도 테스트했습니다. 결과에 따르면 Google의 MusicLM 및 Riffusion, Mousai, Noise2Music과 같은 다른 음악 모델과 비교할 때 MusicGen은 음악과 텍스트 프롬프트의 일치, 구성의 신뢰성과 같은 테스트 지표에서 더 나은 성능을 발휘하며 전체적으로 Google보다 약간 더 높습니다. 뮤직LM 수준.

Meta는 이 모델의 상업적 사용을 허용했으며 Huggingface에 데모 웹 애플리케이션을 출시했습니다.

IT Home에 모델 주소 첨부: 이동하려면 여기를 클릭하세요

데모 신청 주소: 여기를 클릭하여 이동하세요

위 내용은 Meta의 오픈 소스 AI 언어 모델 MusicGen은 텍스트와 멜로디를 완전한 음악 작품으로 변환할 수 있습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

Datagemma : 환각에 대한 LLM 접지 - 분석 VidhyaApr 12, 2025 am 09:46 AM

Datagemma : 환각에 대한 LLM 접지 - 분석 VidhyaApr 12, 2025 am 09:46 AM소개 대형 언어 모델은 빠르게 변화하는 산업을 변화시키고 있습니다. 대도는 뱅킹의 개인화 된 고객 서비스에서 글로벌 커뮤니케이션에서 실시간 언어 번역에 이르기까지 모든 것을 권장합니다. 그들은 퀘스트에 대답 할 수 있습니다

Crewai 및 Ollama로 다중 에이전트 시스템을 구축하는 방법?Apr 12, 2025 am 09:44 AM

Crewai 및 Ollama로 다중 에이전트 시스템을 구축하는 방법?Apr 12, 2025 am 09:44 AM소개 API에 돈을 쓰고 싶지 않거나 개인 정보에 대해 걱정하고 있습니까? 아니면 LLMS를 현지에서 실행하고 싶습니까? 괜찮아요; 이 안내서는 로컬 LLMS를 사용하여 에이전트 및 다중 에이전트 프레임 워크를 구축하는 데 도움이됩니다.

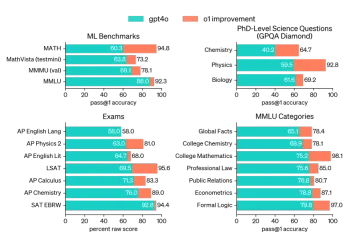

AV 바이트 : OpenAI ' S O1 모델, Apple ' s Visual AI 및 More -Analytics VidhyaApr 12, 2025 am 09:38 AM

AV 바이트 : OpenAI ' S O1 모델, Apple ' s Visual AI 및 More -Analytics VidhyaApr 12, 2025 am 09:38 AM소개 이번 주에는 인공 지능 세계 (AI)의 주요 업데이트가 가득했습니다. OpenAi의 O1 모델에서 고급 추론을 보여주는 Apple의 획기적인 시각 정보 기술, 기술

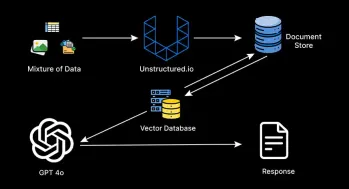

생산 등급 에이전트 헝겊 파이프 라인을 모니터링하는 방법은 무엇입니까?Apr 12, 2025 am 09:34 AM

생산 등급 에이전트 헝겊 파이프 라인을 모니터링하는 방법은 무엇입니까?Apr 12, 2025 am 09:34 AM소개 2022 년에 Chatgpt의 출시는 기술 및 비 기술 산업 모두에 혁명을 일으켜 개인과 조직에 생성 AI를 제공했습니다. 2023 년 내내 노력은 큰 언어 모드를 활용하는 데 집중했습니다

스타 스키마로 데이터웨어 하우스를 최적화하는 방법은 무엇입니까?Apr 12, 2025 am 09:33 AM

스타 스키마로 데이터웨어 하우스를 최적화하는 방법은 무엇입니까?Apr 12, 2025 am 09:33 AMStar Schema는 데이터웨어 하우징 및 비즈니스 인텔리전스에 사용되는 효율적인 데이터베이스 설계입니다. 주변 치수 테이블에 연결된 중앙 사실 테이블로 데이터를 구성합니다. 이 별 모양의 구조는 복잡한 q를 단순화합니다

멀티 모달 헝겊 시스템 구축에 대한 포괄적 인 안내서Apr 12, 2025 am 09:29 AM

멀티 모달 헝겊 시스템 구축에 대한 포괄적 인 안내서Apr 12, 2025 am 09:29 AMRag Systems로 더 잘 알려진 검색 증강 생성 시스템은 값 비싼 미세 튜닝의 번거 로움없이 맞춤형 엔터프라이즈 데이터에 대한 질문에 답하는 지능형 AI 보조원을 구축하는 데 필요한 표준이되었습니다.

에이전트 래그 시스템이 기술을 어떻게 변화시킬 수 있습니까?Apr 12, 2025 am 09:21 AM

에이전트 래그 시스템이 기술을 어떻게 변화시킬 수 있습니까?Apr 12, 2025 am 09:21 AM소개 인공 지능은 새로운 시대에 들어 왔습니다. 모델이 사전 정의 된 규칙에 따라 정보를 단순히 출력하는 시대는 지났습니다. 오늘 AI의 최첨단 접근 방식은 Rag를 중심으로 진행됩니다 (검색-augmente

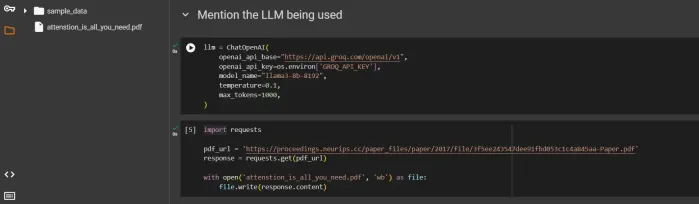

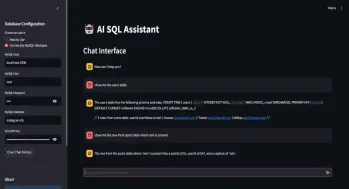

자동 생성 쿼리에 대한 SQL 어시스턴트Apr 12, 2025 am 09:13 AM

자동 생성 쿼리에 대한 SQL 어시스턴트Apr 12, 2025 am 09:13 AM단순히 데이터베이스와 대화하고, 일반 언어로 질문을하고, 복잡한 SQL 쿼리를 작성하거나 스프레드 시트를 정렬하지 않고 즉각적인 답변을받을 수 있기를 바랐습니까? Langchain의 SQL 툴킷으로 Groq a

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

Atom Editor Mac 버전 다운로드

가장 인기 있는 오픈 소스 편집기

맨티스BT

Mantis는 제품 결함 추적을 돕기 위해 설계된 배포하기 쉬운 웹 기반 결함 추적 도구입니다. PHP, MySQL 및 웹 서버가 필요합니다. 데모 및 호스팅 서비스를 확인해 보세요.

ZendStudio 13.5.1 맥

강력한 PHP 통합 개발 환경

에디트플러스 중국어 크랙 버전

작은 크기, 구문 강조, 코드 프롬프트 기능을 지원하지 않음

SecList

SecLists는 최고의 보안 테스터의 동반자입니다. 보안 평가 시 자주 사용되는 다양한 유형의 목록을 한 곳에 모아 놓은 것입니다. SecLists는 보안 테스터에게 필요할 수 있는 모든 목록을 편리하게 제공하여 보안 테스트를 더욱 효율적이고 생산적으로 만드는 데 도움이 됩니다. 목록 유형에는 사용자 이름, 비밀번호, URL, 퍼징 페이로드, 민감한 데이터 패턴, 웹 셸 등이 포함됩니다. 테스터는 이 저장소를 새로운 테스트 시스템으로 간단히 가져올 수 있으며 필요한 모든 유형의 목록에 액세스할 수 있습니다.