목표물 탐지는 컴퓨터 비전에서 매우 중요한 기본 작업입니다. 일반적인 이미지 분류/인식 작업과 달리 목표물 탐지는 모델이 주어진 목표 범주 위에 목표물의 위치 및 크기 정보를 추가로 제공해야 합니다. CV의 주요 업무(식별, 탐지, 세분화)는 과거와 다음을 연결하는 핵심적 위치에 있습니다.

현재 인기 있는 다중 모드 GPT-4는 시각적 기능 측면에서 표적 인식 기능만 가지며 더 어려운 표적 탐지 작업을 완료할 수 없습니다. 이미지 또는 비디오에서 객체의 카테고리, 위치 및 크기 정보를 인식하는 것은 자율 주행의 보행자 및 차량 인식, 보안 모니터링 애플리케이션의 얼굴 잠금, 의료 영상 분석 등 실제 생산에서 많은 인공 지능 애플리케이션의 핵심입니다. , 등.

YOLO 시리즈, R-CNN 시리즈 및 기타 표적 탐지 알고리즘과 같은 기존 표적 탐지 방법은 과학 연구자들의 지속적인 노력으로 높은 표적 탐지 정확도와 효율성을 달성했습니다. 그러나 기존 방법은 사전 테스트가 필요하기 때문입니다. 모델 학습 학습 세트 외부의 타겟을 감지할 수 없도록 감지할 타겟 세트(폐쇄 세트)만 정의하면 됩니다. 예를 들어, 얼굴 감지를 위해 트레이닝된 모델은 차량 감지에 사용할 수 없습니다. 레이블이 지정된 데이터의 경우 탐지할 대상 카테고리를 추가하거나 수정해야 하는 경우 훈련 데이터에 레이블을 다시 지정하고 모델을 다시 지정해야 합니다. - 시간이 많이 걸리고 노동집약적인 훈련입니다.

가능한 해결책은 대규모 이미지를 수집하고 Box 정보 및 의미 정보에 수동으로 라벨을 지정하는 것입니다. 그러나 이를 위해서는 라벨링 비용이 매우 높으며, 탐지 모델을 교육하기 위해 대규모 데이터를 사용하는 것도 과학 연구자들에게 다음과 같은 과제를 제기합니다. 데이터의 롱테일 분포와 수동 주석의 불안정한 품질은 감지 모델의 성능에 영향을 미칩니다.

CVPR 2021에 게재된 OVR-CNN[1] 기사에서는 새로운 표적 탐지 패러다임인 Open-Vocabulary 탐지(OVD, 오픈 월드 표적 탐지라고도 함)를 제안합니다. 위에서 언급한 문제는 다음과 같은 탐지 시나리오입니다. 오픈 월드의 알려지지 않은 물체.

OVD는 주석이 달린 데이터의 양을 수동으로 확장하지 않고도 대상의 수와 범주를 식별하고 찾을 수 있는 기능으로 인해 제안된 이후 학계와 업계의 지속적인 관심을 끌었으며, 전통적인 대상 탐지에도 큰 성공을 가져왔습니다. 새로운 활력과 새로운 도전을 불러일으키며, 향후 표적탐지의 새로운 패러다임이 될 것으로 기대됩니다.

특히 OVD 기술은 알 수 없는 카테고리에 대한 감지 모델의 감지 기능을 향상시키기 위해 대규모 이미지에 대한 수동 주석을 요구하지 않습니다. 대신 클래스에 구애받지 않는 영역 감지기와 대규모 이미지를 결합합니다. 레이블이 지정되지 않은 데이터에 대해 훈련된 모델이 결합되어 이미지 영역 기능의 교차 모달 정렬과 감지할 대상에 대한 설명 텍스트를 통해 개방형 대상을 이해하는 대상 감지 모델의 기능을 확장합니다.

CLIP [2], ALIGN [3], R2D2 [4] 등과 같이 최근 크로스모달 및 멀티모달 대형 모델 작업이 매우 빠르게 발전했으며 이들의 개발도 OVD의 탄생을 촉진했습니다. 및 OVD 분야 관련 작업의 신속한 반복 및 진화.

OVD 기술에는 두 가지 핵심 문제의 해결 방법이 포함됩니다. 1) 지역 정보와 교차 모달 대형 모델 간의 적응을 개선하는 방법 2) 새로운 범주 능력에 대한 범범주 대상 탐지기의 일반화를 개선하는 방법. 이 두 가지 관점에서 OVD 분야의 일부 관련 작업을 아래에서 자세히 소개합니다.

OVD 기본 프로세스 다이어그램 [1]

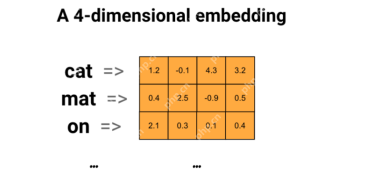

OVD 기본 개념: OVD 사용에는 주로 퓨샷과 제로샷, 퓨샷이라는 두 가지 주요 시나리오가 포함됩니다. 이는 수동으로 레이블이 지정된 소수의 훈련 샘플이 있는 대상 범주를 나타내고, 제로 샷은 수동으로 레이블이 지정된 훈련 샘플이 없는 대상 범주를 나타냅니다. 일반적으로 사용되는 학술 평가 데이터 세트인 COCO와 LVIS에서는 데이터 세트를 Base 클래스와 Novel 클래스로 구분하는데, Base 클래스는 Few-Shot 시나리오에 해당하고 Novel 클래스는 Zero-Shot 시나리오에 해당합니다. 예를 들어 COCO 데이터 세트에는 65개의 카테고리가 포함되어 있으며 일반적인 평가 설정은 기본 세트에 48개의 카테고리가 포함되어 있으며 이 48개의 카테고리만 소수 훈련에 사용됩니다. Novel 세트에는 훈련 중에 전혀 보이지 않는 17개의 범주가 포함되어 있습니다. 테스트 지표는 주로 Novel 클래스의 AP50 값을 참조하여 비교합니다.

논문 1: 캡션을 사용한 개방형 어휘 개체 감지

- 논문 주소: https://arxiv.org/pdf/2011.10678.pdf

- 코드 주소: https://github.com/alirezazareian/ovr-cnn

OVR-CNN은 CVPR 2021의 Oral-Paper이자 OVD 분야의 선구적인 작업입니다. 2단계 교육 패러다임은 이후의 많은 OVD 작업에 영향을 미쳤습니다. 아래 그림에서 볼 수 있듯이 첫 번째 단계에서는 주로 이미지-캡션 쌍을 사용하여 시각적 인코더를 사전 학습하며 BERT(고정 매개변수)를 사용하여 단어 마스크를 생성하고 약한 감독 접지 매칭은 ImageNet이 로드된 ResNet50으로 수행됩니다. 사전 훈련된 가중치로 인해 저자는 약한 감독으로 인해 매칭이 로컬 최적성에 빠지게 된다고 생각하므로 견고성을 높이기 위해 단어 마스크 예측을 위해 다중 모드 변환기가 추가됩니다.

두 번째 단계의 학습 과정은 Faster-RCNN과 유사하지만, 차이점은 첫 번째 단계에서 사전 학습을 통해 얻은 ResNet50의 1~3개 레이어에서 특징 추출을 수행한다는 점입니다. ResNet50은 RPN 이후에도 여전히 사용됩니다. 네 번째 계층은 기능 처리를 수행한 다음 각각 Box 회귀 및 분류 예측에 기능을 사용합니다. 분류 예측은 OVD 작업이 기존 탐지와 다르다는 것을 나타내는 핵심 신호입니다. OVR-CNN에서는 1단계 학습을 통해 얻은 V2L 모듈(그래프 벡터에서 고정 매개변수가 있는 단어 벡터 모듈)에 특징을 입력하여 그림을 얻습니다. 그리고 텍스트 벡터는 레이블 단어 벡터와 결합됩니다. 카테고리를 일치시키고 예측합니다. 2단계 훈련에서는 Base 클래스를 주로 사용하여 검출기 모델에 대한 상자 회귀 훈련과 카테고리 매칭 훈련을 수행합니다. V2L 모듈은 항상 고정되어 있기 때문에 표적 탐지 모델의 포지셔닝 기능과 협력하여 새로운 범주로 마이그레이션함으로써 탐지 모델이 새로운 범주의 표적을 식별하고 찾을 수 있습니다.

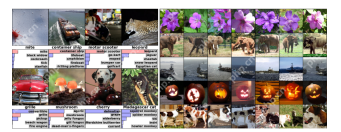

아래 그림에서 볼 수 있듯이 COCO 데이터 세트에서 OVR-CNN의 성능은 이전 Zero-shot 객체 감지 알고리즘을 훨씬 능가합니다.

논문 2: 지역 기반 언어 이미지 사전 훈련

- 논문 주소: https://arxiv.org/abs/ .09106

- 코드 주소: https://github.com/microsoft/RegionCLIP

OVR-CNN은 iamge-text 쌍의 사전 훈련을 위해 BERT 및 다중 모달 Transfomer를 사용하지만 대규모 교차 모달을 사용합니다. 모델 연구가 증가함에 따라 과학 연구자들은 OVD 작업을 훈련하기 위해 CLIP 및 ALIGN과 같은 보다 강력한 교차 모드 대형 모델을 사용하기 시작했습니다. 검출기 모델 자체는 주로 제안서, 즉 지역 정보를 분류하고 식별하는 데 목적이 있습니다. CVPR 2022에 발표된 RegionCLIP [5]에서는 현재 CLIP과 같은 기존 대형 모델의 자르기 영역에 대한 분류 능력이 훨씬 낮은 것으로 나타났습니다. 이를 개선하기 위해 RegionCLIP은 새로운 2단계 OVD 방식을 제안합니다.

첫 번째 단계에서 데이터 세트는 지역 수준의 증류 사전 학습을 위해 주로 CC3M, COCO 캡션 및 기타 이미지 및 텍스트 매칭 데이터 세트를 사용합니다. 구체적으로:

1. 긴 텍스트에 원래 존재했던 단어를 추출하여 개념 풀을 형성하고, 추가로 훈련을 위해 지역에 대한 간단한 설명 세트를 형성합니다.

2. LVIS 사전 훈련을 기반으로 한 RPN을 사용하여 제안 영역을 추출하고, 원본 CLIP을 사용하여 추출된 다양한 영역을 준비된 설명과 일치 및 분류하고, 위조된 의미 라벨로 추가로 조립합니다.

3. 준비된 Proposal Region과 Semantic Label을 이용하여 새로운 CLIP 모델에 대한 Region-text 비교 학습을 진행하여 Region 정보에 특화된 CLIP 모델을 획득합니다.

4 사전 학습에서 새로운 CLIP 모델은 증류 전략을 통해 원본 CLIP의 분류 능력도 학습하고, 새로운 CLIP 모델의 표현력을 유지하기 위해 전체 이미지 수준에서 이미지-텍스트 비교 학습을 수행합니다. 완전한 이미지 능력.

두 번째 단계에서는 획득한 사전 훈련된 모델을 전이 학습을 위한 탐지 모델로 전송합니다.

RegionCLIP은 기존 감지 모델에서 기존 교차 모달 대형 모델의 표현 기능을 더욱 확장하고 아래 그림에서 볼 수 있듯이 Novel 카테고리에서 OVR-CNN보다 더 나은 성능을 달성합니다. 큰 발전을 이루었습니다. RegionCLIP은 1단계 사전 훈련을 통해 지역 정보와 다중 모드 대형 모델 간의 적응성을 효과적으로 향상시킵니다. 그러나 CORA는 1단계 훈련을 위해 더 큰 매개변수 규모를 갖춘 더 큰 교차 모달 대형 모델을 사용할 때 훈련 비용이 매우 높아요.

문서 3: CORA: 영역 프롬프트 및 앵커 사전 일치를 사용한 개방형 어휘 감지를 위한 CLIP 적응

- 논문 주소: https://arxiv .org/abs/2303.13076

- 코드 주소: https://github.com/tgxs002/CORA

CORA [6]는 현재의 OVD를 극복하기 위해 CVPR 2023에 포함되었습니다. 작업이 직면한 두 가지 장애물을 해결하기 위해 DETR과 유사한 OVD 모델이 설계되었습니다. 기사 제목에서 볼 수 있듯이 모델에는 주로 Region Prompting과 Anchor Pre-Matching이라는 두 가지 전략이 포함됩니다. 전자는 Prompt 기술을 사용하여 CLIP 기반 지역 분류기에서 추출한 지역 특징을 최적화하여 전체와 지역 간의 분포 격차를 완화합니다. 후자는 DETR 탐지 방법에서 앵커 포인트 사전 일치 전략을 사용하여 OVD를 향상시킵니다. 새로운 유형의 객체를 배치하는 모델의 능력.

CLIP 원본 비주얼 인코더의 전체 이미지 특징과 지역적 특징 사이에 분포 격차가 있어 결과적으로 검출기의 분류 정확도가 낮아집니다(이는 RegionCLIP의 시작점과 유사합니다) ). 따라서 CORA에서는 CLIP 이미지 인코더에 적응하고 지역 정보의 분류 성능을 향상시키기 위해 Region Prompting을 제안합니다. 구체적으로 전체 영상은 먼저 CLIP 인코더의 처음 3개 레이어를 통해 특징 맵으로 인코딩된 후 RoI Align을 통해 앵커 박스 또는 예측 박스가 생성되어 지역 특징으로 병합됩니다. 그런 다음 CLIP 이미지 인코더의 네 번째 계층에 의해 인코딩됩니다. 전체 이미지 기능 맵과 CLIP 이미지 인코더의 지역 기능 간의 분포 격차를 완화하기 위해 학습 가능한 지역 프롬프트를 설정하고 네 번째 레이어에서 출력된 기능과 결합하여 텍스트 기능과 함께 사용할 최종 지역 기능을 생성합니다. 매칭을 위해 매칭 손실은 순진한 교차 엔트로피 손실을 사용하며, CLIP과 관련된 매개변수 모델은 훈련 과정에서 모두 고정됩니다.

CORA는 DETR과 유사한 DETR 유사 검출기 모델로, 앵커 사전 일치 전략을 사용하여 상자 회귀 훈련을 위해 후보 상자를 미리 생성합니다. 특히, 앵커 사전 일치는 각 레이블 상자를 가장 가까운 앵커 상자 세트와 일치시켜 어떤 앵커 상자가 양성 샘플로 간주되어야 하고 어떤 앵커 상자가 음성 샘플로 간주되어야 하는지 결정합니다. 이 매칭 프로세스는 일반적으로 IoU(Intersection-over-Union Ratio)를 기반으로 합니다. 앵커 박스와 라벨 박스 사이의 IoU가 미리 정의된 임계값을 초과하면 양성 샘플로 간주되고, 그렇지 않으면 음성 샘플로 간주됩니다. CORA는 이 전략이 새로운 카테고리에 대한 현지화 능력의 일반화를 효과적으로 향상시킬 수 있음을 보여줍니다.

그러나 앵커 사전 일치 메커니즘을 사용하면 몇 가지 문제가 발생할 수도 있습니다. 예를 들어 하나 이상의 앵커 상자가 레이블 상자와 일치하는 경우에만 훈련이 정상적으로 수행될 수 있습니다. 그렇지 않으면 레이블 상자가 무시되어 모델 수렴이 방지됩니다. 또한, 라벨 박스가 보다 정확한 기준점 박스를 획득하더라도 지역 분류기의 제한된 인식 정확도로 인해 라벨 박스가 여전히 무시될 수 있습니다. 즉, 라벨 박스에 해당하는 카테고리 정보가 정렬되지 않습니다. CLIP 훈련을 기반으로 한 지역 분류기. 따라서 CORA는 CLIP-Aligned 기술을 사용하여 CLIP의 의미 인식 기능과 사전 훈련된 ROI의 위치 지정 기능을 활용하여 더 적은 인력으로 훈련 데이터 세트의 이미지에 레이블을 다시 지정할 수 있습니다. 훈련 더 많은 태그 상자를 일치시킵니다.

RegionCLIP과 비교하여 CORA는 COCO 데이터 세트에서 AP50 값을 2.4 더 향상시킵니다.

요약 및 전망

OVD 기술은 현재 인기 있는 크로스/멀티모달 대형 모델의 개발과 밀접한 관련이 있을 뿐만 아니라 표적 탐지 분야의 과거 과학 연구자들의 기술 축적을 계승하고 있습니다. 전통적인 AI 기술과 지향적인 AI 종합역량 연구의 성공적인 융합. OVD는 미래를 향한 새로운 표적 탐지 기술입니다. 모든 표적을 탐지하고 위치를 찾는 OVD의 능력은 결국 다중 모드 대형 모델의 추가 개발을 촉진하고 다중 모드 AGI의 중요한 초석이 될 것으로 예상됩니다. 개발 중. 현재 다중 모드 대형 모델의 훈련 데이터 소스는 인터넷에 있는 수많은 대략적인 정보 쌍, 즉 텍스트-이미지 쌍 또는 텍스트-음성 쌍입니다. OVD 기술을 사용하여 원본 대략적인 이미지 정보를 정확하게 찾고 이미지의 의미 정보를 예측하여 코퍼스를 필터링하는 데 도움을 준다면 대형 모델 사전 학습 데이터의 품질이 더욱 향상되어 표현 및 이해 능력이 최적화될 것입니다. 대형 모델의.

좋은 예가 SAM(Segment Anything)[7]입니다. SAM은 과학 연구자들이 일반 시각적 대형 모델의 미래 방향을 볼 수 있게 해줄 뿐만 아니라 많은 생각을 촉발시킵니다. OVD 기술이 SAM과 잘 연계되어 SAM의 의미론적 이해 능력을 향상시키고 SAM이 요구하는 박스 정보를 자동으로 생성함으로써 인력을 더욱 해방시킬 수 있다는 점은 주목할 만합니다. AIGC(인공지능 생성 콘텐츠)의 경우에도 마찬가지로 OVD 기술은 사용자와의 상호 작용 기능을 향상시킬 수 있습니다. 예를 들어 사용자가 사진에서 특정 대상을 지정하여 변경하거나 대상에 대한 설명을 생성해야 하는 경우 이를 수행할 수 있습니다. OVD의 언어 이해 기능과 OVD의 알려지지 않은 대상 감지 기능을 활용하여 사용자가 설명하는 개체를 정확하게 찾아 고품질의 콘텐츠 생성을 달성합니다. 현재 OVD 분야 관련 연구가 활발히 진행되고 있으며, OVD 기술이 향후 일반 AI 대형 모델에 가져올 변화도 기대해 볼 만하다.

위 내용은 대규모 데이터에 라벨을 붙일 필요 없이 표적 탐지 OVD의 새로운 패러다임은 다중 모드 AGI를 한 단계 더 발전시킵니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

Monsterapi로 대형 언어 모델을 미세 조정하는 방법Apr 19, 2025 am 10:49 AM

Monsterapi로 대형 언어 모델을 미세 조정하는 방법Apr 19, 2025 am 10:49 AMMonsterapi와 함께 미세 조정 된 LLM의 힘을 활용 : 포괄적 인 가이드 가상 어시스턴트가 귀하의 요구를 완벽하게 이해하고 기대한다고 상상해보십시오. LLMS (Lange Models)의 발전 덕분에 이것은 현실이되고 있습니다. 그러나 a

5 통계 테스트 모든 데이터 과학자가 알아야 할 모든 데이터 - 분석 VidhyaApr 19, 2025 am 10:27 AM

5 통계 테스트 모든 데이터 과학자가 알아야 할 모든 데이터 - 분석 VidhyaApr 19, 2025 am 10:27 AM데이터 과학의 필수 통계 테스트 : 포괄적 인 가이드 데이터 과학에서 가치있는 통찰력을 잠금 해제하는 것이 가장 중요합니다. 통계 테스트를 마스터하는 것은이를 달성하는 데 필수적입니다. 이 테스트는 데이터 과학자들이 엄격하게 발전 할 수 있도록 권한을 부여합니다

Florence -2를 사용하여 컴퓨터 비전 작업을 수행하는 방법 -Raletics VidhyaApr 19, 2025 am 10:21 AM

Florence -2를 사용하여 컴퓨터 비전 작업을 수행하는 방법 -Raletics VidhyaApr 19, 2025 am 10:21 AM소개 원래 변압기의 도입은 현재 큰 언어 모델의 길을 열었습니다. 유사하게, 변압기 모델이 도입 된 후, Vision Transformer (VIT)가 도입되었다. 처럼

Langchain 텍스트 스플리터를 사용하여 데이터를 분할하는 7 가지 방법 - 분석 VidhyaApr 19, 2025 am 10:11 AM

Langchain 텍스트 스플리터를 사용하여 데이터를 분할하는 7 가지 방법 - 분석 VidhyaApr 19, 2025 am 10:11 AMLangchain 텍스트 스플리터 : 효율성과 정확도를위한 LLM 입력 최적화 이전 기사는 Langchain의 문서 로더를 다루었습니다. 그러나 LLM에는 컨텍스트 창 크기 제한이 있습니다 (토큰으로 측정). 이 한계를 초과하면 데이터가 잘립니다

무료 생성 AI 과정 : 혁신의 미래를 개척합니다Apr 19, 2025 am 10:01 AM

무료 생성 AI 과정 : 혁신의 미래를 개척합니다Apr 19, 2025 am 10:01 AM생성 AI : 창의성과 혁신 혁명 생성 AI는 버튼을 터치 할 때 텍스트, 이미지, 음악 및 가상 세계를 만들어 산업을 변화시키고 있습니다. 그 영향은 비디오 편집, 음악 제작, 예술, 엔터테인먼트, hea에 걸쳐 있습니다.

Universal Sentence Encoder 및 Wikiqa가있는 QA 모델 만들기Apr 19, 2025 am 10:00 AM

Universal Sentence Encoder 및 Wikiqa가있는 QA 모델 만들기Apr 19, 2025 am 10:00 AM고급 질문 답변을위한 모델 임베딩의 힘을 활용 오늘날의 정보가 풍부한 세상에서 정확한 답변을 즉시 얻는 능력이 가장 중요합니다. 이 기사는

Top 10은 기계 학습 연구 논문을 읽어야합니다Apr 19, 2025 am 09:53 AM

Top 10은 기계 학습 연구 논문을 읽어야합니다Apr 19, 2025 am 09:53 AM이 기사는 인공 지능 (AI)과 머신 러닝 (ML)에 혁명을 일으킨 10 가지 주요 간행물을 살펴 봅니다. 우리는 신경망과 알고리즘의 최근의 혁신을 조사하여 현대 AI를 주도하는 핵심 개념을 설명합니다. th

SEO 대행사를 대체하기위한 11 대의 AI 도구 - 분석 VidhyaApr 19, 2025 am 09:49 AM

SEO 대행사를 대체하기위한 11 대의 AI 도구 - 분석 VidhyaApr 19, 2025 am 09:49 AMAI의 SEO 상승 : SEO 대행사를 능가하기위한 11 개의 도구 AI의 빠른 발전은 SEO 환경을 크게 재구성했습니다. 최고의 검색 엔진 순위를 목표로하는 기업은 AI의 힘을 활용하여 온라인 전략을 최적화하고 있습니다. AU에서

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

Dreamweaver Mac版

시각적 웹 개발 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

mPDF

mPDF는 UTF-8로 인코딩된 HTML에서 PDF 파일을 생성할 수 있는 PHP 라이브러리입니다. 원저자인 Ian Back은 자신의 웹 사이트에서 "즉시" PDF 파일을 출력하고 다양한 언어를 처리하기 위해 mPDF를 작성했습니다. HTML2FPDF와 같은 원본 스크립트보다 유니코드 글꼴을 사용할 때 속도가 느리고 더 큰 파일을 생성하지만 CSS 스타일 등을 지원하고 많은 개선 사항이 있습니다. RTL(아랍어, 히브리어), CJK(중국어, 일본어, 한국어)를 포함한 거의 모든 언어를 지원합니다. 중첩된 블록 수준 요소(예: P, DIV)를 지원합니다.

안전한 시험 브라우저

안전한 시험 브라우저는 온라인 시험을 안전하게 치르기 위한 보안 브라우저 환경입니다. 이 소프트웨어는 모든 컴퓨터를 안전한 워크스테이션으로 바꿔줍니다. 이는 모든 유틸리티에 대한 액세스를 제어하고 학생들이 승인되지 않은 리소스를 사용하는 것을 방지합니다.

Eclipse용 SAP NetWeaver 서버 어댑터

Eclipse를 SAP NetWeaver 애플리케이션 서버와 통합합니다.