ChatGPT가 질문에 답변하면 한 단어씩 팝업되어 사람들에게 진지하게 생각하는 느낌을 줍니다.

이 대화의 기본 내용은 다음과 같습니다.

Q: 대규모 언어 생성 모델은 어떻게 작동하나요?

A: 대규모 언어 생성 모델(예: GPT-3)은 딥 러닝 기술을 기반으로 하는 신경망입니다. 모델. 이러한 모델은 자연어 처리 분야에서 큰 성공을 거둔 "Transformer"라는 아키텍처를 사용하는 경우가 많습니다.대규모 언어 생성 모델의 작동 방식에 대한 개요는 다음과 같습니다.

… 단락 생략…

텍스트 생성: 모델이 훈련되면 이를 사용할 수 있습니다. 텍스트를 생성합니다. 초기 텍스트 또는 프롬프트가 주어지면 모델은 학습한 확률 분포를 기반으로 다음 단어를 생성한 다음 생성된 단어를 입력으로 사용하고 다음 단어를 계속 생성하는 방식으로 원하는 텍스트 길이에 도달하거나 생성될 때까지 계속됩니다. 상징.

... 단락 생략...

LLM이라고 하는 대형 언어 모델.

모델 관점에서 LLM은 텍스트 길이 제한에 도달하거나 종결자가 생성될 때까지 추론을 수행할 때마다 토큰을 생성합니다.

서버 입장에서는 생성된 토큰을 HTTPS 프로토콜을 통해 하나씩 브라우저에 반환해야 합니다.

클라이언트-서버 모드에서 일반적인 상호작용 방식은 클라이언트가 요청을 보내고 응답을 받는 것입니다. 분명히 이것은 ChatGPT가 질문에 응답하는 시나리오를 충족할 수 없습니다.

두 번째로 HTTP를 사용하여 Handshake를 구현하고 WebSocket으로 업그레이드되는 websocket을 생각할 수 있습니다. 그러나 WebSocket은 클라이언트와 서버 모두 지속적으로 소켓을 점유해야 하며, 서버 측의 비용이 상대적으로 높습니다.

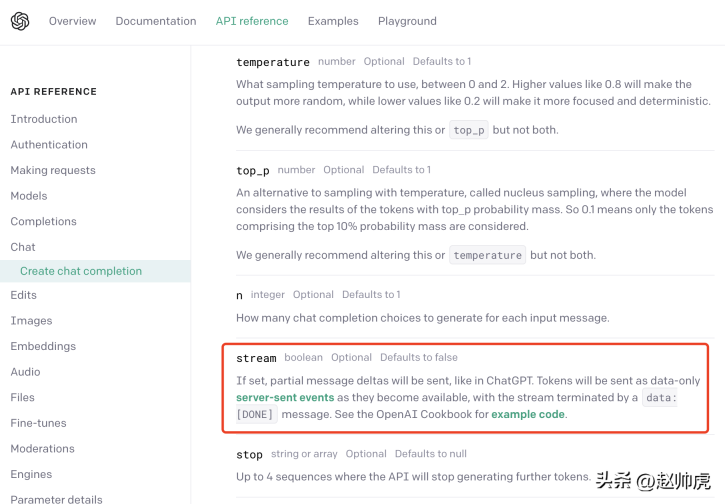

ChatGPT는 타협: 서버 전송 이벤트(줄여서 SSE)를 사용합니다. OpenAI의 API 문서에서 이를 확인할 수 있습니다.

SSE 모드에서 클라이언트는 서버에 한 번만 메시지를 보내면 됩니다. 요청된 경우 서버는 끝이 필요할 때까지 계속해서 출력할 수 있습니다. 전체 상호 작용 프로세스는 아래 그림에 나와 있습니다.

SSE는 여전히 HTTP를 애플리케이션 계층 전송 프로토콜로 사용하여 HTTP의 긴 연결 기능을 최대한 활용하여 서버 측 푸시 기능을 달성합니다.

코드 수준에서 SSE 모드와 단일 HTTP 요청의 차이점은 다음과 같습니다.

- 연결 시간이 초과되지 않도록 클라이언트는 연결 유지를 활성화해야 합니다.

- HTTP 응답 헤더에는 Content-Type=text/event-stream, Cache-Cnotallow=no-cache 등이 포함됩니다.

- HTTP 응답의 본문은 일반적으로 "data: ..."와 같은 구조입니다.

- 연결 시간 초과를 방지하기 위해 HTTP 응답에 빈 데이터가 있을 수 있습니다.

ChatGPT API를 예로 들어 요청을 보낼 때 stream 매개변수를 true로 설정하면 SSE 기능이 활성화되지만 데이터를 읽는 SDK에서는 약간의 주의가 필요합니다.

일반 모드에서 http.Response를 받은 후 ioutil.ReadAll을 사용하여 데이터를 읽어옵니다.

func main() {payload := strings.NewReader(`{"model": "gpt-3.5-turbo","messages": [{"role": "user", "content": "大语言生成式模型是如何工作的"}],"max_tokens": 1024,"temperature": 1,"top_p": 1,"n": 1,"stream": false}`)client := &http.Client{}req, _ := http.NewRequest("POST", "https://api.openai.com/v1/chat/completions", payload)req.Header.Add("Content-Type", "application/json")req.Header.Add("Authorization", "Bearer <openai-token>")resp, err := client.Do(req)if err != nil {fmt.Println(err)return}defer resp.Body.Close()body, _ := ioutil.ReadAll(resp.Body)fmt.Println(string(body))}</openai-token>

실행하는 데 약 20초 이상이 걸리며 완전한 결과를 얻습니다.

{"id": "chatcmpl-7KklTf9mag5tyBXLEqM3PWQn4jlfD","object": "chat.completion","created": 1685180679,"model": "gpt-3.5-turbo-0301","usage": {"prompt_tokens": 21,"completion_tokens": 358,"total_tokens": 379},"choices": [{"message": {"role": "assistant","content": "大语言生成式模型通常采用神经网络来实现,具体工作流程如下:\n\n1. 数据预处理:将语料库中的文本数据进行预处理,包括分词、删除停用词(如“的”、“了”等常用词汇)、去重等操作,以减少冗余信息。\n\n2. 模型训练:采用递归神经网络(RNN)、长短期记忆网络(LSTM)或变种的Transformers等模型进行训练,这些模型都具有一定的记忆能力,可以学习到语言的一定规律,并预测下一个可能出现的词语。\n\n3. 模型应用:当模型完成训练后,可以将其应用于实际的生成任务中。模型接收一个输入文本串,并预测下一个可能出现的词语,直到达到一定长度或遇到结束符号为止。\n\n4. 根据生成结果对模型进行调优:生成的结果需要进行评估,如计算生成文本与语料库文本的相似度、流畅度等指标,以此来调优模型,提高其生成质量。\n\n总体而言,大语言生成式模型通过对语言的规律学习,从而生成高质量的文本。"},"finish_reason": "stop","index": 0}]}

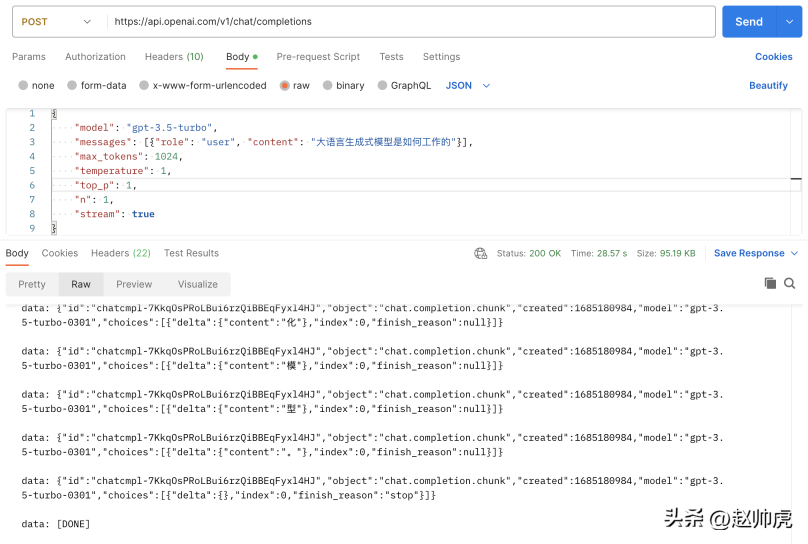

수정 없이 스트림을 true로 설정하면 총 요청 소비는 28초 이상이 되며 이는 많은 스트림 메시지에 반영됩니다.

위 사진은 Postman이 ioutil.ReadAll 모드를 이용해 chatgpt api를 호출하는 사진입니다. 스트림 읽기를 구현하기 위해 http.Response.Body를 세그먼트로 읽을 수 있습니다. 이 방법이 가능한 이유는 다음과 같습니다.

- http.Response.Body는 io.ReaderCloser 유형입니다. 기본 레이어는 HTTP 연결을 사용하고 스트림 읽기를 지원합니다.

- SSE에서 반환된 데이터는 개행 문자 n

으로 분할되므로 수정 방법은 이를 bufio.NewReader(resp.Body)로 감싸서 for-loop에서 읽는 것입니다. , 코드는 다음과 같습니다.

// stream event 结构体定义type ChatCompletionRspChoiceItem struct {Deltamap[string]string `json:"delta,omitempty"` // 只有 content 字段Indexint `json:"index,omitempty"`Logprobs *int`json:"logprobs,omitempty"`FinishReason string`json:"finish_reason,omitempty"`}type ChatCompletionRsp struct {IDstring`json:"id"`Objectstring`json:"object"`Created int `json:"created"` // unix secondModel string`json:"model"`Choices []ChatCompletionRspChoiceItem `json:"choices"`}func main() {payload := strings.NewReader(`{"model": "gpt-3.5-turbo","messages": [{"role": "user", "content": "大语言生成式模型是如何工作的"}],"max_tokens": 1024,"temperature": 1,"top_p": 1,"n": 1,"stream": true}`)client := &http.Client{}req, _ := http.NewRequest("POST", "https://api.openai.com/v1/chat/completions", payload)req.Header.Add("Content-Type", "application/json")req.Header.Add("Authorization", "Bearer "+apiKey)req.Header.Set("Accept", "text/event-stream")req.Header.Set("Cache-Control", "no-cache")req.Header.Set("Connection", "keep-alive")resp, err := client.Do(req)if err != nil {fmt.Println(err)return}defer resp.Body.Close()reader := bufio.NewReader(resp.Body)for {line, err := reader.ReadBytes('\n')if err != nil {if err == io.EOF {// 忽略 EOF 错误break} else {if netErr, ok := err.(net.Error); ok && netErr.Timeout() {fmt.Printf("[PostStream] fails to read response body, timeout\n")} else {fmt.Printf("[PostStream] fails to read response body, err=%s\n", err)}}break}line = bytes.TrimSuffix(line, []byte{'\n'})line = bytes.TrimPrefix(line, []byte("data: "))if bytes.Equal(line, []byte("[DONE]")) {break} else if len(line) > 0 {var chatCompletionRsp ChatCompletionRspif err := json.Unmarshal(line, &chatCompletionRsp); err == nil {fmt.Printf(chatCompletionRsp.Choices[0].Delta["content"])} else {fmt.Printf("\ninvalid line=%s\n", line)}}}fmt.Println("the end")}

클라이언트 측을 읽은 후 서버 측을 살펴보겠습니다. 이제 우리는 chatgpt 서버를 모의하고 텍스트를 그대로 반환하려고 합니다. 여기에는 두 가지 사항이 관련됩니다.

- 응답 헤더는 연결을 연결 유지로 설정하고 콘텐츠 유형을 텍스트/이벤트 스트림으로 설정해야 합니다.

- respnose를 작성한 후 클라이언트에 플러시해야 합니다.

코드는 다음과 같습니다.

func streamHandler(w http.ResponseWriter, req *http.Request) {w.Header().Set("Connection", "keep-alive")w.Header().Set("Content-Type", "text/event-stream")w.Header().Set("Cache-Control", "no-cache")var chatCompletionRsp ChatCompletionRsprunes := []rune(`大语言生成式模型通常使用深度学习技术,例如循环神经网络(RNN)或变压器(Transformer)来建模语言的概率分布。这些模型接收前面的词汇序列,并利用其内部神经网络结构预测下一个词汇的概率分布。然后,模型将概率最高的词汇作为生成的下一个词汇,并递归地生成一个词汇序列,直到到达最大长度或遇到一个终止符号。在训练过程中,模型通过最大化生成的文本样本的概率分布来学习有效的参数。为了避免模型产生过于平凡的、重复的、无意义的语言,我们通常会引入一些技巧,如dropout、序列扰动等。大语言生成模型的重要应用包括文本生成、问答系统、机器翻译、对话建模、摘要生成、文本分类等。`)for _, r := range runes {chatCompletionRsp.Choices = []ChatCompletionRspChoiceItem{{Delta: map[string]string{"content": string(r)}},}bs, _ := json.Marshal(chatCompletionRsp)line := fmt.Sprintf("data: %s\n", bs)fmt.Fprintf(w, line)if f, ok := w.(http.Flusher); ok {f.Flush()}time.Sleep(time.Millisecond * 100)}fmt.Fprintf(w, "data: [DONE]\n")}func main() {http.HandleFunc("/stream", streamHandler)http.ListenAndServe(":8088", nil)}

실제 시나리오에서 반환할 데이터는 다른 서비스 또는 함수 호출에서 가져온 것입니다. 이 서비스 또는 함수 호출의 반환 시간이 불안정할 경우 클라이언트가 발생할 수 있습니다. 오랫동안 데이터를 수신할 수 없으므로 일반적인 처리 방법은 다음과 같습니다.

- 제3자에 대한 호출을 고루틴에 넣습니다.

- 시간에 따른 타이머를 만듭니다. 체크하고 클라이언트에게 빈 메시지를 보냅니다.

- 응답 시간이 너무 길어지는 것을 방지하려면 시간 초과 채널을 만드세요.

다른 채널의 데이터를 읽을 수 있으려면 다음 데모 코드와 같이 select가 좋은 키워드입니다.

// 声明一个 event channel// 声明一个 time.Tick channel// 声明一个 timeout channelselect {case ev := <h2 id="요약하자면">요약하자면</h2><p style="text-align: justify;"><span style="color: #333333;">전체 결과에 대한 응답을 생성하는 프로세스 대규모 언어 모델은 상대적으로 길지만 토큰으로 생성된 응답은 상대적으로 빠릅니다. ChatGPT는 이 기능을 SSE 기술과 완전히 결합하여 단어 단위로 응답을 팝업하여 사용자 경험의 질적 향상을 달성합니다. </span></p><p style="text-align: justify;"><span style="color: #333333;">생성 모델을 살펴보면 LLAMA/Little Alpaca(상용 아님) 또는 Stable Diffusion/Midjourney 등이 있습니다. 온라인 서비스를 제공할 때 SSE 기술을 사용하면 사용자 경험을 개선하고 서버 리소스를 절약할 수 있습니다. </span></p>위 내용은 ChatGPT는 어떻게 단어별로 출력하나요?의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

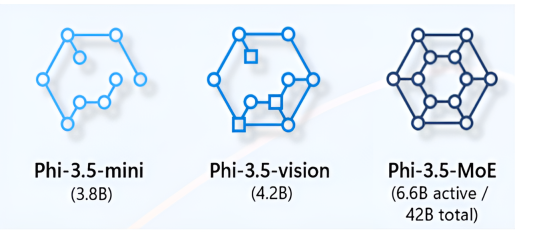

PHI 3.5 SLM이 생성 AI의 게임 체인저로 만드는 이유는 무엇입니까?Apr 14, 2025 am 09:13 AM

PHI 3.5 SLM이 생성 AI의 게임 체인저로 만드는 이유는 무엇입니까?Apr 14, 2025 am 09:13 AMMicrosoft는 PHI-3.5를 공개합니다 : 효율적이고 강력한 소규모 언어 모델의 가족 PHI-3.5 제품군 인 Microsoft의 최신 소규모 언어 모델 (SLMS)은 언어를 포괄하는 다양한 벤치 마크에서 우수한 성능을 자랑합니다.

파이썬 기능 및 람다에 대한 안내서 -Anuctics VidhyaApr 14, 2025 am 09:12 AM

파이썬 기능 및 람다에 대한 안내서 -Anuctics VidhyaApr 14, 2025 am 09:12 AMPython : 효율적이고 읽을 수있는 코드를위한 마스터 링 함수 및 Lambda 기능 우리는 Python의 다양성을 탐구했습니다. 이제 코드 효율성과 가독성을 향상시키기위한 기능을 탐구합시다. 생산 레브에서 코드 모듈성 유지

신속한 엔지니어링에서 생각의 그래프는 무엇입니까?Apr 13, 2025 am 11:53 AM

신속한 엔지니어링에서 생각의 그래프는 무엇입니까?Apr 13, 2025 am 11:53 AM소개 신속한 엔지니어링에서 "Thought of Thought"는 그래프 이론을 사용하여 AI의 추론 과정을 구성하고 안내하는 새로운 접근법을 나타냅니다. 종종 선형 S와 관련된 전통적인 방법과 달리

Genai 에이전트와 함께 조직의 이메일 마케팅을 최적화하십시오Apr 13, 2025 am 11:44 AM

Genai 에이전트와 함께 조직의 이메일 마케팅을 최적화하십시오Apr 13, 2025 am 11:44 AM소개 축하해요! 당신은 성공적인 사업을 운영합니다. 웹 페이지, 소셜 미디어 캠페인, 웹 세미나, 컨퍼런스, 무료 리소스 및 기타 소스를 통해 매일 5000 개의 이메일 ID를 수집합니다. 다음 명백한 단계는입니다

Apache Pinot을 사용한 실시간 앱 성능 모니터링Apr 13, 2025 am 11:40 AM

Apache Pinot을 사용한 실시간 앱 성능 모니터링Apr 13, 2025 am 11:40 AM소개 오늘날의 빠르게 진행되는 소프트웨어 개발 환경에서 최적의 애플리케이션 성능이 중요합니다. 응답 시간, 오류율 및 자원 활용과 같은 실시간 메트릭 모니터링 메인이 도움이 될 수 있습니다.

Chatgpt가 10 억 명의 사용자를 쳤습니까? Openai CEO는'몇 주 만에 두 배가되었습니다Apr 13, 2025 am 11:23 AM

Chatgpt가 10 억 명의 사용자를 쳤습니까? Openai CEO는'몇 주 만에 두 배가되었습니다Apr 13, 2025 am 11:23 AM"얼마나 많은 사용자가 있습니까?" 그는 자극했다. Altman은“마지막으로 우리가 마지막으로 말한 것은 매주 5 억 명의 행위자이며 매우 빠르게 성장하고 있다고 생각합니다. 앤더슨은 계속해서“당신은 나에게 몇 주 만에 두 배가되었다고 말했습니다. “저는 그 개인이라고 말했습니다

Pixtral -12B : Mistral AI의 첫 번째 멀티 모드 모델 -Anuctics VidhyaApr 13, 2025 am 11:20 AM

Pixtral -12B : Mistral AI의 첫 번째 멀티 모드 모델 -Anuctics VidhyaApr 13, 2025 am 11:20 AM소개 Mistral은 최초의 멀티 모드 모델, 즉 Pixtral-12B-2409를 발표했습니다. 이 모델은 Mistral의 120 억 개의 매개 변수 인 NEMO 12B를 기반으로합니다. 이 모델을 차별화하는 것은 무엇입니까? 이제 이미지와 Tex를 모두 가져갈 수 있습니다

생성 AI 응용 프로그램을위한 에이전트 프레임 워크 - 분석 VidhyaApr 13, 2025 am 11:13 AM

생성 AI 응용 프로그램을위한 에이전트 프레임 워크 - 분석 VidhyaApr 13, 2025 am 11:13 AM쿼리에 응답 할뿐만 아니라 자율적으로 정보를 모으고, 작업을 실행하며, 여러 유형의 데이터 (텍스트, 이미지 및 코드를 처리하는 AI 구동 조수가 있다고 상상해보십시오. 미래처럼 들리나요? 이것에서

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

ZendStudio 13.5.1 맥

강력한 PHP 통합 개발 환경

Dreamweaver Mac版

시각적 웹 개발 도구

SecList

SecLists는 최고의 보안 테스터의 동반자입니다. 보안 평가 시 자주 사용되는 다양한 유형의 목록을 한 곳에 모아 놓은 것입니다. SecLists는 보안 테스터에게 필요할 수 있는 모든 목록을 편리하게 제공하여 보안 테스트를 더욱 효율적이고 생산적으로 만드는 데 도움이 됩니다. 목록 유형에는 사용자 이름, 비밀번호, URL, 퍼징 페이로드, 민감한 데이터 패턴, 웹 셸 등이 포함됩니다. 테스터는 이 저장소를 새로운 테스트 시스템으로 간단히 가져올 수 있으며 필요한 모든 유형의 목록에 액세스할 수 있습니다.

VSCode Windows 64비트 다운로드

Microsoft에서 출시한 강력한 무료 IDE 편집기

드림위버 CS6

시각적 웹 개발 도구