자기 인식 AI: AutoGPT

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-05-25 10:28:202113검색

1. 소개

ChatGPT는 요즘 큰 인기를 끌고 있습니다. 자연어 처리 모델의 선두주자로서, ChatGPT의 장점은 원활하고 일관된 대화를 생성할 수 있으면서도, 맥락에 따라 맥락을 이해하고 답변할 수 있다는 것입니다. . 예를 들어 고객 서비스, 교육, 엔터테인먼트 및 기타 분야에서 ChatGPT는 사용자에게 편리한 서비스와 엔터테인먼트 경험을 제공하는 지능형 보조자 역할을 할 수 있습니다.

GPT-3에서 GPT-4에 이르기까지 ChatGPT는 고급 추론, 입력 설정, 동작 미세 조정 및 더 긴 상황별 정보 이해 측면에서 지속적인 최적화 교육에서 상당한 진전을 이루었음을 확인할 수 있습니다.

그러나 이 대화형 GPT 모델의 경우 자기 인식과 스스로 학습하고 진화할 수 있는 능력을 갖춘 영화 속 인공 지능과 같다고 보고 싶습니다. 빈번한 안내와 상호 작용이 필요하지 않으며 단순히 목표를 제안하기만 하면 AI가 모든 실행 계획과 논리적 처리를 자동으로 완료하고 지속적으로 자체 증명 및 최적화를 수행하여 최종적으로 우리가 제안한 목표를 완료할 수 있습니다.

오늘은 ChatGPT의 진화된 버전인 AutoGPT입니다.

2. AutoGPT란 무엇인가요?

AutoGPT는 OpenAI의 GPT-4 언어 모델을 활용하여 완전히 자율적이고 사용자 정의 가능한 AI 에이전트를 만드는 실험적인 오픈 소스 애플리케이션입니다. Toran Bruce Richards가 2023년 3월 30일에 출시했습니다.

게임 개발자 Toran은 Significant Gravitas라는 게임 회사를 설립했습니다.

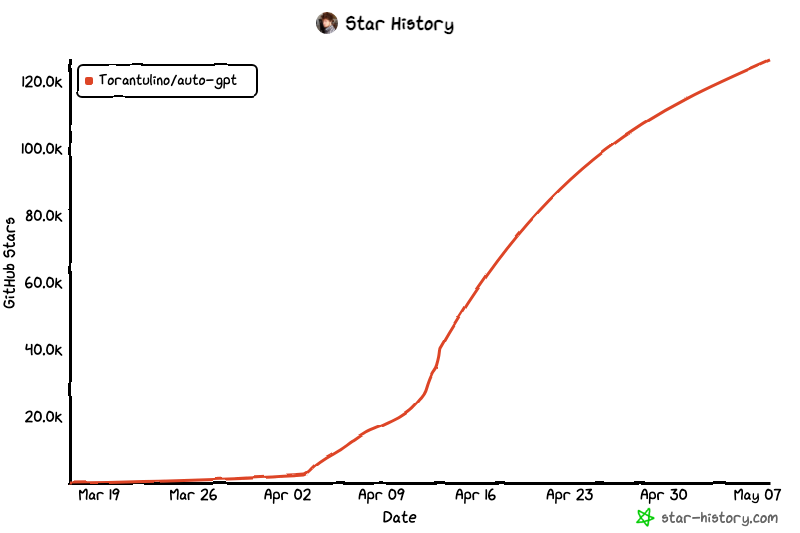

한 달여 만에 AutoGPT의 Git 프로젝트는 120만 개 이상의 별을 받았습니다. 완전히 자율적으로 실행되는 GPT-4의 첫 번째 사례 중 하나인 AutoGPT는 AI로 가능한 것의 경계를 허물었습니다.

AutoGPT는 독립적으로 실행되기 때문에 다른 AI 도구에 비해 독특합니다. 즉, 더 이상 필요에 맞게 모델을 조작할 필요가 없습니다. 대신 목표만 적어두면 나머지는 AI가 알아서 해드립니다. 결과적으로 AutoGPT는 AI가 인간과 상호 작용하는 방식을 근본적으로 바꾸어 인간이 더 이상 적극적인 역할을 할 필요가 없도록 하면서 ChatGPT와 같은 다른 AI 애플리케이션과 동일하거나 더 나은 결과 품질을 유지합니다.

3. AutoGPT는 어떻게 작동하나요?

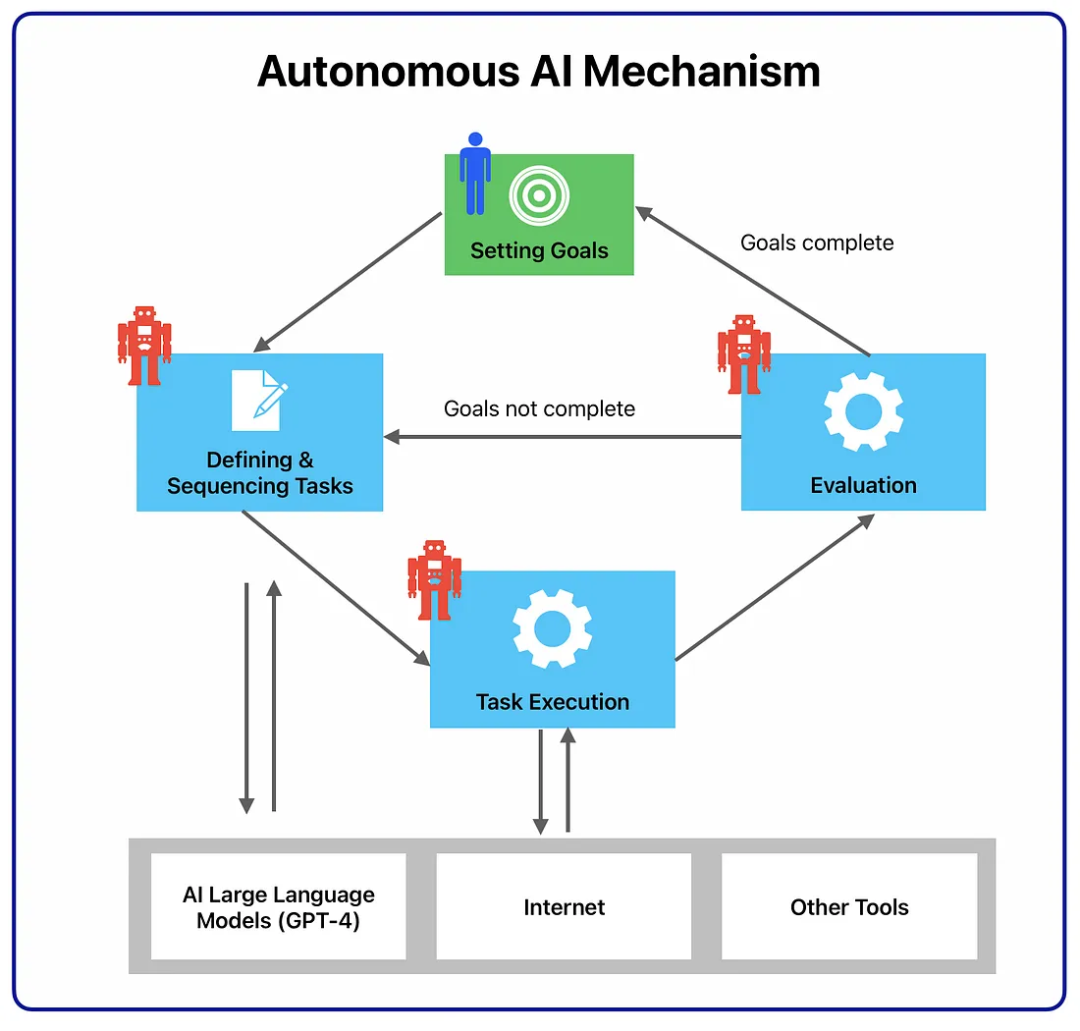

AutoGPT는 AI 시스템이 특정 작업을 충족하기 위해 다양한 AI 에이전트를 생성하는 자율 AI 메커니즘을 기반으로 작동합니다.

- 작업 생성 에이전트: AutoGPT에 대상을 입력하면 가장 먼저 상호 작용하는 대상은 다음과 같습니다. 작업 생성 에이전트 AI 에이전트. 귀하의 목표에 따라 이를 달성하기 위한 작업 및 단계 목록을 작성하고 이를 우선 순위 에이전트에게 보냅니다.

- 작업 우선순위 에이전트: 작업 목록을 받은 후 우선순위 AI 에이전트는 순서가 정확하고 논리적인지 확인한 후 실행 에이전트로 보냅니다.

- 작업 실행 에이전트: 우선순위를 완료한 후 실행 에이전트가 작업을 하나씩 완료합니다. 여기에는 GPT-4, 인터넷 및 기타 리소스를 활용하여 결과를 얻는 것이 포함됩니다.

위 요원들은 서로 소통을 합니다. 따라서 실행 에이전트가 모든 작업을 완료하고 결과가 만족스럽지 않으면 작업 생성 에이전트와 통신하여 새 작업 목록을 생성할 수 있습니다. 사용자가 정의한 목표가 모두 완료될 때까지 세 에이전트 사이를 반복적으로 반복합니다.

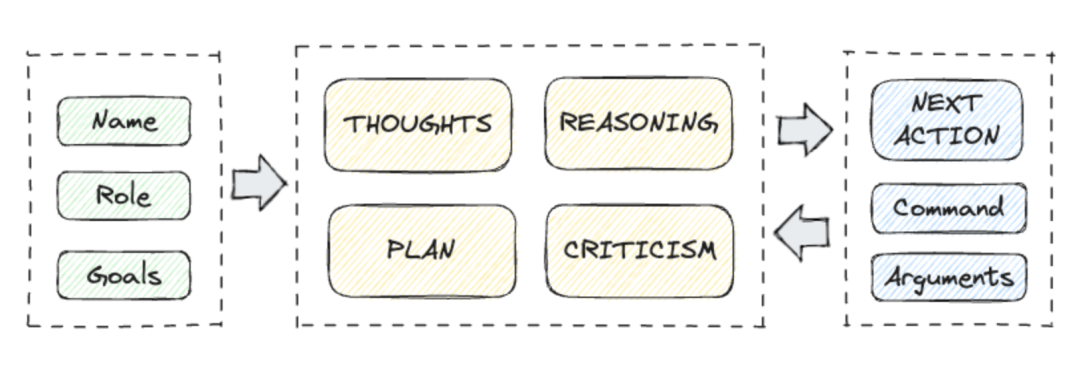

AI 에이전트의 행동은 사용자 인터페이스에도 표시되며 사고, 추론, 계획, 판단의 네 가지 그룹으로 구분됩니다.

- 생각: AI 에이전트가 대상에 대한 생각을 공유합니다.

- REASONING: AI 에이전트 추론이 아이디어를 개발하고 실현하는 방법.

- 계획(PLAN): AI 에이전트가 분석을 통해 완료해야 할 작업에 대한 계획을 나열합니다.

- 비평: AI는 스스로 판단하고 오류를 수정하며 모든 제한 문제를 극복합니다.

이 계산 프로세스를 공유함으로써 AutoGPT는 시행착오 시연을 수행하고 목표 최적화 처리를 수행하여 사용자 개입 없이 직면하는 모든 문제를 극복할 수 있습니다.

4. AutoGPT와 ChatGPT의 비교?

기본 LLM 모델은 동일하지만 AutoGPT와 ChatGPT 간에는 여전히 많은 차이점이 있습니다.

4.1 실시간 통찰력

ChatGPT에서 사용하는 최신 GPT-4 모델은 2021년 9월까지만 사용할 수 있는 GPT-3.5와 동일한 데이터로 훈련됩니다. ChatGPT를 사용하면 실시간 데이터 정보를 얻을 수 없습니다. 정보를 얻고 정보를 추출하기 위해 웹사이트와 온라인 플랫폼에 접속합니다.

반면 AutoGPT는 인터넷에 액세스할 수 있습니다. 인터넷 서핑을 할 수 있을 뿐만 아니라, 출처가 합법적인지도 확인할 수 있습니다. 또한 AutoGPT는 모든 플랫폼에 액세스하여 작업을 수행할 수 있습니다. 예를 들어 AI에게 제품 판매에 대한 잠재 고객을 조사하고 홍보 이메일을 보내도록 요청하면 Gmail 계정을 사용하여 직접 이메일 초안을 작성하여 보냅니다.

4.2 메모리 관리

컨텍스트 창은 언어 모델이 정확한 답변을 제공하는 데 매우 중요합니다. 그러나 GPT-4와 같은 LLM에서는 창의 토큰이 4000~8000개로 제한됩니다. 따라서 요구 사항이 제한을 초과하면 모델이 모든 지침을 올바르게 따르지 않거나 방향을 벗어나 신뢰할 수 없는 출력을 제공할 수 있습니다.

반면 AutoGPT는 단기 및 장기 메모리 관리에 능숙합니다. 메모리 관리를 위해 데이터베이스, 로컬 캐시, Redis를 사용하면 많은 양의 상황 정보나 이전 경험을 저장할 수 있어 AI 모델이 더 나은 결정을 내릴 수 있습니다.

4.3 이미지 생성

AutoGPT는 기본적으로 DALL-E를 사용하여 다양한 이미지 생성 엔진을 사용할 수 있기 때문에 이미지를 생성할 수 있습니다. AI 에이전트에 대한 이미지 생성을 활성화하려면 DALL-E의 API에 액세스해야 합니다. 다중 모드 입력 방법임에도 불구하고 이 기능은 현재 ChatGPT-4에서 사용할 수 없습니다.

3.4 텍스트 음성 변환

명령줄에 python -m autogpt --speak를 입력하여 AutoGPT에서 텍스트 음성 변환을 활성화할 수 있습니다. 하지만 AutoGPT와 상호작용할 때마다 명령을 입력해야 합니다. AutoGPT를 다목적 AI 음성 소프트웨어인 Eleven Labs에 연결하여 음성에 다양한 사운드를 추가할 수도 있습니다.

5. AutoGPT의 한계

자율성이 AI 시스템에 새로운 차원을 더한다는 것은 의심의 여지가 없습니다. 동시에 우리는 AutoGPT의 한계와 위험을 무시할 수 없습니다. 아래에는 알아야 할 몇 가지 주요 제한 사항이 나열되어 있습니다.

5.1 비용이 많이 듭니다

기능은 훌륭하지만 AutoGPT의 유용성은 실망스러울 수 있습니다. AutoGPT는 고가의 GPT-4 모델을 사용하기 때문에 소규모 작업의 경우에도 각 작업을 완료하는 데 드는 비용이 높을 수 있습니다. 이는 주로 AutoGPT가 특정 작업 단계에서 GPT-4를 여러 번 사용하기 때문입니다.

5.2 자주 루프에 갇히는 경우

AutoGPT를 사용할 때 사용자가 직면하는 가장 일반적인 문제는 루프에 갇히는 것입니다. 이 문제가 몇 분 이상 지속되면 프로세스를 다시 시작해야 할 수도 있습니다. 이는 AutoGPT가 GPT-4를 사용하여 작업을 올바르게 정의하고 분해하기 때문에 발생합니다. 따라서 기본 LLM이 AutoGPT가 조치를 취하기에 충분한 결과를 반환하지 않으면 시행착오 문제가 발생합니다.

5.3 데이터 보안

AutoGPT는 완전히 승인되어 자율적으로 실행될 수 있으며 트위터 계정 사용, github 로그인, 검색 엔진 사용 등 시스템과 인터넷에 액세스할 수 있으므로 데이터가 유출될 수 있습니다. AutoGPT에는 보안 에이전트가 없으므로 AutoGPT를 사용할 때 주의해야 합니다. 올바른 지침과 보안 지침을 제공하지 않으면 모델이 계속 실행되도록 할 수 없습니다.

5. AutoGPT를 설치하는 방법은 무엇인가요?

다른 AI 도구와 달리 AutoGPT에는 플랫폼과 기능에 액세스하기 위한 간단한 등록 프로세스가 없습니다. AutoGPT를 사용하기 전에 요구 사항을 충족하는 다양한 소프트웨어를 다운로드해야 합니다. 자세한 단계 요구 사항은 다음과 같습니다.

1단계: 필요한 소프트웨어 다운로드

우선 Git 계정이 있어야 하고 Python 3.1.0 이상을 설치해야 합니다. 또한 일반적으로 사용되는 셸 사용에 능숙해야 합니다. 명령 또는 프로젝트 시작 및 구성을 위한 Docker 컨테이너가 있습니다.

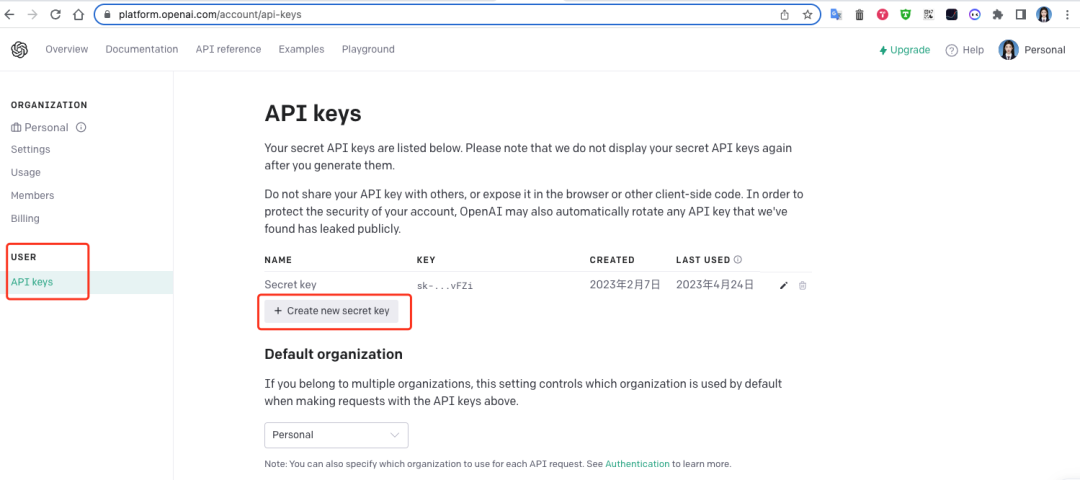

2단계: OpenAI API 키 설정

아직 OpenAI 계정이 없다면 OpenAI 계정을 만드세요. (물론 중국에서 계정을 만들려면 간단한 문제가 아닙니다. 계정을 만들려면 인터넷의 다른 기사를 참조하십시오 신청). OpenAI 계정을 연 후 USER - API 키를 열고 API 키 탭으로 이동하세요. 키를 생성하는 옵션이 표시됩니다. 그것을 클릭하고 키를 복사하십시오.

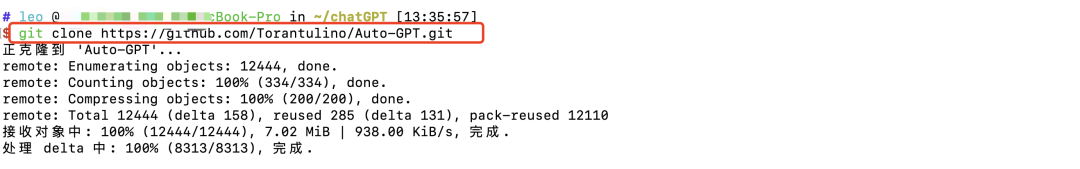

3단계: 최신 버전의 AutoGPT 복제

(1)프로젝트 복제

명령줄 도구를 열고 git clone https://github.com/Torantulino/Auto 명령을 통해 프로젝트를 복사합니다. -GPT.git 로컬에 복제

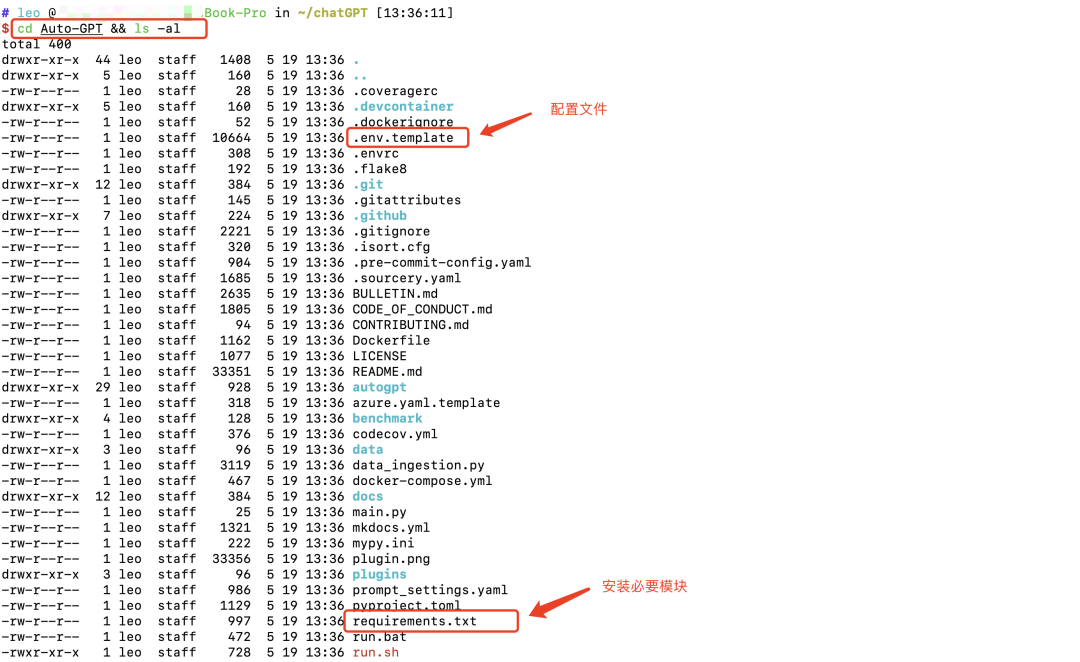

(2) 설치 실행

cd Auto-GPT && ls -al 명령을 통해 해당 디렉토리에 진입하면 여러 파일이 있는 것을 확인할 수 있는데, 그 중 하나가 요구사항.txt입니다. 이 파일에는 AutoGPT를 실행하는 데 필요한 모듈이 표시됩니다.

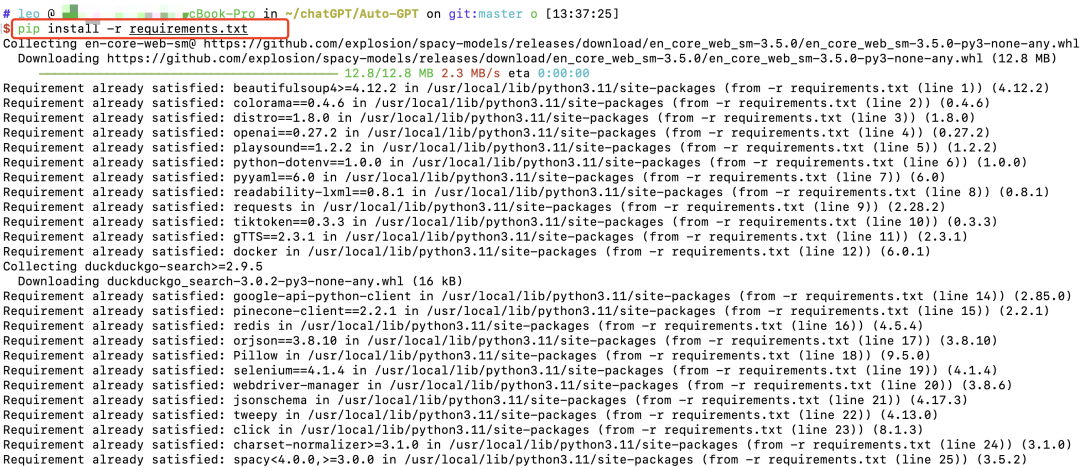

이러한 모듈을 설치하려면 pip install -r 요구사항.txt 명령을 사용하여 다운로드하고 설치할 수 있습니다.

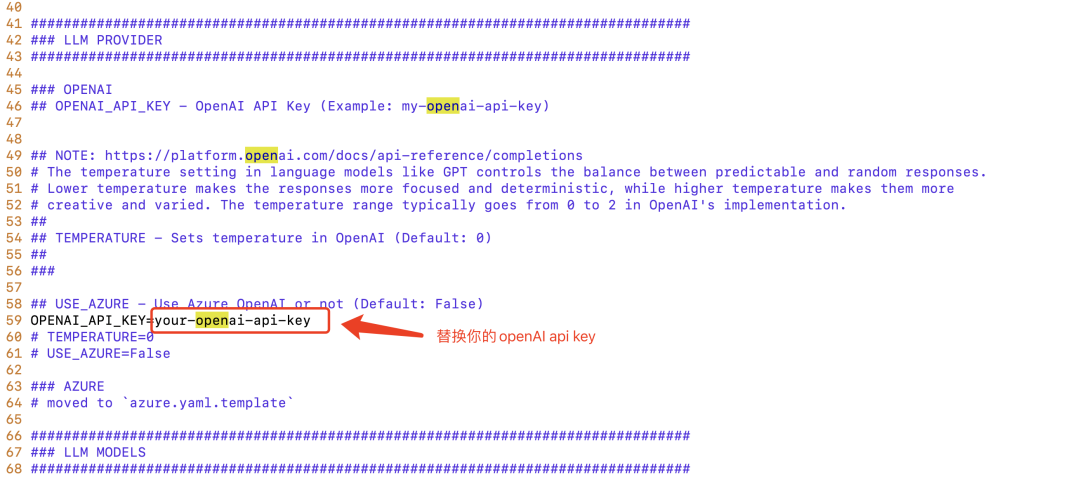

(3) vim .env.template your-openai-api-key 명령을 통해 구성

을 수정합니다. 구성이 완료되면 mv .env.template .env를 실행하여 구성을 만듭니다. 적용

그 외 관련 설정은 표를 참조하여 필요에 따라 구성 가능

LLM PROVIDER |

OPENAI_API_KEY 사용 여부를 설정할 수 있습니다. 아주르 |

LLM 모델 설정 |

은 openAI를 구성할 수 있습니다. 제공된 토큰 제한은 과도한 통화 비용 낭비를 방지합니다. 기본값은 4000-8000 |

LLM MODELS |

LLM 기본 언어 모델입니다. GPT-4 또는 gpt-3.5-turbo를 선택할 수 있습니다 |

MEMORY |

메모리 관리, 로컬, redis, PINECONE, MILVUS 등을 구성할 수 있습니다. |

IMAGE GENERATION PROVIDER | 이미지 생성, 이미지 크기 및 이미지 생성 엔진 구성 가능: dalle, HUGGINGFACE, STABLE DIFFUSION WEBUI |

AUDIO TO TEXT PROVIDER |

Voice to text, HUGGINGFACE 구성 가능 |

저장소 작업을 위한 GIT 공급자 |

github 구성, github api 키를 구성하여 github에 액세스하고 관리하는 데 사용됨 |

WEB BROWSING |

검색 엔진 관리, 다양한 브라우저를 구성할 수 있습니다. firefox, chrome, safari, 검색 엔진: 정보를 얻고 액세스 수준을 관리하기 위해 인터넷에 액세스하기 위한 google 및 기타 승인된 개방형 API |

TTS PROVIDER |

텍스트 전송에 MAC OS, STREAMELEMENTS 및 ELEVENLABS를 사용할 수 있습니다. -음성 구성 |

TWITTER API |

트위터 계정 관리, 트위터 계정 관리 및 구성, 해당 API에 액세스하기 위한 토큰 구성 |

AUTO-GPT - 일반 설정 |

오토G PT 저장소 디렉터리, 스위치, 사용자 에이전트, AI 설정 등과 같은 일부 기본 구성. |

(4) 사용 시작

위 구성을 완료한 후 AutoGPT의 기본 구성이 완료되면 이제 python -m autogpt 명령을 실행하여 AutoGPT 여정을 시작할 수 있습니다.

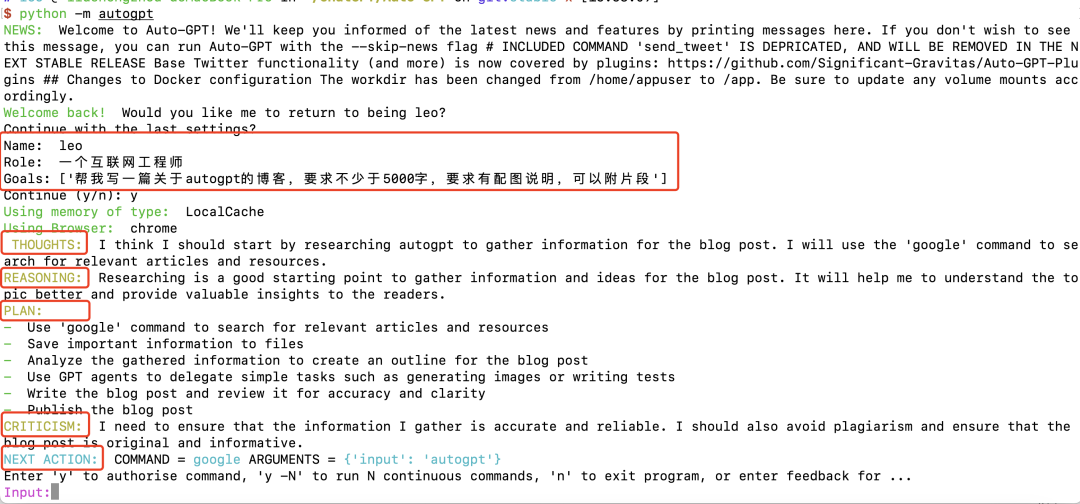

위 그림에서 볼 수 있듯이 AutoGPT에서는 AI에 이름 [이름], 역할 포지셔닝 [역할]을 지정하고 목표 [목표]를 설정할 수 있습니다(위) 최대 5개 목표(목표가 1개뿐이라면 Enter를 누르세요).

목표를 설정하고 완료한 후 AutoGPT는 독립적으로 생각하고 목표를 분석합니다[생각]. 생각이 완료된 후 목표[추론]를 완료하는 방법을 이해하고 추론하기 시작하며 독립적으로 시작됩니다. 이를 구체적인 계획 [PLAN]]으로 세분화하고, 마지막으로 AI 에이전트가 오류를 수정하고 올바른 결정을 내릴 수 있도록 판단 [CRITICISM]을 제안합니다.

위의 행동 계획을 완료한 후 AutoGPT는 실행되는 특정 명령 [COMMAND] 및 매개변수 [ARGUMENTS]가 포함된 [NEXT ACTION]에 대한 지침과 조치를 묻는 메시지를 표시합니다. 데이터 유출과 같은 예상치 못한 위험을 방지하려면 여기에서 y 또는 n을 사용하여 AutoGPT의 후속 명령 작업을 승인하거나 거부할 수 있습니다.

AutoGPT는 상황과 과거 경험을 저장할 수 있으므로 매번 피드백 결과를 바탕으로 더 깊이 생각하고 더 나은 계획을 수립하고 최종적으로 이를 나열합니다. 계획을 실행하고, 원하는 목표에 도달할 때까지 계속해서 추가해 보세요.

AutoGPT는 위의 단계를 거쳐 여러 주기를 수행합니다. AutoGPT는 상황과 과거 경험을 저장할 수 있으므로 피드백 결과를 바탕으로 매번 더 깊이 생각하고 더 나은 계획을 수립하고 최종적으로 구현하려는 계획을 나열합니다. . 원하는 목표에 도달할 때까지 계속해서 추가해 보세요.

(5) Docker는

을 사용합니다. 물론 docker를 사용하여 다음을 실행할 수도 있습니다.

<code>// 最简单的方式就是通过docker-composedocker-compose build auto-gptdocker-compose run --rm auto-gpt// 使用docker命令构建docker build -t auto-gpt .docker run -it --env-file=.env -v $PWD:/app auto-gpt</code>

추가 매개변수를 전달할 수 있습니다(예: 실행 모드 --gpt3only 및 --continuous 모드:

<code>// docker-composedocker-compose run --rm auto-gpt --gpt3only --continuous// docker docker run -it --env-file=.env -v $PWD:/app --rm auto-gpt --gpt3only --continuous</code>

6).

전통적인 텍스트 생성 기술과 비교할 때 AutoGPT 기능의 발전은 놀랍습니다. 목표를 분석하고 이를 수행해야 하는 작업으로 자동으로 분류하며 기존 경험과 결정을 기반으로 지속적으로 결정을 내릴 수 있습니다. 실행 프로세스 최적화, 개선 및 요약 동시에 AutoGPT는 검색 엔진 검색, Github, 웹 도구 및 기타 채널을 통해, 그리고 로컬 캐싱, 음성 변환을 통해 필요한 정보를 다운로드하고 구체화할 수 있습니다. , 이미지 생성 및 기타 플러그인 기능을 통해 궁극적으로 설정한 목표를 달성할 수 있습니다. 이러한 자기인식, 자기반복, 업데이트 방식은 영화 에 나오는 모스(Moss)와 같은 인공지능과 매우 유사합니다! 마지막 질문은, 이 기사가 AutoGPT에 의해 자동으로 생성된 것인가요?위 내용은 자기 인식 AI: AutoGPT의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!