연구진, 영어 명령 이해하고 집안일도 할 수 있는 로봇 개발

- 王林앞으로

- 2023-05-16 13:13:141406검색

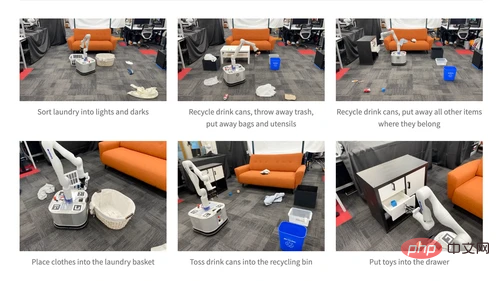

프린스턴대학교, 스탠포드대학교, Google 연구팀은 OpenAI의 GPT-3 Davinci 모델을 사용하여 영어 지시를 이해하고 집안일을 수행할 수 있는 로봇 TidyBot을 개발했습니다. 이 로봇은 사용자의 취향에 따라 세탁물 분류, 바닥 쓰레기 줍기, 장난감 줍기 등의 작업을 자동으로 완료할 수 있다.

GPT-3 Davinci 모델은 GPT 모델 계열의 일부인 딥 러닝 모델로, 자연어를 이해하고 생성할 수 있습니다. 이 모델은 강력한 요약 기능을 갖추고 있으며 대량의 텍스트 데이터로부터 복잡한 개체 속성과 관계를 학습할 수 있습니다. 연구원들은 이 기능을 사용하여 "서랍 속의 노란색 셔츠, 옷장 속의 진한 보라색 셔츠, 서랍 속의 흰색 양말"과 같이 사용자가 제공한 몇 가지 예시 개체를 기반으로 로봇이 개체를 배치한 다음 모델이 결론을 내리도록 했습니다. 사용자의 일반적인 기본 설정 규칙을 적용하고 향후 상호 작용에 적용합니다.

연구원들은 논문에서 다음과 같이 썼습니다. "우리의 기본 통찰력은 LLM(대형 언어 모델)의 요약 기능이 맞춤형 로봇의 일반화 요구와 잘 일치한다는 것입니다. LLM은 Complex를 사용하여 요약을 통해 일반화를 달성하는 놀라운 능력을 보여줍니다. 대규모 텍스트 데이터 세트에서 학습된 개체 속성 및 관계”

그들은 또한 다음과 같이 썼습니다. “비용이 많이 드는 데이터 수집 및 모델 교육이 필요한 기존 방법과 달리 LLM은 로봇 공학 도메인에서 바로 구현될 수 있음을 보여줍니다. 연구진은 방대한 양의 텍스트 데이터에서 학습한 강력한 요약 기능을 통해 세탁물을 밝은 색상과 어두운 색상으로 분류하고, 음료수 캔을 재활용하고, 쓰레기를 버리고, 가방과 접시를 포장하고, 정리할 수 있는 로봇을 시연했습니다. 물건은 제자리로 돌려놓고, 장난감은 서랍에 넣어두세요.

연구원들은 먼저 사용자 선호도를 입력하고 모델에 항목 속성을 결정하기 위한 개인화 규칙을 생성하도록 요청하는 텍스트 기반 벤치마크 데이터 세트를 테스트했습니다. 모델은 예제를 일반 규칙으로 요약하고 요약을 사용하여 새 항목을 배치할 위치를 결정합니다. 기본 장면은 각 방에 24개의 장면이 있는 4개의 방으로 정의됩니다. 각 장면에는 객체를 배치할 수 있는 장소가 2~5개 포함되어 있으며, 모델이 분류할 수 있는 보이는 객체와 보이지 않는 객체의 수가 동일합니다. 이 테스트에서는 보이지 않는 항목에 대해 91.2%의 정확도를 달성했다고 밝혔습니다.

이 접근 방식을 실제 로봇인 TidyBot에 적용했을 때, 물체의 85%를 성공적으로 집어들 수 있다는 것을 발견했습니다. TidyBot은 각각 10개의 개체 세트로 구성된 8개의 실제 시나리오에서 테스트되었으며 로봇은 각 시나리오에서 3번 실행되었습니다. IT House에 따르면 TidyBot은 LLM 외에도 CLIP이라는 이미지 분류기와 OWL-ViT라는 개체 감지기를 사용합니다.

Georgia Institute of Technology 산하 인터랙티브 컴퓨팅 학교의 조교수인 Danfei Xu는 Google의 PaLM-E 모델에 관해 이야기하면서 LLM이 로봇에게 더 많은 문제 해결 능력을 제공한다고 말했습니다. "대부분의 이전 임무 계획 시스템은 유연성이 떨어지고 구축하기 어려운 어떤 형태의 검색 또는 최적화 알고리즘에 의존했습니다. LLM 및 다중 모드 LLM을 통해 이러한 시스템은 인터넷 규모 데이터의 이점을 활용하고 새로운 문제를 해결하는 데 쉽게 사용할 수 있습니다."라고 그는 말했습니다. .

위 내용은 연구진, 영어 명령 이해하고 집안일도 할 수 있는 로봇 개발의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!