NVIDIA, 추론 속도를 10배 향상시키는 ChatGPT 전용 GPU 출시

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-05-13 23:04:041313검색

옛날에는 컴퓨팅 성능이 부족하여 인공지능이 수십 년 동안 병목 현상에 빠졌고, GPU는 딥 러닝에 불을 붙였습니다. ChatGPT 시대에 AI는 대형 모델로 인해 컴퓨팅 성능이 부족하다는 문제에 다시 한번 직면하게 되었습니다. 이번에는 엔비디아가 할 수 있는 방법이 없을까요?

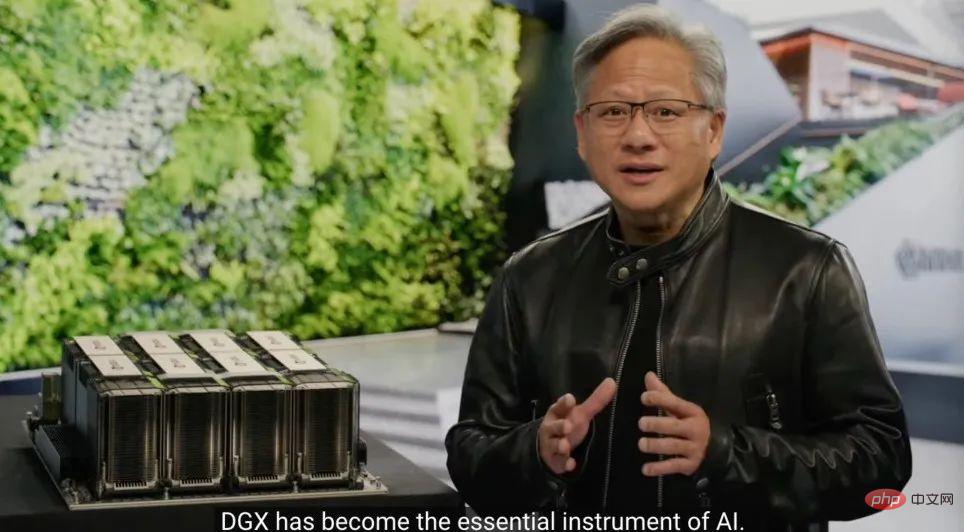

3월 22일 GTC 컨퍼런스가 공식적으로 열렸습니다. 방금 열린 기조연설에서 NVIDIA CEO Jensen Huang이 ChatGPT를 위해 준비한 칩을 꺼냈습니다.

"컴퓨팅을 가속화하는 것은 쉽지 않습니다. 2012년 컴퓨터 비전 모델 AlexNet은 GeForce GTX 580을 사용하여 초당 262 PetaFLOPS를 처리할 수 있었습니다. 이 모델은 AI 기술의 폭발적인 발전을 촉발했습니다."라고 Huang은 말했습니다. "10년 후, 트랜스포머가 등장했습니다. GPT-3는 AlexNet의 100만 배에 달하는 323 ZettaFLOPS의 컴퓨팅 성능을 사용하여 전 세계를 놀라게 한 AI인 ChatGPT를 만들었습니다. 새로운 컴퓨팅 플랫폼이 등장하고 AI의 iPhone 시대가 도래했습니다. "

Nvidia의 주가는 올해 77% 상승했습니다. 현재 Nvidia의 시장 가치는 Intel의 거의 5배에 달하는 6,400억 달러입니다. 그러나 오늘의 릴리스는 Nvidia가 아직 멈추지 않았음을 알려줍니다.

AIGC를 위한 전용 컴퓨팅 성능 설계

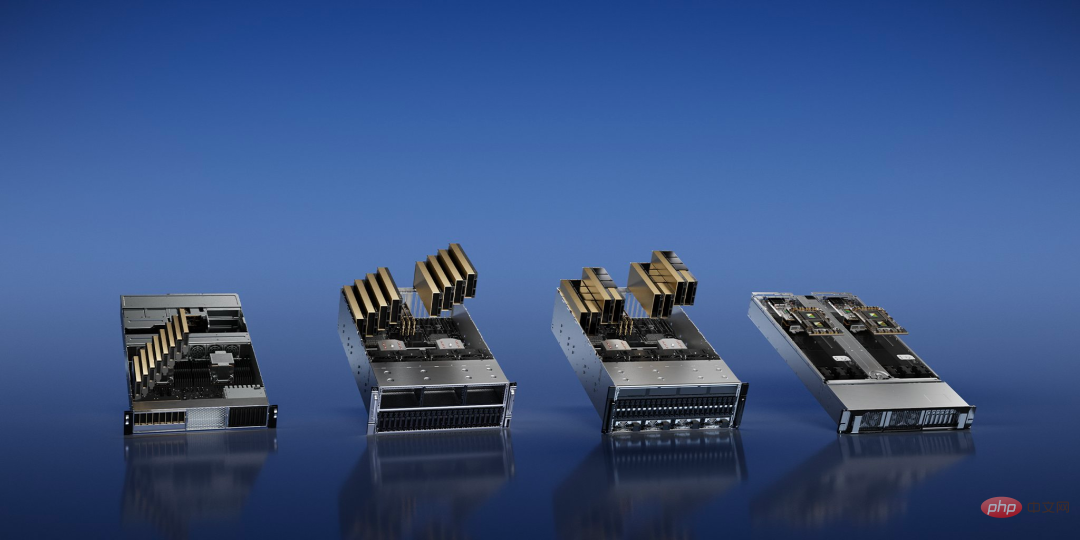

생성 AI(AIGC)의 개발로 인해 NVIDIA는 AI 작업을 위한 4가지 추론 플랫폼을 동시에 시연했으며, 모두 통합 아키텍처를 사용합니다.

이 중 NVIDIA L4는 "CPU보다 120배 더 높은 AI 기반 비디오 성능과 99%의 에너지 효율성"을 제공하며 비디오 스트리밍, 인코딩 및 디코딩, AI 비디오 생성에 사용할 수 있습니다. power 더욱 강력한 NVIDIA L40은 2D/3D 이미지 생성에 특별히 사용됩니다.

대량의 컴퓨팅 성능이 필요한 ChatGPT에 대응하기 위해 NVIDIA는 듀얼 GPU NVLINK를 탑재한 PCIE H100 GPU를 탑재하고 94GB 메모리와 가속 Transformer Engine을 탑재한 LLM(대형 언어 모델) 전용 솔루션인 NVIDIA H100 NVL을 출시했습니다. .

"현재 ChatGPT를 실제로 처리할 수 있는 유일한 GPU는 NVIDIA HGX A100입니다. 이전에 비해 4쌍의 H100과 듀얼 NVLINK를 갖춘 표준 서버는 이제 10배 더 빠르며 대규모 변환이 가능합니다. 언어 모델 처리 비용이 대폭 절감됩니다."라고 Huang은 말했습니다.

마지막으로 추천 모델용 NVIDIA Grace Hopper가 있는데, 이는 추천 작업에 최적화된 것 외에도 그래프 신경망과 벡터 데이터베이스를 강화할 수도 있습니다.

칩이 물리적 한계를 돌파하게 해주세요

현재 반도체 생산 공정은 물리학이 도달할 수 있는 한계에 접근했습니다. 2nm 공정 이후의 돌파구는 어디인가? NVIDIA는 칩 제조의 가장 원시적인 단계인 포토리소그래피부터 시작하기로 결정했습니다.

기본적으로 이것은 물리학의 한계에 따른 이미징 문제입니다. 고급 프로세스에서는 칩의 많은 기능이 인쇄 프로세스에 사용되는 빛의 파장보다 작으며 마스크의 디자인은 광학 근접 보정이라는 단계를 지속적으로 수정해야 합니다. 전산 리소그래피는 원본을 통해 포토레지스트와 상호 작용할 때 빛의 동작을 시뮬레이션합니다. 이러한 동작은 Maxwell의 방정식에 따라 설명됩니다. 이는 칩 설계 및 제조 분야에서 가장 계산량이 많은 작업입니다.

Jensen Huang은 반도체 설계 및 제조 속도를 높이기 위해 GTC에서 CuLitho라는 새로운 기술을 발표했습니다. 이 소프트웨어는 Nvidia 칩을 사용하여 소프트웨어 기반 칩 설계와 칩에 디자인을 인쇄하는 데 사용되는 포토리소그래피 마스크의 물리적 제조 사이의 단계 속도를 높입니다.

CuLitho는 GPU에서 실행되며 현재 리소그래피 기술보다 40배 향상된 성능을 제공하여 현재 연간 수백억 CPU 시간을 소비하는 대규모 컴퓨팅 워크로드를 가속화합니다. "H100을 구축하려면 89개의 마스크가 필요합니다. CPU에서 실행하는 경우 마스크 1개를 실행하는 데 2주가 걸리지만 H100을 CuLitho에서 실행하는 데 사용하면 8시간밖에 걸리지 않습니다."라고 Huang은 말했습니다.

이는 500개의 NVIDIA DGX H100 시스템이 40,000개의 CPU 시스템 작업을 대체하고 전산 리소그래피 프로세스의 모든 부분을 실행할 수 있어 전력 요구 사항과 잠재적인 환경 영향을 줄이는 데 도움이 된다는 것을 의미합니다.

이 발전을 통해 칩의 트랜지스터와 회로를 오늘날보다 더 작게 만들 수 있을 뿐만 아니라 칩의 출시 기간을 단축하고 제조 공정을 주도하기 위해 24시간 내내 운영되는 대규모 데이터 센터의 에너지 효율성을 향상할 수 있습니다.

Nvidia는 이 기술을 시장에 출시하기 위해 ASML, Synopsys 및 TSMC와 협력하고 있다고 말했습니다. 보도에 따르면 TSMC는 6월부터 이 기술의 시험 생산 준비를 시작할 예정이다.

"칩 산업은 전 세계 거의 모든 다른 산업의 기초입니다"라고 Huang은 말했습니다. "물리학의 한계에서 리소그래피 기술을 사용하고 CuLitho를 통해 파트너 TSMC, ASML 및 Synopsys와 협력하여 팹은 생산량을 늘리고 탄소 배출량을 줄이며

최초의 GPU를 위한 기반을 마련할 수 있습니다." 가속화된 양자 컴퓨팅 시스템

오늘 행사에서 NVIDIA는 Quantum Machines를 사용하여 구축된 새로운 시스템도 발표했습니다. 이 시스템은 고성능 및 저지연 양자 클래식 컴퓨팅을 연구하는 연구자에게 혁신적인 새로운 아키텍처를 제공합니다.

세계 최초의 GPU 가속 양자 컴퓨팅 시스템인 NVIDIA DGX Quantum은 세계에서 가장 강력한 가속 컴퓨팅 플랫폼(NVIDIA Grace Hopper 슈퍼 칩 및 CUDA Quantum 오픈 소스 프로그래밍 모델로 구현됨)과 첨단 양자 제어 플랫폼 OPX(Quantum Machines 제공)와 결합하여 세계에서 가장 강력한 성능을 발휘합니다. 이 조합을 통해 연구자들은 양자 컴퓨팅과 최첨단 클래식 컴퓨팅을 결합하여 보정, 제어, 양자 오류 수정 및 하이브리드 알고리즘을 지원하는 전례 없는 강력한 애플리케이션을 구축할 수 있습니다.

DGX Quantum의 중심에는 PCIe를 통해 Quantum Machines OPX+에 연결된 NVIDIA Grace Hopper 시스템이 있어 GPU와 QPU(양자 처리 장치) 간에 마이크로초 미만의 대기 시간을 가능하게 합니다.

NVIDIA의 HPC 및 양자 부문 이사인 Tim Costa는 "양자 가속 슈퍼컴퓨팅은 과학과 산업을 재편할 수 있는 잠재력을 가지고 있으며 NVIDIA DGX Quantum은 연구자들이 양자 고전 컴퓨팅의 한계를 뛰어넘을 수 있도록 해줄 것입니다."라고 말했습니다.

그렇습니다. 따라서 NVIDIA는 회사의 새로운 Grace CPU와 함께 고성능 Hopper 아키텍처 GPU를 "Grace Hopper"에 통합하여 거대 AI 및 HPC 애플리케이션에 강력한 성능을 제공했습니다. 테라바이트 규모의 데이터를 실행하는 애플리케이션에 대해 최대 10배의 성능을 제공하여 양자 고전 연구자들이 세계에서 가장 복잡한 문제를 해결할 수 있는 더 많은 능력을 제공합니다.

DGX Quantum은 또한 개발자에게 현재 오픈 소스인 강력한 통합 소프트웨어 스택인 NVIDIA CUDA Quantum을 제공합니다. CUDA Quantum은 QPU, GPU, CPU를 하나의 시스템에 통합하고 프로그래밍하는 하이브리드 양자 고전 컴퓨팅 플랫폼입니다.

웹페이지에서 ChatGPT를 훈련하는 데 월 $37,000Microsoft는 GPT 전용 슈퍼컴퓨터를 구축하기 위해 수만 개의 A100을 구입하는 데 수억 달러를 썼습니다. 이제 ChatGPT를 훈련하기 위해 OpenAI와 Microsoft를 임대할 수 있습니다. 자신만의 대규모 모델을 훈련하려면 동일한 GPU를 검색해야 합니다.

NVIDIA가 제안한 DGX Cloud는 NVIDIA AI 소프트웨어와 결합된 전용 NVIDIA DGX AI 슈퍼컴퓨팅 클러스터를 제공합니다. 이 서비스를 통해 모든 기업은 간단한 웹 브라우저를 사용하여 AI 슈퍼컴퓨팅에 액세스할 수 있으므로 구입, 배포 및 관리가 필요하지 않습니다. 온프레미스 인프라의 복잡성.

보고서에 따르면 각 DGX Cloud 인스턴스에는 8개의 H100 또는 A100 80GB Tensor Core GPU가 있으며 노드당 총 640GB GPU 메모리가 있습니다. NVIDIA 네트워킹으로 구축된 고성능, 저지연 패브릭은 워크로드가 상호 연결된 시스템 클러스터 전체에 걸쳐 확장될 수 있도록 보장하여 여러 인스턴스가 하나의 거대한 GPU처럼 작동하여 고급 AI 교육의 성능 요구 사항을 충족할 수 있도록 합니다.

이제 기업은 DGX Cloud 클러스터를 월 단위로 임대하여 수요가 높은 컴퓨팅 리소스의 가속화를 기다리지 않고도 대규모 다중 노드 교육 워크로드 개발을 쉽고 빠르게 확장할 수 있습니다.

Huang Renxun에 따르면 월 임대 가격은 인스턴스당 월 $36,999부터 시작됩니다.

"우리는 iPhone의 인공 지능 시대에 살고 있습니다. 스타트업은 파괴적인 제품과 비즈니스 모델을 구축하기 위해 경쟁하고 있으며 기존 기업은 대응을 모색하고 있습니다. DGX Cloud는 고객에게 글로벌 규모의 NVIDIA AI 슈퍼컴퓨팅에 대한 즉각적인 액세스를 제공합니다." "

기업이 생성적 AI의 물결을 수용할 수 있도록 NVIDIA는 기업이 맞춤형 대규모 언어 모델과 생성적 AI 모델을 구축하고 개선할 수 있는 일련의 클라우드 서비스도 발표했습니다.

이제 사람들은 NVIDIA NeMo 언어 서비스와 NVIDIA Picasso 이미지, 비디오 및 3D 서비스를 사용하여 지능형 대화 및 고객 지원, 전문 콘텐츠 제작, 디지털 시뮬레이션 등을 위한 독점적인 도메인별 생성 AI 애플리케이션을 구축할 수 있습니다. 이와 별도로 NVIDIA는 NVIDIA BioNeMo 생물학 클라우드 서비스의 새로운 모델을 발표했습니다.

"제너레이티브 AI는 인간의 자연스러운 언어로 프로그래밍할 수 있는 새로운 유형의 컴퓨터입니다. 이 기능은 광범위합니다. 얼마 전까지만 해도 프로그래머의 영역이었던 문제를 누구나 컴퓨터에 명령하여 문제를 해결할 수 있습니다. 특허," 황이 말했다.

오늘 출시로 볼 때 NVIDIA는 기술 기업의 AI 워크로드를 위한 하드웨어 설계를 지속적으로 개선할 뿐만 아니라 새로운 비즈니스 모델도 제안하고 있습니다. 일부 사람들의 눈에는 NVIDIA가 "AI 분야의 TSMC"가 되기를 원합니다. 즉, 웨이퍼 공장과 같은 고급 생산성 파운드리 서비스를 제공하고, 다른 회사가 특정 시나리오에 맞게 AI 알고리즘을 훈련할 수 있도록 지원하는 것입니다.

NVIDIA의 슈퍼컴퓨터 교육을 사용하여 가격 차이를 벌기 위해 중개자가 필요하지 않도록 직접적으로 제거하는 것이 AI 개발의 미래 방향이 될까요?

위 내용은 NVIDIA, 추론 속도를 10배 향상시키는 ChatGPT 전용 GPU 출시의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!