하얼빈 공과대학(Harbin Institute of Technology)과 난양 공과대학(Nanyang Institute of Technology)은 AIGC에 가짜를 숨길 수 있는 공간을 제공하지 않는 세계 최초의 '다중 모드 DeepFake 탐지 및 위치 지정' 모델을 제안합니다.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-04-25 10:19:061680검색

Stable Diffusion과 같은 시각적 생성 모델의 급속한 발전으로 인해 충실도가 높은 얼굴 이미지가 자동으로 위조될 수 있어 점점 더 심각한 DeepFake 문제가 발생하고 있습니다.

ChatGPT와 같은 대규모 언어 모델의 등장으로 가짜 기사도 대량으로 쉽게 생성되고 허위 정보를 악의적으로 유포할 수 있습니다.

이를 위해 이미지 및 텍스트 형식에서 위의 AIGC 기술 위조를 처리하기 위해 일련의 단일 모달 감지 모델이 설계되었습니다. 그러나 이러한 방법은 새로운 위조 시나리오에서 다중 모드 가짜 뉴스 변조에 잘 대처할 수 없습니다.

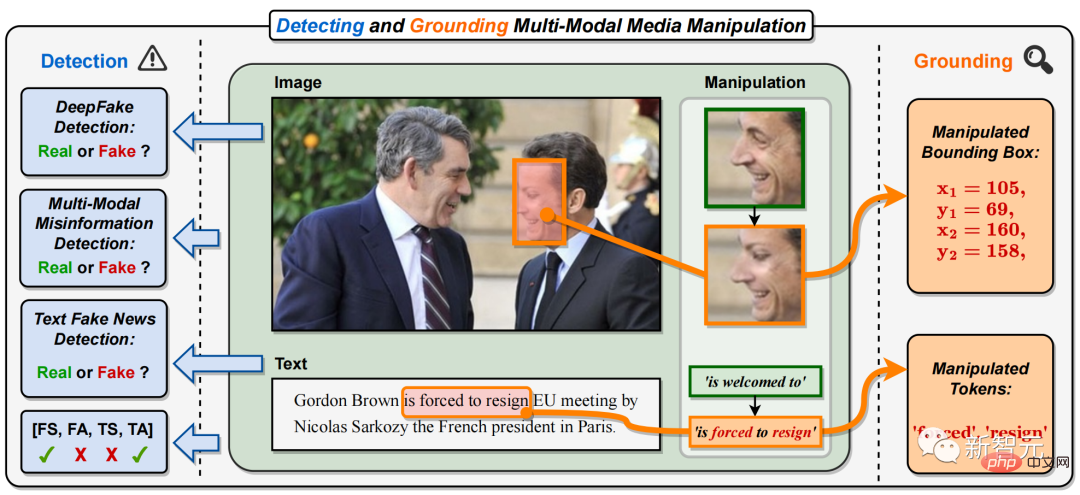

구체적으로, 다중 매체 변조에서는 각종 뉴스 보도 사진 속 주요 인물의 얼굴(그림 1의 프랑스 대통령 얼굴)이 교체되고, 본문의 핵심 문구나 단어가 변조됩니다( 그림 1에서 볼 수 있듯이 긍정적 문구인 "환영합니다"는 부정적인 문구인 "사임하도록 강요받습니다"로 변경되었습니다.

이는 주요 뉴스 인물의 신원을 변경하거나 은폐할 뿐만 아니라 뉴스 텍스트의 의미를 수정하거나 오도하여 인터넷에 대규모로 퍼지는 다양한 형태의 가짜 뉴스를 생성합니다.

그림 1. 본 논문에서는 다중 모드 미디어 변조(DGM4)를 탐지하고 찾아내는 작업을 제안합니다. 기존 단일 모달 DeepFake 탐지 작업과 달리 DGM4은 입력 이미지-텍스트 쌍의 참 및 거짓 분류를 예측할 뿐만 아니라 보다 세밀한 변조 유형을 탐지하고 이미지 변조 영역 및 텍스트 변조 단어를 찾으려고 시도합니다. 참 및 거짓 이진 분류 외에도 이 작업은 변조 감지에 대한 보다 포괄적인 설명과 심층적인 이해를 제공합니다.

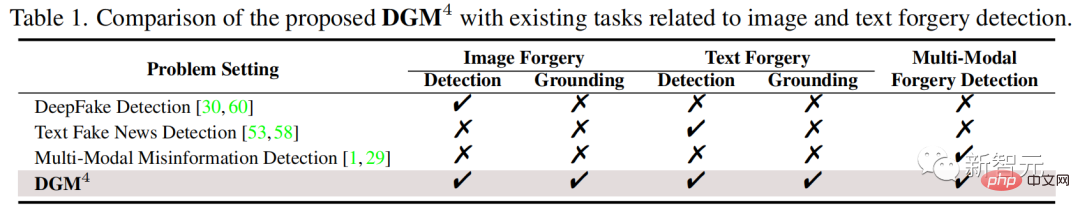

표 1: 제안된 DGM 4과 기존 이미지 및 텍스트 위조 탐지 관련 작업의 비교

이해를 위한 다중 모드 미디어 변조 작업 탐지 및 찾기

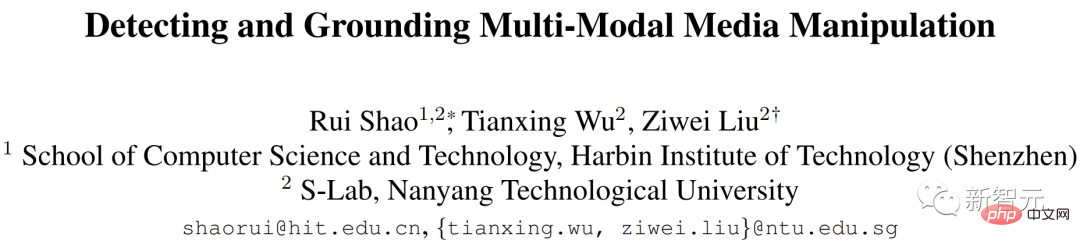

챌린지에서 하얼빈 공과대학(심천)과 난양 공과대학의 연구원들은 다중 모드 미디어 변조(DGM4)를 탐지하고 찾아내는 작업을 제안하고 DGM4 데이터 세트를 구축 및 오픈 소스화했으며 또한 제안했습니다. 다중 모드 계층적 변조 추론 모델. 현재 이 작업은 CVPR 2023에 포함되어 있습니다.

On 글 주소: https://arxiv.org/abs/2304.02556

GitHub: https://github.com/rshaojimmy/Multi Modal -딥페이크

프로젝트 홈페이지: https://rshaojimmy.github.io/Projects/MultiModal-DeepFake

그림 1과 표 1에서 볼 수 있듯이, 다중 모드 미디어 변조 작업 탐지 및 찾기 및 Grounding Multi-Modal Media Manipulation(DGM4))기존 단일 모달 변조 탐지와의 차이점은 다음과 같습니다.

1) 기존 DeepFake 이미지 탐지와 다르며 가짜 텍스트 탐지 방법은 단일 모달에 대해서만 탐지할 수 있습니다. 가짜 정보, DGM4에서는 이미지-텍스트 쌍의 다중 모드 변조를 동시에 탐지해야 합니다.

2) 바이너리 분류에 중점을 두는 기존 DeepFake 탐지와 달리 DGM4에서는 이미지 변조 영역과 텍스트 변조 위치를 더 고려합니다. 단어. 이를 위해서는 이미지-텍스트 양식 간의 변조에 대해 보다 포괄적이고 심층적인 추론을 수행하는 탐지 모델이 필요합니다.

다중 모드 미디어 변조 데이터 세트 감지 및 찾기

DGM4에 대한 연구를 지원하기 위해 그림 2에 표시된 것처럼 이 작업은 세계 최초의 다중 모드 미디어 변조 데이터 세트 감지 및 찾기(DGM) 4) 데이터세트.

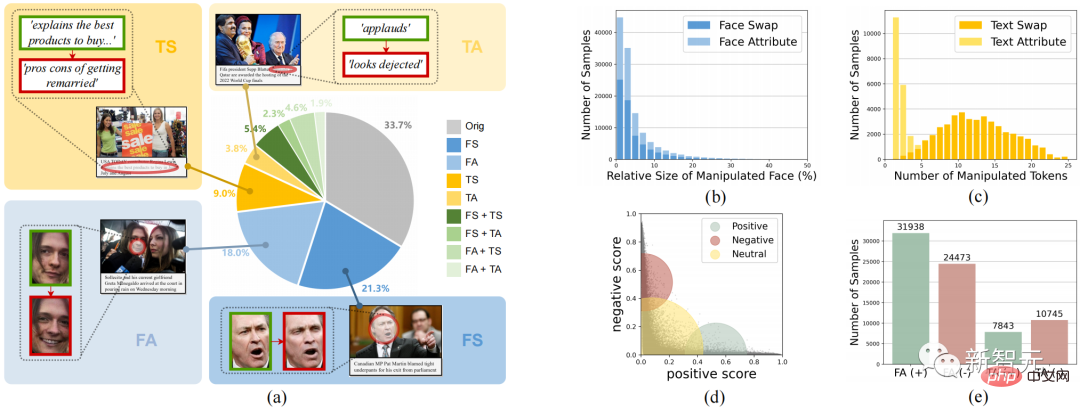

그림 2. DGM4dataset

DGM4dataset에서는 얼굴 대체 변조(FS), 얼굴 속성 변조(FA), 텍스트 대체 변조(TS) 등 4가지 유형의 변조를 조사합니다. , 텍스트 속성 변조(TA).

그림 2는 (a) 변조 유형 수의 분포, (b) 특히 얼굴 속성 변조의 경우 대부분의 이미지에서 변조된 영역의 크기가 작습니다. (c) ) 텍스트 속성 변조는 텍스트 대체 변조보다 변조된 단어가 적습니다. (d) 텍스트 감정 점수 분포 (e) 각 변조 유형에 대한 샘플 수.

이 데이터는 원본 이미지-텍스트 쌍 77,426개와 변조된 샘플 쌍 152,574개를 포함하여 총 230,000개의 이미지-텍스트 쌍 샘플을 생성했습니다. 변조된 샘플 쌍에는 66722 얼굴 교체 변조, 56411 얼굴 속성 변조, 43546 텍스트 교체 변조 및 18588 텍스트 속성 변조가 포함됩니다.다중 모드 계층적 변조 추론 모델

이 기사에서는 다중 모드 변조가 양식 간에 미묘한 의미적 불일치를 일으킬 것이라고 믿습니다. 따라서 양식 간의 의미적 특징을 융합하고 추론하여 변조된 샘플의 교차 양식 의미 불일치를 탐지하는 것이 DGM4을 다루는 이 기사의 주요 아이디어입니다.

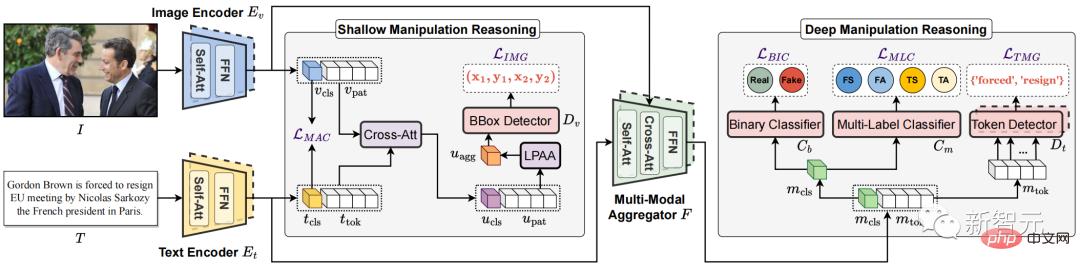

그림 3. 제안하는 다중 모드 계층적 변조 추론 모델 HierArchical Multi-modal Manipulation rEasoning tRansformer (HAMMER)

이러한 아이디어를 바탕으로 그림 3과 같이 본 논문에서는 다음과 같은 제안을 한다.다중 모드 계층적 변조 추론 모델 계층적 다중 모드 조작 추론 변환기(HAMMER).

이 모델은 트윈 타워 구조를 기반으로 한 다중 모드 의미 융합 및 추론의 모델 아키텍처를 기반으로 구축되었으며, 세밀한 수준에서 얕은 및 깊은 변조 추론을 통해 다중 모드 변조 탐지 및 위치를 구현합니다. 수준.구체적으로 그림 3과 같이 HAMMER 모델은 다음과 같은 두 가지 특징을 가지고 있습니다.

1) 얕은 변조 추론에서는

tamper-aware 대조 학습(Manipulation-Aware Contrastive Learning)을 통해 이미지 인코더와 텍스트 인코더에 의해 추출된 이미지와 텍스트의 단일 모달 의미 특징. 동시에, 단일 모달 내장 기능은 정보 상호 작용을 위해 교차 주의 메커니즘을 사용하고 Local Patch Attentional Aggregation은 이미지 변조 영역을 찾아내도록 설계되었습니다.

2) 심층 변조 추론에서, - 다중 모드 수집기의 교차 주의 메커니즘을 활용하여 다중 모드 의미 체계 기능을 더욱 융합합니다. 이를 기반으로 특수한 다중 모드 시퀀스 태깅과 다중 모드 다중 레이블 분류를 수행하여 텍스트 변조 단어를 찾고 보다 세밀한 변조 유형을 탐지합니다.실험 결과

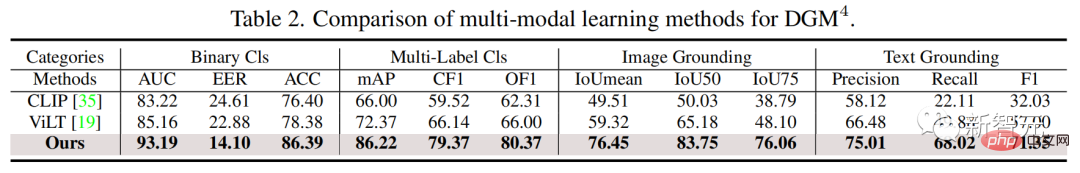

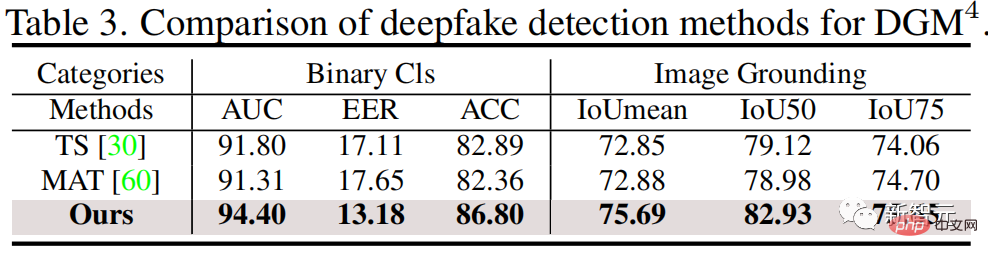

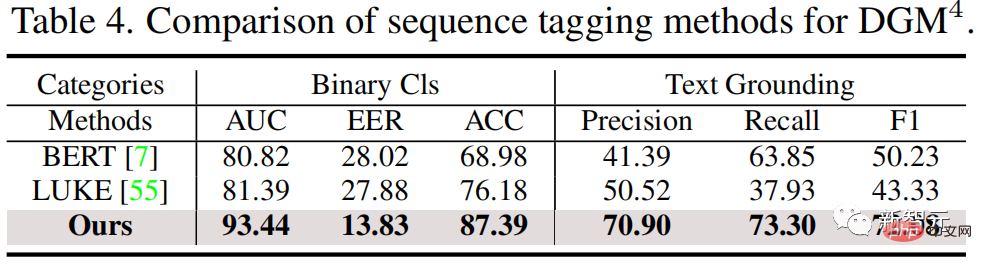

아래와 같이 실험 결과는 연구팀이 제안한 HAMMER가 다중 모드 및 단일 모드 탐지 방법에 비해 다중 모드 미디어 변조를 더 정확하게 탐지하고 위치를 찾을 수 있음을 보여줍니다.

그림 4. 다중 모드 변조 감지 및 위치 파악 결과 시각화

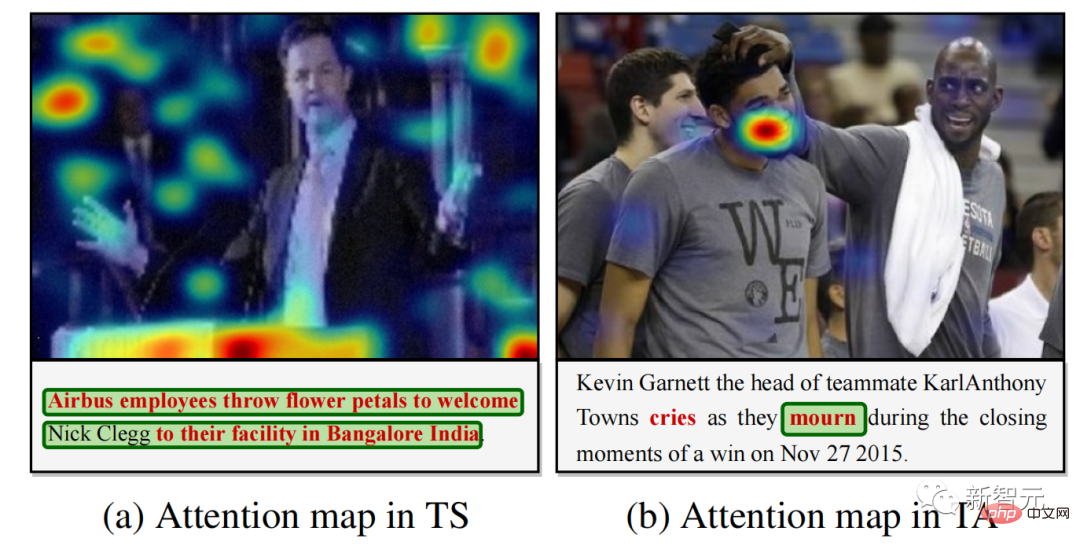

그림 5. 변조된 텍스트에 대한 모델 변조 감지 주의 시각화

그림 4는 일부 다중 모드를 제공합니다. 변조 감지 및 위치 파악 결과는 HAMMER가 변조 감지 및 위치 파악 작업을 동시에 정확하게 수행할 수 있음을 보여줍니다. 그림 5는 변조된 단어에 대한 모델 주의 시각화 결과를 제공하며, HAMMER가 변조된 텍스트와 의미상 일치하지 않는 이미지 영역에 초점을 맞춰 다중 모드 변조 감지 및 위치 파악을 수행함을 추가로 보여줍니다.

요약

- 이 작업은 새로운 연구 주제를 제안합니다: 다중 모드 가짜 뉴스를 처리하기 위해 다중 모드 미디어 변조를 탐지하고 찾아내는 작업입니다.

- 이 작업은 다중 모드 미디어 변조를 감지하고 찾기 위한 최초의 대규모 데이터 세트에 기여하고 변조 감지 및 위치에 대한 상세하고 풍부한 주석을 제공합니다. 팀은 이것이 다중 모드 가짜 뉴스 탐지에 대한 향후 연구에 도움이 될 수 있다고 믿습니다.

- 이 연구에서는 이 새로운 주제에 대한 좋은 시작 솔루션으로 강력한 다중 모드 계층적 변조 추론 모델을 제안합니다.

이 작업의 코드와 데이터세트 링크는 이 프로젝트의 GitHub에서 공유되었습니다. 누구나 이 GitHub Repo에 스타를 표시하고 DGM4데이터세트와 HAMMER를 사용하여 DGM4 문제를 연구할 수 있습니다. DeepFake 분야는 이미지의 단일 모드 탐지뿐만 아니라 시급히 해결해야 할 광범위한 다중 모드 변조 탐지 문제에 관한 것입니다!

위 내용은 하얼빈 공과대학(Harbin Institute of Technology)과 난양 공과대학(Nanyang Institute of Technology)은 AIGC에 가짜를 숨길 수 있는 공간을 제공하지 않는 세계 최초의 '다중 모드 DeepFake 탐지 및 위치 지정' 모델을 제안합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!