추론 속도는 Stable Diffusion보다 2배 빠르며, 하나의 Google 모델로 이미지 생성 및 복구가 가능하여 새로운 SOTA를 구현합니다.

- 王林앞으로

- 2023-04-14 18:49:031096검색

텍스트-이미지 생성은 2022년 가장 인기 있는 AIGC 방향 중 하나이며 "Science"에서 2022년 10대 과학 혁신 중 하나로 선정되었습니다. 최근 Google의 새로운 텍스트-이미지 생성 논문 "Muse: Text-To-Image Generation via Masked Generative Transformers"가 큰 주목을 받았습니다.

- 논문 주소: https://arxiv.org/pdf/2301.00704v1.pdf

- 프로젝트 주소: https://muse-model.github.io/

이 연구는 마스크된 이미지 모델링 접근 방식을 사용하여 텍스트-이미지 합성을 위한 새로운 모델을 제안합니다. 여기서 이미지 디코더 아키텍처는 사전 훈련되고 고정된 T5-XXL 대형 언어 모델(LLM) 인코더의 임베딩을 조건으로 기반으로 합니다. .

Google의 이전 Imagen 모델과 유사하게, 이 연구에서는 사전 훈련된 LLM을 기반으로 한 조정이 사실적인 고품질 이미지 생성에 중요하다는 것을 발견했습니다. Muse 모델은 Transformer(Vaswani et al., 2017) 아키텍처를 기반으로 구축되었습니다.

캐스케이드 픽셀 공간 확산 모델을 기반으로 하는 Imagen(Saharia et al., 2022) 또는 Dall-E2(Ramesh et al., 2022)와 비교하여 Muse는 개별 토큰을 사용하므로 효율성이 크게 향상됩니다. SOTA 자동 회귀 모델 Parti(Yu et al., 2022)와 비교할 때 Muse는 병렬 디코딩을 사용하므로 더 효율적입니다.

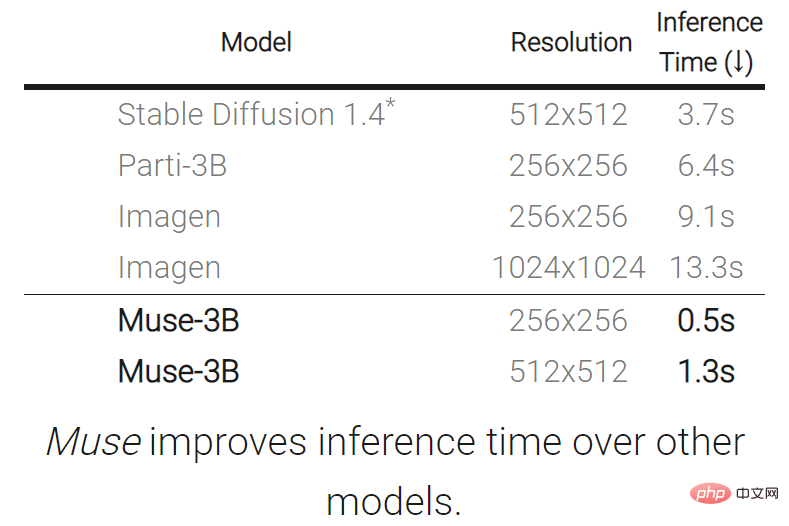

TPU-v4의 실험 결과를 바탕으로 연구원들은 Muse가 Imagen-3B 또는 Parti-3B 모델보다 추론 속도가 10배 이상 빠르고 Stable Diffusion v1.4보다 빠르다고 추정합니다(Rombach et al., 2022) 2배 더 빨라졌습니다. 연구원들은 추론 중에 더 많은 반복이 필요한 Stable Diffusion v1.4에서 확산 모델이 사용되기 때문에 Muse가 Stable Diffusion보다 빠르다고 믿습니다.

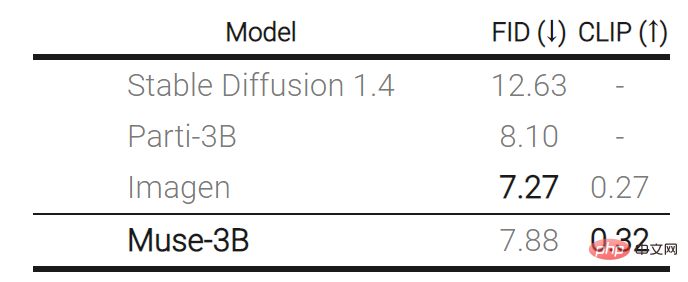

한편, Muse 효율성이 향상되었다고 해서 생성된 이미지의 품질이 저하되거나 입력 텍스트 프롬프트에 대한 모델의 의미론적 이해가 저하되는 것은 아닙니다. 이 연구에서는 CLIP 점수(Radford et al., 2021) 및 FID(Heusel et al., 2017)를 포함한 여러 기준에 대해 Muse의 생성 결과를 평가했습니다. Muse-3B 모델은 COCO(Lin et al., 2014) 제로샷 검증 벤치마크에서 CLIP 점수 0.32와 FID 점수 7.88을 달성했습니다.

Muse 생성 효과를 살펴보겠습니다.

텍스트 이미지 생성: Muse 모델은 텍스트 프롬프트에서 고품질 이미지를 빠르게 생성합니다(TPUv4에서는 512x512 해상도 이미지를 생성하는 데 1.3초가 소요됨) 256x256 해상도 이미지의 경우 0.5초 소요). 예를 들어, "자전거를 타는 곰과 핸들바에 앉은 새"를 생성합니다.

Muse 모델은 텍스트 프롬프트 조건에서 이미지 토큰을 반복적으로 리샘플링하여 사용자에게 제로 샘플, 노샘플링 데이터를 제공합니다. 마스크 없는 편집.

Muse는 "아름다운 단풍을 배경으로 호수 위에 전망대가 있습니다."와 같은 마스크 기반 편집도 제공합니다.

모델 소개

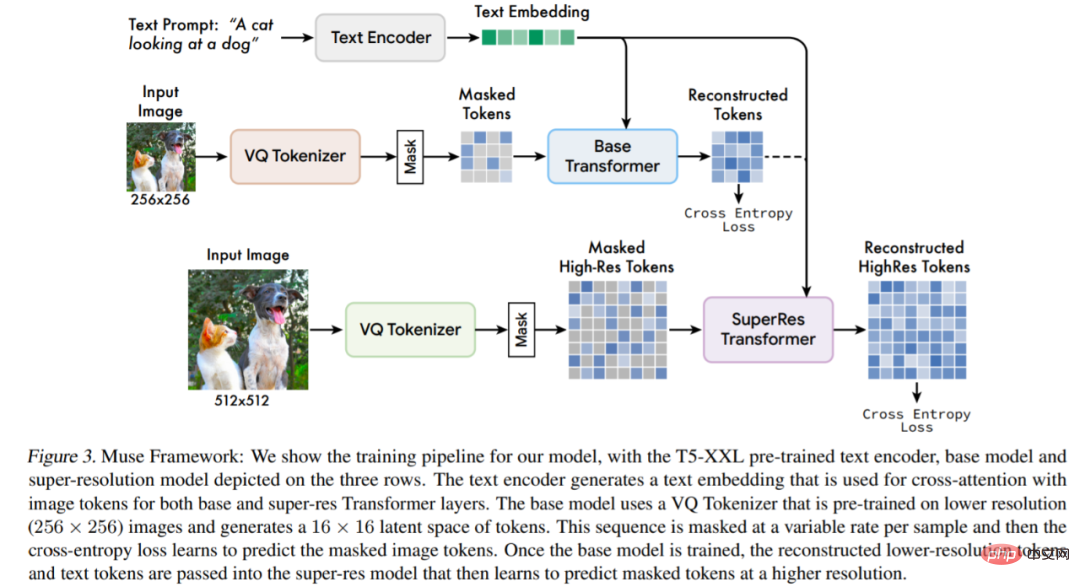

Muse는 다양한 구성 요소를 기반으로 구축되었으며 그림 3은 모델 아키텍처의 개요를 제공합니다.

구체적으로 포함된 구성 요소는 다음과 같습니다.

사전 훈련된 텍스트 인코더: 이 연구에서는 사전 훈련된 LLM(대형 언어 모델)을 활용하면 이미지 생성 품질을 향상시킬 수 있다는 것을 발견했습니다. 그들은 Muse 모델이 LLM 임베딩의 풍부한 시각적 및 의미론적 개념을 생성된 이미지에 매핑하는 방법을 학습했다고 가정했습니다. 입력된 텍스트 자막이 주어지면 연구에서는 이를 고정된 T5-XXL 인코더를 통해 전달하여 4096차원 언어 임베딩 벡터 시퀀스를 생성합니다. 이러한 임베딩 벡터는 Transformer 모델에 선형으로 투영됩니다.

의미론적 토큰화를 위해 VQGAN 사용: 이 모델의 핵심 구성 요소는 VQGAN 모델에서 얻은 의미론적 토큰을 사용하는 것입니다. 이 중 VQGAN은 인코더(Encoder)와 디코더(Decoder)로 구성되며, 양자화 레이어(Quantization Layer)는 입력 이미지를 학습 코드북의 토큰 시퀀스에 매핑한다. 이 연구는 모두 컨볼루셔널 레이어를 사용하여 다양한 해상도의 이미지 인코딩을 지원하는 인코더와 디코더를 구축합니다.

기본 모델: 기본 모델은 입력이 T5에 프로젝션된 임베딩 및 이미지 토큰인 마스크 변환기입니다. 연구에서는 모든 텍스트 임베딩(마스크 해제)을 유지하고 다양한 비율의 이미지 토큰을 무작위로 마스크한 후 특수 [마스크] 토큰으로 대체합니다.

초해상도 모델: 이 연구에서는 일련의 모델을 사용하는 것이 유익하다는 사실을 발견했습니다. 먼저 16 × 16 잠재 맵(256 × 256 이미지에 해당)을 생성하는 기본 모델을 생성한 다음 기본 잠재 맵을 업샘플링합니다. 초해상도 모델은 64×64 전위 맵(512×512 이미지에 해당)이다.

디코더 미세 조정: 미세한 세부 사항을 생성하는 모델의 능력을 더욱 향상시키기 위해 이 연구에서는 인코더 용량을 변경하지 않고 유지하면서 더 많은 잔여 레이어와 채널을 추가하여 VQGAN 디코더의 용량을 늘립니다. 그런 다음 VQGAN 인코더 가중치, 코드북 및 변환기(즉, 기본 모델 및 초해상도 모델)를 동결하면서 새로운 디코더 계층을 미세 조정합니다.

위 구성 요소 외에도 Muse에는 가변 마스크 비율 구성 요소, 추론 중 반복 병렬 디코딩 구성 요소 등이 포함되어 있습니다.

실험 및 결과

아래 표와 같이 Muse는 다른 모델에 비해 추론 시간을 단축합니다.

다음 표는 제로샷 COCO에서 모델별로 측정한 FID 및 CLIP 점수입니다.

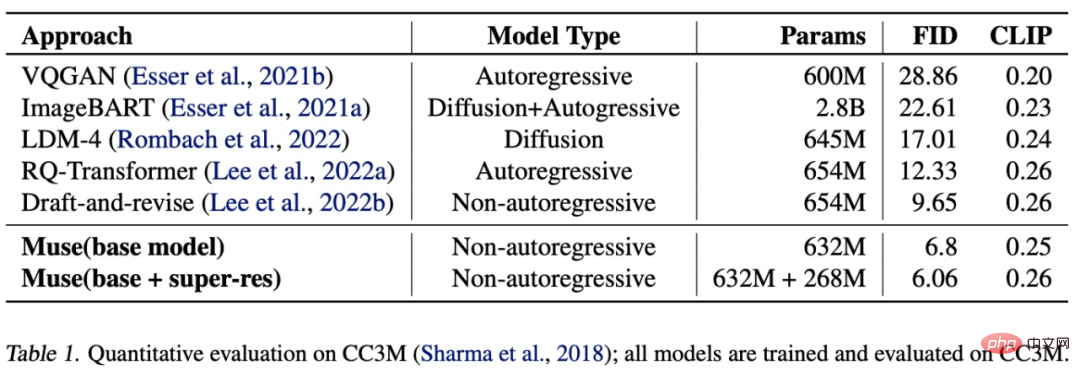

아래 표와 같이 Muse(632M(기본)+268M(슈퍼) -res) 파라메트릭 모델)은 CC3M 데이터 세트에서 훈련 및 평가했을 때 SOTA FID 점수 6.06을 얻었습니다.

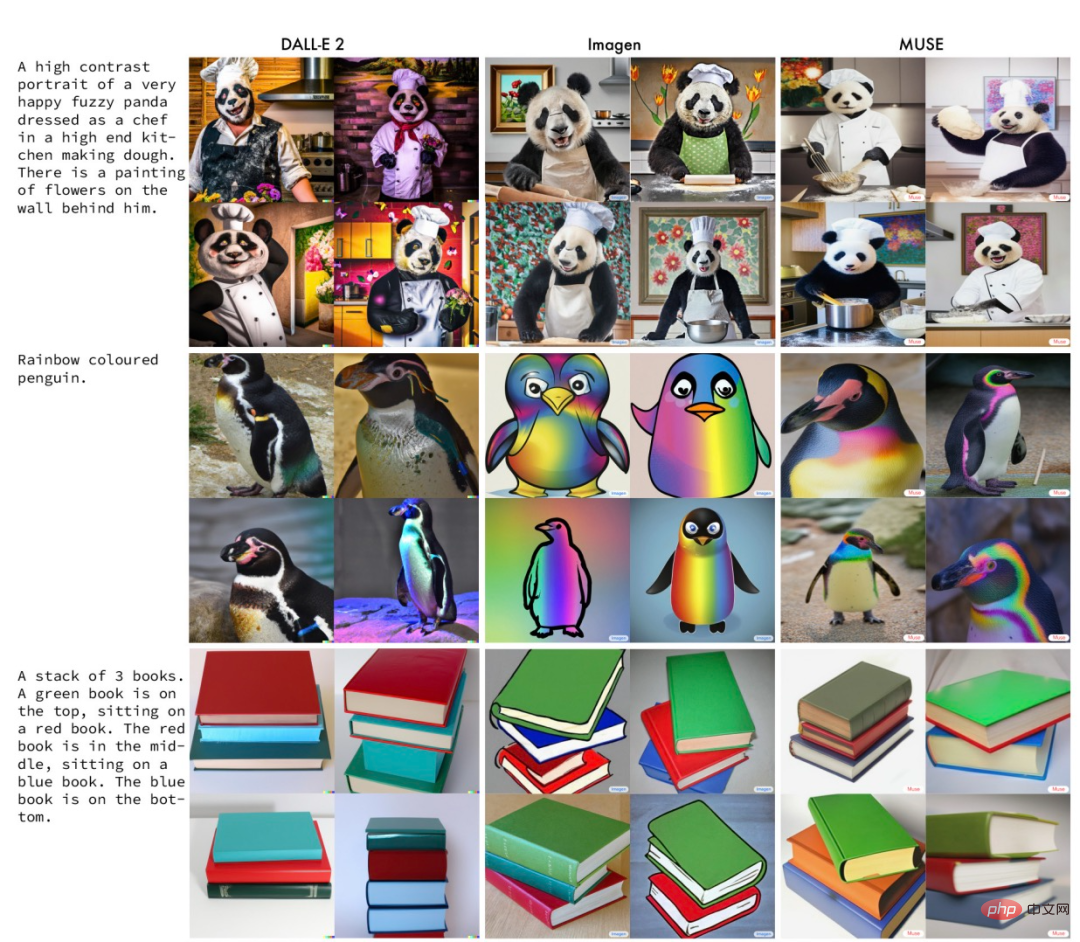

아래 그림은 동일한 프롬프트에서 Muse, Imagen 및 DALL-E 2가 생성한 결과의 예입니다.

관심 있는 독자는 논문의 원문을 읽고 더 많은 연구 세부 사항을 알아볼 수 있습니다.

위 내용은 추론 속도는 Stable Diffusion보다 2배 빠르며, 하나의 Google 모델로 이미지 생성 및 복구가 가능하여 새로운 SOTA를 구현합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!