단일 자연 이미지에서 확산 모델을 학습하는 것이 GAN보다 낫습니다. SinDiffusion은 새로운 SOTA를 달성합니다.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-04-14 18:10:071675검색

하나의 자연 이미지에서 이미지를 생성하는 기술이 널리 활용되면서 점점 더 많은 주목을 받고 있습니다. 본 연구의 목표는 단일 자연 이미지에서 무조건 생성 모델을 학습하여 패치 내부 통계를 캡처하여 유사한 시각적 콘텐츠를 가진 다양한 샘플을 생성하는 것입니다. 학습된 모델은 해상도에 독립적인 고품질 이미지를 생성할 수 있을 뿐만 아니라 이미지 편집, 이미지 조화, 이미지 간 변환 등 다양한 애플리케이션에 쉽게 적용할 수 있습니다.

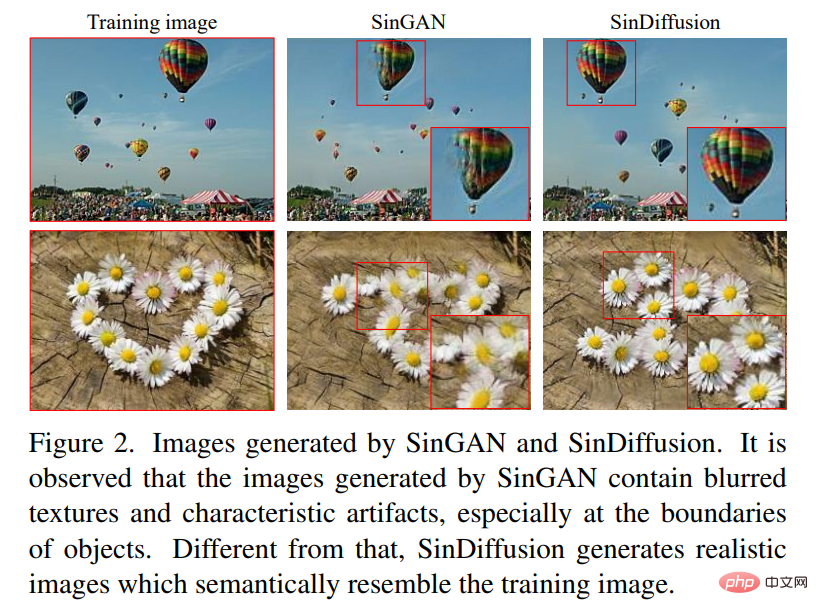

SinGAN은 위의 요구 사항을 충족할 수 있습니다. 이 방법은 여러 규모의 자연 이미지를 구성하고 일련의 GAN을 훈련하여 단일 이미지에서 패치의 내부 통계를 학습할 수 있습니다. SinGAN의 핵심 아이디어는 점진적으로 증가하는 규모로 여러 모델을 훈련하는 것입니다. 그러나 이러한 방법으로 생성된 이미지는 소규모 세부 오류로 인해 생성된 이미지에 명백한 아티팩트가 발생하기 때문에 만족스럽지 못할 수 있습니다(그림 2 참조).

이 기사에서 중국 과학기술대학교, Microsoft Research Asia 및 기타 기관의 연구원들은 It에 새로운 프레임워크인 단일 이미지 확산 모델(SinDiffusion, Single-image Diffusion)을 제안했습니다. DDPM(Denoising Diffusion Probabilistic Model)을 기반으로 하는 단일 자연 이미지로부터 학습하는 데 사용됩니다. 확산 모델은 다단계 생성 과정이지만 누적 오류 문제가 없습니다. 그 이유는 확산 모델은 체계적인 수학적 공식을 가지고 있어 중간 단계의 오류가 간섭으로 간주되어 확산 과정에서 개선될 수 있기 때문입니다.

SinDiffusion의 또 다른 핵심 디자인은 확산 모델의 수용 영역을 제한하는 것입니다. 본 연구에서는 기존 확산 모델에서 일반적으로 사용되는 네트워크 구조를 검토한 결과[7], 더 강력한 성능과 더 깊은 구조를 가지고 있음을 확인했습니다. 그러나 이 네트워크 구조의 수용 필드는 전체 이미지를 포괄할 만큼 충분히 크기 때문에 모델은 훈련 이미지와 정확히 동일한 이미지를 생성하기 위해 메모리 훈련 이미지에 의존하는 경향이 있습니다. 모델이 전체 이미지를 기억하는 대신 패치 통계를 학습하도록 장려하기 위해 연구에서는 네트워크 구조를 신중하게 설계하고 패치 방식 노이즈 제거 네트워크를 도입했습니다. 이전 확산 구조와 비교하여 SinDiffusion은 원래 노이즈 제거 네트워크 구조에서 다운샘플링 수와 ResBlock 수를 줄입니다. 이러한 방식으로 SinDiffusion은 단일 자연 이미지에서 학습하고 고품질의 다양한 이미지를 생성할 수 있습니다(그림 2 참조).

- 논문 주소: https://arxiv.org/pdf/2211.12445.pdf

- 프로젝트 주소: https://github.com/WeilunWang/SinDiffusion

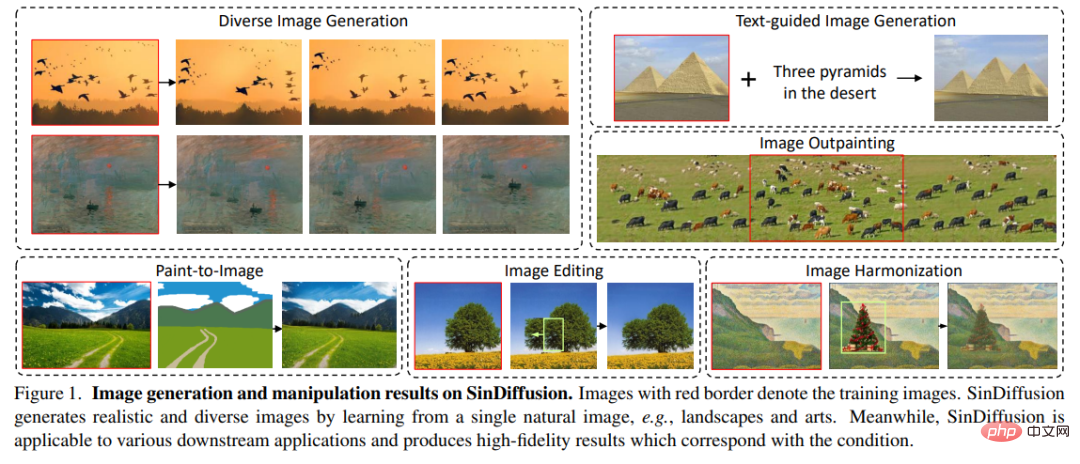

SinDiffusion의 장점은 다양한 시나리오에서 유연하게 사용할 수 있다는 것입니다(그림 1 참조). 모델을 재교육하지 않고도 다양한 애플리케이션에 사용할 수 있습니다. SinGAN에서 다운스트림 애플리케이션은 주로 다양한 규모의 사전 훈련된 GAN에 조건을 입력하여 구현됩니다. 따라서 SinGAN의 적용은 주어진 공간적으로 정렬된 조건으로 제한됩니다. 대조적으로, SinDiffusion은 샘플링 절차를 설계함으로써 더 넓은 범위의 응용 분야에서 사용될 수 있습니다. SinDiffusion은 무조건 훈련을 통해 데이터 분포의 기울기를 예측하는 방법을 학습합니다. 생성된 이미지와 조건(예: L-p 거리 또는 CLIP과 같은 사전 훈련된 네트워크) 간의 상관 관계를 설명하는 점수 함수가 있다고 가정하면 이 연구에서는 상관 점수의 기울기를 활용하여 SinDiffusion의 샘플링 프로세스를 안내합니다. 이러한 방식으로 SinDiffusion은 데이터 분포와 주어진 조건 모두에 맞는 이미지를 생성할 수 있습니다.

이 연구는 풍경과 유명 예술 작품을 포함한 다양한 자연 이미지에 대한 실험을 수행하여 제안된 프레임워크의 장점을 보여줍니다. 정량적 및 정성적 결과 모두 SinDiffusion이 충실도가 높고 다양한 결과를 생성할 수 있음을 확인하는 동시에 다운스트림 애플리케이션은 SinDiffusion의 유용성과 유연성을 더욱 입증합니다.

방법

이전 연구의 점진적인 성장 설계와 달리 SinDiffusion은 학습을 위해 단일 규모의 단일 노이즈 제거 모델을 사용하여 오류의 누적을 방지합니다. 또한 본 연구에서는 확산 네트워크의 패치 수준 수용 영역이 내부 패치 분포를 포착하는 데 중요한 역할을 한다는 사실을 확인하고 새로운 노이즈 제거 네트워크 구조를 설계했습니다. SinDiffusion은 이 두 가지 핵심 디자인을 기반으로 하나의 자연 이미지에서 고품질의 다양한 이미지를 생성합니다.

이 섹션의 나머지 부분은 다음과 같이 구성됩니다. 먼저 SinGAN을 검토하고 SinDiffusion의 동기를 보여준 다음 SinDiffusion의 구조 설계를 소개합니다.

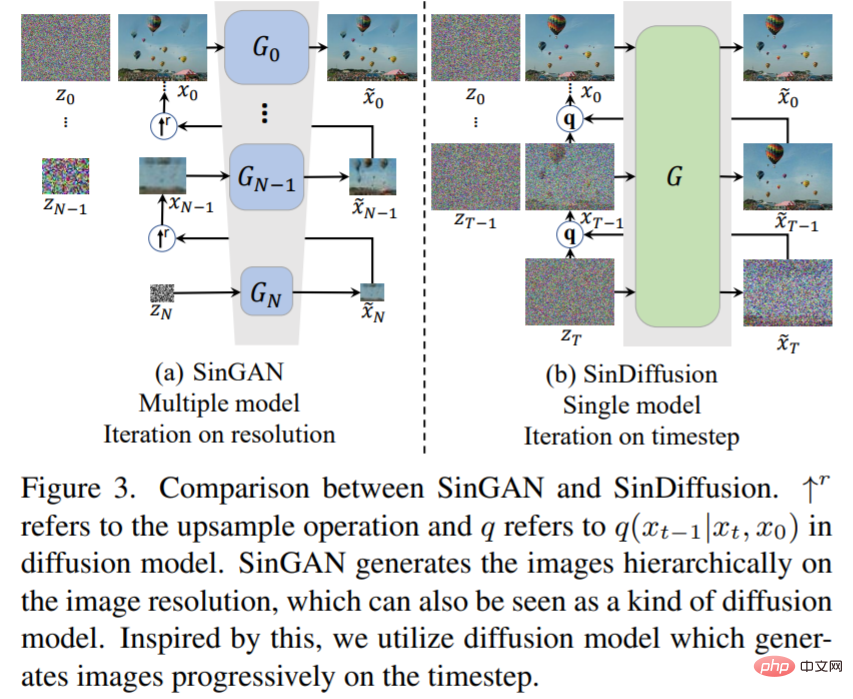

먼저 SinGAN에 대해 간단히 살펴보겠습니다. 그림 3(a)는 SinGAN의 생성 과정을 보여준다. 단일 이미지에서 다양한 이미지를 생성하기 위해 SinGAN의 핵심 설계는 이미지 피라미드를 구축하고 생성된 이미지의 해상도를 점진적으로 높이는 것입니다.

그림 3(b)는 SinDiffusion의 새로운 프레임워크를 보여줍니다. SinGAN과 달리 SinDiffusion은 단일 규모의 단일 노이즈 제거 네트워크를 사용하여 다단계 생성 프로세스를 수행합니다. SinDiffusion도 SinGAN과 동일한 다단계 생성 프로세스를 사용하지만 생성된 결과는 고품질입니다. 확산 모델은 수학 방정식의 체계적인 유도를 기반으로 하며, 확산 과정에서 중간 단계에서 발생하는 오류가 반복적으로 노이즈로 정제되기 때문입니다.

SinDiffusion

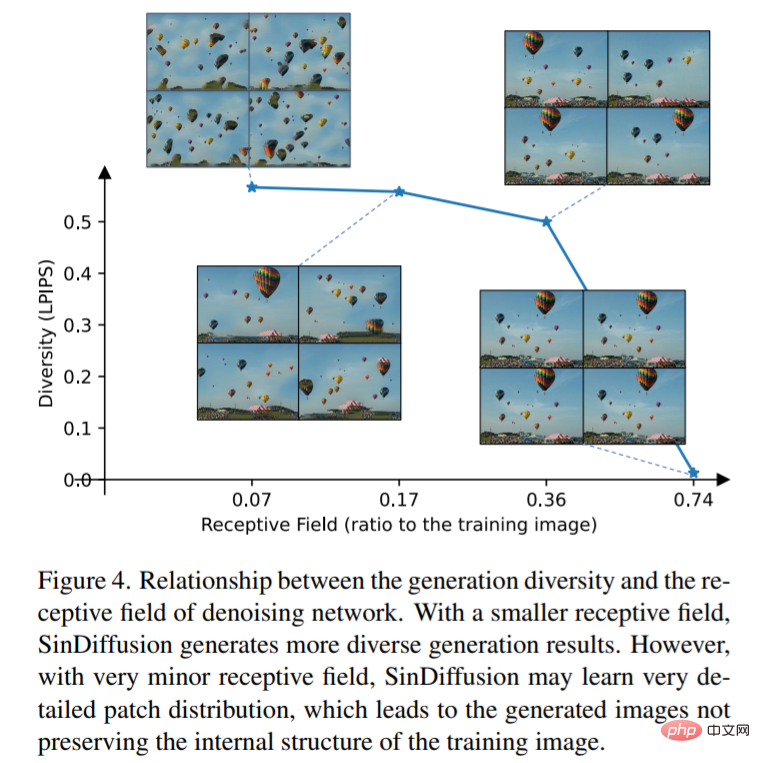

이 글에서는 세대 다양성과 잡음 제거 네트워크의 수용 필드 사이의 관계를 연구합니다. 잡음 제거 네트워크의 네트워크 구조를 수정하면 수용 필드가 바뀔 수 있으며, 네 가지 이러한 모델은 수용 필드는 다르지만 성능은 비슷한 네트워크 구조를 사용하여 단일 자연 이미지에 대해 훈련됩니다. 그림 4는 다양한 수용 필드에서 모델에 의해 생성된 결과를 보여줍니다. 수용 필드가 작을수록 SinDiffusion에 의해 생성된 결과가 더 다양해지고 그 반대도 마찬가지라는 것을 알 수 있습니다. 그러나 연구 결과에 따르면 극히 작은 수용 필드 모델은 이미지의 합리적인 구조를 유지할 수 없는 것으로 나타났습니다. 따라서 합리적인 패치 통계를 얻으려면 적절한 수용 필드가 중요하고 필요합니다.

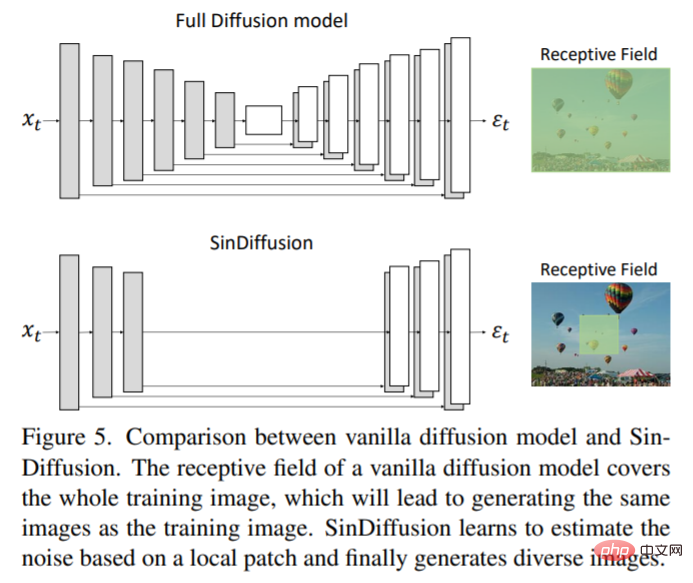

이 연구는 일반적으로 사용되는 확산 모델을 재설계하고 단일 이미지 생성을 위한 패치 방식 노이즈 제거 네트워크를 도입합니다. 그림 5는 SinDiffusion의 패치별 노이즈 제거 네트워크에 대한 개요이며 이전 노이즈 제거 네트워크와의 주요 차이점을 보여줍니다. 첫째, 다운샘플링과 업샘플링 작업을 줄여 잡음 제거 네트워크의 깊이를 줄여 수신 영역을 크게 확장합니다. 동시에, 원래 노이즈 제거 네트워크에 사용된 딥 어텐션 레이어가 자연스럽게 제거되어 SinDiffusion이 모든 해상도에서 생성하기에 적합한 완전한 컨벌루션 네트워크가 됩니다. 둘째, SinDiffusion의 수용 필드는 각 해상도에 포함된 시간의 재블록을 줄임으로써 더욱 제한됩니다. 이 방법은 적절한 수용 필드를 갖춘 패치 방식 노이즈 제거 네트워크를 획득하여 현실적이고 다양한 결과를 얻는 데 사용됩니다.

Experiment

SinDiffusion 무작위로 생성된 이미지의 정성적 결과는 그림 6에 나와 있습니다.

다양한 해상도에서 SinDiffusion은 훈련 이미지와 유사한 패턴으로 실제 이미지를 생성할 수 있음을 확인할 수 있습니다.

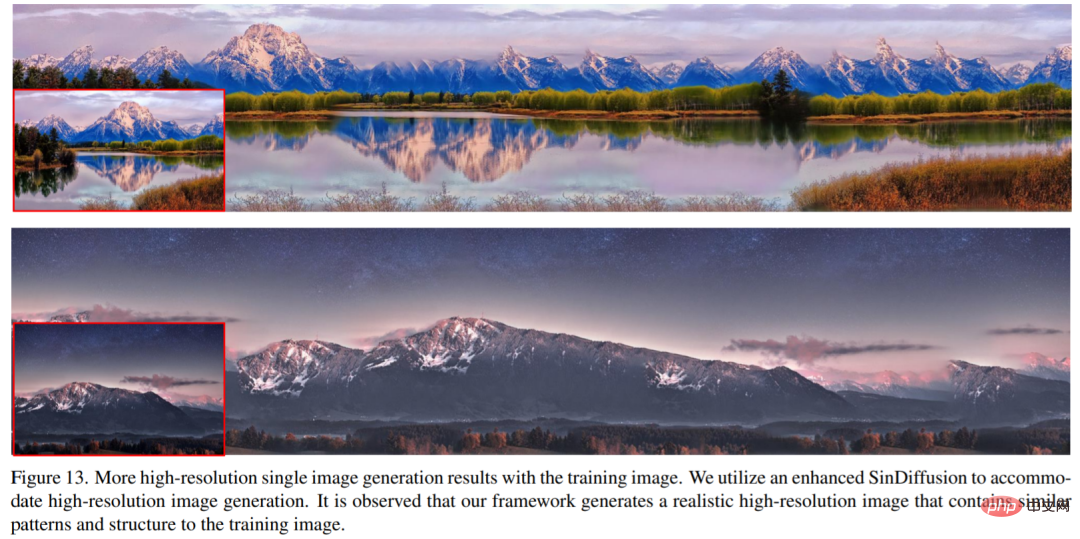

또한 이 기사에서는 단일 이미지에서 고해상도 이미지를 생성하는 방법에 대한 SinDiffusion을 연구합니다. 그림 13은 훈련 이미지와 생성된 결과를 보여줍니다. 훈련 이미지는 구름, 산, 풀, 꽃, 호수 등 풍부한 구성요소를 포함하는 486×741 해상도의 풍경 이미지입니다. 고해상도 이미지 생성을 수용하기 위해 SinDiffusion은 더 큰 수용 필드와 네트워크 기능을 갖춘 향상된 버전으로 업그레이드되었습니다. 향상된 버전의 SinDiffusion은 486×2048 해상도의 고해상도 긴 스크롤 이미지를 생성합니다. 생성된 효과는 그림 13과 같이 훈련 이미지의 내부 레이아웃을 변경하지 않고 새로운 콘텐츠를 요약합니다.

이전 방법과의 비교

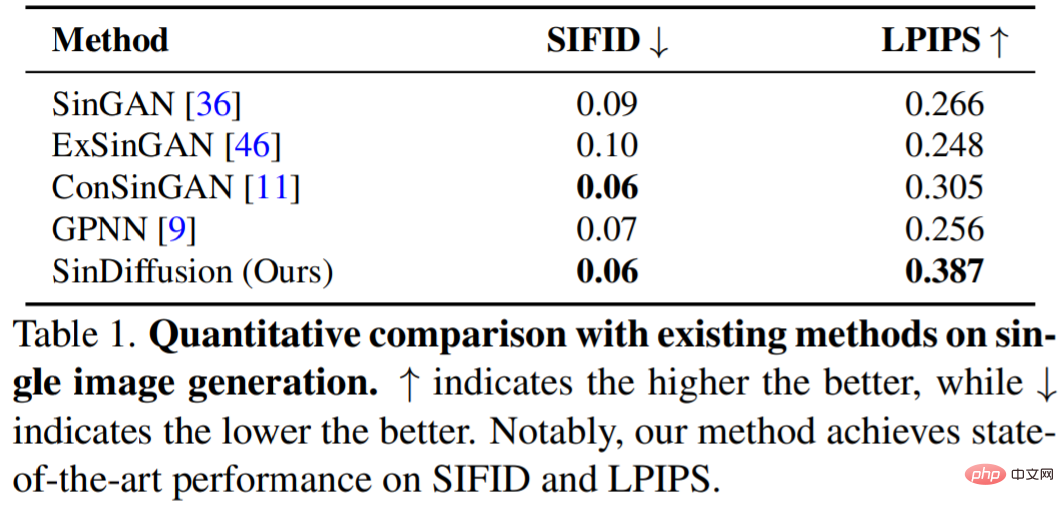

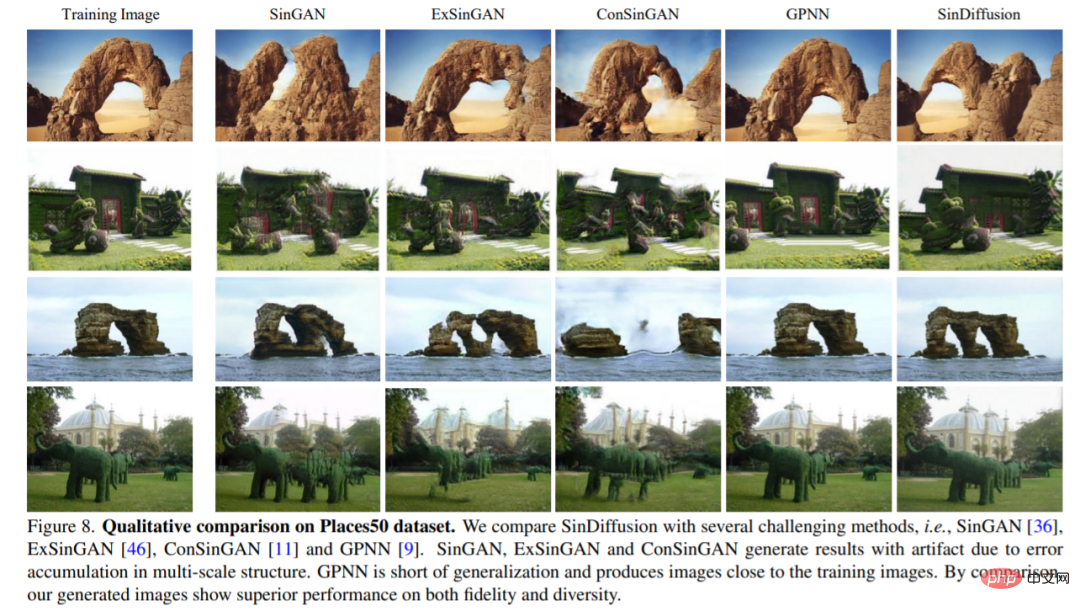

표 1은 SinGAN, ExSinGAN, ConSinGAN 및 GPNN과 같은 몇 가지 까다로운 방법과 비교하여 SinDiffusion에서 생성된 정량적 결과를 보여줍니다. 이전 GAN 기반 방법과 비교하여 SinDiffusion은 점진적인 개선을 거쳐 SOTA 성능을 달성했습니다. 이 기사의 연구 방법은 생성된 이미지의 다양성을 크게 향상시킨다는 점을 언급할 가치가 있습니다. Places50 데이터 세트에서 훈련된 평균 50개의 모델에서 이 방법은 +0.082 LPIPS 방법으로 현재 가장 까다로운 모델을 초과합니다.

그림 8은 정량적 결과 외에도 Places50 데이터세트에 대한 정성적 결과도 보여줍니다.

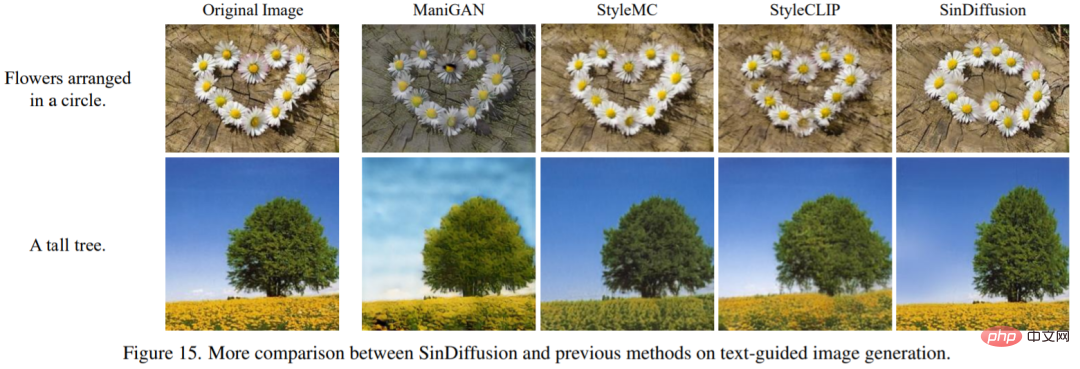

그림 15는 SinDiffusion과 이전 방법의 텍스트 기반 이미지 생성 결과를 보여줍니다.

자세한 내용은 원본 문서를 참조하세요.

위 내용은 단일 자연 이미지에서 확산 모델을 학습하는 것이 GAN보다 낫습니다. SinDiffusion은 새로운 SOTA를 달성합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!