모델이 '더 커지면' AGI에 직접 연결될 수 있습니까? 마커스가 다시 폭격을 가했습니다. 세 가지 위기가 나타났습니다!

- 王林앞으로

- 2023-04-13 14:58:031704검색

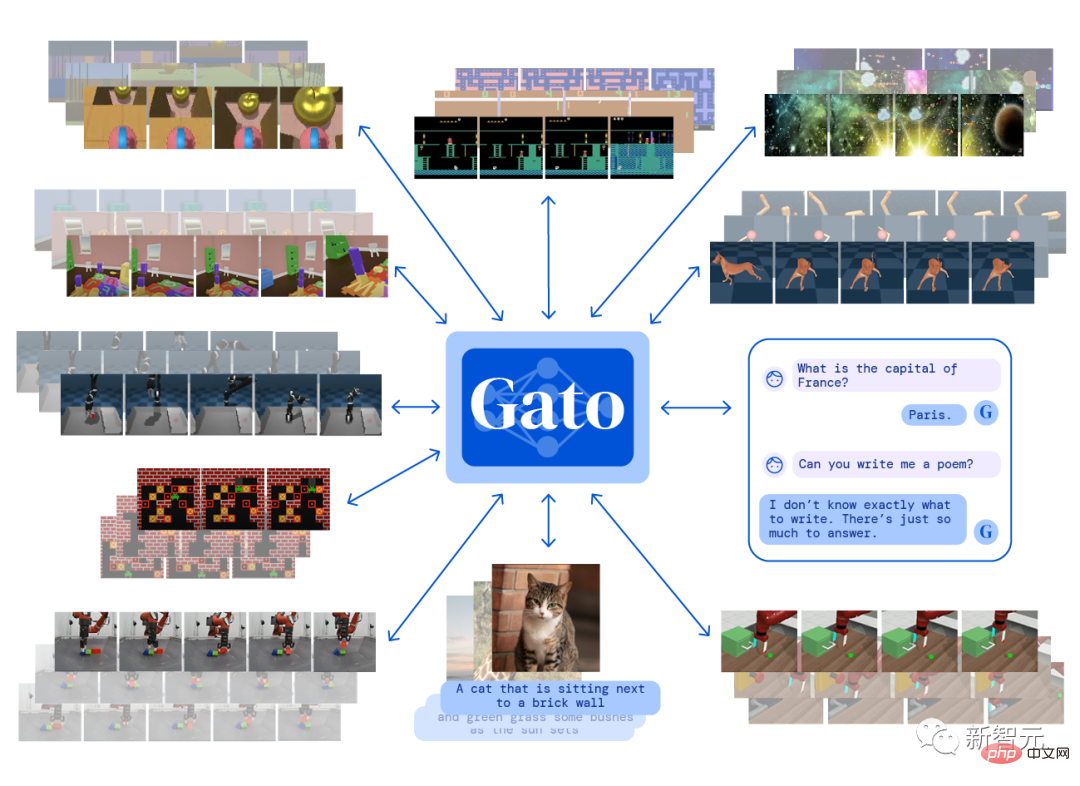

올해 5월 딥마인드는 단 하나의 모델 매개변수 세트로 동시에 600개 이상의 다양한 작업을 수행할 수 있는 다중 모드 인공지능 시스템인 Gato를 출시했으며, 이는 일시적으로 일반 인공지능(AGI)에 대한 열띤 논의를 불러일으켰습니다. 업계.

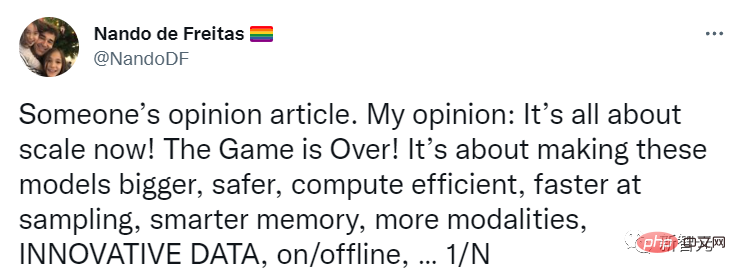

딥마인드의 연구 책임자인 난도 데 프레이타스(Nando de Freitas)도 당시 트위터를 통해 규모가 계속 커지는 한 AI도 통과할 수 있다고 밝혔습니다!

우리가 해야 할 일은 모델을 더 크고, 더 안전하고, 더 계산 효율적으로 만들고, 더 빠르게 샘플링하고, 더 스마트하게 저장하고, 더 많은 양식을 만들고, 데이터, 온라인/오프라인 등을 혁신하는 것뿐입니다.

AGI는 규모 문제만 해결되면 도달할 수 있습니다. 업계에서는 이러한 문제에 더 많은 관심을 기울여야 합니다!

최근 유명한 AI 학자이자 Robust.AI의 창립자 겸 CEO이자 뉴욕대학교 명예교수인 Gary Marcus는 또 다른 블로그를 통해 이 발언은 "너무 이르다"며 위기가 시작되었다고 주장했습니다!

마커스는 계속해서 AI 산업의 발전에 관심을 기울이고 있지만, AI의 과대광고에 대해서는 비판적이다. 그는 "딥 러닝이 벽에 부딪힌다", "GPT-3는 전혀 의미가 없다" 등의 반대 의견을 표명했습니다.

대형 모델을 가지고 놀 수 없다면 어떻게 해야 하나요?

Nando는 인공 지능에 패러다임 전환이 필요하지 않으며 더 많은 데이터, 더 높은 효율성 및 더 큰 서버만 필요하다고 믿습니다.

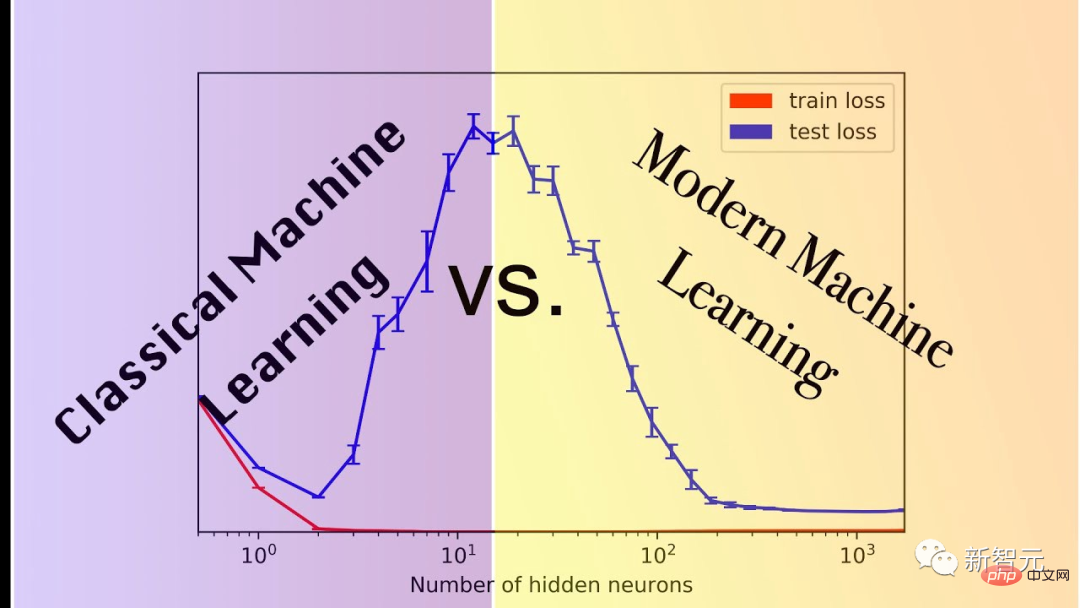

Marcus는 이 가설을 다음과 같이 해석했습니다. 근본적인 새로운 혁신이 없으면 AGI는 대규모 모델에서 나타날 수 있습니다. 이 가정은 스케일링-우버-알레스(scaling-über-alles)라고도 불릴 수 있습니다.

현재 스케일링 최대화라고도 불리는 그의 가설은 여전히 매우 인기가 높습니다. 그 이유는 점점 더 큰 모델이 실제로 매우 강력하고 이미지 생성과 같은 작업에는 대형 모델의 도움이 필요하기 때문입니다.

하지만 그건 지금까지일 뿐입니다.

문제는 몇 달, 심지어 몇 년에 걸쳐 개선된 일부 기술이 실제로 우리가 필요로 하는 규모에 미치지 못한다는 것입니다.

규모에 따른 성과 이점은 단지 경험적 관찰의 결과일 뿐이며 정확하다고 보장할 수 없는 폰지 사기가 점점 더 많아지고 있습니다.

Marcus는 규모 극대화 가설의 종말을 나타낼 수 있는 세 가지 최근 징후를 공유합니다.

1. 전 세계적으로 최대 규모를 지원할 만큼 데이터 양이 충분하지 않을 수 있습니다.

많은 분들이 이에 대해 걱정하기 시작했습니다.

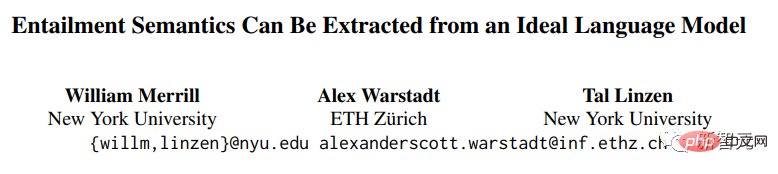

뉴욕대학교와 ETH Zurich의 연구원 William Merrill, Alex Warstadt, Tal Linzen은 최근 "현재의 신경 언어 모델은 대량의 데이터 없이는 자연어의 의미를 추출하는 데 적합하지 않다"는 증거를 제안했습니다.

논문 링크: https://arxiv.org/pdf/2209.12407.pdf

이 증명에는 반박 증거로 사용하기에는 너무 많은 전제가 포함되어 있지만, 이 가정에 접근하면 다음과 같은 일이 발생할 수 있습니다. 대규모의 문제는 매우 빠르게 발생합니다.

2. 최대 규모를 지원하기에는 전 세계적으로 사용 가능한 컴퓨팅 리소스가 충분하지 않을 수 있습니다.

Miguel Solano는 최근 Marcus에게 공동 집필 원고를 보냈습니다. 저자는 BIG-bench와 같은 현재의 슈퍼 벤치마크에 도달하려면 2022년에 미국 전력 소비량의 4분의 1을 소비해야 한다고 믿습니다.

저장소 링크:https://www.php.cn/link/e21bd8ab999859f3642d2227e682e66f

BIG-bench는 대규모 언어 모델을 탐색하고 미래 기능을 추론하도록 설계된 크라우드소싱 벤치마크 데이터세트입니다. 여기에는 200개 이상의 미션이 포함됩니다.

3. 일부 중요한 작업은 단순히 규모가 확장되지 않을 수 있습니다.

가장 분명한 예는 언어의 화용적 의미를 연구한 Ruis, Khan, Biderman, Hooker, Rocktäschl 및 Grefenstette의 최근 언어학 과제입니다.

예를 들어, "지문을 남기셨나요?"라는 질문에 대해 받은 답변은 "장갑을 끼었습니다"일 수 있으며 의미상 "아니오"입니다.

Marcus가 오랫동안 주장했듯이 인지 모델과 상식 없이 모델이 이를 인식하도록 만드는 것은 정말 어렵습니다.

이러한 유형의 작업에서는 규모가 거의 역할을 하지 않습니다. 심지어 최고의 모델이라도 대부분의 모델의 경우 정확도는 80.6%에 불과합니다.

그리고 모델 성능이 더욱 저하되는 이 작업의 더 복잡한 버전을 쉽게 상상할 수 있습니다.

Marcus를 더욱 충격에 빠뜨린 것은 이와 같은 중요한 단일 작업에도 약 80%의 성능은 대규모 게임을 계속 플레이할 수 없다는 것을 의미할 수 있다는 것입니다.

모델이 구문과 의미론만 학습하고 실용적이거나 상식적인 추론에 실패하면 신뢰할 수 있는 AGI를 전혀 얻지 못할 수 있습니다.

"무어의 법칙"은 원래 예상했던 것만큼 우리를 데려가지 않습니다. 지금까지는 너무 빠릅니다. , 왜냐하면 그것은 우주의 원인과 결과의 법칙이 아니며 항상 유효하기 때문입니다.

규모를 극대화하는 것은 단지 흥미로운 가정일 뿐입니다. 예를 들어 위의 세 가지 문제를 해결하면 패러다임 전환이 가능해집니다.

네티즌 Frank van der Velde는 규모를 극대화하는 팔로어가 '크다', '더 많다'와 같은 모호한 용어를 사용하는 경향이 있다고 말했습니다.

딥러닝 모델에서 사용하는 학습 데이터는 인간이 언어 학습에 사용하는 학습 데이터에 비해 너무 큽니다.

그러나 인간 언어의 실제 의미 집합에 비하면 이러한 소위 대규모 데이터는 여전히 미미합니다. 초당 문장을 생성하려면 약 100억 명이 필요하고, 이러한 대규모를 얻으려면 300년이 걸릴 것입니다. 트레이닝 세트.

네티즌 반란 과학은 규모를 극대화하는 것은 흥미로운 가설이 아니라, AI 트랙에서 패할 뿐만 아니라 추악한 방식으로 죽는 어리석은 가설이라고 직설적으로 말했습니다.

규모를 극대화하는 것은 너무 극단적입니다

라파엘 밀리에르(Columbia University 철학과 강사이자 박사)

한때 규모 극대화는 딥 러닝 비평가(예: Gary Marcus)의 초점으로 여겨졌고 Nando de Freitas 및 Alex Dimakis와 같은 업계 내부자가 논쟁에 가담하면서 양측은 서로 대립했습니다.

실무자들의 반응은 대부분 엇갈리지만 너무 부정적이지는 않습니다. 동시에 예측 플랫폼 Metaculus의 AGI 구현 예측 날짜가 역사적 최저치(2028년 5월)로 앞당겨져 극대화의 신뢰성도 높아질 수 있습니다. 규모.

'스케일'에 대한 사람들의 신뢰가 높아지는 것은 PaLM, DALL-E 2, Flamingo, Gato 등 스케일 극대화의 불길에 연료를 더한 새로운 모델의 출시 때문일 것입니다.

Sutton의 "Bitter Lesson"은 규모 극대화에 대한 논의에서 많은 점을 제시하지만 완전히 동일하지는 않습니다. 그는 인간 지식을 인공 지능 모델(예: 기능 엔지니어링)에 구축하는 것이 데이터 및 계산을 활용하는 것보다 덜 효율적이라고 믿습니다. 효율적으로 배워보세요.

기사 링크: http://www.incompleteideas.net/IncIdeas/BitterLesson.html

논란이 없지는 않지만 Sutton의 견해는 규모 극대화보다 훨씬 덜 급진적인 것 같습니다.

규모의 중요성을 강조하지만 AI 연구의 모든 문제를 단순한 규모의 문제로 축소하지는 않습니다.

사실 규모 극대화의 구체적인 의미를 단정하기는 어렵습니다. 문자 그대로 이해하면 "Scaling is all you need"는 알고리즘 혁신이나 아키텍처 변경 없이 AGI를 구현할 수 있고 기존 모델을 확장하고 더 많은 데이터를 강제할 수 있음을 의미합니다. 입력됩니다.

이 문자 그대로의 설명은 말도 안되는 것 같습니다. Palm, DALL-E 2, Flamingo 또는 Gato와 같은 모델조차도 여전히 이전 접근 방식에 대한 아키텍처 변경이 필요합니다.

기성 자동 회귀 변환기를 AGI로 확장할 수 있다고 실제로 생각한 사람이 있다면 정말 놀랄 것입니다.

규모 극대화를 믿는 사람들이 AGI에 얼마나 많은 알고리즘 혁신이 필요하다고 느끼는지 불분명하며, 이는 또한 이러한 관점에서 위조 가능한 예측을 생성하기 어렵게 만듭니다.

"일반 인공 지능"이라는 라벨을 붙일 수 있는 시스템을 구축하려면 확장이 필요 조건일 수 있지만, 필요성을 충분 조건으로 착각해서는 안 됩니다.

위 내용은 모델이 '더 커지면' AGI에 직접 연결될 수 있습니까? 마커스가 다시 폭격을 가했습니다. 세 가지 위기가 나타났습니다!의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!