AI가 보편적인 능력을 갖추게 하려면 어떻게 해야 할까요? 새로운 연구: 잠자기 상태로 두기

- 王林앞으로

- 2023-04-12 21:19:041487검색

신경망은 많은 작업에서 인간보다 뛰어난 성능을 발휘할 수 있지만 AI 시스템에 새로운 기억을 흡수하도록 요청하면 이전에 배운 내용을 즉시 잊어버릴 수 있습니다. 이제 새로운 연구에서는 신경망이 수면 단계를 거쳐 기억상실증을 예방하는 데 도움이 되는 새로운 방법을 보여줍니다.

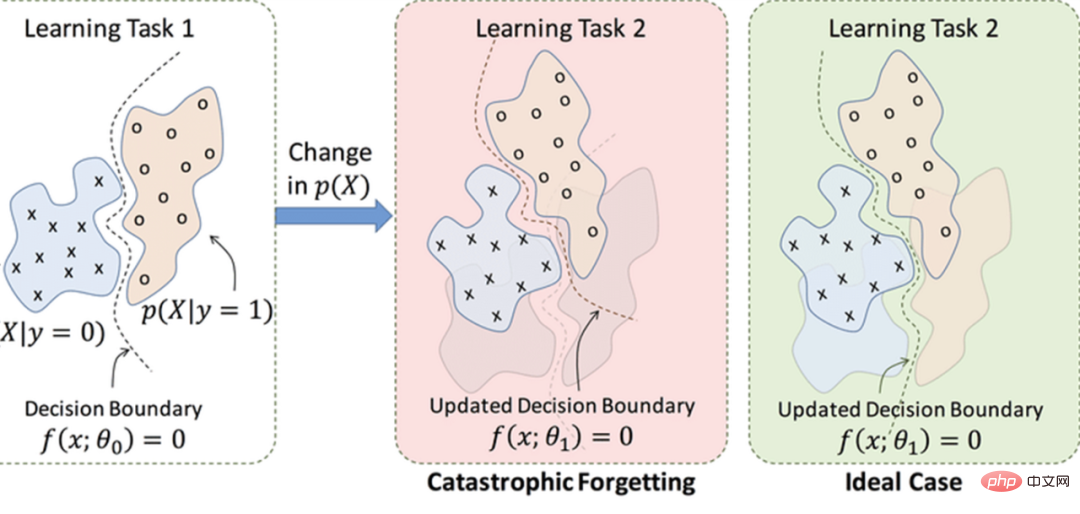

인공 신경망이 직면한 주요 과제는 "재앙적인 망각"입니다. 새로운 일을 배우러 갈 때, 그들은 이전에 배운 것을 갑자기 완전히 잊어버리는 불행한 경향이 있습니다.

기본적으로 신경망에 의한 데이터 표현은 원본 데이터의 작업 중심 데이터 "압축"이며 새로 학습된 지식이 과거 데이터를 덮어쓰게 됩니다.

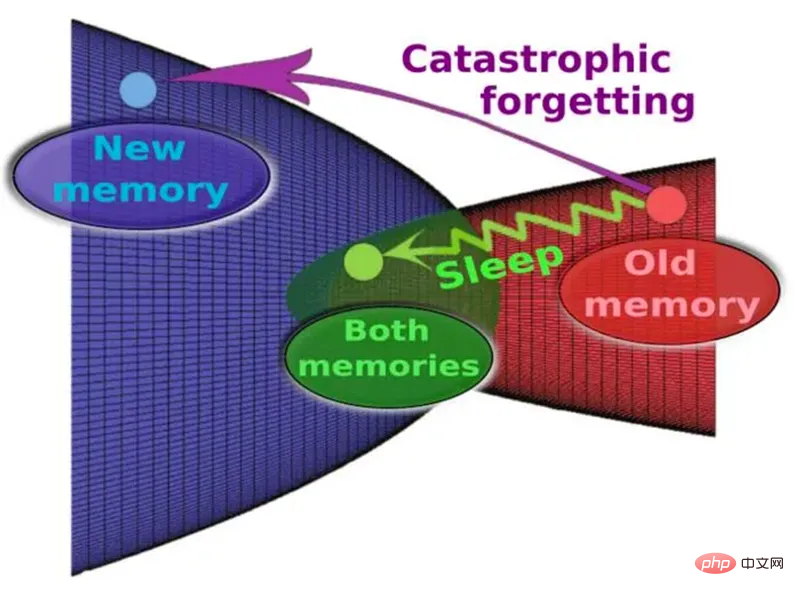

이것은 인간의 신경망에 비해 현재 기술의 가장 큰 결함 중 하나입니다. 반면에 인간의 두뇌는 이전에 기억한 작업을 수행하는 능력에 영향을 주지 않고 평생 동안 새로운 작업을 배울 수 있습니다. 우리는 이유를 완전히 알지 못하지만 오랫동안 연구에 따르면 인간의 두뇌는 학습 라운드와 수면이 섞여 있을 때 가장 잘 학습하는 것으로 나타났습니다. 수면은 분명히 최근 경험을 장기 기억 은행에 통합하는 데 도움이 됩니다.

"기억을 재구성하는 것은 실제로 유기체가 수면 단계를 거쳐야 하는 주요 이유 중 하나일 수 있습니다"라고 샌디에이고 캘리포니아 대학의 컴퓨터 신경과학자 Erik Delanois는 말합니다.

AI도 잠을 배울 수 있나요? 일부 이전 연구에서는 AI가 수면을 시뮬레이션하도록 하여 치명적인 기억상실을 해결하려고 시도했습니다. 예를 들어, 신경망이 새로운 작업을 학습할 때 인터리브 학습이라는 전략은 기계가 이전에 학습한 오래된 데이터를 동시에 제공하여 과거 지식을 유지하는 데 도움을 줍니다. 이전에는 이 접근 방식이 수면 중에 뇌가 작동하는 방식, 즉 오래된 기억을 지속적으로 재생하는 방식을 모방하는 것으로 생각되었습니다.

그러나 과학자들은 인터리브 교육을 위해서는 새로운 것을 배우고 싶을 때마다 오래된 기술을 배우는 데 원래 사용했던 모든 데이터를 신경망에 공급해야 한다는 가설을 세웠습니다. 이를 위해서는 많은 시간과 데이터가 필요할 뿐만 아니라 실제 수면 중에 생물학적 뇌가 수행하는 것과도 같지 않습니다. 유기체는 이전 작업을 학습하는 데 필요한 모든 데이터를 유지할 능력이 없으며, 자고있는 동안 그것을 모두 재생할 시간입니다.

새로운 연구에서 연구자들은 치명적인 망각의 메커니즘과 문제 예방에 있어 수면의 효과를 분석했습니다. 연구진은 전통적인 신경망을 사용하지 않고 인간의 뇌에 더 가까운 '스파이킹 신경망'을 사용했다.

인공 신경망에서는 뉴런이라는 구성 요소에 데이터가 공급되고 함께 작동하여 얼굴 인식과 같은 문제를 해결합니다. 신경망은 뉴런 사이의 연결인 시냅스를 반복적으로 조정하고 결과적인 행동 패턴이 더 나은 솔루션으로 이어지는지 확인합니다. 시간이 지남에 따라(지속적인 훈련) 네트워크는 올바른 결과를 계산하는 데 가장 적합한 패턴을 발견합니다. 마지막으로 이 모드를 기본 모드로 채택했는데, 이는 부분적으로 인간 두뇌의 학습 과정을 모방하는 것으로 생각됩니다.

이 다이어그램은 추상 시냅스 공간의 메모리와 수면 중과 수면 중이 아닌 메모리의 진화를 나타냅니다.

인공 신경망에서는 입력이 변함에 따라 뉴런의 출력도 계속해서 변합니다. 대조적으로, 스파이킹 신경망(SNN)에서 뉴런은 주어진 수의 입력 신호 후에만 출력 신호를 생성합니다. 이는 실제 생물학적 뉴런의 행동을 실제로 재현하는 프로세스입니다. 스파이킹 신경망은 펄스를 거의 방출하지 않기 때문에 일반적인 인공 신경망보다 적은 양의 데이터를 전송하며 원칙적으로 더 적은 전력과 통신 대역폭을 필요로 합니다.

예상대로 스파이킹 신경망은 다음과 같은 특징을 가지고 있습니다. 즉, 초기 학습 과정에서 치명적인 망각이 발생합니다. 그러나 이후의 학습 라운드 이후 일정 시간이 지나면 첫 번째 작업 학습에 참여하는 사람의 수가 늘어납니다. 뉴런이 다시 활성화됩니다. 이것은 현재 신경과학자들이 수면 과정에 대해 생각하는 것과 더 가깝습니다.

간단히 말하면 SNN을 사용하면 이전에 학습된 메모리 추적이 오프라인 처리 수면 중에 자동으로 재활성화되고 간섭 없이 시냅스 가중치를 수정할 수 있습니다.

이 연구에서는 강화 학습이 포함된 다층 SNN을 사용하여 새로운 작업 훈련 기간과 수면과 같은 자율 활동 기간을 섞어서 치명적인 망각을 피할 수 있는지 여부를 탐색합니다. 특히, 이 연구에서는 수면 단계와 유사하게 새로운 작업 중에 강화 학습을 주기적으로 중단함으로써 치명적인 망각을 예방할 수 있음을 보여주었습니다.

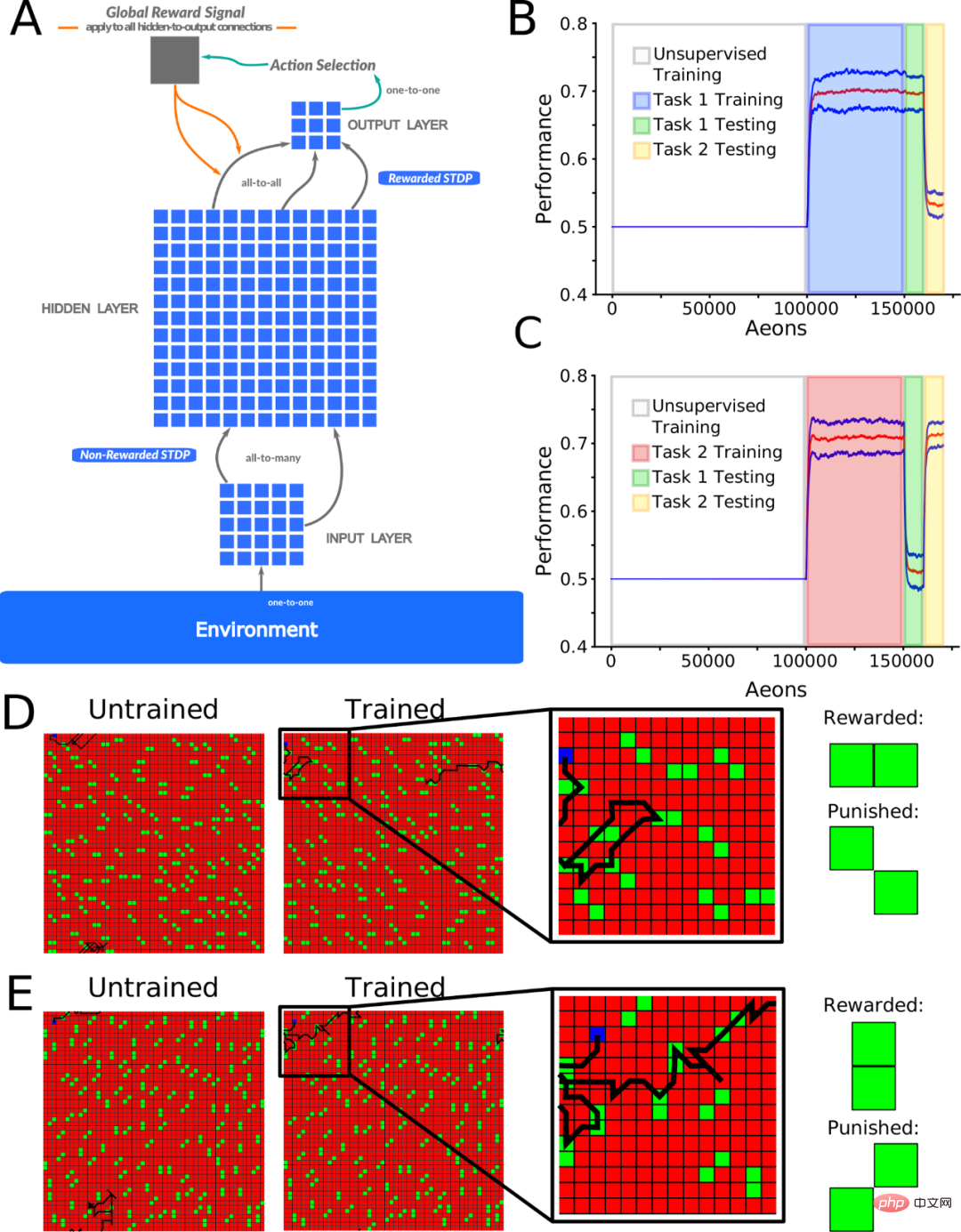

그림 1A는 입력에서 출력까지의 신호를 모델링하는 데 사용되는 피드포워드 스파이킹 신경망을 보여줍니다. 입력 계층(I)과 숨겨진 계층(H) 사이에 위치한 뉴런은 비지도 학습(비보상 STDP를 사용하여 구현)을 수행하고, H 계층과 출력(O) 계층 사이의 뉴런은 강화 학습(보상을 사용하여 구현)을 수행합니다. STDP).

비지도 학습을 통해 숨겨진 계층 뉴런은 입력 계층의 다양한 공간 위치에서 다양한 입자 패턴을 학습할 수 있으며, 보상 STDP는 출력 계층 뉴런이 입력 계층에서 감지한 입자 패턴 유형에 따라 동작 결정을 학습할 수 있습니다.

연구원들은 두 가지 상호 보완적인 방식으로 네트워크를 훈련했습니다. 두 작업 모두에서 네트워크는 가능한 한 많은 보상을 얻는 것을 목표로 보상과 처벌 입자 패턴을 구별하는 방법을 학습합니다. 이 작업에서는 확률이 0.5인 성능 척도로 패턴 식별성(사용된 보상 대 페널티 입자의 비율)을 고려합니다. 보고된 모든 결과는 서로 다른 무작위 네트워크 초기화를 사용한 최소 10번의 실험을 기반으로 합니다.

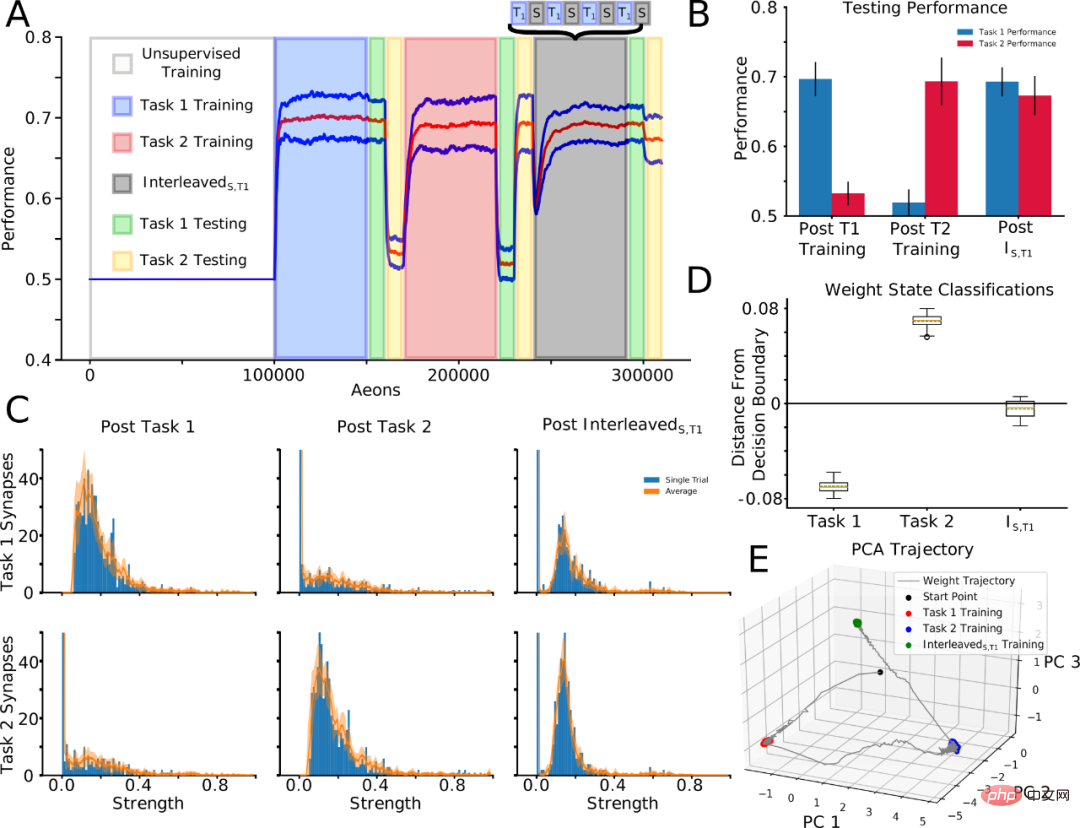

훈련과 수면 중 시냅스 가중치 역학을 밝히기 위해 연구원들은 다음으로 "작업 관련" 시냅스, 즉 특정 작업에 대한 훈련 후 분포의 상위 10%에서 식별된 시냅스를 추적했습니다. 작업 1이 먼저 훈련된 다음 작업 2가 훈련되었고, 각 작업 훈련 후에 작업 관련 시냅스가 식별되었습니다. 다음으로 훈련 작업 1을 다시 계속하되, 수면 시간과 인터리브합니다(인터리브 훈련): T1→T2→InterleavedS,T1. 작업 1 - 작업 2의 순차적 교육으로 인해 작업 1이 잊혀졌지만 InterleavedS 이후 작업 1이 다시 학습되고 작업 2도 유지되었습니다(그림 4A 및 4B).

중요하게도 이 전략을 통해 InterleavedS,T1 교육 후 시냅스 가중치를 별도의 작업 1 및 작업 2 교육 후 작업 관련으로 식별된 가중치와 비교할 수 있었습니다(그림 4C). 작업 1 훈련(그림 4C, 왼쪽 상단) 후에 형성된 작업 1 관련 시냅스의 분포 구조는 작업 2 훈련(상단 중간) 후에 중단되었지만 InterleavedS, T1 훈련(오른쪽 상단) 후에 부분적으로 복원되었습니다. 작업 2 훈련(아래 중앙) 후 작업 2 관련 시냅스의 분포 구조는 작업 1 훈련(왼쪽 아래) 후에는 없고 InterleavedS, T1 훈련(오른쪽 아래) 후에는 부분적으로 보존됩니다.

이 정성적 패턴은 단일 시험 내에서 명확하게 관찰될 수 있으며(그림 4C; 파란색 막대) 시험 전반에 걸쳐 일반화될 수도 있습니다(그림 4C; 주황색 선). 따라서 수면은 새로운 시냅스를 병합하는 동시에 중요한 시냅스를 보존할 수 있습니다.

그림 4. 새로운 작업 훈련과 수면의 인터리브 기간을 통해 이전 작업 정보를 보존하면서 새로운 작업과 관련된 시냅스 정보를 통합할 수 있습니다.

"흥미롭게도 우리는 망각을 방지하기 위해 수면 중에 인위적으로 재생하기 위해 초기 기억과 관련된 데이터를 명시적으로 저장하지 않았습니다."라고 연구 공동 저자인 체코 과학 아카데미 컴퓨터 과학 연구소의 컴퓨팅은 말했습니다. 신경과학자 파벨 산다(Pavel Sanda)는 말합니다.

치명적인 망각을 예방하는 데 도움이 되는 새로운 전략이 발견되었습니다. 스파이킹 신경망은 수면과 같은 단계를 거친 후 두 가지 작업을 모두 수행할 수 있었으며 연구원들은 그들의 전략이 이전 작업과 새로운 작업과 관련된 시냅스 패턴을 보존하는 데 도움이 되었다고 믿습니다.

"우리의 연구는 생물학적으로 영감을 받은 솔루션 개발의 실용성을 보여줍니다"라고 Delanois는 말했습니다.

연구원들은 그들의 연구 결과가 급증하는 신경망에만 국한되지 않는다는 점에 주목합니다. Sanda는 곧 있을 연구가 수면과 같은 단계가 "표준 인공 신경망에서 치명적인 망각을 극복"하는 데 도움이 될 수 있다는 것을 보여준다고 말했습니다.

이 연구는 11월 18일 PLOS Computational Biology 저널에 게재되었습니다.

논문: "수면은 공동 시냅스 가중치 표현을 형성하여 급증하는 신경망에서 치명적인 망각을 예방합니다."

논문 주소: https://journals.plos.org/ploscompbiol /article ?id=10.1371/journal.pcbi.1010628

위 내용은 AI가 보편적인 능력을 갖추게 하려면 어떻게 해야 할까요? 새로운 연구: 잠자기 상태로 두기의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!