뜨거운 GPT-4가 여기에 있습니다!

- 王林앞으로

- 2023-04-12 19:22:021496검색

인공지능 기업 오픈AI(OpenAI)가 지난 3월 14일 ChatGPT의 업그레이드 버전 GPT-4(GPT-3.5 단계)를 출시했는데, 이는 그동안 다소 조용했던 ChatGPT를 다시 한 번 화제로 삼아 '폭발적인 열띤 토론'을 불러일으켰다. , 아무런 서스펜스 없이 소셜 플랫폼에서 뜨거운 검색어가 되었습니다. 'AI가 결국 인간을 대체할 것이다', 'GPP-4 시험 능력이 강한 나라에서는 인간의 90%가' 등의 주제가 사용자들의 관심을 점점 더 끌고 있다.

이전 ChatGPT와 비교하여 이번 GPT-4 업그레이드는 "헤비급"이라고 할 수 있습니다. "슈퍼 멀티 모달 모델"을 채택하고 답변 정확도가 크게 향상되었습니다. , 처리 상한이 2.5W 단어로 증가하고 일반 텍스트 입력을 기반으로 이미지 인식이 추가되어 창의성이 크게 향상되고 더 미묘한 지시를 처리할 수 있습니다...

ChatGPT에 비해 GPT-4는 매우 뛰어납니다. , 그러나 끔찍한 결과는 사용자의 미친 주문으로 인해 OpenAI 결제 시스템이 충돌했다는 것입니다.

Chat을 버리고 GPT-4는 더욱 강력해졌습니다

GPT-3.5 모델을 기반으로 한 ChatGPT가 아직 합격선에 맴돌고 있는 '불량 학생'이라면 GPT-4의 저력이 기대됩니다. "우수 학생"이 됩니다. “대기열은 더 지능적일 뿐만 아니라 "속이기"도 더 어렵습니다.

Chat이라는 접두사를 버리고 GPT-4의 기능이 크게 변경되었습니다. 간단히 말해서, OpenAI가 딥러닝 방향으로 계속 확장되면서 GPT-4는 사법고시와 로스쿨 입학 시험에도 참여하게 되었습니다. LSAT 등 상위 20% 순위에는 GPT-4를 사용하여 YouTube에서 라이브 방송하여 기사 작성, 코드 작성, 세금 신고, 시 쓰기, 농담을 하는 사용자도 있습니다...

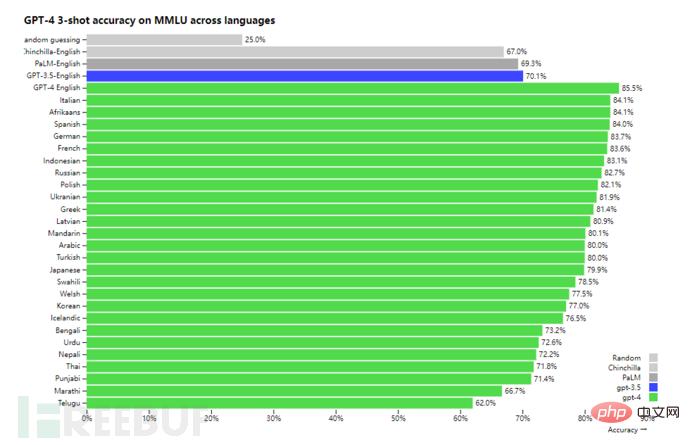

26개 언어를 테스트한 결과, GPT-4는 라트비아어, 웨일스어, 스와힐리어 등 자원이 적은 언어를 포함해 24개 언어에서 GPT-3.5와 같은 다른 대형 언어 모델보다 성능이 뛰어납니다. 이 중 중국어 인식 정확도는 80.1%(아래 그림)에 이릅니다.

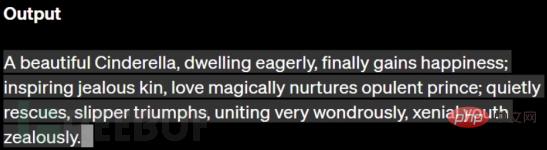

OpenAI는 GPT-4를 사용하여 26개 단어로 작성된 "신데렐라" 이야기의 개요를 시연했습니다. 이 26개 단어의 첫 글자는 A부터 Z까지의 26개 글자의 올바른 순서와 일치하며 이는 증명하기에 충분합니다. 그 GPT -4 어휘력과 언어 창조 능력이 뛰어납니다.

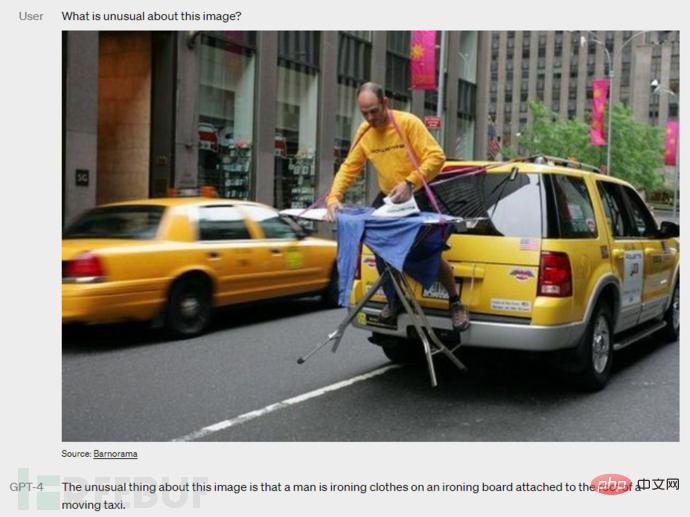

하지만 가장 큰 업데이트는 GPT-4가 이미지 인식을 지원한다는 점입니다. 이미지 내용에 대한 이해를 바탕으로 논리적인 답변을 제공할 수 있습니다. 예를 들어 사용자가 아래 사진의 특별한 점을 묻는 경우 GPT-4는 이를 "이동하는 택시 지붕 위의 다리미판에서 옷을 다림질하는 남자"라고 직접 설명할 수 있습니다.

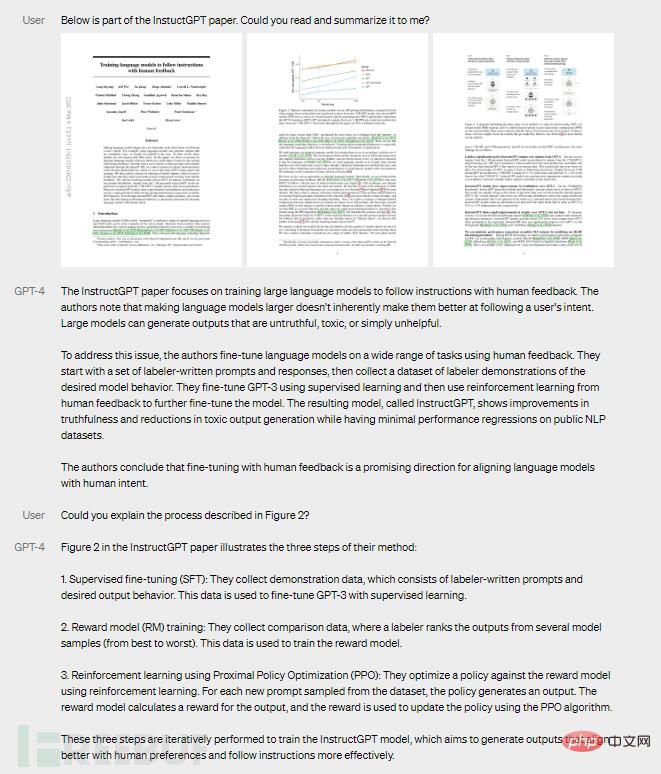

또 다른 예에서 GPT-4는 사용자 요구 사항에 따라 논문의 "이해"를 기반으로 요약을 제공할 수 있으며 특정 실험 과정에 대한 간결한 설명을 제공할 수 있습니다.

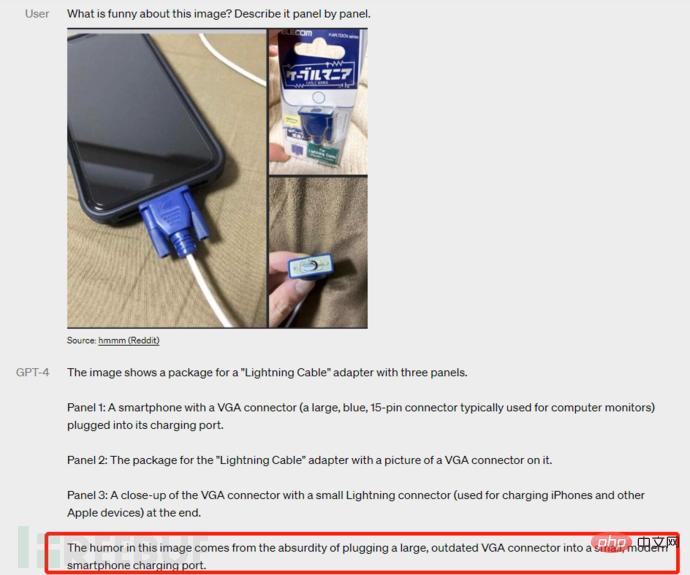

또한 GPT-4는 인터넷에서 인기 있는 재미있는 "밈"도 어느 정도 이해할 수 있습니다. 예를 들어 아래 사진의 재미있는 점은 "오래된 대형 VGA 커넥터를 연결하는 것"이라고 설명할 수 있습니다. 작고 현대적인 스마트폰 충전 포트의 어리 석음”.

GPT-4는 해커의 손에 들린 날카로운 검이 될까요?

우선, 우리는 점점 더 똑똑해지는 GPT-4가 더 끔찍한 보안 위험을 가져올 것인가, 아니면 사이버 범죄 조직의 손에 들어가는 "날카로운 검"이 될 것인가에 대한 문제를 인식해야 합니다.

ChatGPT 버전에서 FreeBuf는 사이버 범죄에서의 사용과 사이버 공간에 가져올 수 있는 보안 위험에 대해 깊이 논의했습니다.

하나의 위험은 그 자체입니다.

예를 들어, 보안 전문가들은 ChatGPT에서 생성된 콘텐츠에서 회사 내부 비밀과 매우 유사한 텍스트를 발견했습니다. 그 이유는 Amazon 직원이 ChatGPT를 사용하여 코드와 텍스트를 생성할 때 회사의 내부 데이터 정보를 입력했기 때문일 수 있습니다. 그러면 GPT-4에서도 이러한 보안 위험은 여전히 존재하며 주요 거대 기업은 여전히 GPT를 방어할 것입니다.

네트워크 보안 정책 측면에서도 GPT-4는 한계선을 밟을 위기에 처해 있습니다. 예를 들어 GDPR의 '최소 데이터' 원칙을 위반하는지, '잊혀질 권리'나 '삭제권'을 충족하는지, 공공 데이터의 사용이 규정을 준수하는지, 학술 및 지적 재산의 수집이 정보가 현행 법률, 규정에 적합하고 일치합니다.

현재 우리나라의 사이버 보안법, 데이터 보호법, 개인 정보 보호법에는 데이터 수집 및 사용에 대한 세부 규정이 있습니다. 현재 상황만 보아도 GPT-4가 이러한 요구 사항을 모두 충족할 수는 없습니다. 더욱이, 앞으로 글로벌 법률 시스템은 '데이터 보호' 방향으로 더욱 정교해질 것이며, 이때 GPT는 더욱 엄격한 규정 준수 압력에 직면하게 될 것입니다.

둘째, GPT-4를 사용하여 코드를 편집할 때 숨겨진 취약점이 더 많이 있을 수 있습니다.

ChatGPT-3.5 단계에서 기업과 개발자는 이미 이를 사용하여 코드를 작성하고 취약점을 해결하려고 노력하고 있습니다. Kaspersky 실험에서 분석가들은 EDR(엔드포인트 탐지 및 응답) 시스템을 실행하지 않거나 코드 난독화를 탐지하거나 코드 바이너리를 리버스 엔지니어링하지 않는 회사에 대한 포렌식 정보를 수집하는 데 ChatGPT를 사용할 수 있음을 발견했습니다.

더 똑똑해진 GPT-4는 많은 사람들로부터 높은 기대를 받고 있습니다. 점점 더 많은 개발자가 GPT-4를 사용하여 코드를 작성하게 되면 숨겨진 취약점은 일단 공격자가 악용하면 더욱 무서운 시한폭탄이 되어 말할 수 없는 재앙을 가져올 것입니다. 전체 네트워크 보안 공간, 특히 강화된 경계가 필요한 공급망 보안 분야에서 그렇습니다.

마지막으로 해커가 GPT-4를 악용하여 네트워크 보안 방어에 새로운 압력을 가하는 것을 방지하는 방법입니다.

매우 분명한 사실은 ChatGPT 단계 이후로 블랙 산업, 사이버 범죄, 해커 공격 및 기타 분야에서 GPT가 사용되는 사례가 점점 더 많아지고 있으며 미래에는 표준이 될 수도 있다는 것입니다.

예를 들어 Cybernews의 연구원은 해커가 ChatGPT를 사용하여 웹 사이트의 보안 취약점을 찾을 수 있다는 사실을 발견한 후 연구원의 도움을 받아 일반 웹 사이트에서 침투 테스트를 수행하고 이를 ChatGPT에서 제공하는 제안 및 코드와 결합했습니다. 45분이면 예제를 변경하면 해킹이 완료됩니다.

ChatGPT에는 더 지능적인 GPT-4는 말할 것도 없고 이미 그러한 기능이 있습니까? GPT-4를 활용해 단기적으로 네트워크 보안 체계를 실질적으로 강화하기는 어려워 보이지만, 사이버 범죄에 활용이 임박한 만큼, 유사 보안 위험에 어떻게 대처할 것인지도 이제 고민해야 할 문제가 됐다.

물론, OpenAI도 보안을 위해 계속해서 열심히 노력하고 있습니다. 예를 들어 인공지능 도킹 위험, 사이버 보안, 생물 위험, 신뢰 및 보안, 국제 안보 분야의 전문가 50명 이상을 고용하여 모델에 대한 적대적 테스트를 수행하고 다양한 고위험 시나리오를 훈련하여 완화 조치에 대한 지침을 제공하고 모델 개발 개선을 위한 기반을 제공합니다. 예를 들어, 유해 화학물질 합성 방법에 대한 요청을 거부하는 GPT-4의 능력을 향상시키기 위해 추가적인 특수 데이터를 수집함으로써 가능합니다.

그러나 이들에만 의존하는 것은 보안 요구 사항을 분명히 충족할 수 없다는 의미이기도 합니다. 이는 정책 및 규정 수립, 기술 사용 등 여러 측면에서 GPT-4로 대표되는 인공 지능의 보안 기능을 강화해야 함을 의미합니다. 악행의 위험 등

마지막에 작성

어쨌든 기술의 진보는 인류 발전에 헤아릴 수 없는 영향을 미치지만 동시에 위험에 대한 명확한 이해가 필요합니다. 즉, 우리는 긍정적인 태도로 GPT-4를 수용하지만, 위험에 대처할 준비가 되어 있어야 한다는 것입니다.

2차 세계대전의 한 지도자가 말했듯이: 우리는 다른 사람들의 마음을 바꿀 수 없습니다. 그들이 전쟁을 준비하고 싶어하기 때문에 우리도 전쟁을 준비해야 합니다. GPT-4의 경우에도 마찬가지입니다. 다른 사람이 이를 "악"에 사용하도록 변경할 수는 없지만 "선"에 사용하는 방법은 결정할 수 있습니다.

AI의 칼은 네트워크 보안의 손에도 매우 날카롭습니다.

우리는 준비되었습니다!

위 내용은 뜨거운 GPT-4가 여기에 있습니다!의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!