AI 백과사전: ChatGPT 작동 방식

- 王林앞으로

- 2023-04-12 13:31:034652검색

ChatGPT는 수백만 명의 사람들의 관심을 빠르게 얻었지만 많은 사람들은 그것이 어떻게 작동하는지 이해하지 못했기 때문에 경계했습니다. 그리고 이 글은 이해하기 쉽도록 분석한 것입니다.

그러나 ChatGPT의 핵심은 매우 복잡한 시스템입니다. ChatGPT를 가지고 놀거나 그것이 무엇인지 알아내고 싶다면 핵심 인터페이스는 질문을 하거나 쿼리를 제공할 수 있는 채팅 창이며 AI가 응답할 것입니다. 기억해야 할 중요한 세부 사항은 채팅에서 컨텍스트가 보존된다는 것입니다. 즉, 메시지는 이전 정보를 참조할 수 있으며 ChatGPT는 이를 컨텍스트에 따라 이해할 수 있습니다.

채팅 상자에 쿼리를 입력하면 어떻게 되나요?

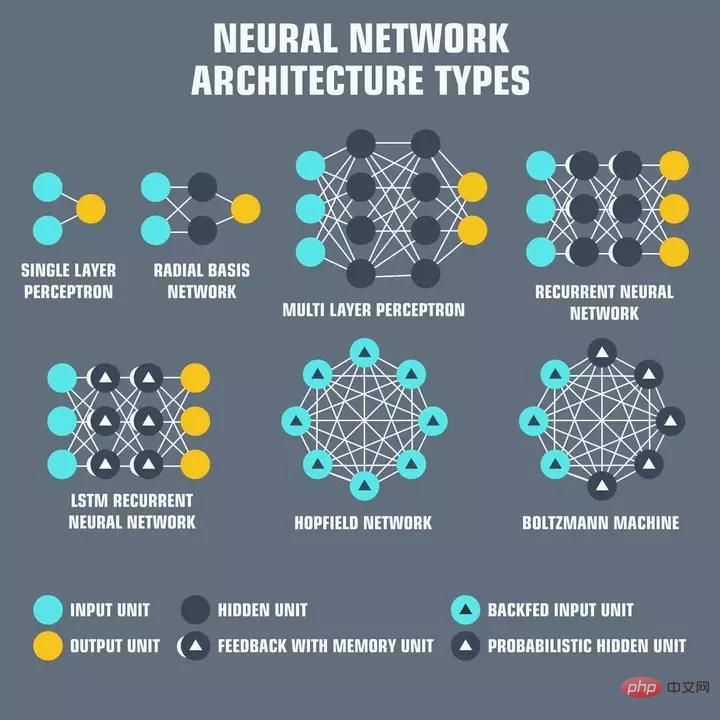

Neural Networks

먼저 ChatGPT 프레임워크 내에서는 많은 것을 발견할 수 있습니다. 기계 학습은 지난 10년 동안 빠르게 발전해 왔으며 ChatGPT는 결과를 달성하기 위해 많은 최첨단 기술을 활용합니다.

신경망은 상호 연결된 "뉴런"의 레이어이며, 각 뉴런은 입력을 수신하고 처리한 후 네트워크의 다음 뉴런으로 전달하는 역할을 담당합니다. 신경망은 오늘날 인공 지능의 중추를 형성합니다. 입력은 일반적으로 처리되는 데이터의 일부 측면을 나타내는 "기능"이라는 숫자 값 집합입니다. 예를 들어, 언어 처리의 경우 특징은 문장의 각 단어의 의미를 나타내는 단어 임베딩일 수 있습니다.

단어 임베딩은 신경망이 텍스트의 의미를 이해하는 데 사용하는 텍스트의 숫자 표현일 뿐이며, 의미론적으로 논리적인 방식으로 응답하는 등 다른 목적으로 사용될 수 있습니다! 키잉 후 텍스트는 먼저 단어 임베딩으로 변환되며, 이는 인터넷 전체의 텍스트에 대해 훈련됩니다. 그런 다음 입력 단어 임베딩이 주어지면 적절한 응답 단어 임베딩 세트를 출력하도록 훈련된 신경망이 있습니다. 그런 다음 이러한 임베딩은 입력 쿼리에 적용된 역연산을 사용하여 사람이 읽을 수 있는 단어로 변환됩니다. 이 디코딩된 출력은 ChatGPT가 인쇄하는 것입니다.

ChatGPT 모델 크기

변환 및 출력 생성에는 계산 비용이 매우 많이 듭니다. ChatGPT는 1,750억 개의 매개변수를 가진 대규모 언어 모델인 GPT-3 위에 위치합니다. 이는 OpenAI가 대규모 데이터 세트를 사용하여 조정한 광범위한 신경망에 1,750억 개의 가중치가 있음을 의미합니다.

따라서 각 쿼리에는 최소 2번의 1,750억 계산이 필요하며 이는 빠르게 합산됩니다. OpenAI는 계산 비용을 줄이기 위해 이러한 계산을 캐시하는 방법을 찾았을 수 있지만 이 정보가 어디에 게시되었는지는 알 수 없습니다. 게다가, 올해 초 출시 예정인 GPT-4는 1000배 더 많은 매개변수를 가지고 있다고 합니다!

계산 복잡성으로 인해 실제 비용이 발생하게 됩니다! 현재 OpenAI가 비용을 지출하고 있으므로 ChatGPT가 곧 유료 제품이 된다면 놀라지 마세요. 무료로 실행하려면 수백 만 달러가 필요합니다.

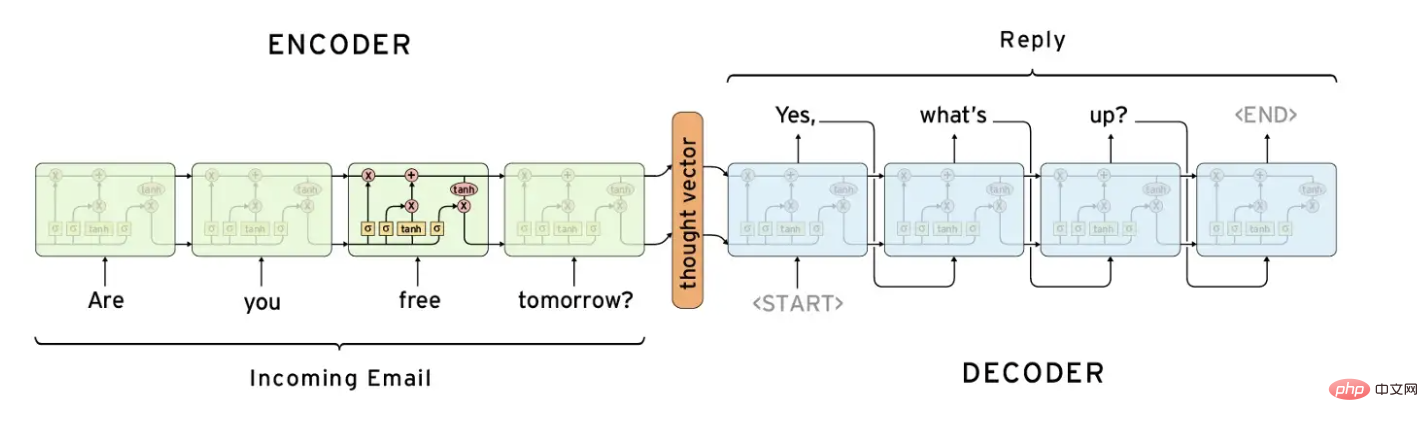

인코더, 디코더 및 RNN

자연어 처리에서 일반적으로 사용되는 신경망 구조는 인코더-디코더 네트워크입니다. 이러한 네트워크는 입력 시퀀스를 압축된 표현으로 "인코딩"한 다음 해당 표현을 출력 시퀀스로 "디코딩"하도록 설계되었습니다.

전통적으로 인코더-디코더 네트워크는 순차 데이터 처리를 위해 순환 신경망(RNN)과 쌍을 이루었습니다. 인코더는 입력 시퀀스를 처리하고 고정 길이 벡터 표현을 생성한 다음 디코더에 전달합니다. 디코더는 이 벡터를 처리하고 출력 시퀀스를 생성합니다.

인코더-디코더 네트워크는 입력이 한 언어의 문장이고 출력이 해당 문장을 다른 언어로 번역하는 기계 번역과 같은 작업에 널리 사용되었습니다. 요약 및 이미지 캡션 생성 작업에도 적용되었습니다.

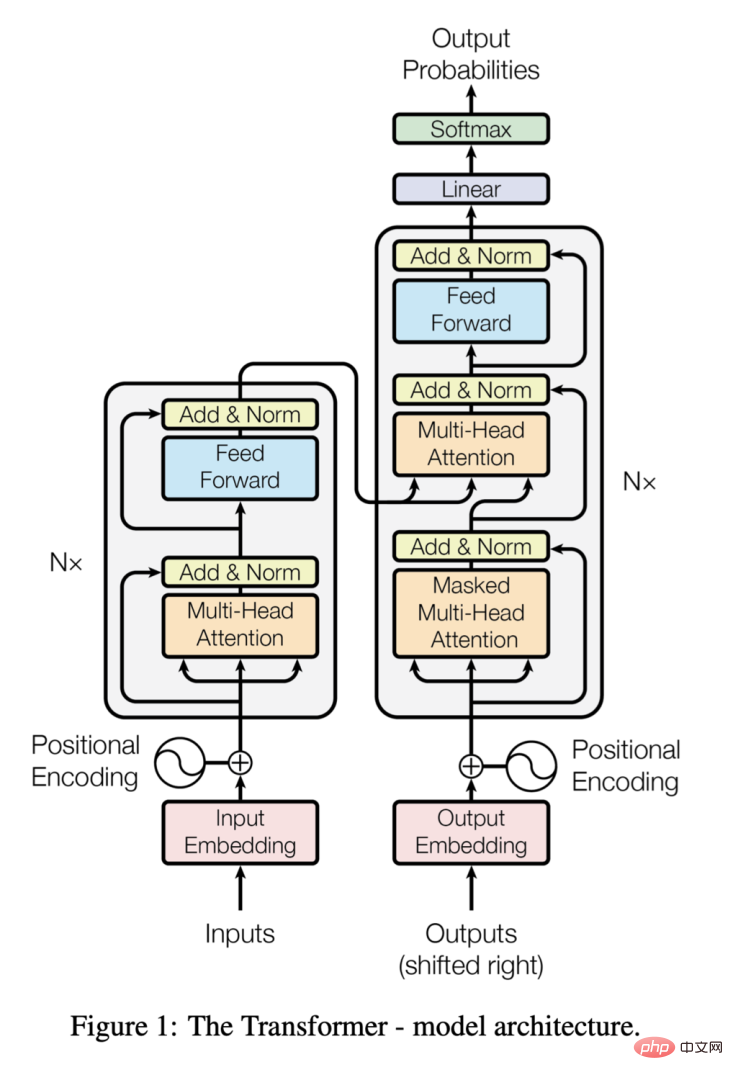

인코더-디코더 구조와 유사하게 변환기는 두 개의 구성 요소로 구성되지만 변환기는 각 입력 요소가 다른 모든 요소에 집중할 수 있는 자체 주의 메커니즘을 사용한다는 점에서 다릅니다. 요소 간의 거리에 관계없이 요소 간의 관계를 캡처할 수 있습니다.

Transformer는 또한 다중 헤드 주의를 사용하여 입력의 여러 부분에 동시에 집중할 수 있습니다. 이를 통해 입력 텍스트의 복잡한 관계를 포착하고 매우 정확한 결과를 생성할 수 있습니다.

2017년에 "Attention is All You Need" 논문이 출판되었을 때 변환기는 더 긴 텍스트에서 더 나은 성능을 달성할 수 있기 때문에 자연어 처리를 위한 최첨단 모델로서 인코더-디코더 아키텍처를 대체했습니다.

변환기 아키텍처, https://arxiv.org/pdf/1706.03762.pdf

생성적 사전 훈련

생성적 사전 훈련은 자연어 처리 분야에서 특히 성공적인 기술입니다. 여기에는 데이터의 보편적인 표현을 학습하기 위해 감독되지 않은 방식으로 대규모 데이터 세트에 대한 광범위한 신경망을 훈련시키는 것이 포함됩니다. 사전 훈련된 이 네트워크는 언어 번역이나 질문 응답과 같은 특정 작업에 맞게 미세 조정되어 성능을 향상시킬 수 있습니다.

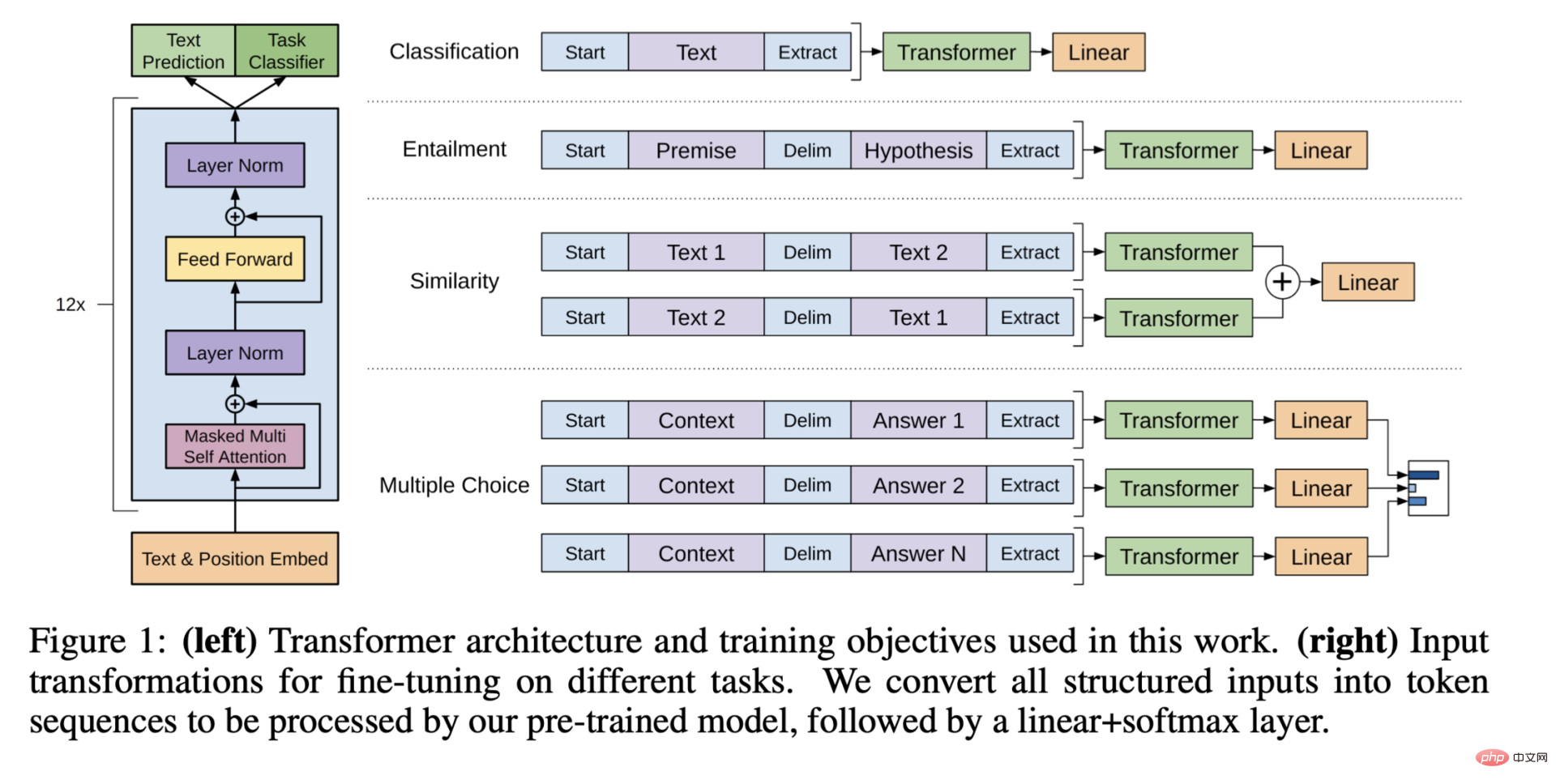

Generative pre-training 아키텍처, "Improving Language Understanding through Generative Pre-training"에서 발췌

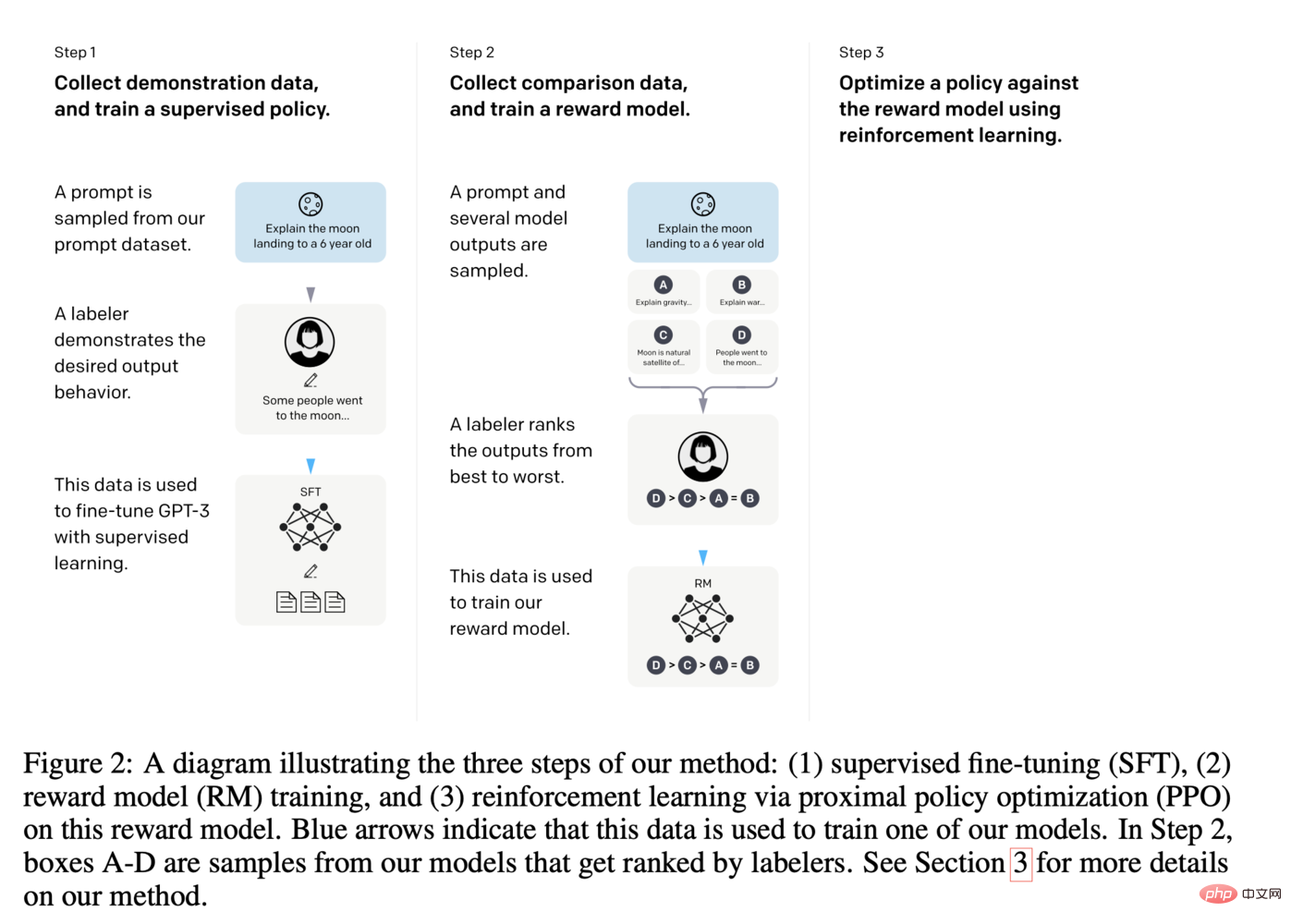

ChatGPT의 경우 GPT-3 모델의 마지막 레이어를 미세 조정하여 적응하는 것을 의미합니다. 사람 태그를 활용하는 채팅 질문에 대한 답변 사례입니다. 다음 그림은 ChatGPT 미세 조정에 대한 자세한 내용을 제공합니다.

ChatGPT 미세 조정 단계, https://arxiv.org/pdf/2203.02155.pdf

모든 것을 하나로 합치기

따라서, ChatGPT 프레임워크에는 움직이는 부분이 많이 있으며 이러한 부분은 계속해서 성장할 것입니다. 다양한 영역의 발전이 GPT와 유사한 모델의 채택을 늘리는 데 도움이 되므로 계속 발전하는 모습을 지켜보는 것은 매우 흥미로울 것입니다.

향후 1~2년 내에 이 새로운 구현 기술로 인해 큰 혼란이 발생할 수 있습니다.

위 내용은 AI 백과사전: ChatGPT 작동 방식의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!