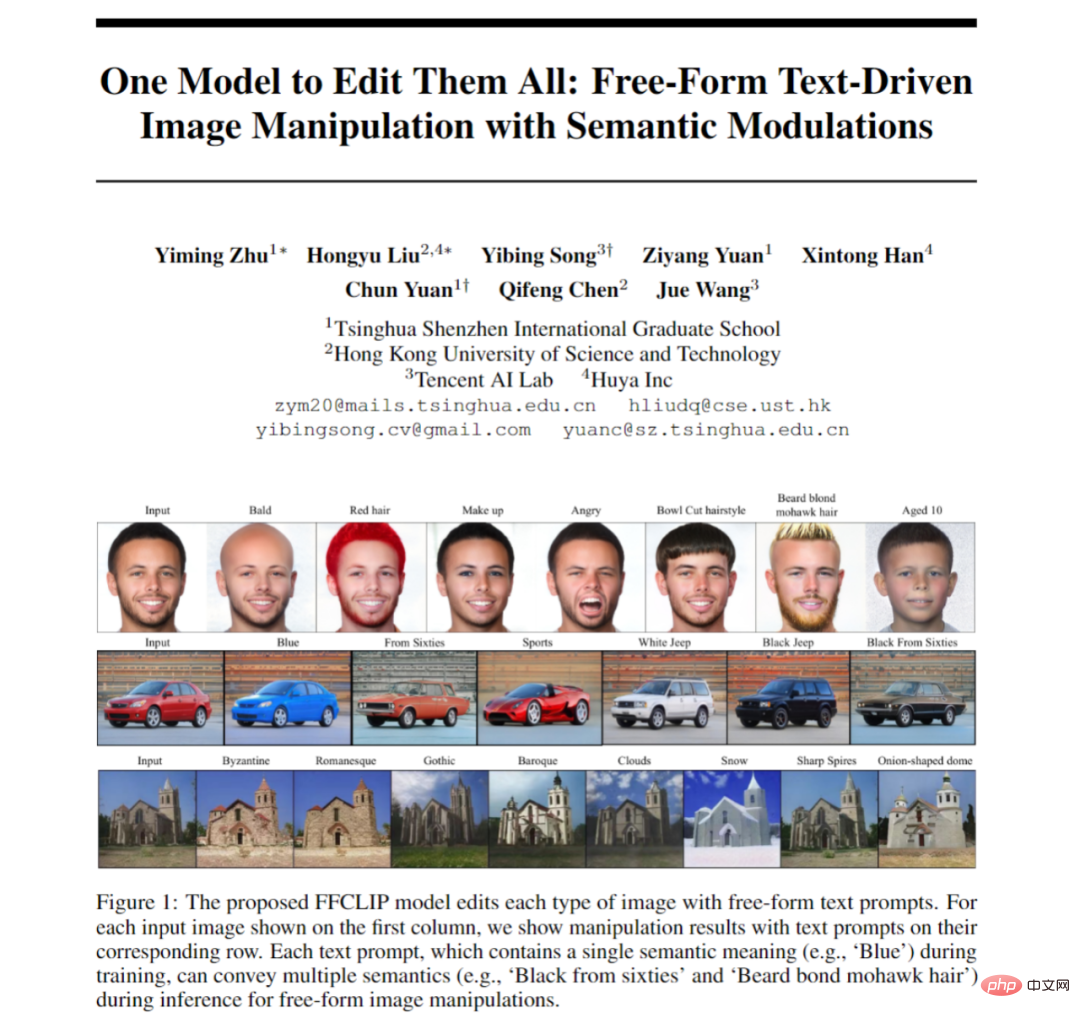

텍스트 및 이미지 편집의 새로운 패러다임, 단일 모델로 다중 텍스트 안내 이미지 편집 가능

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-04-10 19:41:021318검색

논문 개요

텍스트를 사용하여 이미지를 편집하는 것과 관련된 연구는 최근 매우 뜨겁습니다. 최근에는 노이즈 제거 확산 모델을 기반으로 효과를 향상시키는 연구가 많이 이루어지고 있지만 관련 연구에 지속적으로 관심을 기울이는 학자는 거의 없습니다. GAN에. 이 기사는 고전적인 StyleGAN과 CLIP을 기반으로 하며 의미론적 변조 모듈을 제안하므로 텍스트-이미지 편집을 수행하기 위해 다양한 텍스트에 대해 단일 모델만 필요합니다.

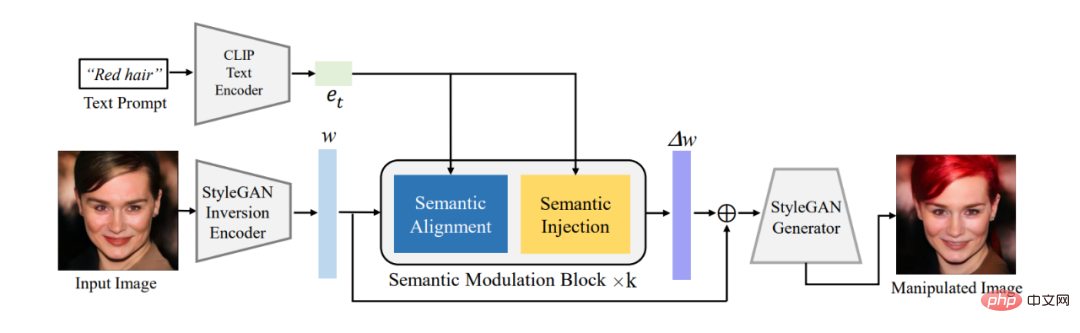

이 기사에서는 먼저 기존 인코더를 사용하여 편집할 이미지를 StyleGAN의 W^+ 의미 공간에서 잠재 코드 w로 변환한 후 제안된 의미 변조 모듈을 통해 잠재 코드를 적응적으로 변조합니다. 의미론적 변조 모듈은 의미론적 정렬과 의미론적 주입 모듈을 포함합니다. 먼저 어텐션 메커니즘을 통해 GAN의 텍스트 인코딩과 잠재 인코딩 간의 의미론을 정렬한 다음 텍스트 정보를 정렬된 잠재 인코딩에 주입하여 Cain 인코딩이 소유하는지 확인합니다. 텍스트를 사용하여 이미지를 편집할 수 있는 기능을 제공합니다.

클래식 StyleCLIP 모델과 달리 우리 모델은 각 텍스트에 대해 별도의 모델을 훈련할 필요가 없습니다. 하나의 모델이 여러 텍스트에 응답하여 이미지를 효과적으로 편집할 수 있으므로 모델은 FFCLIP-Free Form Text-Driven Image Manipulation이 됩니다. . 동시에 우리 모델은 고전적인 교회, 얼굴 및 자동차 데이터 세트에서 매우 좋은 결과를 얻었습니다.

- 문서 주소: https://arxiv.org/pdf/2210.07883.pdf

- Github 주소: https://github.com/KumapowerLIU/FFCLIP

배경 및 의미

최근에는 이미지 편집 작업을 위해 StyleGAN 잠재 공간을 편집하는 데 사용자 의도를 설명하는 무료 텍스트 프롬프트가 사용되었습니다[1, 2]. 문장(예: 'Blue') 또는 구문(예: 'Man aged 10')을 입력으로 사용하여 이러한 방법은 StyleGAN 잠재 공간에서 잠재 인코딩을 변조하여 설명된 이미지 속성을 적절하게 편집합니다.

정확한 텍스트 - 이미지 편집은 StyleGAN의 시각적 의미 공간과 CLIP의 텍스트 의미 공간 간의 정확한 잠재 매핑에 의존합니다. 예를 들어 텍스트 프롬프트가 "놀라움"인 경우 먼저 시각적 의미 공간에서 관련된 의미 부분 공간(예: "표현", 놀라움은 표현의 속성에 속하므로)을 식별합니다. 텍스트에 해당하는 의미 부분 공간을 찾은 후 텍스트는 현재 표현에서 놀라운 표현으로 잠재 인코딩이 변경되는 방향을 알려줍니다. TediGAN [1] 및 StyleCLIP [2]와 같은 선구적인 연구는 어떤 잠재 시각적 하위 공간이 대상 텍스트 힌트 임베딩에 해당하는지 경험적으로 미리 정의했습니다(예: TediGAN의 특정 속성 선택 및 StyleCLIP의 그룹화 매핑). 이러한 경험적 인식은 텍스트 프롬프트가 주어지면 해당 편집 모델을 훈련해야 한다는 것을 제한합니다.

다른 텍스트 큐에는 StyleGAN의 잠재 시각적 하위 공간에 있는 잠재 코드를 변조하기 위해 다른 모델이 필요합니다. StyleCLIP의 전역 방향 지정 방법은 이러한 프로세스를 사용하지 않지만 매개변수 조정 및 편집 방향은 수동으로 사전 정의됩니다. 이러한 이유로 우리는 단일 모델이 여러 텍스트를 처리할 수 있도록 명시적 텍스트를 통해 암시적 시각적 의미 하위 공간을 자동으로 찾는 방법을 탐색할 이유가 있습니다.

본 논문에서는 다양한 텍스트에 해당하는 시각적 하위 공간을 자동으로 찾을 수 있는 FFCLIP-Free Form CLIP을 제안합니다. FFCLIP은 잠재 인코딩 w^+와 StyleGAN 잠재 공간 W^+의 텍스트 인코딩 e를 입력으로 사용하는 여러 의미론적 변조 모듈로 구성됩니다.

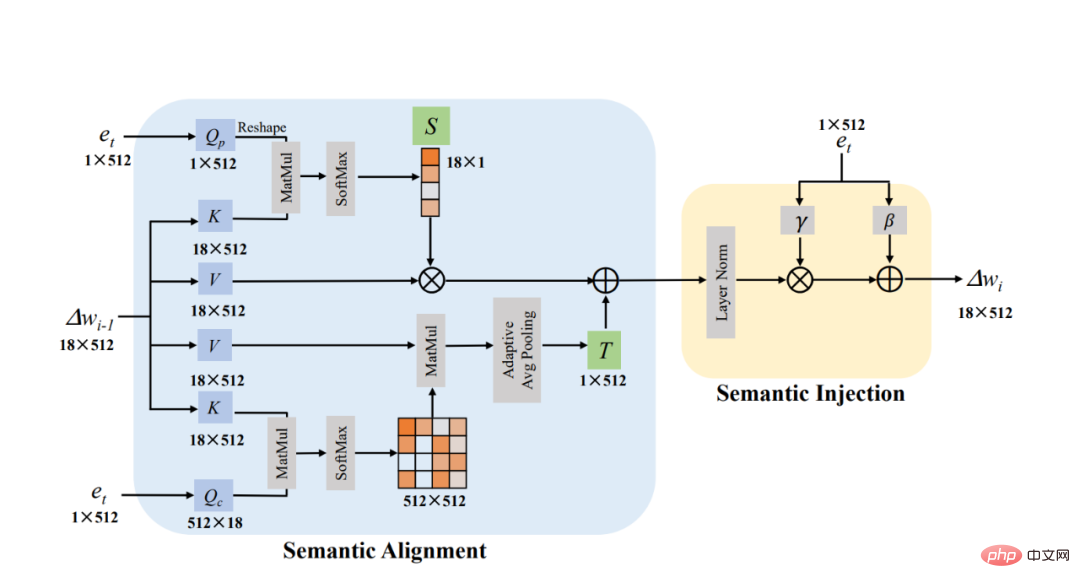

의미 변조 모듈은 의미 정렬 모듈과 의미 주입 모듈로 구성됩니다. 의미 정렬 모듈은 텍스트 인코딩 e를 쿼리로 사용하고 잠재 인코딩 w를 키와 값으로 사용합니다. 그런 다음 위치와 채널 차원에서 각각 교차 관심을 계산하여 두 개의 주의 지도를 생성합니다. 그런 다음 선형 변환을 사용하여 현재 시각적 공간을 텍스트에 해당하는 부분 공간으로 변환합니다. 여기서 선형 변환 매개변수(즉, 번역 및 스케일링 매개변수)는 이 두 개의 어텐션 맵을 기반으로 계산됩니다. 이 정렬을 통해 각 텍스트에 해당하는 시각적 하위 공간을 자동으로 찾을 수 있습니다. 마지막으로 의미 주입 모듈[3]은 또 다른 선형 변환을 따라 하위 공간의 잠재 코드를 수정합니다.

FFCLIP 관점에서 볼 때 [1, 2] 중성자 공간 경험적 선택은 의미 정렬 모듈에 있는 선형 변환의 특별한 형태입니다. 이들의 그룹 선택 작업은 w의 각 위치 차원의 사용법을 나타내는 스케일링 매개변수의 이진 값과 유사합니다. 반면에 W^+ 공간의 의미는 여전히 얽혀 있으며 경험적 설계에서는 StyleGAN의 잠재 공간과 CLIP의 텍스트 의미 공간 사이의 정확한 매핑을 찾을 수 없다는 것을 관찰했습니다. 대신, 의미론적 정렬 모듈의 스케일링 매개변수는 잠재 코드 w를 적응적으로 수정하여 다양한 텍스트 큐 임베딩을 매핑합니다. 그런 다음 번역 매개변수를 통해 정렬이 더욱 개선됩니다. 우리는 벤치마크 데이터 세트에 대한 방법을 평가하고 FFCLIP를 최첨단 방법과 비교합니다. 결과는 FFCLIP이 사용자의 의도를 전달하면서 보다 합리적인 콘텐츠를 생성할 수 있음을 보여줍니다.

FFCLIP

그림 1은 전반적인 프레임워크를 보여줍니다. FFCLIP은 먼저 사전 훈련된 GAN 반전 인코더와 텍스트 인코더를 통해 이미지와 텍스트의 잠재 인코딩을 얻습니다. 앞서 언급한 StyleGAN 시각적 의미 공간 W^+에서 이미지의 잠재 인코딩은 w이고 텍스트 인코딩은 e_t입니다. StyleCLIP과 마찬가지로 e4e GAN 반전 인코더[4]와 CLIP의 텍스트 인코더를 사용하여 각각 해당 잠재 인코딩을 얻습니다. 그런 다음 e_t와 w를 변조 모듈의 입력으로 사용하고 w의 오프셋 Δw를 출력합니다. 마지막으로 원래 w에 Δw를 추가하고 사전 훈련된 StyleGAN에 넣어 해당 결과를 얻습니다.

그림 1: 전체 프레임워크 다이어그램

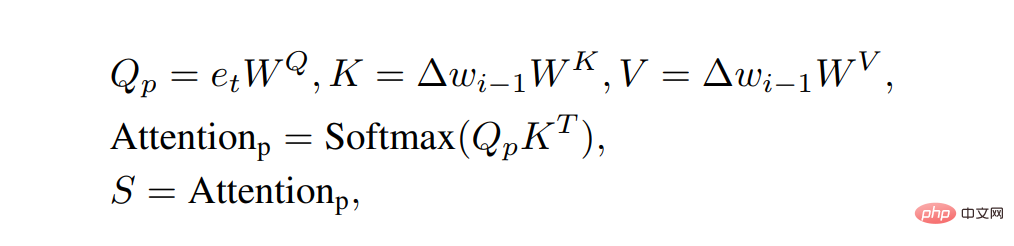

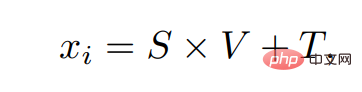

아래 두 번째 그림은 의미 변조 모듈입니다. 의미 정렬 모듈(Semantic Alignment)에서 Δw를 Key와 Value로 설정하고 e_t를 Query로 설정하여 두 개의 Attention 맵의 크기가 각각 18×1과 512×512임을 분명히 알 수 있습니다. . 그런 다음 18×1 어텐션 맵을 선형 변환의 스케일링 계수 S로 사용합니다. 어텐션 맵을 계산하는 과정은 다음과 같습니다.

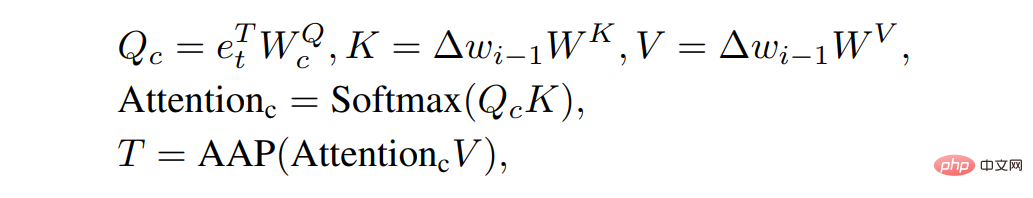

동시에 512×512 어텐션 맵을 곱합니다. 값을 기준으로 한 다음 통과합니다. 풀링 작업은 명시적 변환에서 변환 계수 T를 얻습니다. 어텐션 맵을 계산하는 과정은 다음과 같습니다.

이동 및 스케일링 계수를 얻은 후 선형 변환을 통해 현재 텍스트 e_t에 해당하는 시각적 부분 공간을 찾을 수 있습니다.

중간고사 x_i는 i번째 의미 변조 모듈의 출력 결과입니다. Δw의 크기는 18×512이므로 18×1과 512×512의 어텐션 맵은 각각 Δw의 위치와 채널의 두 가지 차원에서 계산됩니다. 이 작업은 Dual Attention [5]과 유사합니다.

위의 작업을 통해 텍스트에 해당하는 시각적 하위 공간을 얻은 다음 AdaIN과 유사한 방법을 사용하여 텍스트 정보를 이 공간에 주입합니다. 최종 결과를 얻기 위해 이 작업을 의미 주입 모듈(Semantic Injection)이라고 부릅니다. 전체 모듈의 구현 단계는 다음과 같습니다.

결국 우리 FFCLIP에는 총 4개의 의미 변조 모듈이 적층되었고, 최종적으로 최종 오프셋 Δw를 얻었습니다.

실험 결과

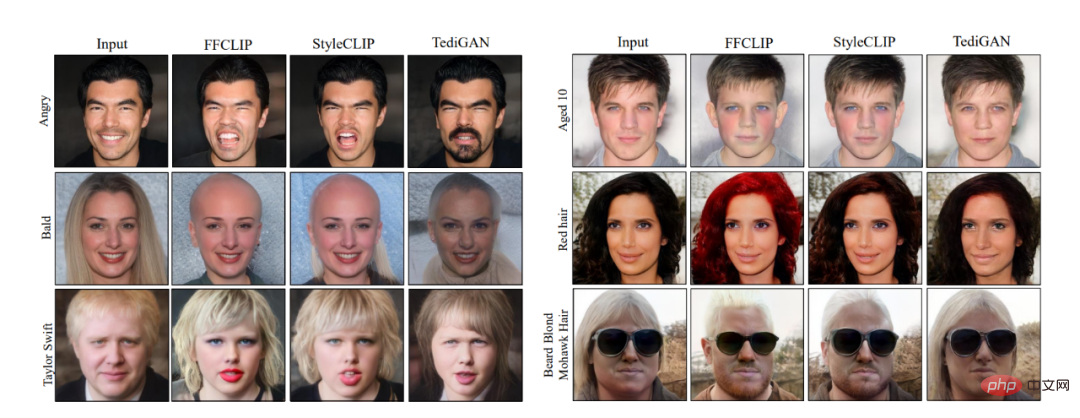

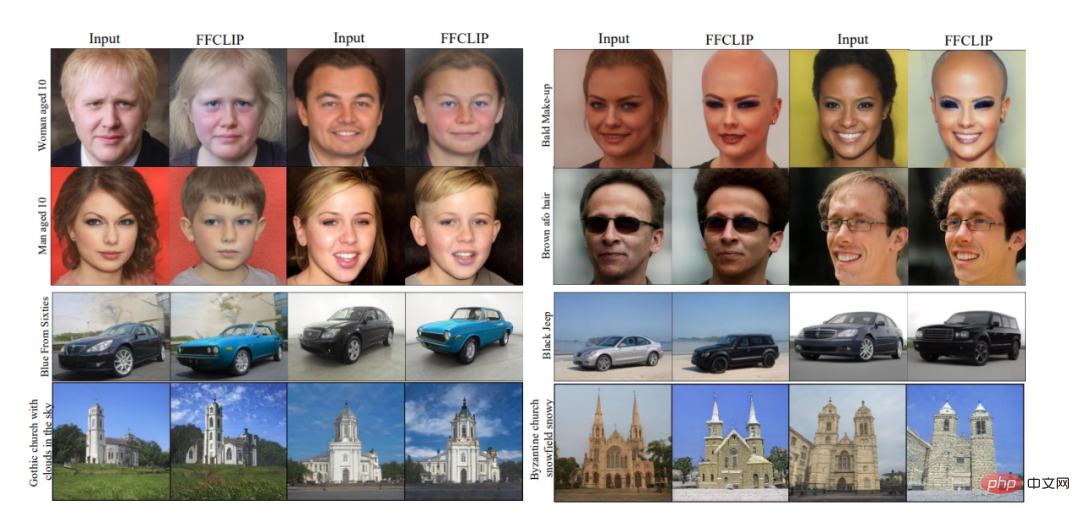

그림 3: 시각적 비교 차트

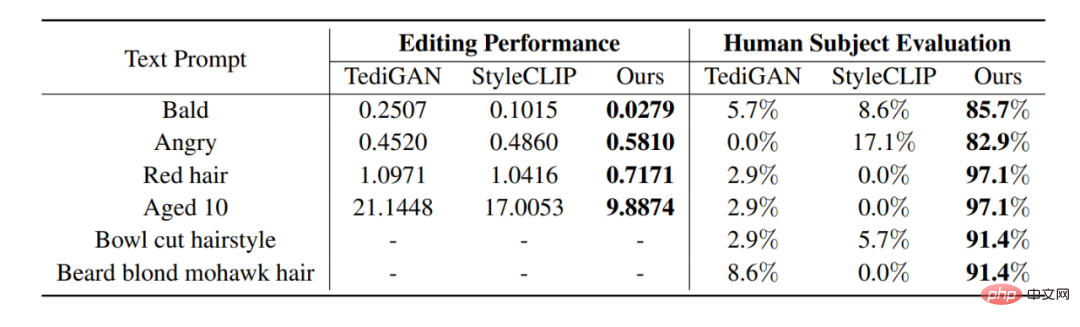

그림 3과 같이 StyleCLIP [1], TediGAN [2] 및 HairCLIP [3]을 사용하여 시각적 비교를 수행했습니다. 비교: FFCLIP이 텍스트의 의미를 더 잘 반영하고 보다 사실적인 편집 이미지를 생성할 수 있음을 알 수 있습니다. 동시에 해당 수치 비교 결과는 아래 표에 나와 있습니다. 우리의 방법은 객관적인 값과 주관적인 값 모두에서 최상의 결과를 얻을 수 있습니다.

표 1: 수치 비교

동시에, FFCLIP은 훈련 중에 단어의 조합을 보지 못했지만 단일 단어를 사용하여 매우 좋은 견고성을 보여줍니다. 훈련용으로 사용되었지만 테스트에서는 문구의 의미에 따라 이미지를 잘 편집할 수 있습니다. 시각적 효과는 그림 4에 나와 있습니다.

그림 4: 문구 편집

더 많은 실험 결과와 절제 실험을 보려면 원문을 참조하세요.

요약

본 논문에서는 다양한 텍스트를 대상으로 할 수 있지만 단일 모델만 필요한 효율적인 이미지 편집을 위한 새로운 방법인 FFCLIP을 제안합니다. 이 기사의 동기는 기존 방법이 기존 경험을 기반으로 현재 텍스트 및 GAN의 의미 하위 공간과 일치하므로 편집 모델이 하나의 텍스트 프롬프트만 처리할 수 있다는 것입니다. 정렬 및 주입된 의미 변조를 통해 잠재 매핑을 개선합니다. 이는 하나의 편집 모델을 통해 여러 텍스트 프롬프트를 처리할 수 있습니다. 여러 데이터 세트에 대한 실험은 FFCLIP이 의미상 관련성이 있고 시각적으로 현실적인 결과를 효과적으로 생성한다는 것을 보여줍니다.

위 내용은 텍스트 및 이미지 편집의 새로운 패러다임, 단일 모델로 다중 텍스트 안내 이미지 편집 가능의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!