BLOOM은 AI 연구를 위한 새로운 문화를 만들 수 있지만 과제는 여전히 남아 있습니다.

- 王林앞으로

- 2023-04-09 16:21:041573검색

번역가 | Li Rui

리뷰어 | Sun Shujuan

BigScience 연구 프로젝트는 최근 대규모 언어 모델 BLOOM을 출시했습니다. 언뜻 보면 OpenAI의 GPT-3을 복사하려는 또 다른 시도처럼 보입니다.

하지만 BLOOM이 다른 대규모 자연어 모델(LLM)과 차별화되는 점은 기계 학습 모델을 연구, 개발, 교육 및 출시하려는 노력입니다.

최근 몇 년간 대형 기술회사들은 영업비밀처럼 대규모 자연어모델(LLM)을 숨겨왔고, 빅사이언스팀은 프로젝트 초기부터 투명성과 개방성을 BLOOM의 중심에 두었습니다.

그 결과 연구 및 학습이 가능하고 누구나 사용할 수 있는 대규모 언어 모델이 탄생했습니다. BLOOM이 구축한 오픈 소스 및 오픈 협업의 사례는 대규모 자연어 모델(LLM) 및 기타 인공 지능 분야의 향후 연구에 매우 도움이 될 것입니다. 그러나 대규모 언어 모델에는 여전히 해결해야 할 몇 가지 과제가 있습니다.

BLOOM이란?

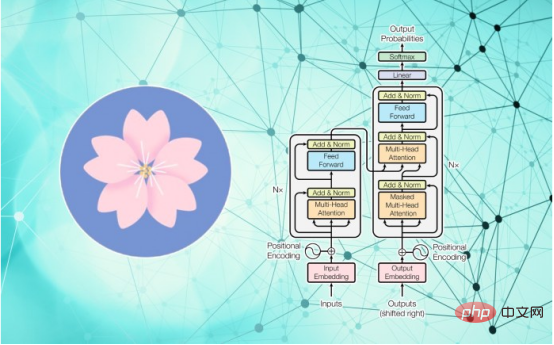

BLOOM은 "BigScience Large-Scale Open Science Open Access Multilingual Model"의 약어입니다. 데이터 관점에서는 GPT-3, OPT-175B와 크게 다르지 않습니다. 이는 자연어 및 소프트웨어 소스 코드를 포함하여 1.6TB의 데이터를 사용하여 훈련된 1,760억 개의 매개변수를 갖춘 매우 큰 Transformer 모델입니다.

GPT-3와 마찬가지로 제로샷 또는 퓨샷 학습을 통해 텍스트 생성, 요약, 질문 답변, 프로그래밍 등 많은 작업을 수행할 수 있습니다.

하지만 BLOOM의 중요성은 그 이면의 조직과 구축 과정에 있습니다.

BigScience는 머신러닝 모델 센터 'Hugging Face'가 2021년에 시작한 연구 프로젝트입니다. 웹사이트 설명에 따르면 이 프로젝트는 "AI/NLP 연구 커뮤니티 내에서 대규모 언어 모델과 대규모 연구 결과물을 생성, 학습 및 공유하는 대안적인 방법을 보여주는 것을 목표로 합니다."

이와 관련하여 유럽의 BigScience Inspiration이 그려집니다. 개방형 과학 협력을 통해 전체 연구 커뮤니티에 유용한 대규모 인공물 생성을 촉진하는 핵 연구 센터(CERN) 및 대형 강입자 충돌기(LHC)와 같은 과학 제작 계획에서 비롯됩니다.

2021년 5월부터 1년 동안 60개국, 250개 이상의 기관에서 1,000명 이상의 연구원이 BigScience에서 BLOOM을 공동 제작했습니다.

투명성, 개방성 및 포용성

대부분의 주요 대규모 자연어 모델(LLM)은 영어 텍스트로만 훈련되지만 BLOOM의 훈련 코퍼스에는 46개의 자연어와 13개의 프로그래밍 언어가 포함됩니다. 이는 기본 언어가 영어가 아닌 많은 지역에서 유용합니다.

BLOOM은 또한 대규모 기술 교육 회사의 모델에 대한 실제 의존도를 깨뜨립니다. 대규모 자연어 모델(LLM)의 주요 문제점 중 하나는 학습 및 조정 비용이 높다는 것입니다. 이러한 장벽으로 인해 1,000억 개의 매개변수가 포함된 대규모 자연어 모델(LLM)이 자금력이 풍부한 대형 기술 기업의 독점 영역이 되었습니다. 최근 몇 년 동안 인공 지능 연구소는 보조금을 받는 클라우드 컴퓨팅 리소스를 확보하고 연구 자금을 지원하기 위해 대규모 기술 회사의 관심을 끌었습니다.

반면, BigScience 연구팀은 슈퍼컴퓨터 Jean Zay에서 BLOOM을 훈련시키기 위해 프랑스 국립 과학 연구 센터로부터 300만 유로의 보조금을 받았습니다. 해당 기술에 대한 독점 라이센스를 상업 회사에 부여하는 합의도 없으며 모델을 상용화하여 수익성 있는 제품으로 전환하겠다는 약속도 없습니다.

또한 BigScience 팀은 전체 모델 훈련 과정을 완전히 투명하게 공개합니다. 데이터세트, 회의 기록, 토론, 코드는 물론 훈련 모델의 로그 및 기술 세부정보를 게시합니다.

연구원들은 모델의 데이터와 메타데이터를 연구하고 흥미로운 결과를 발표하고 있습니다.

예를 들어, David McClure 연구원은 2022년 7월 12일에 다음과 같이 트윗했습니다. “저는 Bigscience와 Hugging Face의 정말 멋진 BLOOM 모델 뒤에 있는 훈련 데이터세트를 살펴봤습니다. 영어 코퍼스 1,000만 개 샘플 중 일부(약 1.25개)가 있습니다. 전체의 %는 'all-distilroberta-v1'로 인코딩된 다음 UMAP을 2d로 인코딩합니다. "

물론 훈련된 모델 자체를 Hugging Face의 플랫폼에서 다운로드할 수 있으므로 이 문제가 완화됩니다. 연구원들은 훈련에 수백만 달러를 소비했습니다.

Facebook은 지난달 몇 가지 제한 사항에 따라 대규모 자연어 모델(LLM) 중 하나를 오픈 소스로 공개했습니다. 그러나 BLOOM이 가져온 투명성은 전례가 없으며 업계의 새로운 표준을 설정할 것을 약속합니다.

BLOOM 교육 공동 책임자인 Teven LeScao는 다음과 같이 말했습니다. “산업 AI 연구실의 비밀과 달리 BLOOM은 가장 강력한 AI 모델이 더 광범위한 연구 커뮤니티에 의해 책임감 있고 개방적인 방식으로 교육되고 출시될 수 있음을 보여줍니다. ”

도전은 남아있습니다

AI 연구와 대규모 언어 모델에 개방성과 투명성을 제공하려는 BigScience의 노력은 칭찬받을 만하지만 이 분야에 내재된 과제는 변함이 없습니다.

대규모 자연어 모델(LLM) 연구는 점점 더 큰 모델로 이동하고 있으며 이로 인해 교육 및 운영 비용이 더욱 증가합니다. BLOOM은 훈련을 위해 384개의 Nvidia Tesla A100 GPU(개당 약 $32,000 가격)를 사용합니다. 그리고 더 큰 모델에는 더 큰 컴퓨팅 클러스터가 필요합니다. BigScience 팀은 계속해서 다른 오픈 소스 대형 자연어 모델(LLM)을 만들 것이라고 발표했지만 팀이 점점 비용이 많이 드는 연구에 어떻게 자금을 지원할지는 아직 알 수 없습니다. 예를 들어 OpenAI는 비영리 조직으로 시작하여 나중에 제품을 판매하고 Microsoft의 자금에 의존하는 영리 조직이 되었습니다.

해결해야 할 또 다른 문제는 이러한 모델을 실행하는 데 드는 막대한 비용입니다. 압축된 BLOOM 모델의 크기는 227GB이며 이를 실행하려면 수백 GB의 메모리를 갖춘 특수 하드웨어가 필요합니다. 비교를 위해 GPT-3에는 Nvidia DGX 2와 동등한 컴퓨팅 클러스터가 필요하며 비용은 약 $400,000입니다. Hugging Face는 연구원들이 상당한 비용인 시간당 약 40달러에 모델을 사용할 수 있도록 하는 API 플랫폼을 출시할 계획입니다.

BLOOM 실행 비용은 대규모 자연어 모델(LLM)로 구동되는 제품을 구축하려는 응용 기계 학습 커뮤니티, 스타트업 및 조직에도 영향을 미칠 것입니다. 현재 OpenAI에서 제공하는 GPT-3 API가 제품 개발에 더 적합합니다. 개발자들이 귀중한 연구를 바탕으로 제품을 만들 수 있도록 BigScience와 Hugging Face가 어떤 방향으로 나아갈지 지켜보는 것도 흥미로울 것입니다.

이와 관련하여 향후 릴리스에서는 BigScience 모델의 더 작은 버전이 기대됩니다. 미디어에서 자주 묘사되는 것과는 달리 LLM(대형 자연어 모델)은 여전히 "공짜 점심 없음" 원칙을 고수합니다. 이는 기계 학습을 적용할 때 특정 작업에 맞게 미세 조정된 보다 컴팩트한 모델이 많은 작업에서 평균 성능을 보이는 매우 큰 모델보다 더 효과적이라는 것을 의미합니다. 예를 들어 Codex는 GPT-3의 수정된 버전으로, GPT-3보다 훨씬 작은 크기와 비용으로 프로그래밍에 큰 도움을 줍니다. GitHub는 현재 Codex 기반 제품인 Copilot을 월 10달러에 제공하고 있습니다.

BLOOM이 만들고자 하는 새로운 문화로서 학문과 응용 AI가 앞으로 어디로 갈지 살펴보는 것도 흥미로울 것입니다.

원제: BLOOM은 AI 연구를 위한 새로운 문화를 설정할 수 있지만 과제는 여전히 남아있습니다, 저자: Ben Dickson

위 내용은 BLOOM은 AI 연구를 위한 새로운 문화를 만들 수 있지만 과제는 여전히 남아 있습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!