Gary Marcus: 텍스트로 생성된 이미지 시스템은 세상을 이해할 수 없으며 AGI와는 거리가 멀습니다.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-04-09 09:31:031482검색

이 기사는 Lei Feng.com에서 복제되었습니다. 재인쇄가 필요한 경우 Lei Feng.com 공식 웹사이트로 이동하여 승인을 신청하세요.

DALL-E 2의 등장 이후 많은 사람들은 사실적인 이미지를 그릴 수 있는 AI가 일반 인공지능(AGI)을 향한 큰 진전이라고 믿고 있습니다. OpenAI CEO인 샘 알트만(Sam Altman)은 DALL-E 2가 출시되었을 때 "AGI가 거칠어질 것"이라고 선언한 적이 있으며, 언론에서도 이러한 시스템이 일반 지능의 발전에 미치는 중요성을 과장하고 있습니다.

근데 정말 그럴까요? AI에 찬물을 끼얹는 유명한 AI 학자이자 마니아인 게리 마커스는 “유보적”이라고 표현했다.

최근 그는 AGI의 진행 상황을 평가할 때 Dall-E, Imagen, Midjourney 및 Stable Diffusion과 같은 시스템이 진정으로 세상을 이해하고 해당 지식을 기반으로 추론하고 결정을 내릴 수 있는지 확인하는 것이 중요하다고 주장했습니다.

이 시스템이 AI(협의 및 광역 AI 포함)에 미치는 중요성을 판단할 때 다음 세 가지 질문을 할 수 있습니다.

이미지 합성 시스템이 고품질 이미지를 생성할 수 있습니까?

언어 입력을 자신이 생산하는 이미지와 연관시킬 수 있나요?

그들은 자신이 제시하는 이미지 뒤에 있는 세계를 이해하고 있나요?

1 AI는 언어와 이미지의 관계를 이해하지 못합니다

첫 번째 질문에서 대답은 '예'입니다. 유일한 차이점은 훈련된 인간 예술가가 AI를 사용하여 이미지를 생성하는 데 더 나은 작업을 수행할 수 있다는 것입니다.

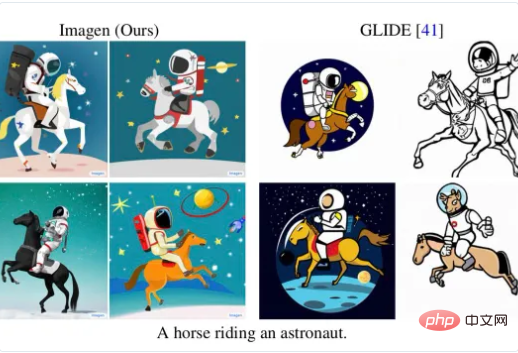

두 번째 질문의 답은 반드시 확실하지는 않습니다. 일부 언어 입력에서는 이러한 시스템이 잘 작동할 수 있습니다. 예를 들어 아래 그림은 DALL-E 2에서 생성된 "말을 탄 우주비행사"입니다.

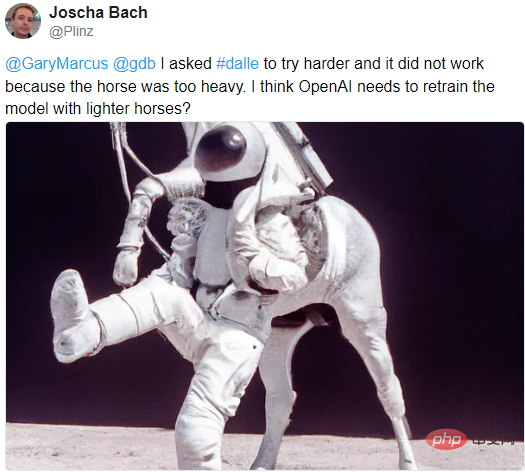

그러나 일부 다른 언어 입력에서는 이러한 AI가 제대로 작동하지 않습니다. .. 속이기 쉽습니다. 예를 들어, Marcus는 얼마 전 Twitter에서 "우주 비행사를 탄 말"에 직면했을 때 이러한 시스템이 상응하는 정확한 이미지를 생성하는 것이 어렵다고 지적했습니다. 예를 들어 AI 연구원인 Joscha Bach는 "Imagen이 잘못된 훈련 세트를 사용할 수도 있다"고 믿었고, 기계 학습 교수인 Luca Ambrogioni는 이는 "Imagen이 이미 어느 정도 상식을 갖고 있다"는 것을 보여주는 것일 뿐이므로 무언가 생성을 거부한다고 반박했습니다. 말도 안 되는.

그러나 Marcus는 문제가 핵심은 시스템이 이미지를 생성할 수 있는지 여부가 아닙니다. 똑똑한 사람들은 시스템이 특정 이미지를 그리도록 하는 방법을 항상 찾을 수 있지만 이러한 시스템은 언어와 이미지 간의 연결에 대한 깊은 이해가 없습니다.

2 자전거 바퀴가 뭔지 모르시나요? 어떻게 AGI라고 부를 수 있나요?

보통 사람들 이 사진을 보면 상식에 어긋나는 일이라고 생각하실 겁니다. 구멍에서 커피가 새지 않는 것은 불가능합니다. 유사한 항목:

"사각 바퀴가 달린 자전거"

Gary Marcus: 텍스트 생성 이미지 시스템은 세상을 이해할 수 없으며 AGI와도 거리가 멀습니다.

"선인장 가시로 덮인 화장지"

Gary Marcus: 텍스트 생성 이미지 시스템은 세상을 이해할 수 없습니다. 세상을 이해하고 AGI와는 거리가 멀다 AGI는 아직 멀다

'예'라고 말하기는 쉽지만 '아니오'라고 말하기는 어렵다. AI가 불가능한 것을 그리도록 하는 데 어려움이 있는 곳이 바로 여기에 있습니다.

하지만 어쩌면 시스템은 단지 초현실적인 이미지를 그리고 싶어할 뿐입니다. 딥마인드 연구교수인 마이클 브론스타인(Michael Bronstein)이 말했듯이, 자신이라면 이렇게 그릴 것입니다.

그렇다면 이 문제를 어떻게 해결할 수 있을까요? Gary Marcus는 최근 철학자 Dave Chalmers와의 대화에서 새로운 영감을 얻었습니다.

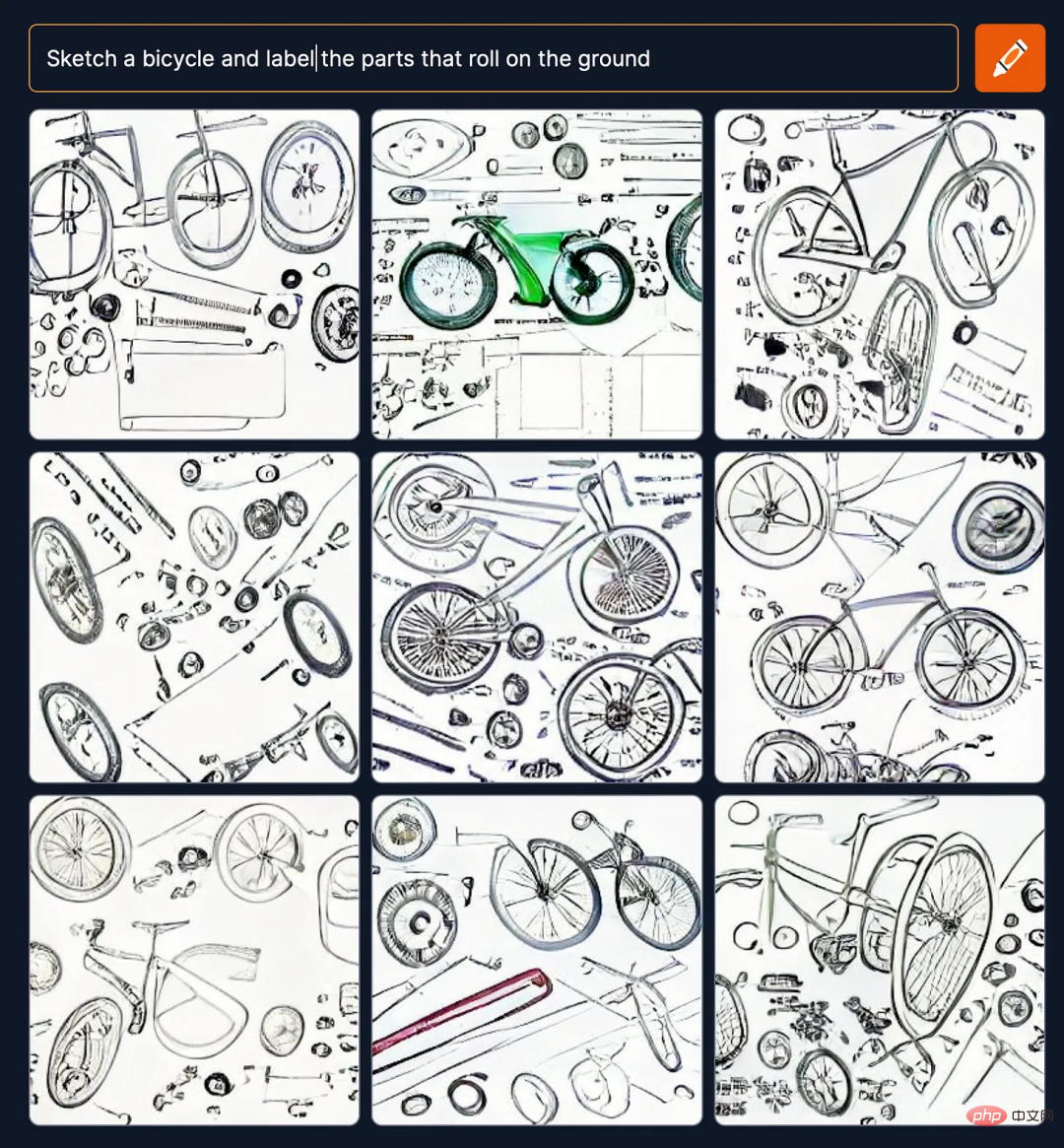

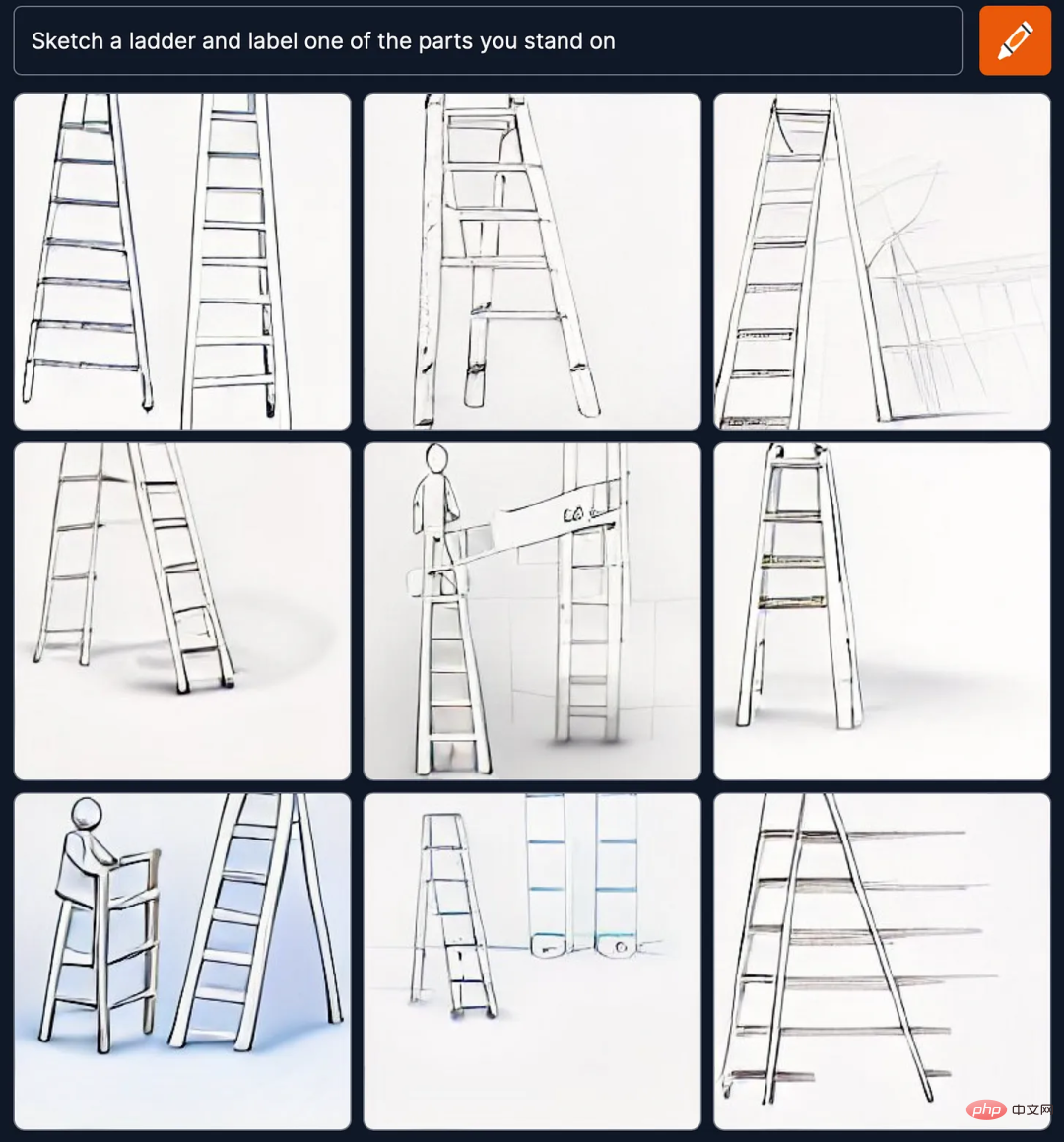

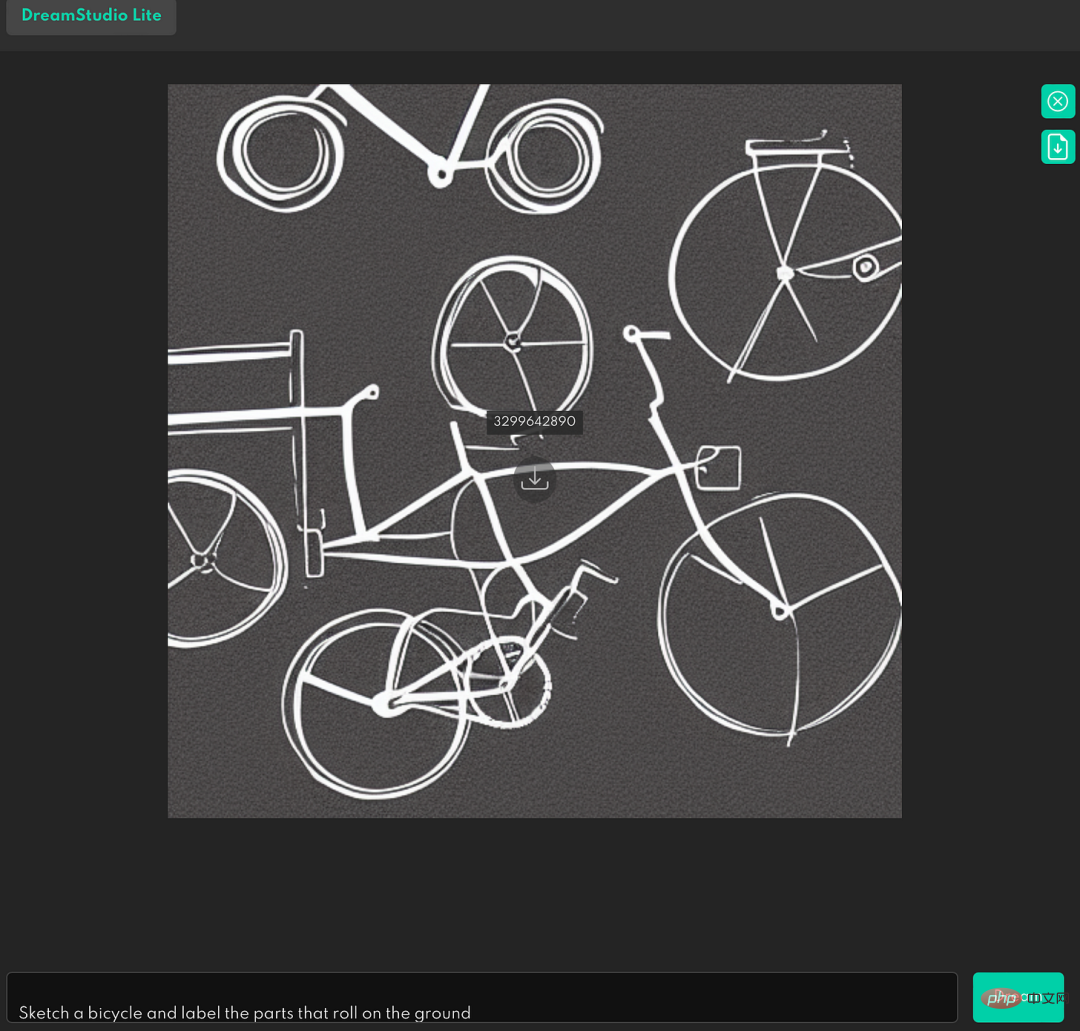

부분과 전체, 기능에 대한 시스템의 이해를 이해하기 위해 Gary Marcus는 시스템 성능이 올바른지 더 명확하게 파악하는 작업을 제안했으며 "자전거를 스케치하고 부품에 라벨을 붙입니다"라는 텍스트 프롬프트를 제공했습니다. that Roll on the ground"(자전거를 그리고 땅에서 굴러가는 부분에 라벨을 붙이세요), "사다리를 스케치하고 당신이 서 있는 부분 중 하나에 라벨을 붙이세요"(사다리를 그리고 당신이 서 있는 부분 중 하나에 라벨을 붙이세요) .

이 테스트의 특별한 점은 "자전거를 그리고 바퀴를 표시하세요" 또는 "사다리를 그리고 페달을 표시하세요"와 같은 프롬프트를 직접 제공하지 않고 AI가 시작하도록 허용한다는 것입니다. '구르는 부분', '서 있는 부분' 등의 설명에서 해당 항목을 추론하는 것은 AI가 세상을 이해하는 능력을 테스트하는 것입니다.

하지만 Marcus의 테스트 결과에 따르면 Craiyon(이전의 DALL-E mini)은 이런 일에 형편없으며 자전거 바퀴와 사다리 페달이 무엇인지 이해하지 못합니다.

이것이 DALL-E Mini만의 문제인가요?

Gary Marcus는 그렇지 않다는 것을 발견했습니다. 현재 가장 인기 있는 텍스트 생성 이미지 시스템인 Stable Diffusion에서도 동일한 결과가 나타났습니다.

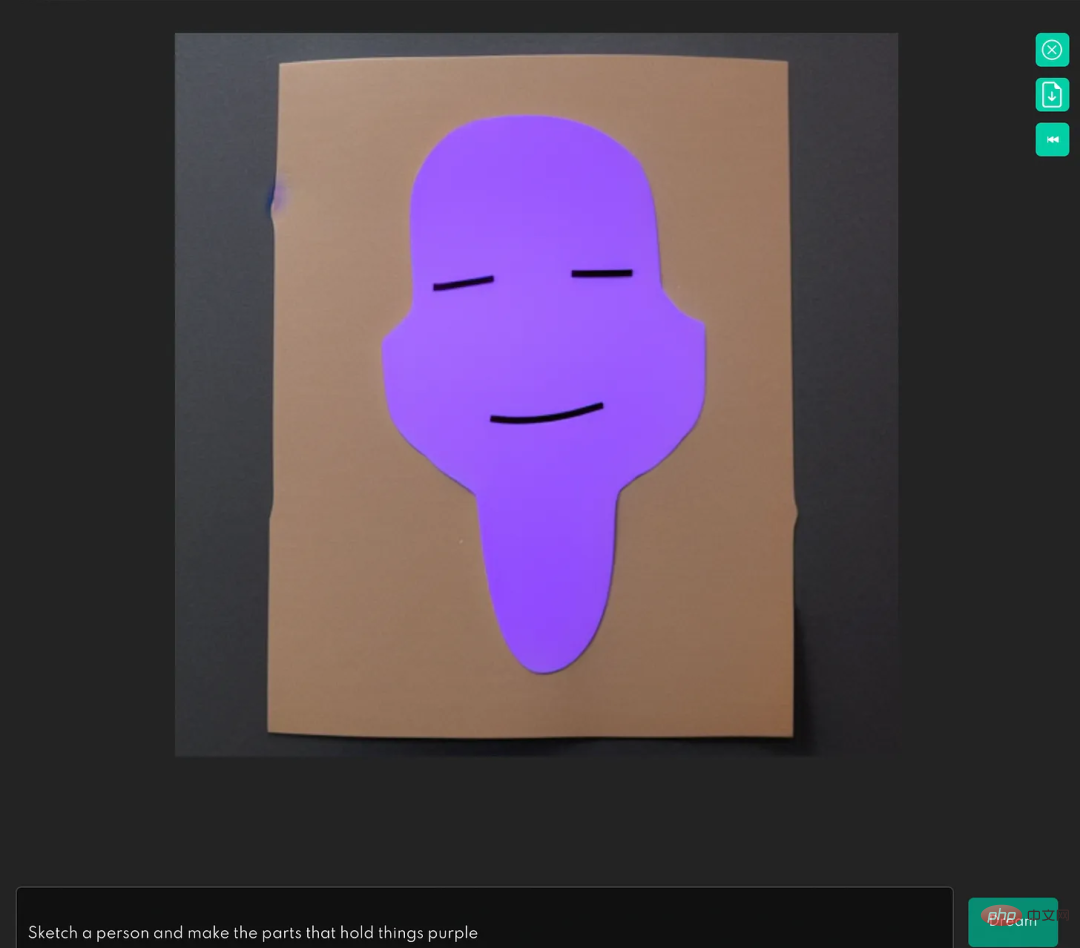

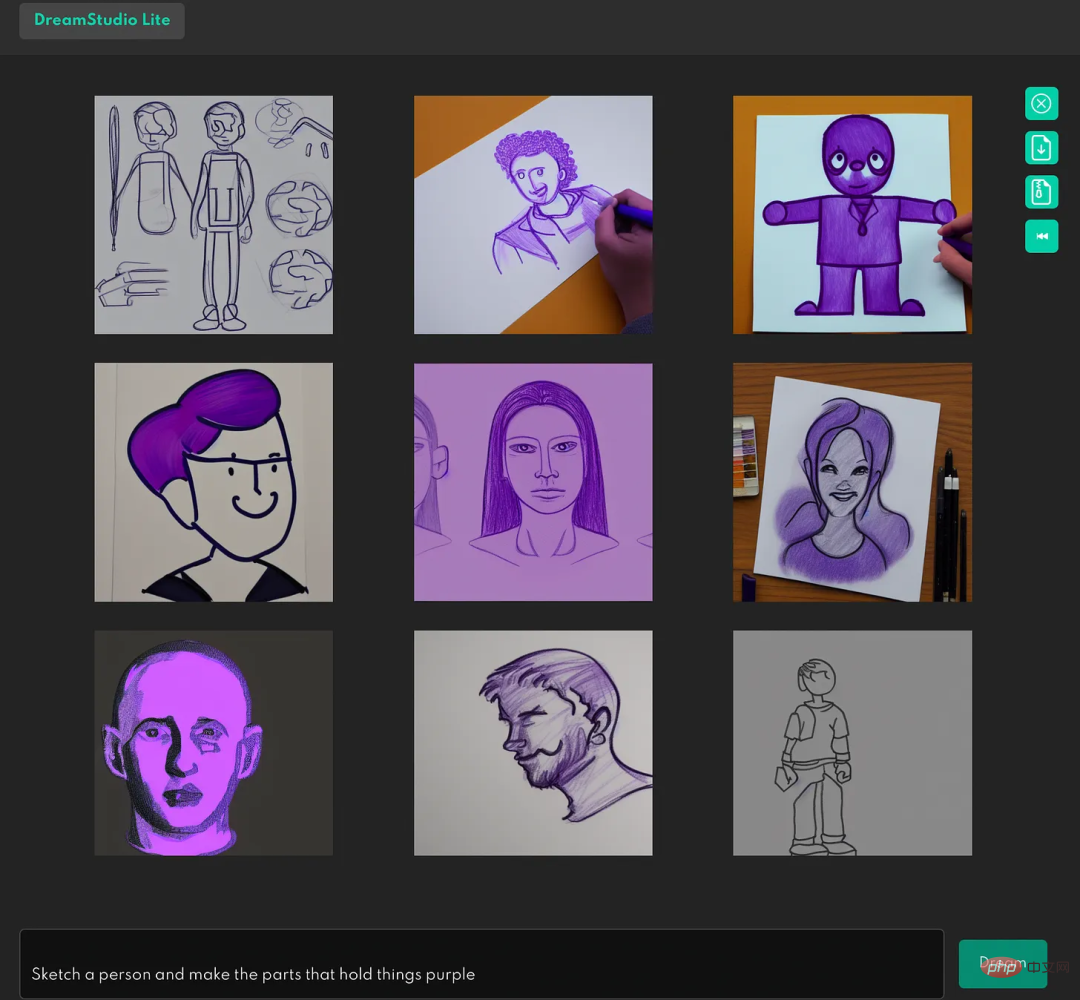

예를 들어 Stable Diffusion "사람을 스케치하고 물건을 담는 부분을 보라색으로 만듭니다"(사람을 스케치하고 물건을 담는 부분을 보라색으로 만듭니다)라고 하면 결과는 다음과 같습니다.

분명히 Stable Diffusion은 아니, 나는 인간의 손이 무엇인지 이해하지 못합니다.

그리고 다음 9번의 시도 중 단 한 번만 성공적으로 완료되었으며(오른쪽 상단) 그다지 정확하지 않았습니다.

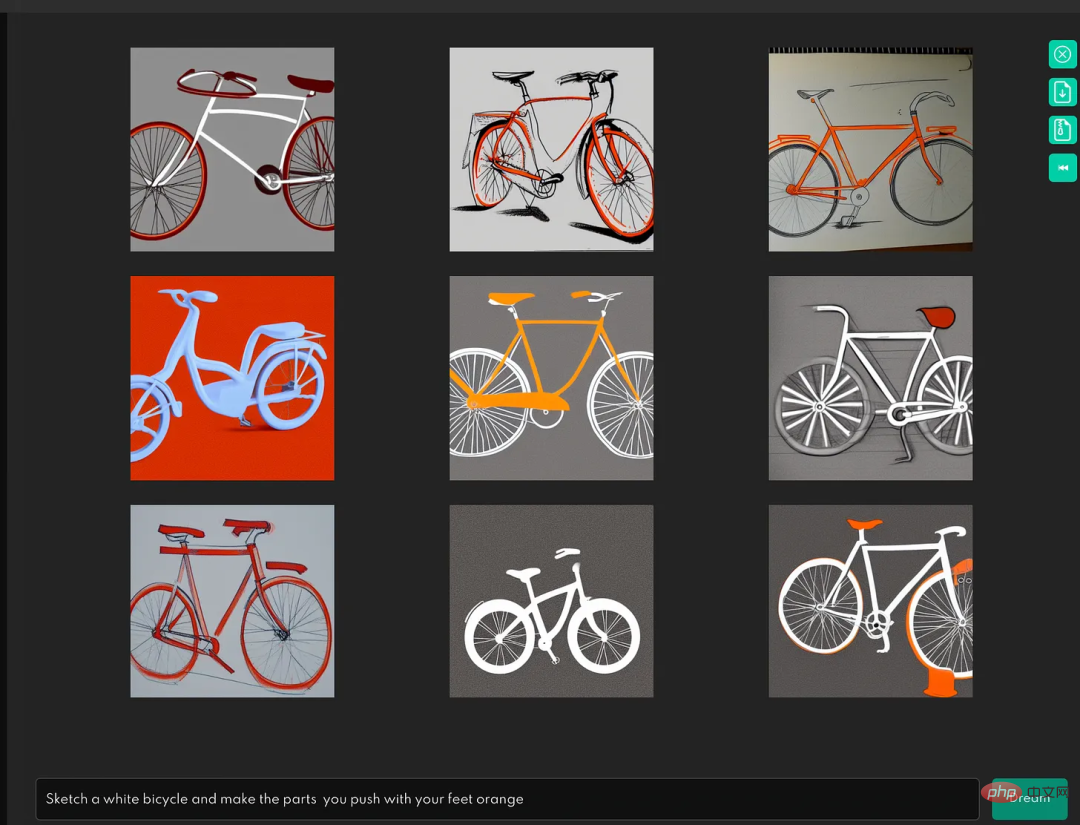

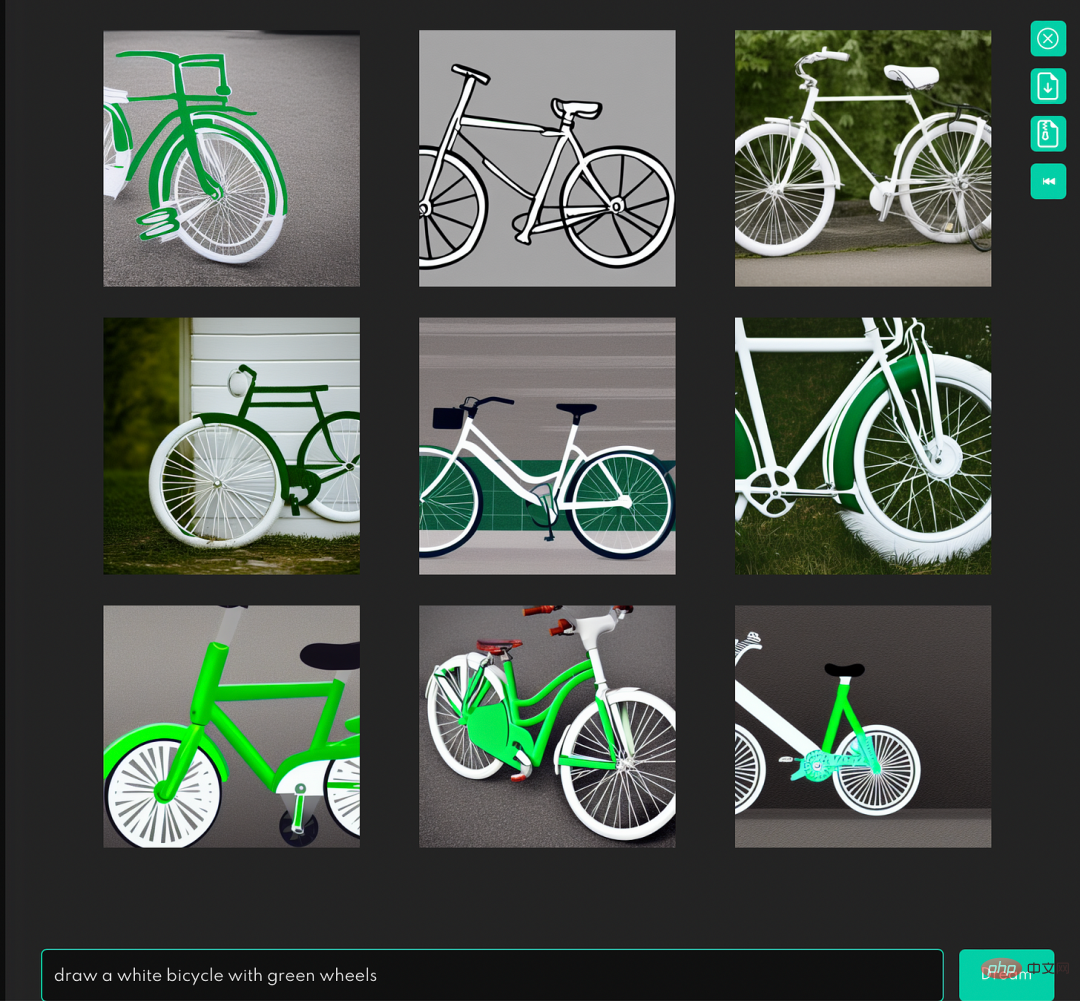

다음 테스트는 "흰색 자전거를 그리고 회전"이었습니다. 발로 밀린 부분이 주황색으로 변합니다." 결과 이미지는 다음과 같습니다.

그래서 자전거 페달이 무엇인지 이해할 수 없습니다.

그리고 "자전거 스케치 및 땅에 굴러가는 부분 표시" 그리기 테스트에서 성능이 매우 좋지 않았습니다.

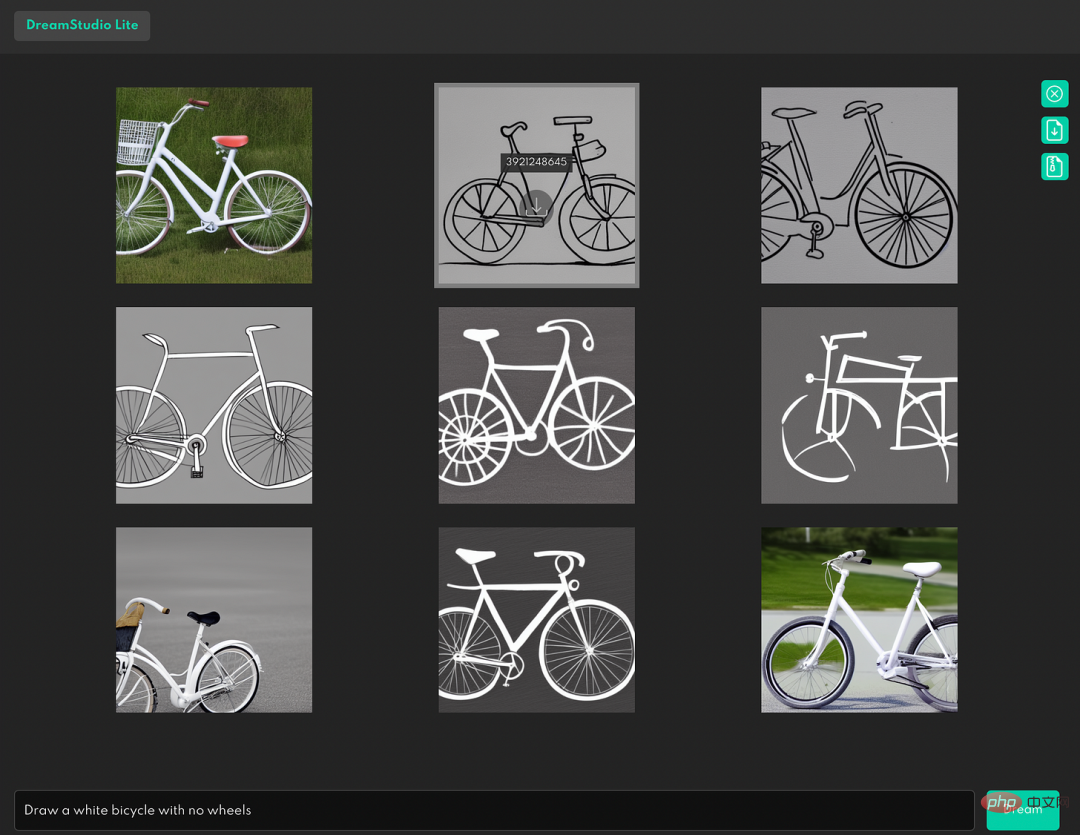

텍스트 프롬프트에 "그리기"와 같은 부정적인 단어가 포함된 경우 바퀴 없는 흰색 자전거", 결과는 다음과 같습니다.

이는 시스템이 부정적인 논리적 관계를 이해하지 못한다는 것을 보여줍니다.

부분과 전체의 관계에만 초점을 맞추고 복잡한 문법이나 기능이 나타나지 않는 "녹색 바퀴가 달린 흰색 자전거 그리기"처럼 간단하더라도 결과에는 여전히 문제가 있습니다.

그러면 마커스는 바퀴가 무엇인지, 바퀴가 어떤 용도로 사용되는지 이해하지 못하는 시스템이 인공 지능의 큰 발전이 될 수 있는지 물었습니다.

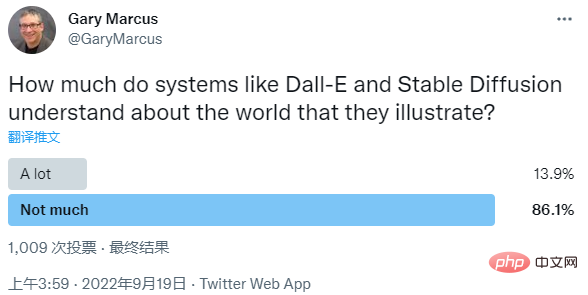

오늘 Gary Marcus도 이 문제에 대한 설문 조사를 발표했습니다. 그가 던진 질문은 "Dall-E와 Stable Diffusion과 같은 시스템은 그들이 묘사하는 세계에 대해 얼마나 알고 있습니까?"였습니다. 그 중 86.1%가 의 사람들은 시스템이 세상을 잘 이해하지 못한다고 믿고 있으며, 13.9%만이 이러한 시스템이 세상을 높은 수준으로 이해하고 있다고 믿습니다.

Stability.AI의 CEO인 Emad Mostique도 제가 "많지 않음"에 투표했다고 응답하고 "그들은 단지 퍼즐의 작은 조각일 뿐"이라고 인정했습니다.

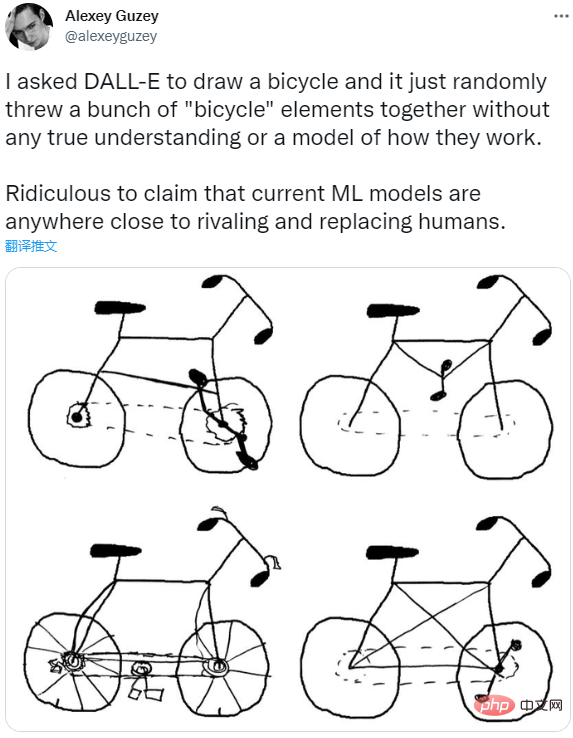

Alexey 과학 기관인 New Science의 Guzey도 Marcus에게 비슷한 발견을 했습니다. 그는 DALL-E에게 자전거를 그려달라고 요청했지만 결과는 자전거 요소가 잔뜩 쌓여 있는 것뿐이었습니다.

그래서 그는 자전거가 무엇인지, 자전거가 어떻게 작동하는지 진정으로 이해하는 모델은 없으며 인간과 거의 경쟁하거나 대체할 수 있는 현재 ML 모델을 생성하는 것은 터무니없다고 믿습니다.

어떻게 생각하세요?

위 내용은 Gary Marcus: 텍스트로 생성된 이미지 시스템은 세상을 이해할 수 없으며 AGI와는 거리가 멀습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!