Python 크롤링 웹페이지 소개

- coldplay.xixi앞으로

- 2021-03-09 10:03:203868검색

저는 이전에도 인터넷에서 웹 페이지를 크롤링하기 위해 크롤러에 대한 코드를 많이 작성했습니다. 최근에도 제가 작성한 크롤러를 모두가 사용할 수 있도록 기록하고 싶습니다!

코드는 4부분으로 나뉩니다:

1부: 웹사이트를 찾습니다.

我这里还是找了一个比较简单的网站,就是大家都知道的https://movie.douban.com/top250?start= 大家可以登录里面看一下。

여기에 설치되지 않은 라이브러리가 있을 수 있습니다. 위 그림을 보면 웹페이지 크롤링에 필요한 라이브러리를 설치할 수 있습니다. 그 중 이번에 사용한 라이브러리는 bs4, urllib, xlwt, re입니다. .

(무료 학습 추천: python 비디오 튜토리얼)

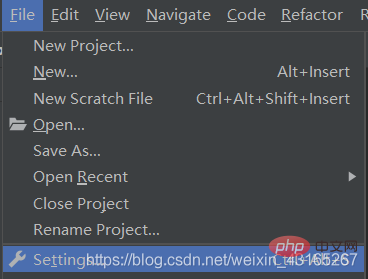

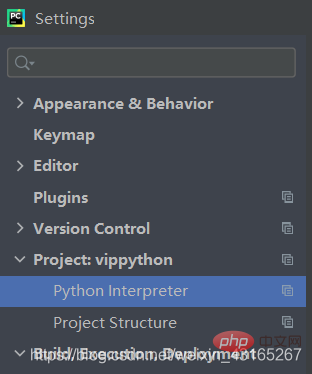

그림과 같이

여기에서 파일 설정-프로젝트를 선택한 다음 왼쪽 하단에 있는 더하기 기호를 선택하여 파일을 설치합니다. 필요. .

다음 코드는 웹 페이지 크롤링을 위한 소스 코드입니다.

import urllib.requestfrom bs4 import BeautifulSoupimport xlwtimport redef main():

# 爬取网页

baseurl = 'https://movie.douban.com/top250?start='

datalist = getData(baseurl)

savepath = '豆瓣电影Top250.xls'

# 保存数据

saveData(datalist,savepath)

# askURL("https://movie.douban.com/top250?start=1")#影片详情的规则findLink = re.compile(r'<a>') #创建从正则表达式,表示规则findImgSrc = re.compile(r'<img class="title lazy" src="/static/imghwm/default1.png" data-src="(.*?)" . alt="Python 크롤링 웹페이지 소개" >(.*)')#影片的评分findReating = re.compile(r'<span>(.*)</span>')#找到评价人数findJudge = re.compile(r'<span>(\d*)人评价</span>')#找到概况findInq = re.compile(r'<span>(.*)</span>')#找到影片的相关内容findBb = re.compile(r'<p>(.*?)</p>', re.S)#re.S忽视换行符</a>

파트 2: 웹 페이지 크롤링.

def getData(baseurl):

datalist = []

for i in range(0, 10):

url = baseurl + str(i*25)

html = askURL(url) #保存获取到的网页源码

#对网页进行解析

soup = BeautifulSoup(html, 'html.parser')

for item in soup.find_all('p', class_="item"): #查找符合要求的字符串 形成列表

#print(item) #测试查看电影信息

data = []

item = str(item)

link = re.findall(findLink, item)[0] #re库用来查找指定的字符串

data.append(link)

imgSrc = re.findall(findImgSrc, item)[0]

data.append(imgSrc) #添加图片

titles = re.findall(finTitle, item) #

if (len(titles) == 2):

ctitle = titles[0] #添加中文名

data.append(ctitle)

otitle = titles[1].replace("/", "") #replace("/", "")去掉无关的符号

data.append(otitle) #添加英文名

else:

data.append(titles[0])

data.append(' ')#外国名字留空

rating = re.findall(findReating, item)[0] #添加评分

data.append(rating)

judgeNum = re.findall(findJudge,item) #评价人数

data.append(judgeNum)

inq = re.findall(findInq, item) #添加概述

if len(inq) != 0:

inq = inq[0].replace(".", "") #去掉句号

data.append(inq)

else:

data.append(" ") #留空

bd = re.findall(findBb,item)[0]

bd = re.sub('<br>(\s+)?',' ', bd) #去掉br 后面这个bd表示对bd进行操作

bd = re.sub('/', ' ', bd) #替换/

data.append(bd.strip()) #去掉前后的空格strip()

datalist.append(data) #把处理好的一部电影放入datalist当中

return datalist

3부: 지정된 URL 정보를 가져옵니다.

#得到指定的一个url网页信息def askURL(url):

head = {

"User-Agent": "Mozilla/5.0 (Linux; Android 6.0; Nexus 5 Build/MRA58N) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/87.0.4280.141 Mobile Safari/537.36"}

request = urllib.request.Request(url,headers=head) # get请求不需要其他的的,而post请求需要 一个method方法

html = ""

try:

response = urllib.request.urlopen(request)

html = response.read().decode('utf-8')

# print(html)

except Exception as e:

if hasattr(e,'code'):

print(e.code)

if hasattr(e,'reason'):

print(e.reason)

return html

4부: 데이터 저장

# 3:保存数据def saveData(datalist,savepath):

book = xlwt.Workbook(encoding="utf-8", style_compression=0)

sheet = book.add_sheet('豆瓣电影Top250', cell_overwrite_ok=True)

col = ('电影详情链接', '图片链接', '影片中文名', '影片外国名', '评分', '评价数', '概况', '相关信息')

for i in range(0,8):

sheet.write(0,i,col[i]) #列名

for i in range(0,250):

print("第%d条"%i)

data = datalist[i]

for j in range(0,8):

sheet.write(i+1,j,data[j])

book.save(savepath) #保存

코드를 살펴보겠습니다. 코드 주석을 아주 명확하게 작성했습니다.

이 크롤러를 배우려면 기본적인 정규식도 배워야 합니다. 물론 기본적인 Python 구문도 모두에게 도움이 되기를 바랍니다.

관련 무료 학습 권장사항: python tutorial(동영상)

위 내용은 Python 크롤링 웹페이지 소개의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

성명:

이 기사는 csdn.net에서 복제됩니다. 침해가 있는 경우 admin@php.cn으로 문의하시기 바랍니다. 삭제

이전 기사:스파이더가 코드를 실행하는 방법다음 기사:스파이더가 코드를 실행하는 방법