requests는 Python으로 구현된 간단하고 사용하기 쉬운 HTTP 라이브러리입니다. urllib보다 사용하기가 훨씬 간단합니다.

왜냐하면. 타사 라이브러리이므로

pip install requests

전에 cmd로 설치해야 합니다. 설치가 완료된 후 가져오면 정상이면 사용을 시작할 수 있습니다.

기본 사용법:

requests.get()은 대상 웹사이트를 요청하는 데 사용되며 유형은 HTTPresponse 유형입니다.

import requests response = requests.get('http://www.baidu.com') print(response.status_code) # 打印状态码 print(response.url) # 打印请求url print(response.headers) # 打印头信息 print(response.cookies) # 打印cookie信息print(response.text) #以文本形式打印网页源码 print(response.content) #以字节流形式打印#🎜🎜 #실행 결과 :상태 코드: 200각종 요청 방법:

import requests requests.get('http://httpbin.org/get') requests.post('http://httpbin.org/post') requests.put('http://httpbin.org/put') requests.delete('http://httpbin.org/delete') requests.head('http://httpbin.org/get') requests.options('http://httpbin.org/get')기본 가져오기 요청

import requests response = requests.get('http://httpbin.org/get')print(response.text)With 매개변수 GET 요청: 첫 번째 방법은 매개변수를 URL에 직접 넣는 것입니다

import requests response = requests.get(http://httpbin.org/get?name=gemey&age=22)print(response.text)Parse json

import requests response = requests.get('http://httpbin.org/get') print(response.text) print(response.json()) #response.json()方法同json.loads(response.text) print(type(response.json()))

위 내용은 Python에 요청 모듈을 설치하는 방법의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

python中CURL和python requests的相互转换如何实现May 03, 2023 pm 12:49 PM

python中CURL和python requests的相互转换如何实现May 03, 2023 pm 12:49 PMcurl和Pythonrequests都是发送HTTP请求的强大工具。虽然curl是一种命令行工具,可让您直接从终端发送请求,但Python的请求库提供了一种更具编程性的方式来从Python代码中发送请求。将curl转换为Pythonrequestscurl命令的基本语法如下所示:curl[OPTIONS]URL将curl命令转换为Python请求时,我们需要将选项和URL转换为Python代码。这是一个示例curlPOST命令:curl-XPOSThttps://example.com/api

Python爬虫Requests库怎么使用May 16, 2023 am 11:46 AM

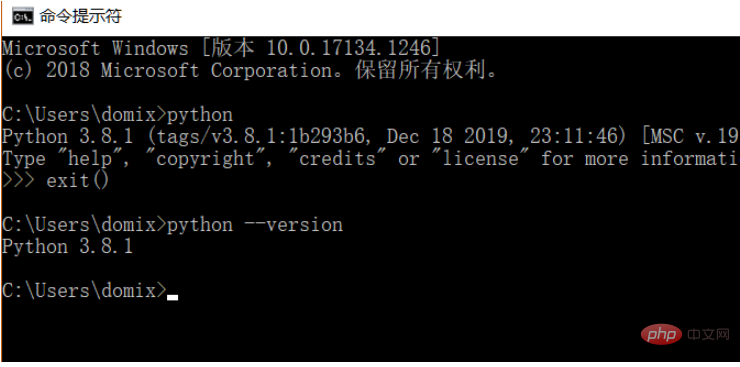

Python爬虫Requests库怎么使用May 16, 2023 am 11:46 AM1、安装requests库因为学习过程使用的是Python语言,需要提前安装Python,我安装的是Python3.8,可以通过命令python--version查看自己安装的Python版本,建议安装Python3.X以上的版本。安装好Python以后可以直接通过以下命令安装requests库。pipinstallrequestsPs:可以切换到国内的pip源,例如阿里、豆瓣,速度快为了演示功能,我这里使用nginx模拟了一个简单网站。下载好了以后,直接运行根目录下的nginx.exe程序就可

Python如何使用Requests请求网页Apr 25, 2023 am 09:29 AM

Python如何使用Requests请求网页Apr 25, 2023 am 09:29 AMRequests继承了urllib2的所有特性。Requests支持HTTP连接保持和连接池,支持使用cookie保持会话,支持文件上传,支持自动确定响应内容的编码,支持国际化的URL和POST数据自动编码。安装方式利用pip安装$pipinstallrequestsGET请求基本GET请求(headers参数和parmas参数)1.最基本的GET请求可以直接用get方法'response=requests.get("http://www.baidu.com/"

python requests post如何使用Apr 29, 2023 pm 04:52 PM

python requests post如何使用Apr 29, 2023 pm 04:52 PMpython模拟浏览器发送post请求importrequests格式request.postrequest.post(url,data,json,kwargs)#post请求格式request.get(url,params,kwargs)#对比get请求发送post请求传参分为表单(x-www-form-urlencoded)json(application/json)data参数支持字典格式和字符串格式,字典格式用json.dumps()方法把data转换为合法的json格式字符串次方法需要

使用Python的Requests和BeautifulSoup下载PDF文件Aug 30, 2023 pm 03:25 PM

使用Python的Requests和BeautifulSoup下载PDF文件Aug 30, 2023 pm 03:25 PMRequest和BeautifulSoup是可以在线下载任何文件或PDF的Python库。请求库用于发送HTTP请求和接收响应。BeautifulSoup库用于解析响应中收到的HTML并获取可下载的pdf链接。在本文中,我们将了解如何在Python中使用Request和BeautifulSoup下载PDF。安装依赖项在Python中使用BeautifulSoup和Request库之前,我们需要使用pip命令在系统中安装这些库。要安装request以及BeautifulSoup和Request库,

Python中使用Requests模块Sep 02, 2023 am 10:21 AM

Python中使用Requests模块Sep 02, 2023 am 10:21 AMRequests是一个Python模块,可用于发送各种HTTP请求。它是一个易于使用的库,具有许多功能,从在URL中传递参数到发送自定义标头和SSL验证。在本教程中,您将学习如何使用该库在Python中发送简单的HTTP请求。您可以在Python版本2.6–2.7和3.3–3.6中使用请求。在继续之前,您应该知道Requests是一个外部模块,因此在尝试本教程中的示例之前必须先安装它。您可以通过在终端中运行以下命令来安装它:pipinstallrequests安装模块后,您可以使用以下命令导入模

Python之requests怎么安装使用May 18, 2023 pm 07:49 PM

Python之requests怎么安装使用May 18, 2023 pm 07:49 PM1.准备工作首先呢,我们要确保我们已经之前安装requests库,如果没有安装,按照下面步骤按照库。pip安装无论是Windows、Linux还是Mac,都可以通过pip这个包管理工具来安装。在命令行下运行如下命令即可完成requests库的安装:pip3installrequests这是最简单的安装方式,推荐此种方法安装。验证安装为了验证库是否已经安装成功,可以在命令行下测试一下:importrequestsres=requests.get('https://www.baidu

Python爬虫之怎么使用BeautifulSoup和Requests抓取网页数据Apr 29, 2023 pm 12:52 PM

Python爬虫之怎么使用BeautifulSoup和Requests抓取网页数据Apr 29, 2023 pm 12:52 PM一、简介网络爬虫的实现原理可以归纳为以下几个步骤:发送HTTP请求:网络爬虫通过向目标网站发送HTTP请求(通常为GET请求)获取网页内容。在Python中,可以使用requests库发送HTTP请求。解析HTML:收到目标网站的响应后,爬虫需要解析HTML内容以提取有用信息。HTML是一种用于描述网页结构的标记语言,它由一系列嵌套的标签组成。爬虫可以根据这些标签和属性定位和提取需要的数据。在Python中,可以使用BeautifulSoup、lxml等库解析HTML。数据提取:解析HTML后,

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

맨티스BT

Mantis는 제품 결함 추적을 돕기 위해 설계된 배포하기 쉬운 웹 기반 결함 추적 도구입니다. PHP, MySQL 및 웹 서버가 필요합니다. 데모 및 호스팅 서비스를 확인해 보세요.

드림위버 CS6

시각적 웹 개발 도구

안전한 시험 브라우저

안전한 시험 브라우저는 온라인 시험을 안전하게 치르기 위한 보안 브라우저 환경입니다. 이 소프트웨어는 모든 컴퓨터를 안전한 워크스테이션으로 바꿔줍니다. 이는 모든 유틸리티에 대한 액세스를 제어하고 학생들이 승인되지 않은 리소스를 사용하는 것을 방지합니다.

PhpStorm 맥 버전

최신(2018.2.1) 전문 PHP 통합 개발 도구