이 기사는 Python에서 신경망 모델을 만드는 방법에 대한 간략한 이해를 제공합니다. 이는 특정 참조 가치가 있으므로 도움이 될 수 있습니다.

요약: 신경망이 어떻게 작동하는지 궁금하신가요? 신경망의 작동 방식을 이해하는 가장 좋은 방법은 간단한 신경망을 직접 만들어 보는 것입니다.

ANN(인공 신경망)이라고도 알려진 신경망(NN)은 기계 학습 분야의 학습 알고리즘의 하위 집합으로, 생물학적 신경망의 개념을 느슨하게 차용한 것입니다. 현재 신경망은 컴퓨터 비전, 자연어 처리 등의 분야에서 널리 사용되고 있습니다. 독일의 수석 기계 학습 전문가인 Andrey Bulezyuk은 "신경망은 사람의 개입 없이 다양한 분야와 산업에서 복잡한 추상화를 효과적으로 시뮬레이션할 수 있기 때문에 기계 학습에 혁명을 일으키고 있습니다."라고 말했습니다.

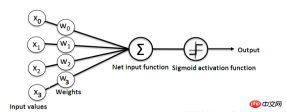

일반적으로 인공 신경망은 기본적으로 다음 구성 요소를 포함합니다. :

데이터를 수신하고 데이터를 전송하는 입력 레이어

숨겨진 레이어;

레이어와 레이어 사이의 가중치는 일반적으로 경사 분산이 발생하기 쉽기 때문에 첫 번째 선택입니다.

또한 인공 신경망에는 피드포워드 신경망, 컨볼루션 신경망, 순환 신경망 등 여러 가지 유형의 신경망이 있습니다. 이 기사에서는 간단한 피드포워드 또는 지각 신경망을 예로 들어 설명합니다. 이러한 유형의 인공 신경망은 데이터를 앞에서 뒤로 직접 전송하는데, 이를 순방향 전파 프로세스라고 합니다. -

피드포워드 뉴런을 훈련하려면 일반적으로 네트워크에 해당 입력 및 출력 세트를 제공해야 하는 역전파 알고리즘이 필요합니다. 입력 데이터가 뉴런으로 전송되면 그에 따라 처리되고 결과 출력이 다음 레이어로 전송됩니다.

다음 그림은 신경망 구조를 간단히 보여줍니다.

또한 신경망의 작동 방식을 이해하는 가장 좋은 방법은 도구 상자를 사용하지 않고 처음부터 신경망을 구축하는 방법을 배우는 것입니다. 이 기사에서는 Python을 사용하여 간단한 신경망을 만드는 방법을 보여줍니다.

문제

아래 표는 우리가 해결할 문제를 보여줍니다.

표에서 볼 수 있듯이 출력 값은 항상 입력 섹션의 첫 번째 값과 같습니다. 따라서 새로운 상황의 출력(?) 값은 1이 될 것으로 예상할 수 있다.  몇 가지 Python 코드를 사용하여 동일한 결과를 얻을 수 있는지 살펴보겠습니다.

몇 가지 Python 코드를 사용하여 동일한 결과를 얻을 수 있는지 살펴보겠습니다.

신경망 클래스 만들기|NeuralNetwork 클래스

우리는 Python에서 NeuralNetwork 클래스를 만들어 뉴런을 훈련시켜 정확한 예측을 제공할 것입니다. 이 클래스에는 다른 도우미 함수도 포함되어 있습니다. 이 간단한 신경망 예제를 생성하기 위해 신경망 라이브러리를 사용하지 않고 계산을 돕기 위해 기본 Numpy 라이브러리를 가져올 것입니다.

Numpy 라이브러리는 데이터 처리를 위한 기본 라이브러리입니다.

EXP - 자연 지수를 생성하는 데 사용됩니다.

배열 - 행렬을 생성하는 데 사용됩니다. - 행렬 곱셈에 사용됩니다.

random - 난수를 생성하는 데 사용됩니다.

Sigmoid 함수 적용

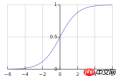

"S" 모양의 곡선을 그리는 Sigmoid 함수를 활성화 함수로 사용합니다. 이 글에서 만든 신경망의 모습입니다. - 이 함수는 0과 1 사이의 값을 매핑할 수 있으며 입력의 가중 합계를 정규화하는 데 도움이 됩니다.

- 이후에는 가중치에 대한 기본 조정을 계산하는 데 도움이 되는 시그모이드 함수의 파생 함수를 만듭니다. 시그모이드 함수의 출력을 사용하여 도함수를 생성할 수 있습니다. 예를 들어, 출력 변수가 "x"인 경우 해당 도함수는 x *(1-x)가 됩니다.

다음은 이 기사에서 구성한 신경망 예제 문제의 훈련 과정입니다.

2. 역전파의 오류율을 계산합니다. 이 경우에는 뉴런의 예측 출력과 훈련 데이터 세트의 예상 출력 간의 오류입니다.

3 얻은 오류 범위를 기반으로 오류 가중 파생 공식을 사용하여 약간의 가중치를 조정합니다.

4. 이 프로세스를 15,000회 반복하고 각 반복 중에 전체 훈련 세트가 동시에 처리됩니다.

여기에서는 ".T" 함수를 사용하여 행렬을 편향합니다. 따라서 숫자는 다음과 같은 방식으로 저장됩니다.

궁극적으로 뉴런의 가중치는 제공된 훈련 데이터에 맞게 최적화됩니다. 따라서 신경망의 출력이 예상 출력과 일치하면 훈련이 완료되어 정확한 예측을 할 수 있다는 의미입니다.

Encapsulation

마지막으로 NeuralNetwork 클래스를 초기화하고 전체 프로그램을 실행한 후 Python 프로젝트에서 신경망을 생성하는 방법에 대한 전체 코드는 다음과 같습니다.

import numpy as np

class NeuralNetwork():

def __init__(self):

# 设置随机数种子

np.random.seed(1)

# 将权重转化为一个3x1的矩阵,其值分布为-1~1,并且均值为0

self.synaptic_weights = 2 * np.random.random((3, 1)) - 1

def sigmoid(self, x):

# 应用sigmoid激活函数

return 1 / (1 + np.exp(-x))

def sigmoid_derivative(self, x):

#计算Sigmoid函数的偏导数

return x * (1 - x)

def train(self, training_inputs, training_outputs, training_iterations):

# 训练模型

for iteration in range(training_iterations):

# 得到输出

output = self.think(training_inputs)

# 计算误差

error = training_outputs - output

# 微调权重

adjustments = np.dot(training_inputs.T, error * self.sigmoid_derivative(output))

self.synaptic_weights += adjustments

def think(self, inputs):

# 输入通过网络得到输出

# 转化为浮点型数据类型

inputs = inputs.astype(float)

output = self.sigmoid(np.dot(inputs, self.synaptic_weights))

return output

if __name__ == "__main__":

# 初始化神经类

neural_network = NeuralNetwork()

print("Beginning Randomly Generated Weights: ")

print(neural_network.synaptic_weights)

#训练数据

training_inputs = np.array([[0,0,1],

[1,1,1],

[1,0,1],

[0,1,1]])

training_outputs = np.array([[0,1,1,0]]).T

# 开始训练

neural_network.train(training_inputs, training_outputs, 15000)

print("Ending Weights After Training: ")

print(neural_network.synaptic_weights)

user_input_one = str(input("User Input One: "))

user_input_two = str(input("User Input Two: "))

user_input_three = str(input("User Input Three: "))

print("Considering New Situation: ", user_input_one, user_input_two, user_input_three)

print("New Output data: ")

print(neural_network.think(np.array([user_input_one, user_input_two, user_input_three])))

print("Wow, we did it!")

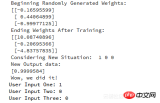

코드 실행 후 생성된 출력은 다음과 같습니다.

위 내용은 우리가 가지고 있는 간단한 신경망을 만들어 보도록 하겠습니다. 먼저 신경망은 자신에게 임의의 가중치를 할당하기 시작한 다음 훈련 예제를 사용하여 스스로 훈련합니다.

따라서 새로운 샘플 입력 [1,0,0]이 발생하면 출력 값은 0.9999584입니다. 예상 정답은 1이다. 시그모이드 함수가 비선형 함수라는 점을 고려하면 이 둘은 매우 가깝다고 볼 수 있다.

또한 이 기사에서는 간단한 작업을 수행하기 위해 신경망의 한 계층만 사용합니다. 수천 개의 인공 신경망을 하나로 합치면 어떻게 될까요? 인간의 사고방식을 100% 모방할 수 있나요? 대답은 '예'입니다. 하지만 현재는 구현하기가 매우 어렵습니다. 이에 관심 있는 독자들은 딥러닝 관련 자료를 읽어보시면 됩니다.

위 내용은 Python에서 신경망 모델을 만드는 내용을 간략하게 이해해 보겠습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

GNN的基础、前沿和应用Apr 11, 2023 pm 11:40 PM

GNN的基础、前沿和应用Apr 11, 2023 pm 11:40 PM近年来,图神经网络(GNN)取得了快速、令人难以置信的进展。图神经网络又称为图深度学习、图表征学习(图表示学习)或几何深度学习,是机器学习特别是深度学习领域增长最快的研究课题。本次分享的题目为《GNN的基础、前沿和应用》,主要介绍由吴凌飞、崔鹏、裴健、赵亮几位学者牵头编撰的综合性书籍《图神经网络基础、前沿与应用》中的大致内容。一、图神经网络的介绍1、为什么要研究图?图是一种描述和建模复杂系统的通用语言。图本身并不复杂,它主要由边和结点构成。我们可以用结点表示任何我们想要建模的物体,可以用边表示两

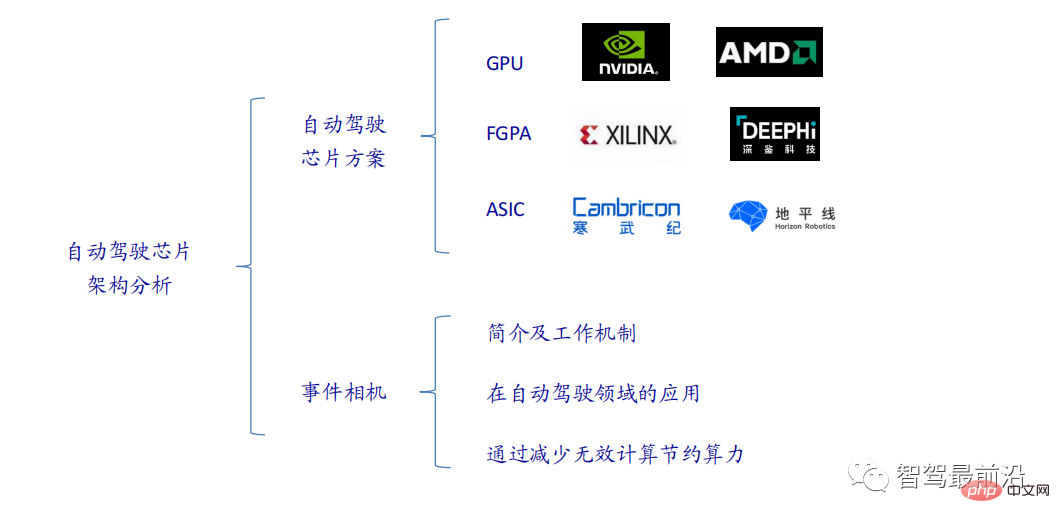

一文通览自动驾驶三大主流芯片架构Apr 12, 2023 pm 12:07 PM

一文通览自动驾驶三大主流芯片架构Apr 12, 2023 pm 12:07 PM当前主流的AI芯片主要分为三类,GPU、FPGA、ASIC。GPU、FPGA均是前期较为成熟的芯片架构,属于通用型芯片。ASIC属于为AI特定场景定制的芯片。行业内已经确认CPU不适用于AI计算,但是在AI应用领域也是必不可少。 GPU方案GPU与CPU的架构对比CPU遵循的是冯·诺依曼架构,其核心是存储程序/数据、串行顺序执行。因此CPU的架构中需要大量的空间去放置存储单元(Cache)和控制单元(Control),相比之下计算单元(ALU)只占据了很小的一部分,所以CPU在进行大规模并行计算

扛住强风的无人机?加州理工用12分钟飞行数据教会无人机御风飞行Apr 09, 2023 pm 11:51 PM

扛住强风的无人机?加州理工用12分钟飞行数据教会无人机御风飞行Apr 09, 2023 pm 11:51 PM当风大到可以把伞吹坏的程度,无人机却稳稳当当,就像这样:御风飞行是空中飞行的一部分,从大的层面来讲,当飞行员驾驶飞机着陆时,风速可能会给他们带来挑战;从小的层面来讲,阵风也会影响无人机的飞行。目前来看,无人机要么在受控条件下飞行,无风;要么由人类使用遥控器操作。无人机被研究者控制在开阔的天空中编队飞行,但这些飞行通常是在理想的条件和环境下进行的。然而,要想让无人机自主执行必要但日常的任务,例如运送包裹,无人机必须能够实时适应风况。为了让无人机在风中飞行时具有更好的机动性,来自加州理工学院的一组工

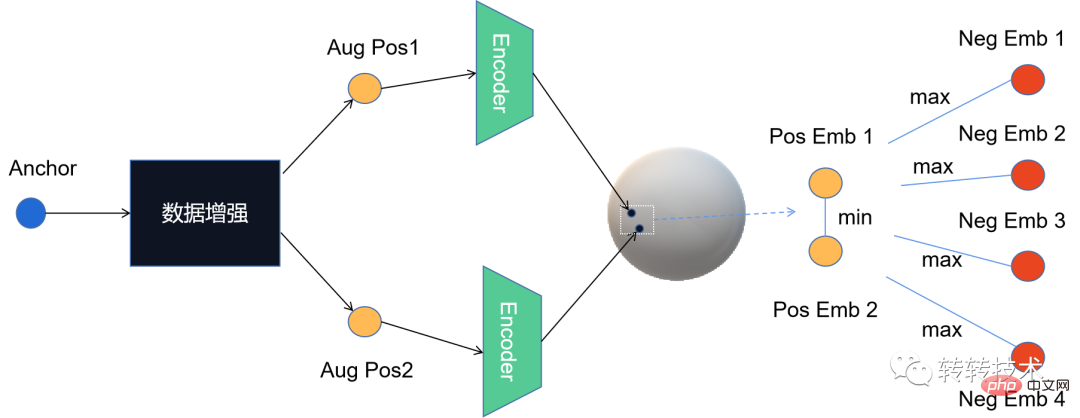

对比学习算法在转转的实践Apr 11, 2023 pm 09:25 PM

对比学习算法在转转的实践Apr 11, 2023 pm 09:25 PM1 什么是对比学习1.1 对比学习的定义1.2 对比学习的原理1.3 经典对比学习算法系列2 对比学习的应用3 对比学习在转转的实践3.1 CL在推荐召回的实践3.2 CL在转转的未来规划1 什么是对比学习1.1 对比学习的定义对比学习(Contrastive Learning, CL)是近年来 AI 领域的热门研究方向,吸引了众多研究学者的关注,其所属的自监督学习方式,更是在 ICLR 2020 被 Bengio 和 LeCun 等大佬点名称为 AI 的未来,后陆续登陆 NIPS, ACL,

python random库如何使用demoMay 05, 2023 pm 08:13 PM

python random库如何使用demoMay 05, 2023 pm 08:13 PMpythonrandom库简单使用demo当我们需要生成随机数或者从一个序列中随机选择元素时,可以使用Python内置的random库。下面是一个带有注释的例子,演示了如何使用random库:#导入random库importrandom#生成一个0到1之间的随机小数random_float=random.random()print(random_float)#生成一个指定范围内的随机整数(包括端点)random_int=random.randint(1,10)print(random_int)#

Michael Bronstein从代数拓扑学取经,提出了一种新的图神经网络计算结构!Apr 09, 2023 pm 10:11 PM

Michael Bronstein从代数拓扑学取经,提出了一种新的图神经网络计算结构!Apr 09, 2023 pm 10:11 PM本文由Cristian Bodnar 和Fabrizio Frasca 合著,以 C. Bodnar 、F. Frasca 等人发表于2021 ICML《Weisfeiler and Lehman Go Topological: 信息传递简单网络》和2021 NeurIPS 《Weisfeiler and Lehman Go Cellular: CW 网络》论文为参考。本文仅是通过微分几何学和代数拓扑学的视角讨论图神经网络系列的部分内容。从计算机网络到大型强子对撞机中的粒子相互作用,图可以用来模

Java使用Random类的nextDouble()函数生成随机的双精度浮点数Jul 25, 2023 am 09:06 AM

Java使用Random类的nextDouble()函数生成随机的双精度浮点数Jul 25, 2023 am 09:06 AMJava使用Random类的nextDouble()函数生成随机的双精度浮点数Java中的Random类是一个伪随机数生成器,可以用来生成不同类型的随机数。其中,nextDouble()函数用于生成一个随机的双精度浮点数。在使用Random类之前,我们需要先导入java.util包。接下来我们可以创建一个Random对象,然后使用nextDouble()函数

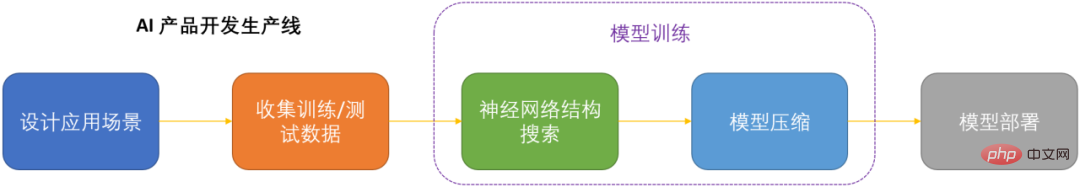

微软提出自动化神经网络训练剪枝框架OTO,一站式获得高性能轻量化模型Apr 04, 2023 pm 12:50 PM

微软提出自动化神经网络训练剪枝框架OTO,一站式获得高性能轻量化模型Apr 04, 2023 pm 12:50 PMOTO 是业内首个自动化、一站式、用户友好且通用的神经网络训练与结构压缩框架。 在人工智能时代,如何部署和维护神经网络是产品化的关键问题考虑到节省运算成本,同时尽可能小地损失模型性能,压缩神经网络成为了 DNN 产品化的关键之一。DNN 压缩通常来说有三种方式,剪枝,知识蒸馏和量化。剪枝旨在识别并去除冗余结构,给 DNN 瘦身的同时尽可能地保持模型性能,是最为通用且有效的压缩方法。三种方法通常来讲可以相辅相成,共同作用来达到最佳的压缩效果。然而现存的剪枝方法大都只针对特定模型,特定任务,且需要很

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

DVWA

DVWA(Damn Vulnerable Web App)는 매우 취약한 PHP/MySQL 웹 애플리케이션입니다. 주요 목표는 보안 전문가가 법적 환경에서 자신의 기술과 도구를 테스트하고, 웹 개발자가 웹 응용 프로그램 보안 프로세스를 더 잘 이해할 수 있도록 돕고, 교사/학생이 교실 환경 웹 응용 프로그램에서 가르치고 배울 수 있도록 돕는 것입니다. 보안. DVWA의 목표는 다양한 난이도의 간단하고 간단한 인터페이스를 통해 가장 일반적인 웹 취약점 중 일부를 연습하는 것입니다. 이 소프트웨어는

SecList

SecLists는 최고의 보안 테스터의 동반자입니다. 보안 평가 시 자주 사용되는 다양한 유형의 목록을 한 곳에 모아 놓은 것입니다. SecLists는 보안 테스터에게 필요할 수 있는 모든 목록을 편리하게 제공하여 보안 테스트를 더욱 효율적이고 생산적으로 만드는 데 도움이 됩니다. 목록 유형에는 사용자 이름, 비밀번호, URL, 퍼징 페이로드, 민감한 데이터 패턴, 웹 셸 등이 포함됩니다. 테스터는 이 저장소를 새로운 테스트 시스템으로 간단히 가져올 수 있으며 필요한 모든 유형의 목록에 액세스할 수 있습니다.

Atom Editor Mac 버전 다운로드

가장 인기 있는 오픈 소스 편집기

ZendStudio 13.5.1 맥

강력한 PHP 통합 개발 환경