*이 기사는 *** 데이터 과학 블로그 톤의 일부입니다

목차

추론 기반 LLMS 기능은 어떻게 작동합니까?

exaone 3.5 모델 아키텍처

Exaone 3.5 의 건축 혁신

직접 환경 설정 최적화 이해 (dpo)

데이터 오염 제거 프로세스

성능 벤치 마크

Ollama를 통해 Google Colab에서 Exaone 3.5 (70 억 매개 변수 모델) 실행

다양한 프롬프트를 사용한 모델 테스트

실제 응용 프로그램 예

결론

자주 묻는 질문

추론 기반 LLMS 기능은 어떻게 작동합니까?

Exaone 3.5와 같은 추론 기반 LLM은 논리적 추론, 문제 해결 및 패턴 인식이 필요한 복잡한 작업에서 탁월합니다. 고급 변압기 기반 네트워크를 기반으로 한 순차 데이터와 광범위한 컨텍스트를 효율적으로 처리합니다. 대규모 데이터 세트에 대해 교육을받은 정보 내에서의 관계를 식별하고, 정확한 응답 생성, 문제 해결 및 정확하게 지침을 따릅니다.

SFT (Supervised Fine Tuning) 및 DPO (Direct Preverence Optimization)와 같은 기술은 단순한 응용 프로그램에서 복잡한 의사 결정에 이르기까지 다양한 응용 분야에서 인간과 같은 추론 능력을 개선합니다.

exaone 3.5 모델 아키텍처

exaone 3.5는 순차 데이터 처리 효율로 알려진 현대 LLM 설계의 표준 인 디코더 전용 변압기 아키텍처를 사용합니다. 이 아키텍처는 명령을 따르는 데 최적화되어 사용자 명령의 효과적인 이해와 실행을 보장합니다. 세 가지 변형 (2.4b, 7.8b 및 32b 매개 변수)의 주요 사양은 다음과 같습니다.

최대 컨텍스트 길이

: 32,768 토큰

레이어 : 32

피드 포워드 치수 : 14,336 -

Exaone 3.5 의 건축 혁신

exaone 3.5는 상당한 아키텍처 개선을 통합하여 확장 컨텍스트 처리를 향상시키고 정확한 사용자 정렬 출력을 보장합니다. 이러한 혁신은 LLM의 효율성과 성능 표준을 재정의합니다

-

확장 컨텍스트 길이 : 실질적으로 증가 된 최대 컨텍스트 길이 (32,768 토큰)는 일관성을 희생하지 않고 더 큰 텍스트를 효과적으로 처리 할 수 있습니다.

2 단계 훈련 :

exaone 3.5는 2 단계 훈련 과정을 활용합니다. 일반 도메인 훈련과 장기 텍스트 이해를위한 작업 별 미세 조정이 이어집니다. 사전 훈련은 중복 및 개인 식별 정보를 제거하고 성능을 높이고 인프라 비용을 줄입니다. 훈련 후, SFT 및 DPO는 명령어를 따르는 및 사용자 기본 설정 정렬을 향상시킵니다.

- 오염 제거 프로세스 : 엄격한 탈출 프로세스는 교육 세트에서 편향된 데이터를 제거하여 편견없는 평가를 보장합니다. 여기에는 평가 데이터 세트와의 교육 데이터를 반복적으로 비교합니다.

직접 환경 설정 최적화 이해 (dpo)

DPO는 LLM을 인간 선호도와 직접 정렬하여 전통적인 강화 학습의 복잡성을 우회하여 LLM을 미세 조정하기위한 새로운 알고리즘입니다. 복잡한 보상 모델링이 필요한 RLHF와 달리 DPO는 사용자 기본 설정에 따라 모델 응답을 최적화하기 위해 간단한 분류 손실을 사용하여 프로세스를 단순화합니다. 이로 인해 안정적이고 효율적이며 계산적으로 가벼운 교육이 발생합니다. DPO는 트리플렛이 포함 된 기본 설정 데이터 세트 (프롬프트, 선택한 답변, 거부 된 답변)가 필요합니다.

데이터 오염 제거 프로세스

데이터 오염 제거는 훈련 데이터 세트에서 오염 된 예를 제거하여 모델 일반화를 개선하는 데 중요한 프로세스입니다. 웹 크롤링 데이터에는 종종 테스트 세트 예제가 포함되어 있으며 편향된 평가로 이어집니다. EXAONE 3.5는 기판 레벨 매칭 방법을 사용하여 이러한 오염 된 샘플을 식별하고 제거합니다.

이러한 아키텍처 개선 사항은 벤치 마크에서 강력한 성능을 유지하면서 실제 응용 프로그램에서 Exaone 3.5가 탁월 할 수 있습니다. 성능 벤치 마크

exaone 3.5 모델 평가는 세 그룹으로 분류됩니다

실제 사용 사례 :

실제 사용자 쿼리를 이해하고 응답하는 모델의 능력을 평가합니다.

장기 텍스트 처리 :

확장 된 텍스트에서 정보를 처리하고 추출 할 수있는 모델의 기능을 평가합니다.

일반 도메인 작업 : 수학, 코딩 및 지식 기반 작업의 숙련도를 테스트합니다.

-

결과는 세 가지 범주 모두에서 Exaone 3.5의 강력한 성능을 보여줍니다.

Ollama를 통해 Google Colab에서 Exaone 3.5 (70 억 매개 변수 모델) 실행

이 섹션에서는 Ollama를 사용하여 Google Colab에서 7b 매개 변수 Exaone 3.5 모델을 설정하고 쿼리합니다.

- (1-4 단계 : 설치, Ollama 설정, 모델 다운로드 및 쿼리를위한 코드 예제는 원본 텍스트에 제공되며 여기에서 변경되지 않았습니다.)

다양한 프롬프트를 사용한 모델 테스트

( "Haystack의 바늘"및 "조상 추적"작업을 포함하여 다양한 프롬프트로 모델을 테스트하는 예는 원본 텍스트에 제공되며 여기에 변경되지 않은 상태로 유지됩니다.)

실제 응용 프로그램 예

(고객 지원, 교육 지원 및 논리적 추론 작업을 포함한 실제 응용 프로그램의 예는 원본 텍스트에 제공되며 여기에서 변경되지 않은 상태로 유지됩니다.)

- 결론

exaone 3.5는 LLM 기술의 상당한 도약을 나타내며 다양한 응용 프로그램을위한 세 가지 확장 가능한 모델 크기를 제공합니다. 고급 아키텍처, 강력한 교육 추종 및 다국어 기능은 연구원과 비즈니스 모두에게 귀중한 도구가됩니다. 윤리적 AI 개발 관행과 함께 벤치 마크에서 강력한 성과는 LLM으로서의 위치를 강화합니다.

(주요 테이크 아웃 및 자주 묻는 질문 섹션은 원본 텍스트에서 변경되지 않은 상태로 유지됩니다.)

참고 : 이미지 URL은 변경되지 않았습니다

최대 컨텍스트 길이

: 32,768 토큰 레이어 : 32 피드 포워드 치수- : 14,336

- Exaone 3.5 의 건축 혁신 exaone 3.5는 상당한 아키텍처 개선을 통합하여 확장 컨텍스트 처리를 향상시키고 정확한 사용자 정렬 출력을 보장합니다. 이러한 혁신은 LLM의 효율성과 성능 표준을 재정의합니다

- 확장 컨텍스트 길이 : 실질적으로 증가 된 최대 컨텍스트 길이 (32,768 토큰)는 일관성을 희생하지 않고 더 큰 텍스트를 효과적으로 처리 할 수 있습니다. 2 단계 훈련 : exaone 3.5는 2 단계 훈련 과정을 활용합니다. 일반 도메인 훈련과 장기 텍스트 이해를위한 작업 별 미세 조정이 이어집니다. 사전 훈련은 중복 및 개인 식별 정보를 제거하고 성능을 높이고 인프라 비용을 줄입니다. 훈련 후, SFT 및 DPO는 명령어를 따르는 및 사용자 기본 설정 정렬을 향상시킵니다.

- 오염 제거 프로세스 : 엄격한 탈출 프로세스는 교육 세트에서 편향된 데이터를 제거하여 편견없는 평가를 보장합니다. 여기에는 평가 데이터 세트와의 교육 데이터를 반복적으로 비교합니다.

직접 환경 설정 최적화 이해 (dpo) DPO는 LLM을 인간 선호도와 직접 정렬하여 전통적인 강화 학습의 복잡성을 우회하여 LLM을 미세 조정하기위한 새로운 알고리즘입니다. 복잡한 보상 모델링이 필요한 RLHF와 달리 DPO는 사용자 기본 설정에 따라 모델 응답을 최적화하기 위해 간단한 분류 손실을 사용하여 프로세스를 단순화합니다. 이로 인해 안정적이고 효율적이며 계산적으로 가벼운 교육이 발생합니다. DPO는 트리플렛이 포함 된 기본 설정 데이터 세트 (프롬프트, 선택한 답변, 거부 된 답변)가 필요합니다. 데이터 오염 제거 프로세스 데이터 오염 제거는 훈련 데이터 세트에서 오염 된 예를 제거하여 모델 일반화를 개선하는 데 중요한 프로세스입니다. 웹 크롤링 데이터에는 종종 테스트 세트 예제가 포함되어 있으며 편향된 평가로 이어집니다. EXAONE 3.5는 기판 레벨 매칭 방법을 사용하여 이러한 오염 된 샘플을 식별하고 제거합니다. 이러한 아키텍처 개선 사항은 벤치 마크에서 강력한 성능을 유지하면서 실제 응용 프로그램에서 Exaone 3.5가 탁월 할 수 있습니다. 성능 벤치 마크 exaone 3.5 모델 평가는 세 그룹으로 분류됩니다실제 사용 사례 :

실제 사용자 쿼리를 이해하고 응답하는 모델의 능력을 평가합니다.장기 텍스트 처리 :

확장 된 텍스트에서 정보를 처리하고 추출 할 수있는 모델의 기능을 평가합니다. 일반 도메인 작업 :- 수학, 코딩 및 지식 기반 작업의 숙련도를 테스트합니다.

- (1-4 단계 : 설치, Ollama 설정, 모델 다운로드 및 쿼리를위한 코드 예제는 원본 텍스트에 제공되며 여기에서 변경되지 않았습니다.)

다양한 프롬프트를 사용한 모델 테스트 ( "Haystack의 바늘"및 "조상 추적"작업을 포함하여 다양한 프롬프트로 모델을 테스트하는 예는 원본 텍스트에 제공되며 여기에 변경되지 않은 상태로 유지됩니다.) 실제 응용 프로그램 예 (고객 지원, 교육 지원 및 논리적 추론 작업을 포함한 실제 응용 프로그램의 예는 원본 텍스트에 제공되며 여기에서 변경되지 않은 상태로 유지됩니다.)

- 결론 exaone 3.5는 LLM 기술의 상당한 도약을 나타내며 다양한 응용 프로그램을위한 세 가지 확장 가능한 모델 크기를 제공합니다. 고급 아키텍처, 강력한 교육 추종 및 다국어 기능은 연구원과 비즈니스 모두에게 귀중한 도구가됩니다. 윤리적 AI 개발 관행과 함께 벤치 마크에서 강력한 성과는 LLM으로서의 위치를 강화합니다. (주요 테이크 아웃 및 자주 묻는 질문 섹션은 원본 텍스트에서 변경되지 않은 상태로 유지됩니다.) 참고 : 이미지 URL은 변경되지 않았습니다

결과는 세 가지 범주 모두에서 Exaone 3.5의 강력한 성능을 보여줍니다. Ollama를 통해 Google Colab에서 Exaone 3.5 (70 억 매개 변수 모델) 실행 이 섹션에서는 Ollama를 사용하여 Google Colab에서 7b 매개 변수 Exaone 3.5 모델을 설정하고 쿼리합니다.

위 내용은 이중 언어 강국 Exaone 3.5는 새로운 AI 표준을 설정합니다의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

Tesla의 Robovan은 2024 년 Robotaxi 티저의 숨겨진 보석이었습니다.Apr 22, 2025 am 11:48 AM

Tesla의 Robovan은 2024 년 Robotaxi 티저의 숨겨진 보석이었습니다.Apr 22, 2025 am 11:48 AM2008 년 이래로 저는 도시 교통의 미래로서 "Robotjitney"라고 불리는 공유 라이드 밴을 옹호했습니다. 나는이 차량들을 21 세기의 차세대 대중 교통 솔루션 인 Surpas로 예측합니다.

Sam 's Club은 영수증 수표를 제거하고 소매를 강화하기 위해 AI에 베팅합니다.Apr 22, 2025 am 11:29 AM

Sam 's Club은 영수증 수표를 제거하고 소매를 강화하기 위해 AI에 베팅합니다.Apr 22, 2025 am 11:29 AM체크 아웃 경험 혁명 Sam 's Club의 혁신적인 "Just Go"시스템은 기존 AI 기반 AI 기반 "Scan & Go"기술을 기반으로하여 회원이 쇼핑 중에 Sam's Club 앱을 통해 구매를 스캔 할 수 있습니다.

Nvidia의 AI Omniverse는 GTC 2025에서 확장됩니다Apr 22, 2025 am 11:28 AM

Nvidia의 AI Omniverse는 GTC 2025에서 확장됩니다Apr 22, 2025 am 11:28 AMGTC 2025에서 Nvidia의 향상된 예측 가능성 및 신제품 라인업 AI 인프라의 핵심 업체 인 Nvidia는 고객의 예측 가능성 증가에 중점을두고 있습니다. 여기에는 일관된 제품 제공, 성과 기대치 충족 및 충족이 포함됩니다

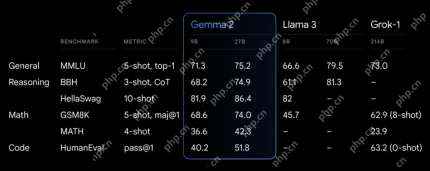

Google의 Gemma 2 모델의 기능을 탐색합니다Apr 22, 2025 am 11:26 AM

Google의 Gemma 2 모델의 기능을 탐색합니다Apr 22, 2025 am 11:26 AMGoogle의 Gemma 2 : 강력하고 효율적인 언어 모델 효율성과 성능으로 축하되는 Google의 Gemma Family of Language 모델은 Gemma 2의 도착으로 확장되었습니다.이 최신 릴리스는 두 가지 모델로 구성됩니다 : 27 억 매개 변수 Ver Ver

Genai의 다음 물결 : Kirk Borne 박사와의 관점 -Salystics VidhyaApr 22, 2025 am 11:21 AM

Genai의 다음 물결 : Kirk Borne 박사와의 관점 -Salystics VidhyaApr 22, 2025 am 11:21 AM이 데이터 에피소드와 함께이 선도에는 주요 데이터 과학자, 천체 물리학 자, TEDX 스피커 인 Kirk Borne 박사가 있습니다. Borne 박사는 빅 데이터, AI 및 머신 러닝 분야의 유명한 전문가 인 현재 상태와 미래의 Traje에 대한 귀중한 통찰력을 제공합니다.

주자와 운동 선수를위한 AI : 우리는 훌륭한 진전을 이루고 있습니다Apr 22, 2025 am 11:12 AM

주자와 운동 선수를위한 AI : 우리는 훌륭한 진전을 이루고 있습니다Apr 22, 2025 am 11:12 AM이 연설에는 인공 지능이 사람들의 신체 운동을 지원하는 데 왜 좋은지를 보여주는 공학에 대한 백 그라운드 정보가 매우 통찰력있는 관점이있었습니다. 스포츠에서 인공 지능 적용을 탐구하는 데 중요한 부분 인 세 가지 디자인 측면을 보여주기 위해 각 기고자의 관점에서 핵심 아이디어를 간략하게 설명 할 것입니다. 에지 장치 및 원시 개인 데이터 인공 지능에 대한이 아이디어에는 실제로 두 가지 구성 요소가 포함되어 있습니다. 하나는 우리가 큰 언어 모델을 배치하는 위치와 관련하여 하나의 구성 요소와 다른 하나는 인간 언어와 활력 징후가 실시간으로 측정 될 때“표현”하는 언어의 차이와 관련이 있습니다. Alexander Amini는 달리기와 테니스에 대해 많은 것을 알고 있지만 그는 여전히

Caterpillar의 기술, 인재 및 혁신에 관한 Jamie EngstromApr 22, 2025 am 11:10 AM

Caterpillar의 기술, 인재 및 혁신에 관한 Jamie EngstromApr 22, 2025 am 11:10 AMCaterpillar의 최고 정보 책임자이자 IT의 수석 부사장 인 Jamie Engstrom은 28 개국에서 2,200 명 이상의 IT 전문가로 구성된 글로벌 팀을 이끌고 있습니다. 현재 역할에서 4 년 반을 포함하여 Caterpillar에서 26 년 동안 Engst

새로운 Google 사진 업데이트는 Ultra HDR 품질로 모든 사진 팝을 만듭니다.Apr 22, 2025 am 11:09 AM

새로운 Google 사진 업데이트는 Ultra HDR 품질로 모든 사진 팝을 만듭니다.Apr 22, 2025 am 11:09 AMGoogle Photos의 새로운 Ultra HDR 도구 : 빠른 가이드 Google Photos의 새로운 Ultra HDR 도구로 사진을 향상시켜 표준 이미지를 활기차고 높은 동기 범위의 걸작으로 변환하십시오. 소셜 미디어에 이상적 이며이 도구는 모든 사진의 영향을 높이고

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

PhpStorm 맥 버전

최신(2018.2.1) 전문 PHP 통합 개발 도구

SecList

SecLists는 최고의 보안 테스터의 동반자입니다. 보안 평가 시 자주 사용되는 다양한 유형의 목록을 한 곳에 모아 놓은 것입니다. SecLists는 보안 테스터에게 필요할 수 있는 모든 목록을 편리하게 제공하여 보안 테스트를 더욱 효율적이고 생산적으로 만드는 데 도움이 됩니다. 목록 유형에는 사용자 이름, 비밀번호, URL, 퍼징 페이로드, 민감한 데이터 패턴, 웹 셸 등이 포함됩니다. 테스터는 이 저장소를 새로운 테스트 시스템으로 간단히 가져올 수 있으며 필요한 모든 유형의 목록에 액세스할 수 있습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

Eclipse용 SAP NetWeaver 서버 어댑터

Eclipse를 SAP NetWeaver 애플리케이션 서버와 통합합니다.