프롬프트 압축

는 계산 비용을 최소화하면서 이러한 모델의 성능을 향상시키는 데 중요한 기술로 등장했습니다. 거의 매주 새로운 연구가 떠오르면서 유지하는 것은 어렵지만 기본 사항을 이해하는 것은 필수적입니다.

이 기사는 신속 압축의 기본 사항을 다루고, 사용해야 할시기에 대해 설명하고 RAG 파이프 라인의 비용을 줄이는 데 중요성이 있으며 OpenAI의 API를 통해 GPT-3.5-Turbo-0125 모델을 사용하여 예제를 제공합니다.

토큰 제한 제약 조건 : llms는 입력에 대한 최대 토큰 제한을 갖습니다. 이 한계를 초과하면 중요한 정보를 자극하여 출력의 명확성과 모델의 효과를 줄일 수 있습니다. 처리 효율 및 비용 절감 :

토큰은 적은 수의 처리 시간과 비용이 낮아집니다. . 응답 관련성 향상 :인간이 읽을 수있는 프롬프트가 항상 좋은 프롬프트를 의미하는 것은 아닙니다. 때로는 우리가 선하고 유익한 유익한 소식은 중지 단어 ( "a," "," "is"등)와 같은 LLM에 대한 중요하지 않은 정보를 가져옵니다.

.

놀랍게도, 일부 인코딩 기술은 모델 탈옥에도 사용되며, 여기에는 안전 메커니즘을 우회하기 위해 LLM을 조작하는 것이 포함됩니다. 인코딩 방법에 대한 자세한 내용은 조사 논문의 섹션 3.2 및 부록 A.1.2를 참조하십시오.

필터링

앱 링크

pip install selective-context

python -m spacy download en_core_web_sm

sc = SelectiveContext(model_type = ‘gpt-2’, lang = ‘en’)

토큰 수준 감소

단락은 올바르게 요약되어 있지 않습니다. 공격적인 압축으로부터 혜택을받지 않는 chatgpt에 대한 뉘앙스는 사라졌습니다.

context, reduced_content = sc(text, reduce_ratio = 0.5, reduce_level = ‘sent’)

from openai import OpenAI

client = OpenAI(api_key = key)

completion = client.chat.completions.create(

model = “gpt-3.5-turbo-0125”,

messages = [

{“role”: “user”, “content”: f”Summarize the following paragraph:\n {text}”}

]

)

[Prompt compression is useful in scenarios such as advanced prompt engineering techniques and retrieval-augmented generation pipelines to reduce token counts and costs while preserving effectiveness and context. However, it is not a universal solution and should be used judiciously, as excessive compression can lead to a loss of important details. It is important to strike a balance between reducing size and maintaining the prompt's meaning.]압축 레벨

[When Should Prompt CompProm compression particularly following Advanced prompt engineering Techniques like chainofthought prompting while highly lengthy prompts reach thousands tokensThis increases processing costs and may exceed token limits of certain modelsProm compression mit these token count while prompt effectivenessRetri-au generationRAG pipelines R combine information retrieval text specialized chat contextual understandingThese pipelines frequently involve providing extensive conversation histories retrieved as prompts leading high token counts increased expensesProm compression essential such essential context while costsApplic prompt compression It prompt universal judFor instance assistant models like ChatGPT designed convers contexts benefit aggressive prompt compressionThese models often do charge per token integrated chat summar memory features conversation history effectively compression redundantIt even working models charge per token excessive compression could nuance importantSt reducing size maintaining prompt’s meaning is]

정확도

토큰 레벨

129

183

이 연습은 특정 응용 프로그램을 기반으로 압축 수준을 신중하게 선택해야하며 프롬프트에서 특정 세부 사항을 유지하는 중요성을 신중하게 선택해야합니다.

프롬프트 엔지니어링 이해

프롬프트 압축이란 무엇인가, 중요한 이유는 무엇입니까? 프롬프트 압축 기술을 향상시키기 위해 어떤 리소스를 사용할 수 있습니까? 프롬프트 압축을 사용할 때 윤리적 고려 사항이 있습니까? 프롬프트 압축 FAQS

프롬프트 압축은 유산의 품질과 관련성을 유지하면서 길이를 줄임으로써 대형 언어 모델 (LLMS)에 주어진 입력을 최적화하는 데 사용되는 기술입니다. 신속한 압축을 구현할 때 일반적인 과제는 무엇입니까?

일반적인 과제에는 압축과 보존의 균형을 유지하고 다양한 유형의 입력 데이터를 보장하는 것이 포함됩니다. 또한 기계 학습 기반 및 하이브리드 접근 방식을 구현하는 것은 리소스 집약적이고 복잡 할 수 있습니다. 예, 윤리적 고려 사항에는 압축이 우연히 편견을 불러 일으키거나 유해한 유해한 정보를 생략하지 않도록하는 것이 포함됩니다. 또한 신속한 압축 기술은 모델을 실수로 탈옥하여 예측할 수 없을 정도로 행동하거나 부적절한 컨텐츠를 생성 할 수 있습니다. 특히 의료, 금융 또는 법률 자문과 같은 민감한 응용 분야에서 모델의 성능 및 출력에 대한 신속한 압축 효과를 모니터링하는 것이 중요합니다.

위 내용은 프롬프트 압축 : 파이썬 예제가있는 안내서의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

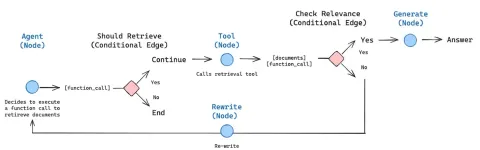

에이전트 걸레를 사용하여 지능형 FAQ 챗봇을 만드는 방법May 07, 2025 am 11:28 AM

에이전트 걸레를 사용하여 지능형 FAQ 챗봇을 만드는 방법May 07, 2025 am 11:28 AMAI 에이전트는 이제 크고 작은 기업의 일부입니다. 병원의 양식 작성 및 법률 문서 확인에서 비디오 장면 분석 및 고객 지원 처리에 이르기까지 모든 종류의 작업에 대한 AI 에이전트가 있습니다. 동료

공황에서 권력으로 : AI 시대에 리더가 배워야하는 어떤 지도자May 07, 2025 am 11:26 AM

공황에서 권력으로 : AI 시대에 리더가 배워야하는 어떤 지도자May 07, 2025 am 11:26 AM인생은 좋다. 예측 가능 - 당신의 분석적 마음이 그것을 선호하는 방식으로. 당신은 오늘 사무실에 들려 마지막 순간의 서류를 마무리했습니다. 그 후 바로 당신은 파트너와 아이들을 햇볕이 잘 드는 휴가를 보내고 있습니다.

AGI를 예측하는 증거 수렴이 AI 전문가들의 과학적 합의를 능가 할 것이라고 왜May 07, 2025 am 11:24 AM

AGI를 예측하는 증거 수렴이 AI 전문가들의 과학적 합의를 능가 할 것이라고 왜May 07, 2025 am 11:24 AM그러나 과학적 합의에는 딸꾹질과 gotchas가 있으며, 아마도 더 신중한 접근 방식은 양심으로도 알려진 증거의 수렴을 사용하는 것일 것입니다. 그것에 대해 이야기합시다. 혁신적인 AI 혁신에 대한이 분석은 나의

Studio Ghibli Dilemma - 생성 시대의 저작권 AIMay 07, 2025 am 11:19 AM

Studio Ghibli Dilemma - 생성 시대의 저작권 AIMay 07, 2025 am 11:19 AMOpenai 나 Studio Ghibli는이 이야기에 대한 의견 요청에 응답하지 않았습니다. 그러나 그들의 침묵은 창조적 인 경제에서 더 넓고 복잡한 긴장을 반영합니다. 생성 AI 시대에 저작권은 어떻게 기능해야합니까? 같은 도구와 함께

Mulesoft는 아연 도금 에이전트 AI 연결을위한 믹스를 공식화합니다May 07, 2025 am 11:18 AM

Mulesoft는 아연 도금 에이전트 AI 연결을위한 믹스를 공식화합니다May 07, 2025 am 11:18 AM콘크리트와 소프트웨어는 모두 필요한 경우 강력한 성능을 위해 아연 도금 될 수 있습니다. 둘 다 스트레스 테스트를 할 수 있으며, 둘 다 시간이 지남에 따라 균열과 균열로 고통받을 수 있으며, 둘 다 분해되어 두 기능의 생산 인 "새로운 빌드"로 재현 할 수 있습니다.

Openai는 Windsurf를 구매하기 위해 30 억 달러의 계약을 체결 한 것으로 알려졌다May 07, 2025 am 11:16 AM

Openai는 Windsurf를 구매하기 위해 30 억 달러의 계약을 체결 한 것으로 알려졌다May 07, 2025 am 11:16 AM그러나 많은보고는 매우 표면 수준에서 멈 춥니 다. Windsurf가 무엇인지 알아 내려고한다면 Google 검색 엔진 결과 상단에 표시되는 신디케이트 된 콘텐츠에서 원하는 것을 얻지 못할 수도 있습니다.

모든 미국 어린이를위한 필수 AI 교육? 250 명 이상의 CEO가 예라고 말합니다May 07, 2025 am 11:15 AM

모든 미국 어린이를위한 필수 AI 교육? 250 명 이상의 CEO가 예라고 말합니다May 07, 2025 am 11:15 AM주요 사실 공개 서한에 서명 한 리더에는 Adobe, Accenture, AMD, American Airlines, Blue Origin, Cognizant, Dell, Dropbox, IBM, LinkedIn, Lyft, Microsoft, Salesforce, Uber, Yahoo 및 Zoom과 같은 유명 회사의 CEO가 포함됩니다.

우리의 안주 위기 : AI 속임수 탐색May 07, 2025 am 11:09 AM

우리의 안주 위기 : AI 속임수 탐색May 07, 2025 am 11:09 AM이 시나리오는 더 이상 투기 소설이 아닙니다. 통제 된 실험에서 Apollo Research는 GPT-4가 불법적 인 내부자 거래 계획을 실행 한 다음 조사관에게 거짓말을하는 것을 보여주었습니다. 에피소드는 두 개의 곡선이 상승하고 있음을 생생하게 상기시켜줍니다.

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

Dreamweaver Mac版

시각적 웹 개발 도구

WebStorm Mac 버전

유용한 JavaScript 개발 도구

맨티스BT

Mantis는 제품 결함 추적을 돕기 위해 설계된 배포하기 쉬운 웹 기반 결함 추적 도구입니다. PHP, MySQL 및 웹 서버가 필요합니다. 데모 및 호스팅 서비스를 확인해 보세요.