배치 정규화 : 이론 및 텐서 플로 구현

- Joseph Gordon-Levitt원래의

- 2025-03-06 11:00:15233검색

활성화의 분포는 훈련, 적응 및 학습을 방해하는 동안 레이어에 걸쳐 변화합니다. 소실/폭발 기울기 :

변환 중에 그라디언트가 너무 작거나 커져 효과적인 체중 업데이트를 방해합니다.초기화 감도 :

- 초기 중량은 훈련에 크게 영향을 미칩니다. 초기화가 잘못되면 수렴이 느려지거나 실패 할 수 있습니다

-

배치 정규화는 각 미니 배치 내에서 활성화를 정상화하고, 훈련을 안정화하고, 모델 성능을 향상시킴으로써 이들을 다룹니다. 배치 정규화는 훈련 중에 미니 배치 내에서 층의 활성화를 정규화합니다. 각 기능에 대한 활성화의 평균과 분산을 계산 한 다음 이러한 통계를 사용하여 정규화합니다. 학습 가능한 파라미터 (γ 및 β) 스케일 및 정규화 된 활성화를 바꾸어 모델이 최적의 활성화 분포를 배울 수 있도록합니다. 출처 : Yintai MA와 Diego Klabjan bn은 일반적으로 층의 선형 변환 (예를 들어, 완전히 연결된 층의 매트릭스 곱셈 또는 컨볼 루션 층의 컨볼 루션) 및 비선형 활성화 기능 (예 : Relu) 이전에 적용됩니다. 주요 구성 요소는 미니 배치 통계 (평균 및 분산), 정규화 및 학습 가능한 매개 변수로 스케일링/이동입니다. Bn은 각각의 미니 배치 내에서 활성화를 정규화함으로써 내부 공변량 이동을 해결하여 후속 층에 대한 입력을보다 안정적으로 만듭니다. 이를 통해 더 높은 학습 속도로 수렴이 빠르고 초기화 감도를 줄입니다. 또한 특정 활성화 패턴에 대한 의존성을 줄임으로써 과적으로 피해를 방지하여 규칙화합니다. 배치 정규화의 수학 : - 훈련 및 추론 중에

bn은 다르게 작동합니다 훈련 :

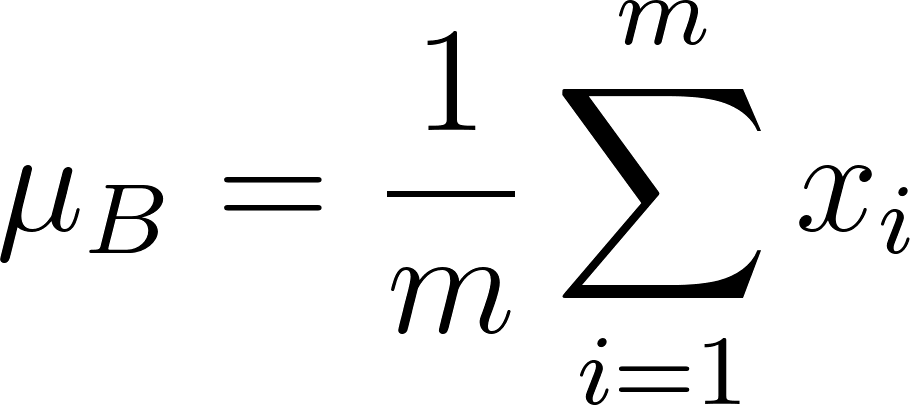

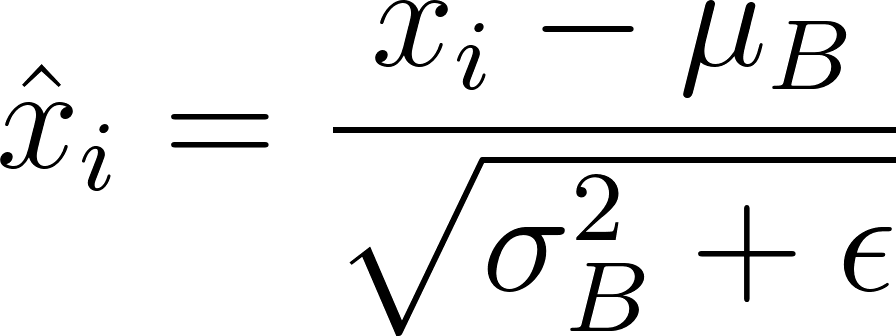

정규화 :평균 (μ b ) 및 분산 (σ b ))는 미니 배치에서 각 기능에 대해 계산됩니다 : .

-

활성화 (x i )는 정규화됩니다 (ε는 수치 안정성을 위해 작은 상수입니다) 스케일링 및 이동 : 학습 가능한 매개 변수 γ 및 β 스케일 및 시프트 :

추론 :

배치 통계는 움직이는 평균 (운동량 계수 α)을 사용하여 훈련 중에 계산 된 실행 통계 (실행 평균 및 분산)로 대체됩니다.

배치 통계는 움직이는 평균 (운동량 계수 α)을 사용하여 훈련 중에 계산 된 실행 통계 (실행 평균 및 분산)로 대체됩니다.

이러한 실행 통계 및 학습 된 γ 및 β는 추론 중 정규화에 사용됩니다. 텐서 플로 구현 : 구현 고려 사항 :

배치 : 선형 변환 후 및 활성화 기능 전 배치 크기 :

정규화 : bn은 정규화 효과를 소개합니다 더 큰 배치 크기는보다 정확한 배치 통계를 제공합니다.

더 큰 배치 크기는보다 정확한 배치 통계를 제공합니다.

제한과 도전 :- 비 컨볼 루션 아키텍처 : Bn의 효과는 RNNS 및 변압기에서 감소합니다. 작은 배치 크기 :

신뢰할 수있는 배치 통계 계산 간접비 : 메모리와 훈련 시간 증가

적응 형 배치 정규화, 가상 배치 정규화 및 하이브리드 정규화 기술은 일부 한계를 해결할 수 있습니다. 완화 한계 :

완화 한계 : 변형 및 확장 : 층 정규화, 그룹 정규화, 인스턴스 정규화, 배치 재 정규화 및 중량 정규화는 특정 요구에 따라 대안 또는 개선을 제공합니다. 결론 :

배치 정규화는 깊은 신경망 훈련을 향상시키는 강력한 기술입니다. 이점, 구현 세부 사항 및 제한 사항을 기억하고 프로젝트에서 최적의 성능을위한 변형을 고려하십시오.

-

위 내용은 배치 정규화 : 이론 및 텐서 플로 구현의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

성명:

본 글의 내용은 네티즌들의 자발적인 기여로 작성되었으며, 저작권은 원저작자에게 있습니다. 본 사이트는 이에 상응하는 법적 책임을 지지 않습니다. 표절이나 침해가 의심되는 콘텐츠를 발견한 경우 admin@php.cn으로 문의하세요.

배치 통계는 움직이는 평균 (운동량 계수 α)을 사용하여 훈련 중에 계산 된 실행 통계 (실행 평균 및 분산)로 대체됩니다.

배치 통계는 움직이는 평균 (운동량 계수 α)을 사용하여 훈련 중에 계산 된 실행 통계 (실행 평균 및 분산)로 대체됩니다.

더 큰 배치 크기는보다 정확한 배치 통계를 제공합니다.

더 큰 배치 크기는보다 정확한 배치 통계를 제공합니다.

완화 한계 :

완화 한계 :