빅 데이터의 세계로 들어서신다면 강력한 분산 컴퓨팅 시스템인 Apache Spark에 대해 들어보셨을 것입니다. Apache Spark용 Python 라이브러리인 PySpark는 속도, 확장성 및 사용 편의성이 결합되어 데이터 애호가들 사이에서 인기가 높습니다. 하지만 로컬 컴퓨터에 설정하는 것은 처음에는 다소 겁이 날 수 있습니다.

두려워하지 마세요. 이 기사에서는 일반적인 질문을 해결하고 여정을 최대한 간단하게 만들어 전체 과정을 안내합니다.

PySpark란 무엇이며 왜 관심을 가져야 합니까?

설치에 앞서 PySpark가 무엇인지 알아보겠습니다. PySpark를 사용하면 Python을 사용하여 Apache Spark의 엄청난 컴퓨팅 성능을 활용할 수 있습니다. 테라바이트 단위의 데이터를 분석하든, 기계 학습 모델을 구축하든, ETL(Extract, Transform, Load) 파이프라인을 실행하든 PySpark를 사용하여 작업할 수 있습니다. 그 어느 때보다 데이터를 효율적으로 활용하세요.

이제 PySpark를 이해했으므로 설치 과정을 살펴보겠습니다.

1단계: 시스템이 요구 사항을 충족하는지 확인

PySpark는 Windows, macOS, Linux를 비롯한 다양한 시스템에서 실행됩니다. 성공적으로 설치하는 데 필요한 사항은 다음과 같습니다.

- JDK(Java Development Kit): PySpark에는 Java가 필요합니다(버전 8 또는 11 권장).

- Python: Python 3.6 이상이 있는지 확인하세요.

- Apache Spark 바이너리: 설치 과정에서 다운로드하게 됩니다.

시스템 준비 상태를 확인하려면:

- 터미널 또는 명령 프롬프트를 엽니다.

- java -version 및 python —version을 입력하여 Java 및 Python 설치를 확인하세요.

Java 또는 Python이 설치되어 있지 않은 경우 다음 단계를 따르세요.

- Java의 경우: 오라클 공식 홈페이지에서 다운로드하세요.

- Python의 경우: Python 다운로드 페이지를 방문하세요.

2단계: 자바 설치

Java는 Apache Spark의 핵심입니다. 설치하려면:

1.Java 다운로드: Java SE Development Kit 다운로드 페이지를 방문하세요. 운영 체제에 적합한 버전을 선택하세요.

2.Java 설치: 설치 프로그램을 실행하고 프롬프트를 따릅니다. Windows에서는 JAVA_HOME 환경 변수를 설정해야 합니다. 이렇게 하려면:

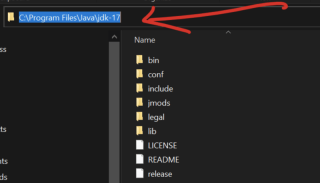

- 경로 변수를 복사하고 컴퓨터의 로컬 디스크로 이동한 후 프로그램 파일을 선택하고 java 폴더를 찾습니다. 열면 jdk-17(자신의 버전)이 표시됩니다. 17이 아닐 수도 있습니다.) 열어보시면 아래와 같이 경로 및 복사가 가능합니다

Windows 검색창에 환경변수를 검색하세요.

시스템 변수에서 새로 만들기를 클릭하고 변수 이름을 JAVA_HOME으로 설정하고 값을 위에서 복사한 Java 설치 경로(예: C:Program 파일Javajdk-17).

3.설치 확인: 터미널 또는 명령 프롬프트를 열고 java-version을 입력하세요.

3단계: Apache Spark 설치

1.Spark 다운로드: Apache Spark 웹사이트를 방문하여 필요에 맞는 버전을 선택하세요. Hadoop용으로 사전 구축된 패키지를 사용하세요(Spark와 공통 조합).

2.파일 추출:

- Windows에서는 WinRAR 또는 7-Zip과 같은 도구를 사용하여 파일을 추출합니다.

- macOS/Linux에서는 tar -xvf Spark-.tgz 명령을 사용하세요.

3.환경 변수 설정:

- Windows의 경우: Spark의 bin 디렉토리를 시스템의 PATH 변수에 추가하세요.

- macOS/Linux의 경우: .bashrc 또는 .zshrc 파일에 다음 줄을 추가합니다. :

export SPARK_HOME=/path/to/spark export PATH=$SPARK_HOME/bin:$PATH

4.설치 확인: 터미널을 열고 Spark-Shell을 입력합니다. Spark의 대화형 셸 시작이 표시됩니다.

4단계: Hadoop 설치(선택 사항이지만 권장됨)

Spark는 엄격하게 Hadoop을 요구하지는 않지만 많은 사용자가 HDFS(Hadoop 분산 파일 시스템) 지원을 위해 Spark를 설치합니다. Hadoop을 설치하려면:

- Apache Hadoop 웹사이트에서 Hadoop 바이너리를 다운로드하세요.

- 파일을 추출하고 HADOOP_HOME 환경 변수를 설정합니다.

5단계: pip를 통해 PySpark 설치

Python의 pip 도구를 사용하면 PySpark를 쉽게 설치할 수 있습니다. 간단히 실행하세요:

pip install pyspark

확인하려면 Python 셸을 열고 다음을 입력하세요.

pip install pysparkark.__version__)

버전 번호가 보이면 축하합니다! PySpark가 설치되어 있나요?

6단계: PySpark 설치 테스트

여기서 재미가 시작됩니다. 모든 것이 원활하게 작동하는지 확인하세요.

간단한 스크립트 만들기:

텍스트 편집기를 열고 다음 코드를 붙여넣습니다.

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName("PySparkTest").getOrCreate()

data = [("Alice", 25), ("Bob", 30), ("Cathy", 29)]

columns = ["Name", "Age"]

df = spark.createDataFrame(data, columns)

df.show()

test_pyspark.py로 저장하세요

스크립트 실행:

터미널에서 스크립트 디렉터리로 이동하여 다음을 입력하세요.

export SPARK_HOME=/path/to/spark export PATH=$SPARK_HOME/bin:$PATH

이름과 나이

가 깔끔하게 정리된 표를 볼 수 있습니다.일반적인 문제 해결

최선의 지시에도 딸꾹질이 발생합니다. 다음은 몇 가지 일반적인 문제와 해결 방법입니다.

문제: java.lang.NoClassDefFoundError

해결책: JAVA_HOME 및 PATH 변수를 다시 확인하세요.문제: PySpark 설치에 성공했지만 테스트 스크립트가 실패했습니다.

해결책: 올바른 Python 버전을 사용하고 있는지 확인하세요. 때로는 가상 환경이 충돌을 일으킬 수도 있습니다.문제: Spark-shell 명령이 작동하지 않습니다.

해결책: Spark 디렉터리가 PATH에 올바르게 추가되었는지 확인하세요.

PySpark를 로컬에서 사용하는 이유는 무엇입니까?

많은 사용자는 PySpark가 주로 분산 시스템에서 사용되는데 왜 로컬 컴퓨터에 설치해야 하는지 궁금해합니다. 이유는 다음과 같습니다.

- 학습: 클러스터 없이 Spark 개념을 실험하고 학습하세요.

- 프로토타이핑: 소규모 데이터 작업을 대규모 환경에 배포하기 전에 로컬에서 테스트합니다.

- 편리성: 문제를 쉽게 디버깅하고 애플리케이션을 개발할 수 있습니다.

PySpark 생산성 향상

PySpark를 최대한 활용하려면 다음 팁을 고려하세요.

가상 환경 설정: venv 또는 conda와 같은 도구를 사용하여 PySpark 설치를 격리합니다.

IDE와 통합: PyCharm 및 Jupyter Notebook과 같은 도구를 사용하면 PySpark 개발을 보다 대화형으로 만들 수 있습니다.

PySpark 문서 활용: 자세한 지침은 Apache Spark 문서를 참조하세요.

PySpark 커뮤니티에 참여하세요

특히 PySpark와 같은 강력한 도구를 사용하면 막히는 현상이 일반적입니다. 활발한 PySpark 커뮤니티에 참여하여 도움을 받으세요:

포럼 가입: Stack Overflow와 같은 웹사이트에는 전용 Spark 태그가 있습니다.

모임 참석: Spark 및 Python 커뮤니티에서는 학습하고 네트워킹할 수 있는 이벤트를 자주 개최합니다.

블로그 팔로우: 많은 데이터 전문가가 자신의 경험과 튜토리얼을 온라인으로 공유합니다.

결론

로컬 컴퓨터에 PySpark를 설치하는 것은 처음에는 어려워 보일 수 있지만 다음 단계를 따르면 관리가 쉽고 보람이 있습니다. 데이터 여행을 막 시작하든 기술을 연마하든 PySpark는 실제 데이터 문제를 해결할 수 있는 도구를 제공합니다.

Apache Spark용 Python API인 PySpark는 데이터 분석 및 처리에 있어 획기적인 변화를 가져왔습니다. 잠재력은 엄청나지만 로컬 컴퓨터에 설정하는 것은 어려울 수 있습니다. 이 문서에서는 Java 설치 및 Spark 다운로드부터 간단한 스크립트를 사용한 설정 테스트까지 모든 과정을 단계별로 설명합니다.

PySpark를 로컬에 설치하면 전체 클러스터 없이도 데이터 워크플로의 프로토타입을 만들고, Spark의 기능을 배우고, 소규모 프로젝트를 테스트할 수 있습니다.

위 내용은 로컬 컴퓨터에 PySpark를 설치하는 방법의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

파이썬 : 컴파일러 또는 통역사?May 13, 2025 am 12:10 AM

파이썬 : 컴파일러 또는 통역사?May 13, 2025 am 12:10 AMPython은 해석 된 언어이지만 편집 프로세스도 포함됩니다. 1) 파이썬 코드는 먼저 바이트 코드로 컴파일됩니다. 2) 바이트 코드는 Python Virtual Machine에 의해 해석되고 실행됩니다. 3)이 하이브리드 메커니즘은 파이썬이 유연하고 효율적이지만 완전히 편집 된 언어만큼 빠르지는 않습니다.

루프 대 루프를위한 파이썬 : 루프시기는 언제 사용해야합니까?May 13, 2025 am 12:07 AM

루프 대 루프를위한 파이썬 : 루프시기는 언제 사용해야합니까?May 13, 2025 am 12:07 AMUSEAFORLOOPHENTERATINGOVERASERASERASPECIFICNUMBEROFTIMES; USEAWHILLOOPWHENTINUTIMONDITINISMET.FORLOOPSAREIDEALFORKNOWNSEDINGENCENCENS, WHILEWHILELOOPSSUITSITUATIONS WITHERMINGEDERITERATIONS.

파이썬 루프 : 가장 일반적인 오류May 13, 2025 am 12:07 AM

파이썬 루프 : 가장 일반적인 오류May 13, 2025 am 12:07 AMPythonloopscanleadtoerrors likeinfiniteloops, modifyinglistsdizeration, off-by-by-byerrors, zero-indexingissues, andnestedloopineficiencies.toavoidthese : 1) aing'i

파이썬의 루프 및 루프의 경우 : 각각의 장점은 무엇입니까?May 13, 2025 am 12:01 AM

파이썬의 루프 및 루프의 경우 : 각각의 장점은 무엇입니까?May 13, 2025 am 12:01 AMForloopSareadvantageForkNowniTerations 및 Sequence, OffingSimplicityAndInamicConditionSandunkNowniTitionS 및 ControlOver Terminations를 제공합니다

파이썬 : 편집과 해석에 대한 깊은 다이빙May 12, 2025 am 12:14 AM

파이썬 : 편집과 해석에 대한 깊은 다이빙May 12, 2025 am 12:14 AMPythonusesahybridmodelofilationandlostretation : 1) ThePyThoninterPretreCeterCompileSsourcodeIntOplatform-IndependentBecode.

Python은 해석 된 또는 편집 된 언어입니까? 왜 중요한가?May 12, 2025 am 12:09 AM

Python은 해석 된 또는 편집 된 언어입니까? 왜 중요한가?May 12, 2025 am 12:09 AMPythonisbothingretedandcompiled.1) 1) it 'scompiledtobytecodeforportabilityacrossplatforms.2) thebytecodeisthentenningreted, withfordiNamictyTeNgreted, WhithItmayBowerShiledlanguges.

루프를위한 것 및 기간 : 실용 가이드May 12, 2025 am 12:07 AM

루프를위한 것 및 기간 : 실용 가이드May 12, 2025 am 12:07 AMforloopsareusedwhendumberofitessiskNowninadvance, whilewhiloopsareusedwhentheationsdepernationsorarrays.2) whiloopsureatableforscenarioScontiLaspecOndCond

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

에디트플러스 중국어 크랙 버전

작은 크기, 구문 강조, 코드 프롬프트 기능을 지원하지 않음

PhpStorm 맥 버전

최신(2018.2.1) 전문 PHP 통합 개발 도구

SublimeText3 Linux 새 버전

SublimeText3 Linux 최신 버전

WebStorm Mac 버전

유용한 JavaScript 개발 도구

ZendStudio 13.5.1 맥

강력한 PHP 통합 개발 환경