Dify API로 실시간 음성을 구현하는 방법

- PHPz원래의

- 2024-08-24 16:51:021451검색

Dify는 온라인으로 LLM 워크플로를 구축하기 위한 오픈 소스 SaaS 플랫폼입니다. 저는 API를 사용하여 앱에서 대화형 AI 경험을 만들고 있습니다. API 응답으로 TTS 스트림을 가져와서 재생하는 데 어려움을 겪고 있었습니다. 여기서는 오디오 스트림을 처리하고 올바르게 재생하는 방법을 보여줍니다.

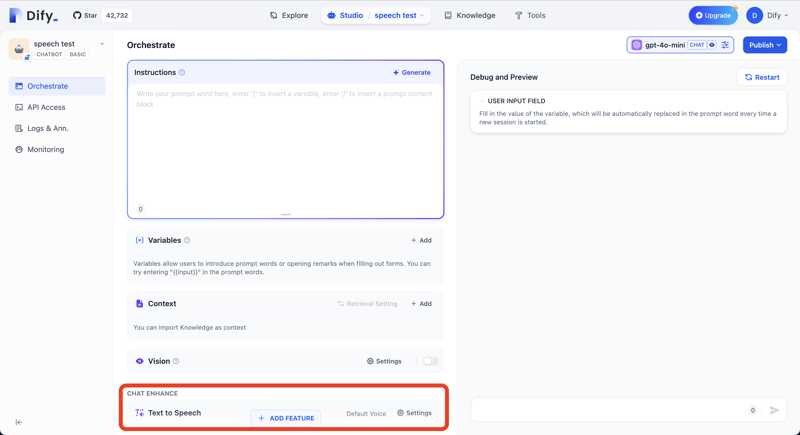

문자 채팅에 API 엔드포인트 https://api.dify.ai/v1/chat-messages를 사용하고 있습니다. Dify 앱에서 텍스트 음성 변환 기능을 활성화한 경우 텍스트 응답과 동일한 스트림으로 오디오 데이터를 반환합니다.

기능 추가 버튼을 누르고 텍스트 말하기 기능을 추가하세요.

다음의 컬 명령어로 API의 응답을 확인할 수 있습니다.

curl -X POST 'https://api.dify.ai/v1/chat-messages' \

--header 'Authorization: Bearer YOUR_API_KEY' \

--header 'Content-Type: application/json' \

--data-raw '{

"inputs": {},

"query": "What are the specs of the iPhone 13 Pro Max?",

"response_mode": "streaming",

"conversation_id": "",

"user": "abc-123",

"files": []

}'

TypeScript/JavaScript로 시연했지만 프로그래밍 언어에도 동일한 논리를 적용할 수 있습니다.

스트리밍 데이터 분석

먼저 Dify가 스트리밍을 위해 어떤 데이터를 사용하는지 알아보겠습니다.

스트리밍 데이터 형식

Dify는 다음과 같은 텍스트 데이터 형식을 사용하고 있습니다. JSON 라인과 비슷하지만 완전히 똑같지는 않습니다.

data: {"event": "workflow_started", "conversation_id": "065fb118-35d4-4524-a067-a70338ece575", "message_id": "3f0fe3cf-5aa1-4f7c-8abe-2505bf07ae8f", "created_at": 1724478014, "task_id": "dacb2d5c-a6f5-44b5-b5a6-de000f24aeba", "workflow_run_id": "50100b30-e458-4632-ad7d-8dd383823376", "data": {"id": "50100b30-e458-4632-ad7d-8dd383823376", "workflow_id": "debdb4fa-dcab-4233-9413-fd6d17b9e36a", "sequence_number": 334, "inputs": {"sys.query": "What are the specs of the iPhone 13 Pro Max?", "sys.files": [], "sys.conversation_id": "065fb118-35d4-4524-a067-a70338ece575", "sys.user_id": "abc-123"}, "created_at": 1724478014}}

data: {"event": "node_started", "conversation_id": "065fb118-35d4-4524-a067-a70338ece575", "message_id": "3f0fe3cf-5aa1-4f7c-8abe-2505bf07ae8f", "created_at": 1724478014, "task_id": "dacb2d5c-a6f5-44b5-b5a6-de000f24aeba", "workflow_run_id": "50100b30-e458-4632-ad7d-8dd383823376", "data": {"id": "bf912f43-29dd-4ee2-aefa-0fabdf379257", "node_id": "1721365917005", "node_type": "start", "title": "\u958b\u59cb", "index": 1, "predecessor_node_id": null, "inputs": null, "created_at": 1724478013, "extras": {}}}

data: {"event": "node_finished", "conversation_id": "065fb118-35d4-4524-a067-a70338ece575", "message_id": "3f0fe3cf-5aa1-4f7c-8abe-2505bf07ae8f", "created_at": 1724478014, "task_id": "dacb2d5c-a6f5-44b5-b5a6-de000f24aeba", "workflow_run_id": "50100b30-e458-4632-ad7d-8dd383823376", "data": {"id": "bf912f43-29dd-4ee2-aefa-0fabdf379257", "node_id": "1721365917005", "node_type": "start", "title": "\u958b\u59cb", "index": 1, "predecessor_node_id": null, "inputs": {"sys.query": "What are the specs of the iPhone 13 Pro Max?", "sys.files": [], "sys.conversation_id": "065fb118-35d4-4524-a067-a70338ece575", "sys.user_id": "abc-123", "sys.dialogue_count": 1}, "process_data": null, "outputs": {"sys.query": "What are the specs of the iPhone 13 Pro Max?", "sys.files": [], "sys.conversation_id": "065fb118-35d4-4524-a067-a70338ece575", "sys.user_id": "abc-123", "sys.dialogue_count": 1}, "status": "succeeded", "error": null, "elapsed_time": 0.001423838548362255, "execution_metadata": null, "created_at": 1724478013, "finished_at": 1724478013, "files": []}}

data: {"event": "node_started", "conversation_id": "065fb118-35d4-4524-a067-a70338ece575", "message_id": "3f0fe3cf-5aa1-4f7c-8abe-2505bf07ae8f", "created_at": 1724478014, "task_id": "dacb2d5c-a6f5-44b5-b5a6-de000f24aeba", "workflow_run_id": "50100b30-e458-4632-ad7d-8dd383823376", "data": {"id": "89ed58ab-6157-499b-81b2-92b1336969a5", "node_id": "llm", "node_type": "llm", "title": "LLM", "index": 2, "predecessor_node_id": "1721365917005", "inputs": null, "created_at": 1724478013, "extras": {}}}

...

응답에 Dify는 문자 답변과 오디오 데이터를 푸시합니다.

텍스트 답변 예시

data: {"event": "message", "conversation_id": "aa13eb24-e90a-4c5d-a36b-756f0e3be8f8", "message_id": "5be739a9-09ba-4444-9905-a2f37f8c7a21", "created_at": 1724301648, "task_id": "0643f770-e9d3-408f-b771-bb2e9430b4f9", "id": "5be739a9-09ba-4444-9905-a2f37f8c7a21", "answer": "MP"}

오디오 데이터 예시

data: {"event": "tts_message", "conversation_id": "aa13eb24-e90a-4c5d-a36b-756f0e3be8f8", "message_id": "5be739a9-09ba-4444-9905-a2f37f8c7a21", "created_at": 1724301648, "task_id": "0643f770-e9d3-408f-b771-bb2e9430b4f9", "audio": "//PkxABhvDm0DVp4ACUUfvWc1CFlh0tR9Oh7LxzHRsGBuGx155x3JqTJiwKKZf8wIcxpMzJU0h4zhgyQwwwIsgWQMAALQMkanBTjfCPgZwFsDOGGIYJoJoJoJoPQPQLYEgAOwM4SMXMW8TcNWGrEPEME0HoIQTg0DQNA0C5k7IOLeJuDnDVi5nWyJwgghAagQwTQQgJAGrDVibiFhqw1YR8HOEjBUA5AcgagQwTQTQQgJAAtgLYKsQ8hZc0PV7OrE4SgQgFIAsAQAwA6H0Uv4t4m4m49Yt4uYOQHIBkAyAqAkAuB0Mm6UeKxDGRrIODkByBqBNBCA1ARwHIEgBVg5wkY41W2GgdEVDFBNe+HicQw0ydk7HrHrIWXM62d48ePNfCkNATcTcNWGrCRhqxDxcwMYBwBkByCGC4EILgoJTQUDeW8W8TcTchZ1qBWIYchOBbBCA1AhgSMJGGrFzLmh6fL+LeBkAyAZAcgSAXAhB0Kxnj4YDkJwXA6FAzwj8IIJoJoPQXA6EPOcg4R8FOBnCRljRAwlwoh4EUwLhFTCVA+MR0R8wyxOhgAwwDgJjBUABMM0hMxBgnTPtMrMBEEcwJQCzIXIdMZMG821DmjDKHJAwLDKHRMQsJkwbwVRoFs//PkxEx5dDnwAZ7wANHgEUFJHGCUCQp3LWCQQYGAATI5QzwHBJF4UFktpfATT2l0goAGNADLOU64HAMCQCK50szABAIkDS2/j8gl6l6Di7QgBEiAfMEADBnyZBgeAWCMK4xvBbhoRZj1M+ktsNMTrMNcHEwHQEzAjAHMGQAQwRQZTBHALMGMDkzhh2jGhLtMgsMMwfhOzCnGLMMcKgwOw8pqHMoGtvdDzos0AIAiXIsBAmGsRFtYcBABmB0AUYjQfhhDAfjoCrETAGArMOAJ4iAAMCMFkwXwh5fffuhpYMhyP2bl3MVAJQrSYQDsna7G2+fx/GvyAwUQbTAdAFCAHVKyIAduTXHZZXDjNS57/VeVJ5+JBJ+0kATkCSells8/NBt/2/5Dj1s+chDBYSINutNS9FQwDwBWHjgASKRgAAJOyYC4Ao0CMNAKBgB6KK1hYBkAAHROM9mLsknb8avTcB0MerV6jl7llE70egOerRh9WcP/FoHqtVsO/In2f+G2tsdnH+L/KSSvBQB4OATam27Yi4jiBgBFOpq15bTQU6k1G4LoWo1mMAwDQwlBEzEnKsMkA7c5JYuTOzK2MvAbEysSPTM+dOOn1XEzGgIzXzmPODVvs1cyNTJxQ9MsAWwy//PkxDlz7DIMAd7gAek5EwnjcjX9QVN1N0czFyijQKOmMi4IYw8RvzFvCHMHYBQwdQlTRxVNvm8ycGjLYlMTAQ=="}

이벤트 속성을 확인하면 오디오 데이터의 JSON 라인을 구분할 수 있습니다. 오디오 JSON의 값은 tts_message입니다. 오디오 mp3 바이너리는 JSON의 audio 속성에 base64 형식으로 저장됩니다.

데이터 처리 문제

TTS 오디오를 실시간으로 재생할 때 발생하는 첫 번째 문제는 JSON 라인이 패킷으로 분할되어 있으며 각 패킷이 그대로 유효한 JSON 데이터가 아니라는 것입니다.

가운데가 잘린 패킷 예시

euimRrhsPMZiMAl+BqSZMDmIkQEcDb/8+TEtHm8MhwA3p/p8dA0CCpAxwMMPABoYMIWwUDG6BRmiYZg2G6gRidGanOm5i5iaIYmfkH8Z/FmEopqJGZKXihYEIRxCKYKtlQuMvPjPQIwUVFFECDRnRCYEimGmA6cji41yQMImMEmhaHrVKpCxo2OYx6Q5RcJKAKkah4X6MckHEqdwKgHGHltDUjCy46HMgTCpwodAM8KijREwSSEk5hB4gRGFfC0ouYoeDiYtNREDgKQsTT6EI4egmMMBxpQZmoUJmAAg6YPDmQISgSECAZQOLfAUEQAG/dgxAVkxfFHGorEHB4CS+Yugwk2gq8akIwMsZIuIzUSrCAGm1iBnoYA8lcoYSlaIJ5RjCblwbsh8sB3skA7Gcx3zmSOKnXNJO6ObKklhuYjlVL1dSMhgwVJtFzMeWFufNKy3ODmCExBTUUzLjEwMKqqqqqqqqqqqqqqqqqqCIEWFIAA4DAWKkMDDIBA4lBqGDdmZwzAkGJFoYiwEV0IQOQHg1AATJiUM6F0z2fDE6PMvlc6DhTMJ+MNH4xWwzBwKMMCgHAwwUFQwjGEgMgovgIBMIMECYxYSDKAwSoMOBC4Ez682pEZIB8kBuiawZEaSnFAjIEwSFRxGUJIXMGRMmfNCPApcKL/8+TEiVdEKlJm5pM9gz0MyScwo04BgqjEFh489MGKVw=="}

패킷은 JSON 라인의 중간부터 시작됩니다. 유효한 JSON 라인을 얻으려면 여러 패킷을 결합해야 합니다.

두 번째 문제는 JSON의 오디오 데이터 청크가 유효한 오디오 데이터가 아니라는 것입니다. mp3 프레임 중간에 데이터가 잘립니다.

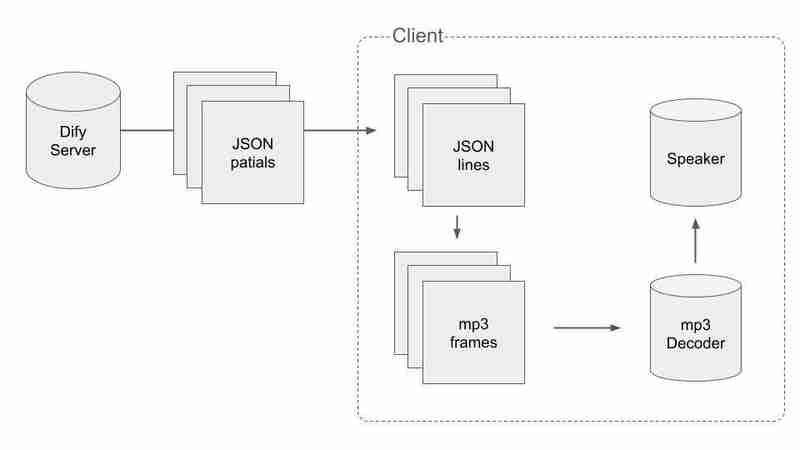

구현

JSON과 mp3로 분할된 데이터를 처리하려면 현명한 방법이 필요합니다. 진행과정은 다음과 같습니다.

먼저 유효한 JSON 데이터를 가져와서 패킷을 수신하면서 JSON으로 분할해야 합니다. 끝에 n이 있는 패킷을 얻었을 때 지금까지 수신된 패킷의 연결이 중간에 잘리지 않았다고 말할 수 있습니다. 의사코드는 이렇습니다.

let packets = []

stream.on('data', (bytes) => {

const text = bytes.toString()

packets.push(text)

if (text.endsWith('\n')) {

// Extract audio data from the packets.

const audioChunks = extractAudioChunks(packets.join(''))

// Clear the packet array

packets = []

}

})

두 번째로 오디오 청크를 mp3 프레임으로 분할해야 합니다. 오디오 청크를 바이너리로 연결하고 그 안에 있는 각 mp3 프레임을 찾습니다.

const mp3Frames = []

const binaryToProcess = Buffer.concat([...audioChunks])

let frameStartIndex = 0

for (let i = 0; i < binaryToProcess.length; i += 1) {

const currentByte = binaryToProcess[i]

const nextByte = binaryToProcess[i + 1]

// MP3 frame header always starts with eleven 1 bits. Checking 2 bytes.

// It is a beginning of mp3 frame if current byte is 0xff and the beginning of the next byte is 111.

// MP3 Spacification

// http://www.mp3-tech.org/programmer/frame_header.html

if (currentByte === 0xff && (nextByte & 0b11100000) === 0b11100000) {

mp3Frames.push(binaryToProcess.subarray(frameStartIndex, i))

frameStartIndex = i

}

}

mp3 프레임 분할이 완전히 구현된 것은 아닙니다. 실제 프로세스에서는 오디오 바이너리에서 mp3 프레임을 추출할 때 나머지 바이트가 있고 나머지를 다음 반복에서 오디오 바이트의 시작으로 사용하는 경우를 고려해야 합니다. 전체 구현을 보려면 내 Github 저장소를 확인하세요.

위 내용은 Dify API로 실시간 음성을 구현하는 방법의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!