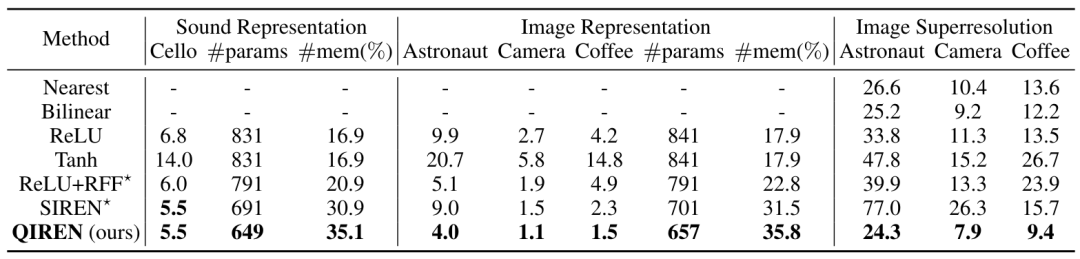

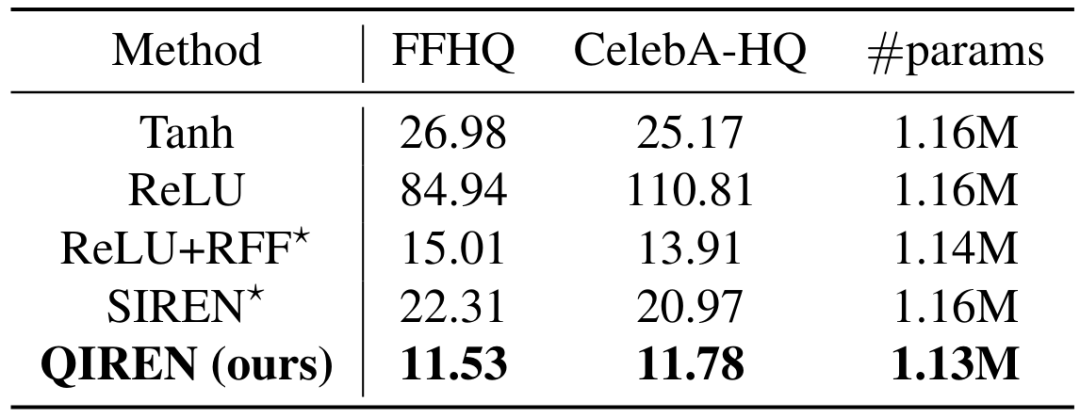

ICML 2024 | 신호 표현이 기하급수적으로 향상되고 메모리 절약이 35%를 초과하며 양자 암시적 표현 네트워크가 출시됩니다.

- PHPz원래의

- 2024-06-26 17:07:22828검색

AIxiv 칼럼은 본 사이트에서 학술 및 기술 콘텐츠를 게재하는 칼럼입니다. 지난 몇 년 동안 이 사이트의 AIxiv 칼럼에는 전 세계 주요 대학 및 기업의 최고 연구실을 대상으로 한 2,000개 이상의 보고서가 접수되어 학술 교류 및 보급을 효과적으로 촉진하고 있습니다. 공유하고 싶은 훌륭한 작품이 있다면 자유롭게 기여하거나 보고를 위해 연락주시기 바랍니다. 제출 이메일: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com

논문 제목: Quantum Implicit Neural Representations 논문 저자: Jiaming Zhao, Wenbo Qiao, Peng Zhang*, Hui Gao -

논문 링크: https://arxiv.org/abs /2406.03873 introduction tianjin University Quantum Intelligence and Language Team Team 혁신적으로 양자 컴퓨팅을 암시 적 신경 표현 분야에 도입하고 양자 암시 적 표현 네트워크 ( Q

presentation N

ㅋㅋ 그림 3. 모델 아키텍처

N개의 혼합 레이어와 선형 레이어로 구성 끝. 모델은 좌표를 입력으로 사용하고 신호 값을 출력합니다. 데이터는 처음에 선형 레이어와 BatchNorm 레이어로 시작하여 혼합 레이어에 들어가며 결과는 다음과 같습니다.

ㅋㅋ 그림 5. 그림 5. Tanh 기반 MLP와 비교한 각 모델의 오차. 음영 처리된 영역은 저주파 오류를 나타내고, 음영 처리되지 않은 영역은 고주파 오류를 나타냅니다.

summary

위 내용은 ICML 2024 | 신호 표현이 기하급수적으로 향상되고 메모리 절약이 35%를 초과하며 양자 암시적 표현 네트워크가 출시됩니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

성명:

본 글의 내용은 네티즌들의 자발적인 기여로 작성되었으며, 저작권은 원저작자에게 있습니다. 본 사이트는 이에 상응하는 법적 책임을 지지 않습니다. 표절이나 침해가 의심되는 콘텐츠를 발견한 경우 admin@php.cn으로 문의하세요.