AIxiv 칼럼은 본 사이트에서 학술 및 기술 콘텐츠를 게재하는 칼럼입니다. 지난 몇 년 동안 이 사이트의 AIxiv 칼럼에는 전 세계 주요 대학 및 기업의 최고 연구실을 대상으로 한 2,000개 이상의 보고서가 접수되어 학술 교류 및 보급을 효과적으로 촉진하고 있습니다. 공유하고 싶은 훌륭한 작품이 있다면 자유롭게 기여하거나 보고를 위해 연락주시기 바랍니다. 제출 이메일 : liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com 링크 : https://arxiv.org/abs/2306.16772

링크 : https : // cjerry1243. github.io/M3Act/

- 논문 제목: M3Act: 합성 인간 그룹 활동에서 학습

- 시각 정보를 통해 군중 행동을 인식하고 이해하는 것은 비디오 모니터링, 대화형 로봇 분야에 있습니다. , 자율주행 등이 핵심 기술 중 하나이지만, 대규모 군중 행동 주석 데이터를 획득하는 것은 관련 연구 개발에 병목 현상이 되고 있다. 요즘 합성 데이터 세트는 실제 데이터를 대체하는 새로운 방법으로 떠오르고 있지만 기존 연구의 합성 데이터 세트는 주로 인체 자세와 형태를 추정하는 데 중점을 둡니다. 의 합성 애니메이션 동영상만 제공하는 경우가 많아

군중

의 동영상 인식 작업에는 적합하지 않습니다.

이 글에서 저자는 다중 그룹 군중 행동에 적합한 합성 데이터 생성 프레임워크인 M3Act를 제안합니다. 실험에 따르면 이 합성 데이터 세트는 여러 사람 추적 및 그룹 활동 인식에서 다운스트림 모델의 성능을 크게 향상시킬 수 있으며 DanceTrack 작업에 대한 실제 데이터의 62.5% 이상을 대체할 수 있으므로 실제 응용 프로그램에서 데이터 주석 비용을 줄일 수 있습니다. 시나리오. 또한 이 합성 데이터 프레임워크는 제어 가능한 3D 군집 활동 생성이라는 새로운 작업 클래스를 제안합니다. 이 작업은 다중 입력(활동 범주, 군집 크기, 궤적, 밀도, 속도 및 텍스트 입력)을 사용하여 군집 활동 생성 결과를 직접 제어하는 것을 목표로 합니다. 저자는 작업과 지표를 엄격하게 정의하고 경쟁 기준과 결과를 제공합니다. 데이터 생성

Unity 엔진을 기반으로 개발된 M3Act는 다양한 행동 유형의 군중 데이터를 다루고 매우 다양하고 사실적인 비디오 이미지와 포괄적인 데이터 라벨링을 제공합니다. 다른 합성 데이터 세트와 비교하여 M3Act는 2D 및 3D 마커는 물론 세분화된 개인 수준 및 그룹 수준 레이블을 포함하여 보다 포괄적인 레이블이 지정된 데이터를 제공하므로 다중 사용자 및 다중 그룹 연구 작업을 지원하는 이상적인 합성이 됩니다. 데이터 세트 생성기.

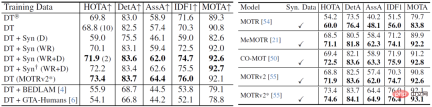

데이터 생성기에는 25개의 3D 장면, 104개의 HDR(High Dynamic Range) 파노라마 이미지, 5개의 조명 설정, 2200개의 캐릭터 모델, 384개의 애니메이션(14개의 동작 카테고리) 및 6개의 그룹 활동 유형이 포함되어 있습니다. 데이터 생성 과정은 다음과 같습니다. 먼저 시뮬레이션 시나리오 내의 모든 매개변수는 무작위화 과정을 통해 결정되며, 이후 매개변수를 기반으로 배경 객체, 조명, 카메라가 포함된 3D 장면과 애니메이션이 포함된 캐릭터 모델 그룹이 생성됩니다. . 마지막으로 RGB 이미지가 여러 관점에서 렌더링되고 레이블이 지정된 결과가 내보내집니다. 시뮬레이션된 데이터의 높은 수준의 다양성을 보장하기 위해 M3Act는 데이터 생성 프로세스의 거의 모든 측면에 대해 무작위화를 제공합니다. 여기에는 장면의 그룹 수, 각 그룹의 사람 수, 그룹의 위치, 그룹 내 사람의 배열, 개인의 위치, 인스턴스화된 캐릭터의 질감 및 장면이 포함됩니다. , 조명 조건, 카메라 위치, 캐릭터, 그룹 활동, 원자 액션 및 애니메이션 클립 선택. 각 그룹 활동은 매개변수화된 모듈로도 구축됩니다. 이러한 매개변수에는 떼의 개인 수와 떼의 활동 내에서 허용되는 특정 원자적 활동이 포함됩니다. 최종 생성된 데이터 세트는 두 부분으로 나뉩니다. 첫 번째 부분인 "M3ActRGB"에는 단일이지만 여러 유형의 그룹 활동에 대한 6000개의 시뮬레이션과 여러 그룹 및 여러 유형에 대한 9000개의 시뮬레이션이 포함되어 있으며 총 600만 개의 RGB 이미지와 4,800만 개의 경계 상자가 포함되어 있습니다. 두 번째 부분 "M3Act3D"에는 3D 데이터만 포함되어 있습니다. 단일 다중 유형 그룹 활동에 대한 65,000개 이상의 150프레임 시뮬레이션으로 구성되며 총 87.6시간이 소요됩니다. 저자가 아는 한, M3Act3D의 그룹 크기와 상호 작용 복잡성은 이전 멀티플레이어 스포츠 데이터 세트보다 훨씬 높아 대규모 그룹 활동을 위한 최초의 대규모 3D 데이터 세트입니다. 다인원 추적, 그룹 활동 인식, 제어 가능한 그룹 활동 생성이라는 세 가지 핵심 실험을 통해 M3Act의 실제 효과가 입증되었습니다. 연구 결과 기존 모델 MOTRv2[1]의 훈련에 합성 데이터를 추가한 후 모델이 5개 지표 모두에서 유의미한 것으로 나타났습니다. 특히 HOTA 지표 순위 10~2위를 기록 중이다. 동시에 훈련 세트의 실제 데이터 중 62.5%가 합성 데이터로 대체된 경우 모델은 여전히 유사한 성능을 달성할 수 있습니다. 또한 BEDLAM 및 GTA-Humans와 같은 다른 합성 데이터 소스와 비교할 때 M3Act는 모델 교육에 대한 성능이 크게 향상되어 다중 사용자 그룹 활동 작업에 더 적합하다는 것을 나타냅니다. 마지막으로 아래 표는 M3Act에 따른 다양한 모델의 훈련 결과를 보여줍니다. 결과는 M3Act가 다양한 모델에서 효과적임을 보여줍니다.

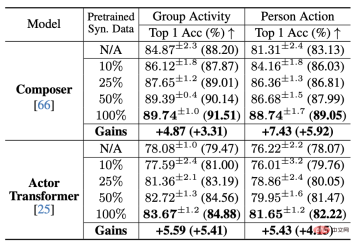

마찬가지로 M3Act는 다음 표와 같이 두 가지 기존 그룹 활동 인식 모델의 성능도 향상시켰습니다. 사전 훈련에 합성을 사용하여 데이터 양이 늘어날수록 인식 정확도는 계속해서 향상됩니다. 100% 합성 데이터를 활용한 경우, 그룹 활동 인식 모델인 Composer[2]의 정확도는 그룹 수준에서는 평균 4.87%, 개인 수준에서는 7.43% 증가한 반면, 또 다른 그룹 활동 인식 모델인 Actor Transformer[3]는 정확도가 향상되었다. 그룹 수준에서는 정확도가 5.59% 증가했고, 개인 수준에서는 5.43% 증가했습니다.

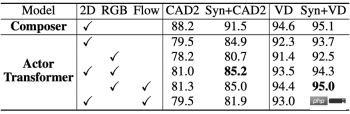

아래 표는 다양한 입력 방식을 사용한 CAD2 및 배구(VD)의 그룹 인식 정확도를 보여줍니다. 실험의 성능 향상은 M3Act의 합성 데이터가 다운스트림 작업에 효과적으로 이점을 제공하고 다양한 모델, 입력 형식 및 데이터 세트에 걸쳐 있을 수 있음을 보여줍니다.

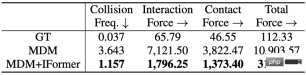

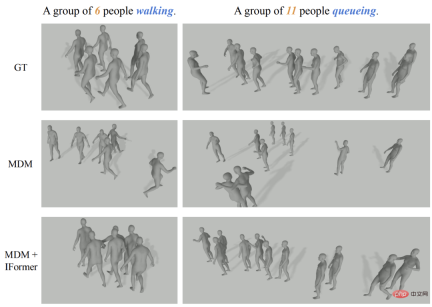

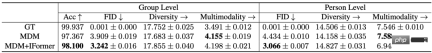

저자는 제어 가능한 3D 그룹 활동 생성이라는 새로운 유형의 작업을 제안합니다. 이 작업은 주어진 활동 클래스 레이블과 임의의 인구 규모를 기반으로 가우스 노이즈로부터 일련의 3D 인간 행동을 합성하는 것을 목표로 합니다. 기존 연구는 멀티 플레이어 액션을 생성할 수 있지만 2인 시나리오나 고정된 인원이 있는 그룹으로 제한됩니다. 따라서 저자는 두 가지 기본 방법을 제안합니다. 첫 번째 기본 접근 방식에서는 1인 모션 확산 모델 MDM[4]을 반복적으로 호출하여 그룹 활동을 구현하므로 각 개인에 대한 생성 프로세스가 독립적입니다. 두 번째 방법은 MDM을 기반으로 하는 대화형 변환기(IFormer)를 추가합니다. 인간 상호 작용의 모델링으로 인해 MDM+IFormer는 단일 전달 단계에서 조정된 그룹 활동을 생성할 수 있습니다. 저자는 그룹 및 개인 수준 모두에서 인식 정확도, FID(Frechette 초기 거리), 다양성 및 다중 모드 등의 평가 지표를 고려합니다. 또한 저자는 사회적 힘 모델을 기반으로 충돌 빈도, 반발 상호작용력, 접촉 반발력, 전체 반발력이라는 4가지 위치 기반 지표를 그룹 수준에 추가합니다. 결과는 다음과 같습니다.

- MDM+IFormer는 잘 정렬된 캐릭터 위치로 그룹 활동을 생성할 수 있습니다. 아래 정성적 그래프를 참고하세요.

- 두 기준 방법 모두 입력 조건에 맞는 다양한 활동을 생성할 수 있지만 MDM+IFormer가 더 나은 FID 점수를 얻습니다.

- MDM+IFormer의 대화형 변환기는 생성된 그룹 활동 내에서 충돌 빈도를 크게 줄입니다. ㅋㅋㅋ . 다중 사용자 추적 및 그룹 활동 인식에 대한 실험에서 더 많은 합성 데이터가 추가됨에 따라 보이지 않는 테스트 사례에 대한 모델의 일반화 능력이 향상되는 것을 관찰했습니다.

또한 M3Act의 합성 데이터는 성능에 영향을 주지 않고 대상 필드의 실제 데이터 중 일부를 대체할 수 있으므로 훈련 과정에서 대량의 실제 데이터에 대한 필요성이 줄어들 것으로 예상됩니다. 데이터 수집 및 주석 비용. 이 결과는 시뮬레이션된 데이터에서 실제 데이터로 마이그레이션할 수 있는 작은 샘플 또는 심지어 제로 샘플의 가능성을 보여줍니다.

또한 M3Act의 합성 데이터는 성능에 영향을 주지 않고 대상 필드의 실제 데이터 중 일부를 대체할 수 있으므로 훈련 과정에서 대량의 실제 데이터에 대한 필요성이 줄어들 것으로 예상됩니다. 데이터 수집 및 주석 비용. 이 결과는 시뮬레이션된 데이터에서 실제 데이터로 마이그레이션할 수 있는 작은 샘플 또는 심지어 제로 샘플의 가능성을 보여줍니다.

제어 가능한 3D 그룹 활동 생성에서 MDM+IFormer는 이 작업의 기본 모델일 뿐이지만 여전히 캐릭터 움직임의 상호 작용 규칙을 학습하고 제어 가능한 잘 정렬된 그룹 활동을 생성합니다. 특히 생성적 접근 방식은 현재 절차적 접근 방식보다 성능이 뛰어나지만 다양한 신호(활동 카테고리, 그룹 크기, 궤적, 밀도, 속도 및 텍스트 입력)에서 직접 그룹 작업을 제어할 수 있는 잠재력을 보여줍니다. 미래에 데이터 가용성이 증가하고 생성 모델 기능이 향상됨에 따라 생성 방법이 결국 지배력을 얻고 사회적 상호 작용 및 집단적 인간 활동에서 더 널리 사용될 것이라고 예측합니다.

M3Act 데이터 세트의 그룹 행동의 복잡성은 데이터 생성 프로세스의 경험적 규칙에 의해 제한될 수 있지만 M3Act는 특정 다운스트림 작업에 맞게 새로운 그룹 활동을 통합하는 데 상당한 유연성을 제공합니다. 이러한 새로운 그룹은 전문가가 안내하는 경험적 규칙, 대규모 언어 모델에서 생성된 규칙 또는 제어 가능한 3D 그룹 활동의 생성 모델 출력에서 시작될 수 있습니다. 또한 이 논문의 저자는 합성 데이터와 실제 데이터 사이에 존재하는 도메인 차이를 인식합니다. 향후 릴리스에서 데이터 생성기에 자산을 추가하면 모델의 일반화 기능을 개선하고 이러한 차이점을 완화할 수 있습니다. [1] Yuang Zhang, Tiancai Wang 및 Xiangyu Zhang: 사전 훈련된 객체 감지기를 통한 부트스트랩핑 컴퓨터 비전 및 패턴에 관한 IEEE/CVF 컨퍼런스. Recognition, 페이지 22056–22065, 2023. [2] Honglu Zhou, Asim Kadav, Aviv Shamsian, Shijie Geng, Farley Lai, Long Zhao, Ting Liu, Mubbasir Kapadia 및 Hans Peter Graf. 키포인트 전용 양식을 사용하여 비디오에서 그룹 활동 추론(ECCV 2022), 2022.[3] Kirill Gavrilyuk, Ryan Sanford, Mehrsan Javan 및 Cees GM Snoek . 그룹 활동 인식을 위한 행위자 변환기 컴퓨터 비전 및 패턴 인식에 관한 IEEE/CVF 컨퍼런스 진행, 839–848페이지, 2020.

[4] Guy Tevet, Sigal Raab, Brian Gordon, Yonatan Shafir, Daniel Cohen-Or 및 Amit H Bermano 인간 모션 확산 모델 arXiv 사전 인쇄 arXiv:2209.14916, 2022.위 내용은 CVPR 2024 | 합성 영상 데이터 세트에 1인 데이터만 있나요? M3Act는 군중 행동 라벨링 문제를 해결합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

또한 M3Act의 합성 데이터는 성능에 영향을 주지 않고 대상 필드의 실제 데이터 중 일부를 대체할 수 있으므로 훈련 과정에서 대량의 실제 데이터에 대한 필요성이 줄어들 것으로 예상됩니다. 데이터 수집 및 주석 비용. 이 결과는 시뮬레이션된 데이터에서 실제 데이터로 마이그레이션할 수 있는 작은 샘플 또는 심지어 제로 샘플의 가능성을 보여줍니다.

또한 M3Act의 합성 데이터는 성능에 영향을 주지 않고 대상 필드의 실제 데이터 중 일부를 대체할 수 있으므로 훈련 과정에서 대량의 실제 데이터에 대한 필요성이 줄어들 것으로 예상됩니다. 데이터 수집 및 주석 비용. 이 결과는 시뮬레이션된 데이터에서 실제 데이터로 마이그레이션할 수 있는 작은 샘플 또는 심지어 제로 샘플의 가능성을 보여줍니다.