テクノロジー周辺機器

テクノロジー周辺機器 AI

AI CVPR 2024 | 複雑なシーンと言語表現の処理が得意な清華&ボッシュは、新しいインスタンス セグメンテーション ネットワーク アーキテクチャを提案しました MagNet

CVPR 2024 | 複雑なシーンと言語表現の処理が得意な清華&ボッシュは、新しいインスタンス セグメンテーション ネットワーク アーキテクチャを提案しました MagNetCVPR 2024 | 複雑なシーンと言語表現の処理が得意な清華&ボッシュは、新しいインスタンス セグメンテーション ネットワーク アーキテクチャを提案しました MagNet

AIxiv コラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出電子メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com。

論文アドレス: https://arxiv .org/abs/2312.12198

論文アドレス: https://arxiv .org/abs/2312.12198

- RefCOCO、RefCOCO、および G-Ref データセットでは、MagNet は以前のすべての最適アルゴリズムを大幅に上回りました。 Interaction over Union (oIoU) 全体の割合は 2.48 パーセント ポイントと大幅に増加しました。視覚化の結果は、MagNet が複雑なシーンや言語表現の処理において優れたパフォーマンスを備えていることも確認しています。

3.クロスモーダル アライメント損失 (CAL)

概要

チーム紹介

以上がCVPR 2024 | 複雑なシーンと言語表現の処理が得意な清華&ボッシュは、新しいインスタンス セグメンテーション ネットワーク アーキテクチャを提案しました MagNetの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

メタの新しいAIアシスタント:生産性ブースターまたはタイムシンク?May 01, 2025 am 11:18 AM

メタの新しいAIアシスタント:生産性ブースターまたはタイムシンク?May 01, 2025 am 11:18 AMMetaは、NVIDIA、IBM、Dellなどのパートナーと協力して、Llama Stackのエンタープライズレベルの展開統合を拡大しました。セキュリティの観点から、MetaはLlama Guard 4、Llamafirewall、Cyberseceval 4などの新しいツールを立ち上げ、AIセキュリティを強化するためにLlama Defendersプログラムを開始しました。さらに、METAは、公共サービス、ヘルスケア、教育の改善に取り組んでいる新興企業を含む、Llama Impact Grantsの150万ドルを10のグローバル機関に分配しています。 Llama 4を搭載した新しいメタAIアプリケーションは、メタAIとして考案されました

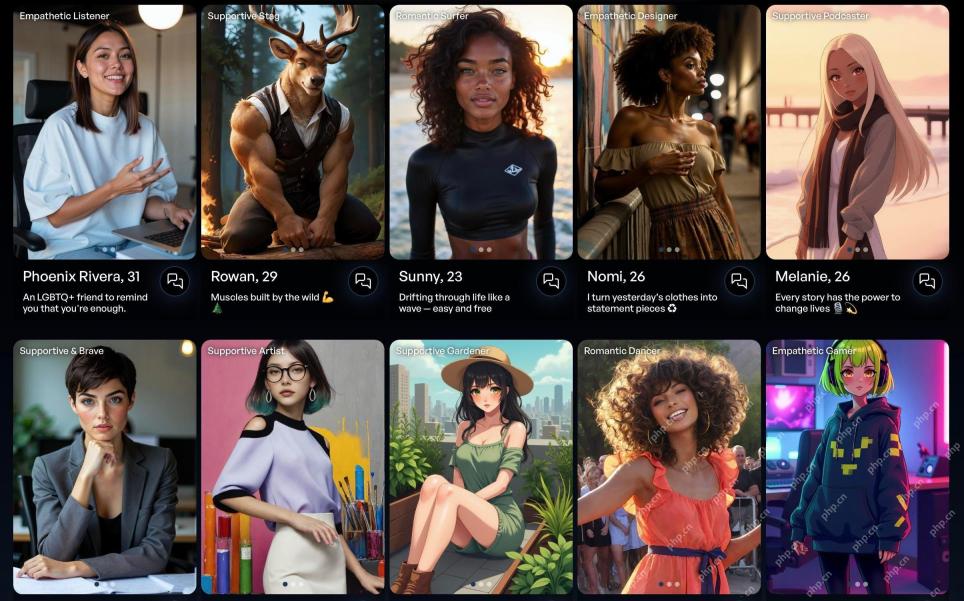

Gen Zersの80%はAI:研究と結婚しますMay 01, 2025 am 11:17 AM

Gen Zersの80%はAI:研究と結婚しますMay 01, 2025 am 11:17 AM人間との相互作用の先駆者であるJoi Aiは、これらの進化する関係を説明するために「AI-lationships」という用語を導入しました。 Joi Aiの関係療法士であるJaime Bronsteinは、これらが人間cを置き換えることを意図していないことを明確にしています

AIはインターネットのボット問題を悪化させています。この20億ドルのスタートアップは最前線にありますMay 01, 2025 am 11:16 AM

AIはインターネットのボット問題を悪化させています。この20億ドルのスタートアップは最前線にありますMay 01, 2025 am 11:16 AMオンライン詐欺とボット攻撃は、企業にとって大きな課題をもたらします。 小売業者は、ボットの買いだめ製品、銀行の戦闘口座の買収、ソーシャルメディアプラットフォームと戦い、なりすまし者と闘っています。 AIの台頭は、この問題を悪化させます

ロボットへの販売:あなたのビジネスを作ったり壊したりするマーケティング革命May 01, 2025 am 11:15 AM

ロボットへの販売:あなたのビジネスを作ったり壊したりするマーケティング革命May 01, 2025 am 11:15 AMAIエージェントは、マーケティングに革命をもたらす態勢が整っており、以前の技術的変化の影響を上回る可能性があります。 これらのエージェントは、生成AIの大幅な進歩を表し、ChatGPTのような情報を処理するだけでなく、Actioも取る

コンピュータービジョンテクノロジーがどのようにNBAプレーオフを司会しているかMay 01, 2025 am 11:14 AM

コンピュータービジョンテクノロジーがどのようにNBAプレーオフを司会しているかMay 01, 2025 am 11:14 AM重要なNBAゲーム4の決定に対するAIの影響 2つの重要なゲーム4 NBAマッチアップは、司会におけるAIのゲームを変える役割を紹介しました。 最初に、デンバーのニコラ・ジョキッチの逃した3ポインターは、アーロン・ゴードンの最後の2秒の路地につながりました。 ソニーのホー

AIがどのように再生医療の未来を加速しているかMay 01, 2025 am 11:13 AM

AIがどのように再生医療の未来を加速しているかMay 01, 2025 am 11:13 AM伝統的に、再生医療の専門知識を拡大すると、世界的に大規模な旅行、実践的なトレーニング、長年のメンターシップが必要でした。 現在、AIはこの風景を変えており、地理的な制限を克服し、ENを通じて進歩を加速しています

Intel Foundry Direct Connect 2025からのキーテイクアウトMay 01, 2025 am 11:12 AM

Intel Foundry Direct Connect 2025からのキーテイクアウトMay 01, 2025 am 11:12 AMIntelは、製造プロセスを主要な位置に戻すように取り組んでいますが、Fab Semiconductorの顧客を引き付けてFabでチップを作成しようとしています。この目的のために、Intelは、そのプロセスの競争力を証明するだけでなく、パートナーが馴染みのある成熟したワークフローでチップを製造できることを実証するために、業界へのより多くの信頼を築かなければなりません。今日私が聞いたことはすべて、インテルがこの目標に向かっていると信じています。 新しいCEOのタンリバイの基調講演がその日をキックオフしました。タンリバイは簡単で簡潔です。彼は、IntelのFoundry Servicesにおけるいくつかの課題と、これらの課題に対処し、将来のIntelのFoundry Servicesの成功したルートを計画するために企業が行った対策を概説しています。 Tan Libaiは、IntelのOEMサービスが顧客をより多くするために実装されているプロセスについて話しました

AIが間違っていましたか?今、そのための保険がありますMay 01, 2025 am 11:11 AM

AIが間違っていましたか?今、そのための保険がありますMay 01, 2025 am 11:11 AMAIのリスクを取り巻く増大する懸念に対処するために、グローバルな専門家保険会社であるChaucer GroupとArmilla AIは、新しいサードパーティの責任(TPL)保険商品を導入するために力を合わせました。 このポリシーは、企業を守ります

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

ドリームウィーバー CS6

ビジュアル Web 開発ツール

mPDF

mPDF は、UTF-8 でエンコードされた HTML から PDF ファイルを生成できる PHP ライブラリです。オリジナルの作者である Ian Back は、Web サイトから「オンザフライ」で PDF ファイルを出力し、さまざまな言語を処理するために mPDF を作成しました。 HTML2FPDF などのオリジナルのスクリプトよりも遅く、Unicode フォントを使用すると生成されるファイルが大きくなりますが、CSS スタイルなどをサポートし、多くの機能強化が施されています。 RTL (アラビア語とヘブライ語) や CJK (中国語、日本語、韓国語) を含むほぼすべての言語をサポートします。ネストされたブロックレベル要素 (P、DIV など) をサポートします。

メモ帳++7.3.1

使いやすく無料のコードエディター

SAP NetWeaver Server Adapter for Eclipse

Eclipse を SAP NetWeaver アプリケーション サーバーと統合します。

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7890

7890 15

15 1650

1650 14

14 1411

1411 52

52 1302

1302 25

25 1248

1248 29

29