ディープ ニューラル ネットワークは、特徴とパターンを自動的に学習できる強力な機械学習モデルです。ただし、実際のアプリケーションでは、パフォーマンスと信頼性を向上させるためにニューラル ネットワークの出力を調整する必要があることがよくあります。分類キャリブレーションと回帰キャリブレーションは一般的に使用されるキャリブレーション手法であり、それぞれに異なる原理と用途があります。この記事では、これら 2 つのテクノロジーの動作原理と応用シナリオについて詳しく紹介します。

1. 分類キャリブレーション

分類キャリブレーションは、分類器出力ベクトルの確率分布を調整することにより、分類器の信頼性と精度を向上させることです。達成するために。分類問題では、ニューラル ネットワークは各クラスの予測確率を表すベクトルを出力します。ただし、これらの確率は常に正確であるとは限らず、偏りが高すぎたり低すぎたりする可能性があります。分類キャリブレーションの目的は、これらの確率を調整して、真の確率分布に近づけることです。これにより分類器のパフォーマンスが向上し、さまざまなクラスの確率を予測する際の信頼性が高まります。

#一般的に使用される分類キャリブレーション方法には、次の 2 つがあります: 1. 温度スケーリング 温度スケーリングは、シンプルで効果的な分類キャリブレーション手法であり、その原理は、ニューラル ネットワークの出力をスケーリングすることによって分類器の信頼性を調整することです。具体的には、温度スケーリングは、ニューラル ネットワークの最後の層の出力をスケーリングするために温度パラメーター T を導入し、元の予測確率 p を校正された確率 q に変換します。q_i=\frac{p_i^{\frac{1}{T}}}{\sum_{j=1}^K p_j^{\frac{1}{T}}} ここで、i は th i カテゴリを表します。 K はカテゴリの総数を表します。 T=1 の場合、温度スケーリングは元の予測確率を変更しません。T>1 の場合、温度スケーリングは分類器の信頼度を高め、予測確率をより集中させ、信頼性を高めます。T温度スケーリングの利点は、実装が簡単で低コストであり、モデルを再トレーニングせずに校正できることです。ただし、温度スケーリングはすべてのカテゴリの誤差が独立しており、同じスケールであると想定しているため、すべてのケースで分類器のパフォーマンスを効果的に向上させることが保証されておりませんが、これは実際のアプリケーションでは必ずしも当てはまりません。

2.Platt キャリブレーション (Platt スケーリング)

Platt キャリブレーションは比較的伝統的な分類キャリブレーション方法であり、その原理はロジスティック回帰に基づいています。モデルを作成し、ニューラル ネットワークの出力を当てはめて、校正された確率分布を取得します。具体的には、Platt キャリブレーションでは、バイナリ ロジスティック回帰モデルを導入してニューラル ネットワークの出力を適合させ、新しい確率分布を取得します。ロジスティック回帰モデルの入力はニューラル ネットワークの出力または特徴であり、出力は 0 ~ 1 の確率値です。ロジスティック回帰モデルを当てはめることにより、各カテゴリの修正確率値を取得できます。

Platt キャリブレーションの利点は、予測確率をより正確に推定でき、さまざまな分類問題に適していることです。ただし、Platt キャリブレーションにはモデル フィッティングが必要なため、計算コストが高く、ロジスティック回帰モデルをトレーニングするには大量のラベル付きデータが必要です。

2. 回帰キャリブレーション

回帰キャリブレーションとは、回帰モデルの出力を修正して、より信頼性と正確性を高めることを指します。回帰問題では、ニューラル ネットワークの出力は通常、予測されたターゲット変数の値を表す連続実数値です。ただし、これらの予測値には偏りや分散が存在する可能性があるため、予測の精度と信頼性を向上させるために回帰キャリブレーションが必要になります。

一般的に使用される回帰キャリブレーション方法には、次の 2 つがあります:

1. 履歴平均キャリブレーション 履歴平均キャリブレーションは、シンプルで効果的な回帰キャリブレーション手法であり、その原理は、履歴データを使用してターゲット変数の平均と分散を計算し、ニューラル ネットワークの予測値を調整することです。具体的には、履歴平均キャリブレーションでは、履歴データの平均と分散を計算してキャリブレーション係数を取得し、ニューラル ネットワークの予測値を真の目標値に近づけるように補正します。履歴平均キャリブレーションの利点は、シンプルで使いやすく、追加のトレーニング データや計算コストを必要とせず、さまざまな異なる回帰問題に適していることです。

2. 線形回帰キャリブレーション

線形回帰キャリブレーションは、線形回帰モデルに基づいた回帰キャリブレーション テクノロジです。線形モデルをフィッティングすることにより、ニューラル ネットワークの予測値を実際の目標値に近づけます。具体的には、線形回帰キャリブレーションでは、追加のラベル付きデータを使用して線形回帰モデルをトレーニングし、ニューラル ネットワークの予測値を入力として、真のターゲット値を出力として取得して線形マッピング関数を取得し、それによってニューラル ネットワークの予測値に基づいて予測を実行します。値、校正。

線形回帰キャリブレーションの利点は、予測値と目標値の間の関係をより正確に推定できることであり、さまざまな回帰問題に適していることです。ただし、線形回帰モデルのフィッティングには大量のラベル付きデータと計算コストが必要であり、非線形関係を伴う回帰問題には効果的ではない可能性があります。

一般に、分類キャリブレーションと回帰キャリブレーションはディープ ニューラル ネットワークにおける一般的なキャリブレーション手法であり、モデルのパフォーマンスと信頼性を向上させることができます。分類キャリブレーションは主に分類器の信頼度を調整して予測確率をより正確にします。回帰キャリブレーションは主に、予測値のバイアスと分散を修正することで予測結果を真の目標値に近づけます。実際のアプリケーションでは、特定の問題に応じて適切なキャリブレーション方法を選択し、他の手法と組み合わせてモデルのパフォーマンスを最適化する必要があります。

以上が分類キャリブレーションと回帰キャリブレーションのためのディープ ニューラル ネットワークの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

解读CRISP-ML(Q):机器学习生命周期流程Apr 08, 2023 pm 01:21 PM

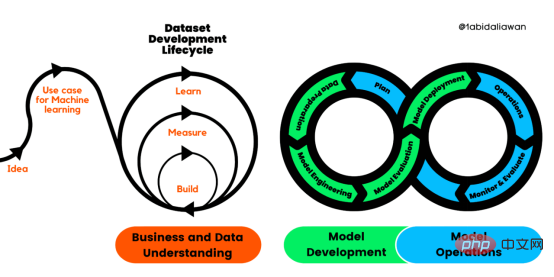

解读CRISP-ML(Q):机器学习生命周期流程Apr 08, 2023 pm 01:21 PM译者 | 布加迪审校 | 孙淑娟目前,没有用于构建和管理机器学习(ML)应用程序的标准实践。机器学习项目组织得不好,缺乏可重复性,而且从长远来看容易彻底失败。因此,我们需要一套流程来帮助自己在整个机器学习生命周期中保持质量、可持续性、稳健性和成本管理。图1. 机器学习开发生命周期流程使用质量保证方法开发机器学习应用程序的跨行业标准流程(CRISP-ML(Q))是CRISP-DM的升级版,以确保机器学习产品的质量。CRISP-ML(Q)有六个单独的阶段:1. 业务和数据理解2. 数据准备3. 模型

2023年机器学习的十大概念和技术Apr 04, 2023 pm 12:30 PM

2023年机器学习的十大概念和技术Apr 04, 2023 pm 12:30 PM机器学习是一个不断发展的学科,一直在创造新的想法和技术。本文罗列了2023年机器学习的十大概念和技术。 本文罗列了2023年机器学习的十大概念和技术。2023年机器学习的十大概念和技术是一个教计算机从数据中学习的过程,无需明确的编程。机器学习是一个不断发展的学科,一直在创造新的想法和技术。为了保持领先,数据科学家应该关注其中一些网站,以跟上最新的发展。这将有助于了解机器学习中的技术如何在实践中使用,并为自己的业务或工作领域中的可能应用提供想法。2023年机器学习的十大概念和技术:1. 深度神经网

基于因果森林算法的决策定位应用Apr 08, 2023 am 11:21 AM

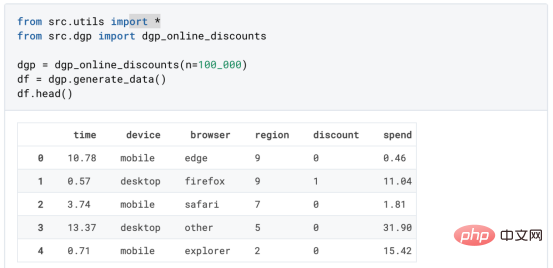

基于因果森林算法的决策定位应用Apr 08, 2023 am 11:21 AM译者 | 朱先忠审校 | 孙淑娟在我之前的博客中,我们已经了解了如何使用因果树来评估政策的异质处理效应。如果你还没有阅读过,我建议你在阅读本文前先读一遍,因为我们在本文中认为你已经了解了此文中的部分与本文相关的内容。为什么是异质处理效应(HTE:heterogenous treatment effects)呢?首先,对异质处理效应的估计允许我们根据它们的预期结果(疾病、公司收入、客户满意度等)选择提供处理(药物、广告、产品等)的用户(患者、用户、客户等)。换句话说,估计HTE有助于我

使用PyTorch进行小样本学习的图像分类Apr 09, 2023 am 10:51 AM

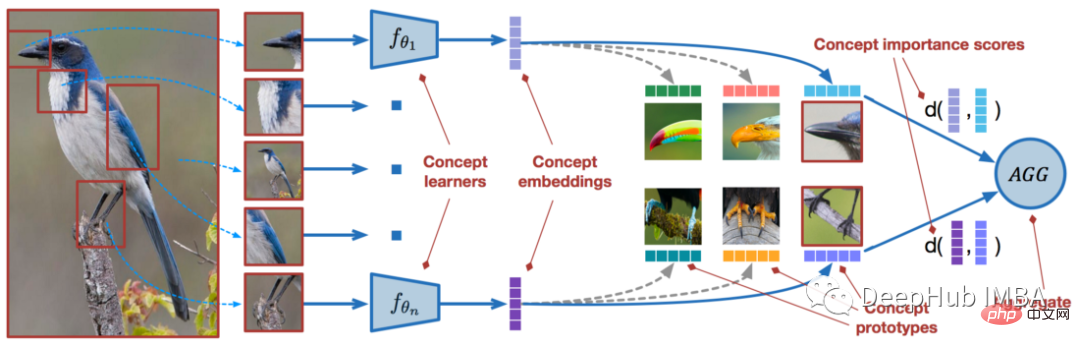

使用PyTorch进行小样本学习的图像分类Apr 09, 2023 am 10:51 AM近年来,基于深度学习的模型在目标检测和图像识别等任务中表现出色。像ImageNet这样具有挑战性的图像分类数据集,包含1000种不同的对象分类,现在一些模型已经超过了人类水平上。但是这些模型依赖于监督训练流程,标记训练数据的可用性对它们有重大影响,并且模型能够检测到的类别也仅限于它们接受训练的类。由于在训练过程中没有足够的标记图像用于所有类,这些模型在现实环境中可能不太有用。并且我们希望的模型能够识别它在训练期间没有见到过的类,因为几乎不可能在所有潜在对象的图像上进行训练。我们将从几个样本中学习

LazyPredict:为你选择最佳ML模型!Apr 06, 2023 pm 08:45 PM

LazyPredict:为你选择最佳ML模型!Apr 06, 2023 pm 08:45 PM本文讨论使用LazyPredict来创建简单的ML模型。LazyPredict创建机器学习模型的特点是不需要大量的代码,同时在不修改参数的情况下进行多模型拟合,从而在众多模型中选出性能最佳的一个。 摘要本文讨论使用LazyPredict来创建简单的ML模型。LazyPredict创建机器学习模型的特点是不需要大量的代码,同时在不修改参数的情况下进行多模型拟合,从而在众多模型中选出性能最佳的一个。本文包括的内容如下:简介LazyPredict模块的安装在分类模型中实施LazyPredict

Mango:基于Python环境的贝叶斯优化新方法Apr 08, 2023 pm 12:44 PM

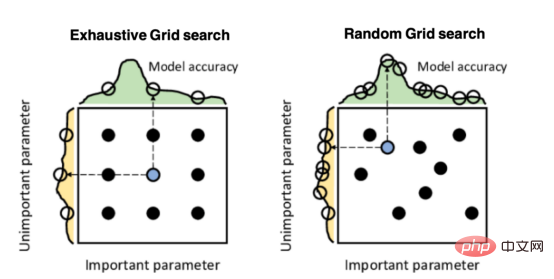

Mango:基于Python环境的贝叶斯优化新方法Apr 08, 2023 pm 12:44 PM译者 | 朱先忠审校 | 孙淑娟引言模型超参数(或模型设置)的优化可能是训练机器学习算法中最重要的一步,因为它可以找到最小化模型损失函数的最佳参数。这一步对于构建不易过拟合的泛化模型也是必不可少的。优化模型超参数的最著名技术是穷举网格搜索和随机网格搜索。在第一种方法中,搜索空间被定义为跨越每个模型超参数的域的网格。通过在网格的每个点上训练模型来获得最优超参数。尽管网格搜索非常容易实现,但它在计算上变得昂贵,尤其是当要优化的变量数量很大时。另一方面,随机网格搜索是一种更快的优化方法,可以提供更好的

人工智能自动获取知识和技能,实现自我完善的过程是什么Aug 24, 2022 am 11:57 AM

人工智能自动获取知识和技能,实现自我完善的过程是什么Aug 24, 2022 am 11:57 AM实现自我完善的过程是“机器学习”。机器学习是人工智能核心,是使计算机具有智能的根本途径;它使计算机能模拟人的学习行为,自动地通过学习来获取知识和技能,不断改善性能,实现自我完善。机器学习主要研究三方面问题:1、学习机理,人类获取知识、技能和抽象概念的天赋能力;2、学习方法,对生物学习机理进行简化的基础上,用计算的方法进行再现;3、学习系统,能够在一定程度上实现机器学习的系统。

超参数优化比较之网格搜索、随机搜索和贝叶斯优化Apr 04, 2023 pm 12:05 PM

超参数优化比较之网格搜索、随机搜索和贝叶斯优化Apr 04, 2023 pm 12:05 PM本文将详细介绍用来提高机器学习效果的最常见的超参数优化方法。 译者 | 朱先忠审校 | 孙淑娟简介通常,在尝试改进机器学习模型时,人们首先想到的解决方案是添加更多的训练数据。额外的数据通常是有帮助(在某些情况下除外)的,但生成高质量的数据可能非常昂贵。通过使用现有数据获得最佳模型性能,超参数优化可以节省我们的时间和资源。顾名思义,超参数优化是为机器学习模型确定最佳超参数组合以满足优化函数(即,给定研究中的数据集,最大化模型的性能)的过程。换句话说,每个模型都会提供多个有关选项的调整“按钮

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

ドリームウィーバー CS6

ビジュアル Web 開発ツール

MantisBT

Mantis は、製品の欠陥追跡を支援するために設計された、導入が簡単な Web ベースの欠陥追跡ツールです。 PHP、MySQL、Web サーバーが必要です。デモおよびホスティング サービスをチェックしてください。

ZendStudio 13.5.1 Mac

強力な PHP 統合開発環境

メモ帳++7.3.1

使いやすく無料のコードエディター

DVWA

Damn Vulnerable Web App (DVWA) は、非常に脆弱な PHP/MySQL Web アプリケーションです。その主な目的は、セキュリティ専門家が法的環境でスキルとツールをテストするのに役立ち、Web 開発者が Web アプリケーションを保護するプロセスをより深く理解できるようにし、教師/生徒が教室環境で Web アプリケーションを教え/学習できるようにすることです。安全。 DVWA の目標は、シンプルでわかりやすいインターフェイスを通じて、さまざまな難易度で最も一般的な Web 脆弱性のいくつかを実践することです。このソフトウェアは、

ホットトピック

7444

7444 15

15 1371

1371 52

52